VL-KnG: Visual Scene Understanding for Navigation Goal Identification using Spatiotemporal Knowledge Graphs

作者: Mohamad Al Mdfaa, Svetlana Lukina, Timur Akhtyamov, Arthur Nigmatzyanov, Dmitrii Nalberskii, Sergey Zagoruyko, Gonzalo Ferrer

分类: cs.RO, cs.AI

发布日期: 2025-10-01

备注: This work has been submitted to the IEEE for possible publication

💡 一句话要点

VL-KnG:利用时空知识图谱进行视觉场景理解,解决导航目标识别问题

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱八:物理动画 (Physics-based Animation)

关键词: 视觉场景理解 知识图谱 机器人导航 视觉-语言模型 时空推理

📋 核心要点

- 现有视觉-语言模型在机器人导航中面临场景记忆不足、空间推理有限以及长视频处理效率低下的挑战。

- VL-KnG通过构建时空知识图谱,利用可查询的图结构实现可解释的空间推理,从而解决上述问题。

- 实验表明,VL-KnG在导航目标识别任务中达到与Gemini 2.5 Pro相当的性能,并提供可解释的推理过程。

📝 摘要(中文)

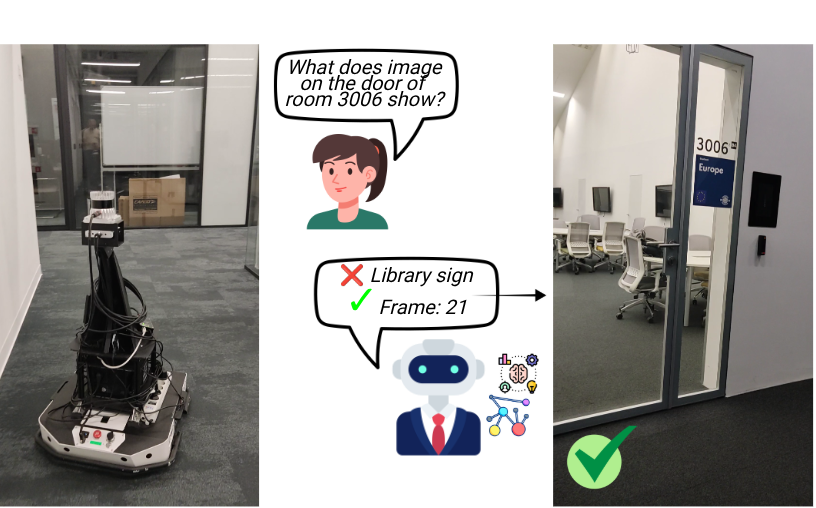

视觉-语言模型(VLMs)在机器人导航方面展现出潜力,但存在根本性局限:缺乏持久的场景记忆,空间推理能力有限,且无法有效扩展到实时应用的长视频。我们提出了VL-KnG,一个视觉场景理解系统,它通过构建时空知识图谱和高效的查询处理来解决导航目标识别的这些挑战。我们的方法分块处理视频序列,利用现代VLMs创建持久的知识图谱,维护对象随时间的身份,并通过可查询的图结构实现可解释的空间推理。我们还引入了WalkieKnowledge,一个新的基准测试,包含约200个手动标注的问题,涵盖8条不同的轨迹,跨越约100分钟的视频数据,从而可以公平地比较结构化方法和通用VLMs。在差速驱动机器人上的真实部署表明了实际应用性,我们的方法实现了77.27%的成功率和76.92%的答案准确率,与Gemini 2.5 Pro的性能相匹配,同时提供了由知识图谱支持的可解释推理,以及在定位、导航和规划等不同任务中进行实时部署的计算效率。

🔬 方法详解

问题定义:论文旨在解决机器人导航中,视觉-语言模型在理解复杂场景和进行有效空间推理方面的不足。现有方法难以维持长期场景记忆,无法有效处理长视频,并且缺乏可解释性,限制了其在实际机器人应用中的潜力。

核心思路:核心思路是构建一个时空知识图谱,该图谱能够持久地记录场景中的对象及其关系,并支持高效的查询和推理。通过将视觉信息转化为结构化的知识表示,可以克服传统VLMs的局限性,提高导航目标识别的准确性和可解释性。

技术框架:VL-KnG系统主要包含以下几个阶段:1) 视频分块处理:将长视频分割成较小的片段,以便于VLMs处理。2) 知识图谱构建:利用VLMs提取每个视频片段中的对象和关系,并将这些信息添加到知识图谱中。图谱维护对象随时间的身份,确保长期一致性。3) 查询处理:接收导航目标相关的查询,并在知识图谱上执行查询,以找到最佳的导航策略。4) 机器人控制:根据查询结果,控制机器人执行相应的导航动作。

关键创新:最重要的技术创新在于将视觉信息转化为可查询的时空知识图谱,并利用该图谱进行导航目标识别。与传统的端到端VLMs相比,VL-KnG提供了一种结构化的、可解释的推理过程,并且能够更好地处理长视频和复杂场景。

关键设计:论文中关键的设计包括:1) 知识图谱的表示方式,需要能够有效地存储对象、关系和时间信息。2) 查询处理算法,需要能够高效地在知识图谱上找到答案。3) 视频分块策略,需要在计算效率和信息完整性之间进行权衡。此外,WalkieKnowledge基准测试的构建也为评估和比较不同的导航方法提供了标准。

🖼️ 关键图片

📊 实验亮点

VL-KnG在WalkieKnowledge基准测试上取得了显著成果,在真实机器人部署中,成功率达到77.27%,答案准确率达到76.92%,与Gemini 2.5 Pro的性能相媲美。更重要的是,VL-KnG提供了可解释的推理过程,并具有实时部署的计算效率,这使其在实际应用中更具优势。

🎯 应用场景

该研究成果可应用于各种机器人导航场景,例如家庭服务机器人、仓库物流机器人、自动驾驶汽车等。通过提供更准确、可解释的导航能力,可以提高机器人的自主性和可靠性,使其能够更好地适应复杂和动态的环境。未来,该技术有望扩展到更广泛的视觉场景理解任务,例如智能监控、虚拟现实等。

📄 摘要(原文)

Vision-language models (VLMs) have shown potential for robot navigation but encounter fundamental limitations: they lack persistent scene memory, offer limited spatial reasoning, and do not scale effectively with video duration for real-time application. We present VL-KnG, a Visual Scene Understanding system that tackles these challenges using spatiotemporal knowledge graph construction and computationally efficient query processing for navigation goal identification. Our approach processes video sequences in chunks utilizing modern VLMs, creates persistent knowledge graphs that maintain object identity over time, and enables explainable spatial reasoning through queryable graph structures. We also introduce WalkieKnowledge, a new benchmark with about 200 manually annotated questions across 8 diverse trajectories spanning approximately 100 minutes of video data, enabling fair comparison between structured approaches and general-purpose VLMs. Real-world deployment on a differential drive robot demonstrates practical applicability, with our method achieving 77.27% success rate and 76.92% answer accuracy, matching Gemini 2.5 Pro performance while providing explainable reasoning supported by the knowledge graph, computational efficiency for real-time deployment across different tasks, such as localization, navigation and planning. Code and dataset will be released after acceptance.