MultiPhysio-HRC: Multimodal Physiological Signals Dataset for industrial Human-Robot Collaboration

作者: Andrea Bussolan, Stefano Baraldo, Oliver Avram, Pablo Urcola, Luis Montesano, Luca Maria Gambardella, Anna Valente

分类: cs.RO

发布日期: 2025-10-01

💡 一句话要点

MultiPhysio-HRC:用于工业人机协作的多模态生理信号数据集

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 人机协作 多模态数据集 生理信号 情感计算 认知负荷 工业机器人 虚拟现实 工作场所福祉

📋 核心要点

- 现有的人机协作研究缺乏足够真实和全面的生理数据,难以准确评估人类的精神状态。

- MultiPhysio-HRC数据集通过整合多种生理信号、音频和面部数据,全面捕捉人类在人机协作中的精神状态。

- 论文评估了压力和认知负荷分类的基线模型,验证了数据集在情感计算和人机协作机器人研究中的潜力。

📝 摘要(中文)

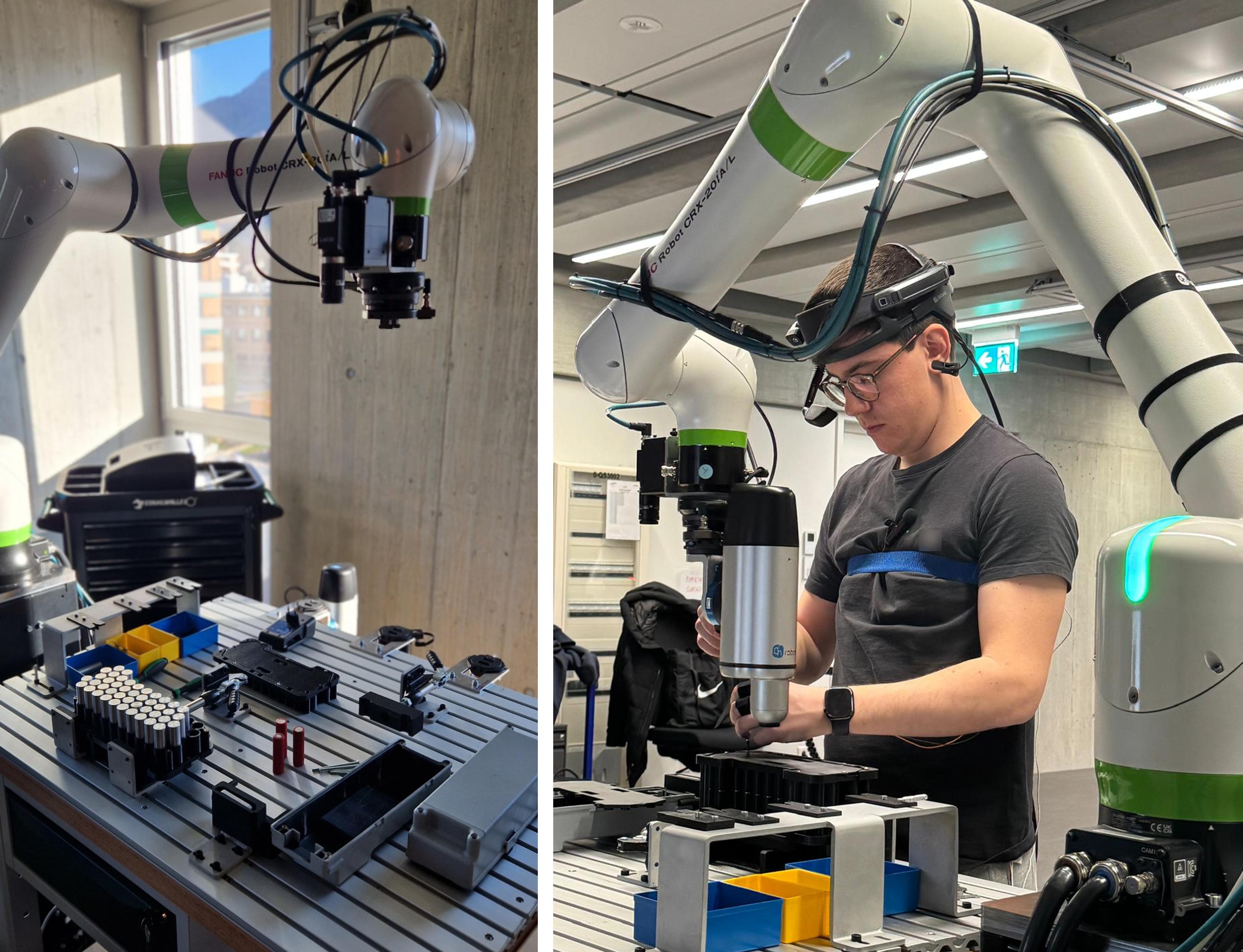

本文介绍了MultiPhysio-HRC,一个多模态数据集,包含在真实人机协作(HRC)场景中收集的生理、音频和面部数据。该数据集包括脑电图(EEG)、心电图(ECG)、皮肤电活动(EDA)、呼吸(RESP)、肌电图(EMG)、语音记录和面部动作单元。数据集整合了受控认知任务、沉浸式虚拟现实体验以及手动和机器人辅助的工业拆卸活动,以全面捕捉参与者的精神状态。通过验证的心理自评问卷获得了丰富的ground truth标注。对压力和认知负荷分类的基线模型进行了评估,证明了该数据集在情感计算和以人为本的机器人研究中的潜力。MultiPhysio-HRC是公开可用的,旨在支持以人为中心的自动化、工作场所福祉和智能机器人系统方面的研究。

🔬 方法详解

问题定义:现有的人机协作研究中,缺乏高质量、多模态的生理信号数据集,难以准确地理解和预测人类操作者的认知状态和情绪状态,从而限制了人机协作的智能化和自适应性。现有的数据集往往数据量不足,或者场景不够真实,难以反映实际工业环境中的复杂情况。

核心思路:论文的核心思路是构建一个包含多种生理信号、音频和面部数据的大型数据集,这些数据是在真实的工业人机协作场景中收集的。通过整合受控认知任务、虚拟现实体验和工业拆卸活动,全面捕捉参与者的精神状态,并使用心理自评问卷进行ground truth标注。

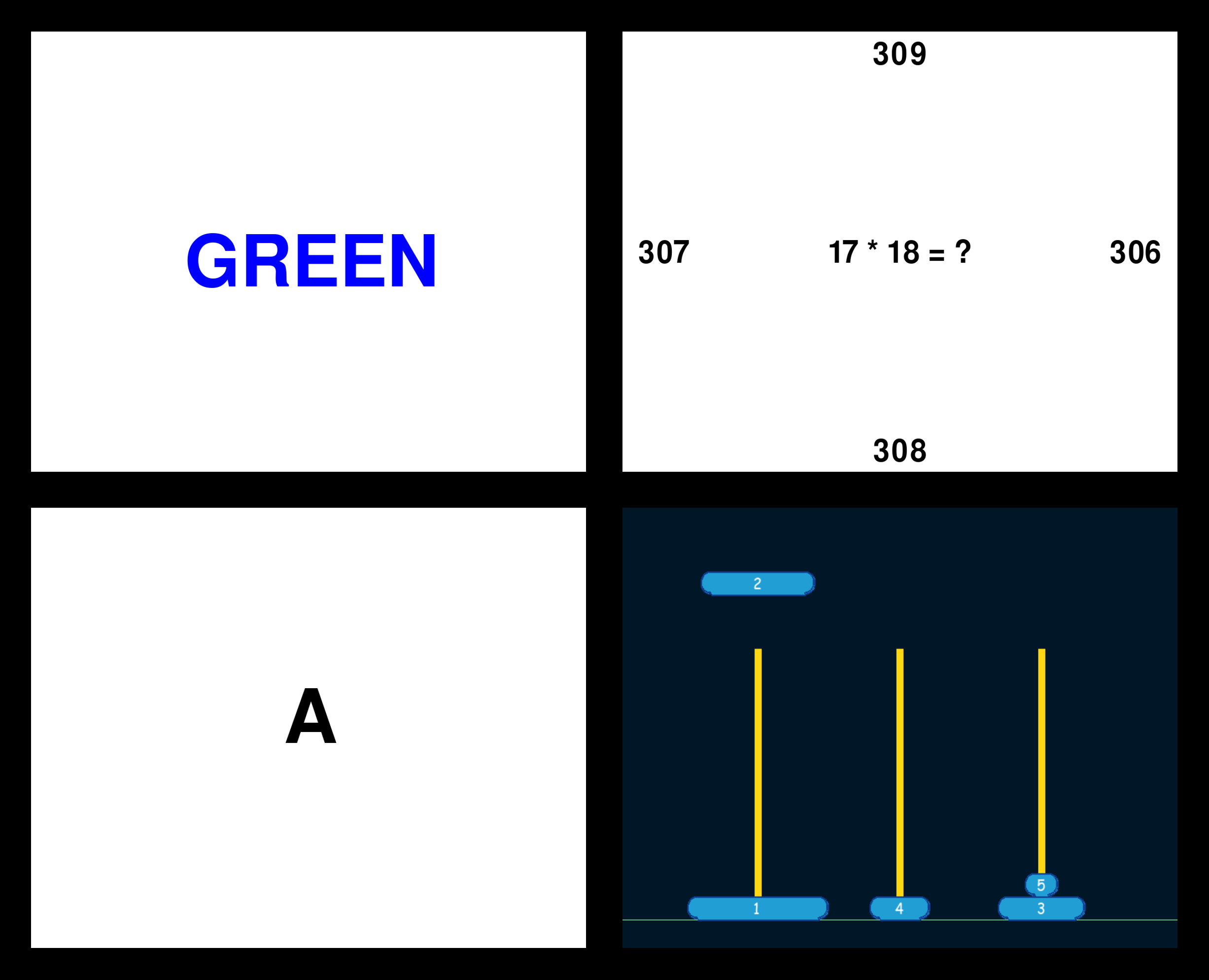

技术框架:MultiPhysio-HRC数据集的构建流程包括以下几个主要阶段: 1. 实验设计:设计包含受控认知任务、虚拟现实体验和工业拆卸活动的实验场景。 2. 数据采集:使用多种传感器同步采集参与者的生理信号(EEG、ECG、EDA、RESP、EMG)、音频和面部数据。 3. 数据标注:使用心理自评问卷获取参与者的主观感受,作为ground truth。 4. 数据预处理:对采集到的数据进行清洗、降噪和标准化处理。 5. 基线模型评估:使用数据集训练和评估压力和认知负荷分类的基线模型。

关键创新:MultiPhysio-HRC数据集的关键创新在于其多模态性、真实性和全面性。它整合了多种生理信号、音频和面部数据,是在真实的工业人机协作场景中收集的,并且包含了受控认知任务、虚拟现实体验和工业拆卸活动,能够全面捕捉参与者的精神状态。

关键设计:数据集包含了以下关键设计: * 生理信号:EEG (脑电图), ECG (心电图), EDA (皮肤电活动), RESP (呼吸), EMG (肌电图) * 其他模态:语音记录, 面部动作单元 * 任务类型:受控认知任务, 沉浸式虚拟现实体验, 工业拆卸活动 (手动和机器人辅助) * 标注方法:心理自评问卷

🖼️ 关键图片

📊 实验亮点

论文通过在MultiPhysio-HRC数据集上评估压力和认知负荷分类的基线模型,验证了数据集的有效性。虽然具体的性能数据未在摘要中给出,但实验结果表明该数据集具有在情感计算和以人为本的机器人研究中的潜力,为后续研究提供了有价值的资源。

🎯 应用场景

该研究成果可广泛应用于人机协作、智能制造、工作场所安全和福祉等领域。通过分析生理信号,机器人可以感知人类操作者的认知状态和情绪状态,从而调整自身行为,提高协作效率和安全性。此外,该数据集还可以用于开发新型的人机交互界面和智能辅助系统,提升工作场所的整体福祉。

📄 摘要(原文)

Human-robot collaboration (HRC) is a key focus of Industry 5.0, aiming to enhance worker productivity while ensuring well-being. The ability to perceive human psycho-physical states, such as stress and cognitive load, is crucial for adaptive and human-aware robotics. This paper introduces MultiPhysio-HRC, a multimodal dataset containing physiological, audio, and facial data collected during real-world HRC scenarios. The dataset includes electroencephalography (EEG), electrocardiography (ECG), electrodermal activity (EDA), respiration (RESP), electromyography (EMG), voice recordings, and facial action units. The dataset integrates controlled cognitive tasks, immersive virtual reality experiences, and industrial disassembly activities performed manually and with robotic assistance, to capture a holistic view of the participants' mental states. Rich ground truth annotations were obtained using validated psychological self-assessment questionnaires. Baseline models were evaluated for stress and cognitive load classification, demonstrating the dataset's potential for affective computing and human-aware robotics research. MultiPhysio-HRC is publicly available to support research in human-centered automation, workplace well-being, and intelligent robotic systems.