TacRefineNet: Tactile-Only Grasp Refinement Between Arbitrary In-Hand Object Poses

作者: Shuaijun Wang, Haoran Zhou, Diyun Xiang, Yangwei You

分类: cs.RO

发布日期: 2025-09-30

备注: 9 pages, 9 figures

💡 一句话要点

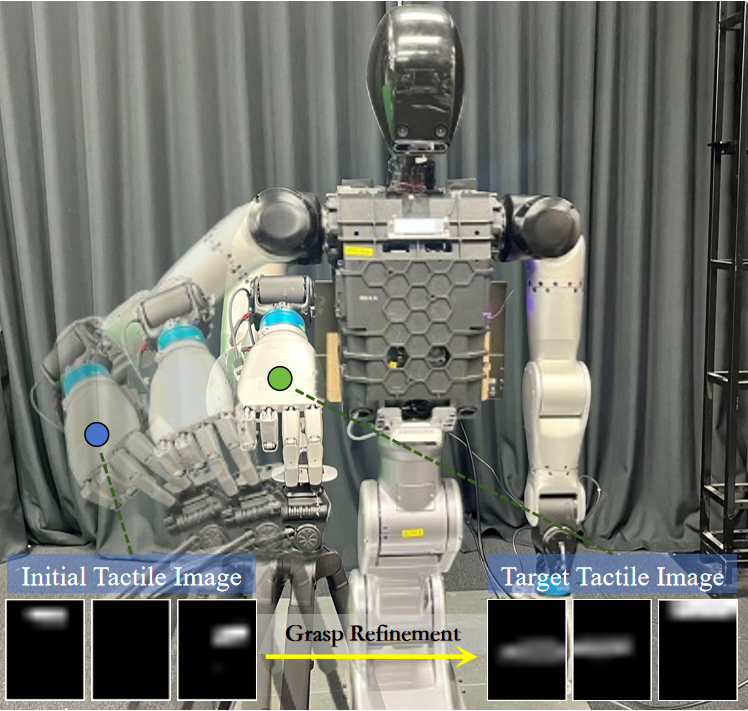

TacRefineNet:提出一种仅用触觉的多指灵巧手末端姿态精确调整方法

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 触觉感知 灵巧抓取 姿态调整 机器人控制 深度学习

📋 核心要点

- 现有灵巧抓取流程在抓取执行阶段易受姿态不准确的影响,尤其是在长时任务中,降低整体性能。

- TacRefineNet利用多指触觉信息,迭代调整末端执行器姿态,使物体与期望配置对齐,实现精确的末端姿态调整。

- 通过模拟数据预训练和真实数据微调,TacRefineNet在真实世界实验中仅使用触觉输入就实现了毫米级的抓取精度。

📝 摘要(中文)

本文提出TacRefineNet,一个仅使用触觉信息的框架,用于在任意目标姿态下对已知物体进行精确的末端姿态调整。该方法通过多指指尖触觉传感,迭代地调整末端执行器的姿态,使物体与期望的配置对齐。我们设计了一个多分支策略网络,融合来自多个手指的触觉输入和本体感受信息,以预测精确的控制更新。为了训练该策略,我们结合了来自MuJoCo中基于物理的触觉模型的大规模模拟数据和从物理系统收集的真实世界数据。对比实验表明,在模拟数据上进行预训练,并用少量真实数据进行微调,可以显著提高性能。广泛的真实世界实验验证了该方法的有效性,仅使用触觉输入即可实现毫米级的抓取精度。据我们所知,这是第一个仅通过多指触觉传感实现任意末端姿态调整的方法。

🔬 方法详解

问题定义:现有灵巧抓取流程,特别是长时任务中,抓取执行阶段的姿态不准确问题严重影响了整体性能。传统方法依赖视觉信息,但在遮挡、光照变化等情况下表现不佳。因此,需要一种鲁棒的、仅依赖触觉信息的末端姿态调整方法,以提高抓取的精度和可靠性。

核心思路:TacRefineNet的核心思路是利用多指指尖的触觉信息,通过迭代调整末端执行器的姿态,逐步将物体调整到期望的目标姿态。这种方法避免了对视觉信息的依赖,更加鲁棒,并且能够利用多指协同的触觉感知能力,实现更精确的姿态调整。

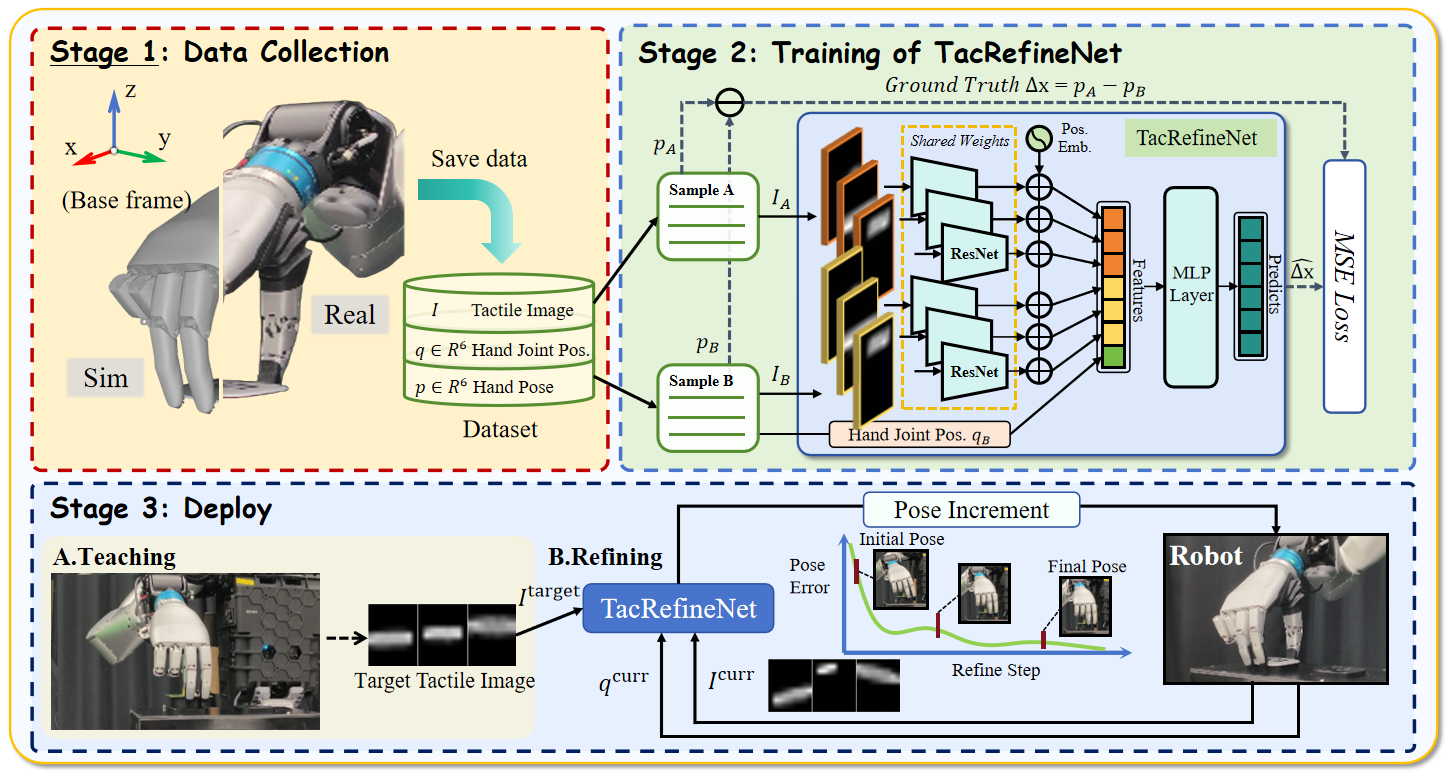

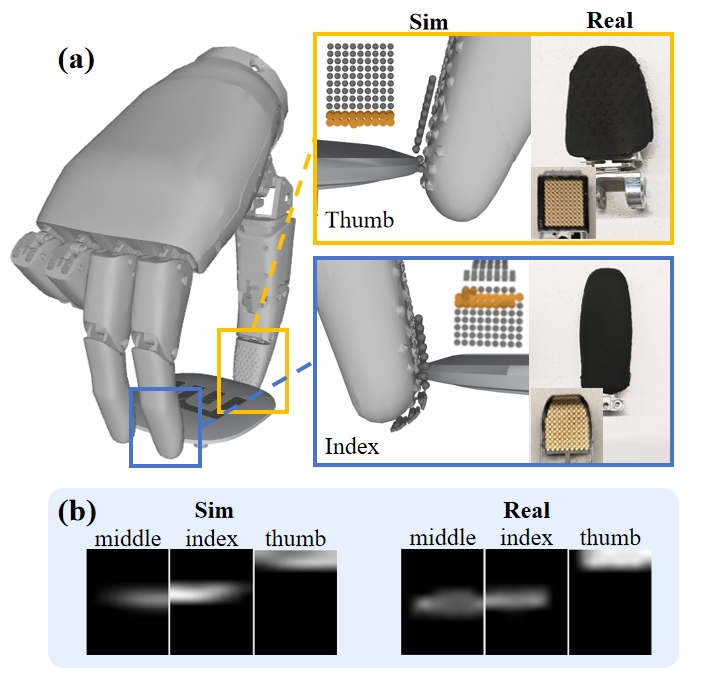

技术框架:TacRefineNet的整体框架包含以下几个主要模块:1) 触觉数据采集模块:利用多指指尖的触觉传感器获取触觉信息。2) 多分支策略网络:该网络融合来自多个手指的触觉输入和本体感受信息,预测末端执行器的控制更新。3) 控制执行模块:根据策略网络的输出,控制末端执行器进行姿态调整。4) 迭代优化模块:通过迭代执行策略网络和控制执行模块,逐步将物体调整到期望的目标姿态。

关键创新:TacRefineNet最重要的技术创新点在于,它是一种仅使用触觉信息实现任意末端姿态调整的方法。与现有方法相比,TacRefineNet不需要依赖视觉信息,更加鲁棒,并且能够利用多指协同的触觉感知能力,实现更精确的姿态调整。此外,该方法还采用了模拟数据预训练和真实数据微调的策略,有效提高了模型的泛化能力。

关键设计:TacRefineNet的关键设计包括:1) 多分支策略网络:该网络采用多分支结构,分别处理来自不同手指的触觉输入,然后将这些输入融合在一起,预测末端执行器的控制更新。2) 损失函数:损失函数的设计目标是使末端执行器的姿态逐步接近期望的目标姿态。3) 模拟数据预训练和真实数据微调:通过在模拟数据上进行预训练,可以使模型学习到一些通用的触觉感知知识。然后,通过在真实数据上进行微调,可以使模型适应真实世界的触觉特性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,TacRefineNet在真实世界中仅使用触觉输入即可实现毫米级的抓取精度,显著优于仅使用模拟数据训练的模型。通过模拟数据预训练和真实数据微调,TacRefineNet的性能得到了显著提升,验证了该方法的有效性。该方法在不同物体和不同目标姿态下均表现出良好的泛化能力。

🎯 应用场景

TacRefineNet在机器人灵巧操作领域具有广泛的应用前景,例如在装配、医疗、家庭服务等场景中,可以用于提高机器人抓取的精度和可靠性。该方法还可以应用于虚拟现实和增强现实领域,为用户提供更加真实的触觉反馈。此外,该研究对于开发更加智能和自主的机器人系统具有重要的理论意义。

📄 摘要(原文)

Despite progress in both traditional dexterous grasping pipelines and recent Vision-Language-Action (VLA) approaches, the grasp execution stage remains prone to pose inaccuracies, especially in long-horizon tasks, which undermines overall performance. To address this "last-mile" challenge, we propose TacRefineNet, a tactile-only framework that achieves fine in-hand pose refinement of known objects in arbitrary target poses using multi-finger fingertip sensing. Our method iteratively adjusts the end-effector pose based on tactile feedback, aligning the object to the desired configuration. We design a multi-branch policy network that fuses tactile inputs from multiple fingers along with proprioception to predict precise control updates. To train this policy, we combine large-scale simulated data from a physics-based tactile model in MuJoCo with real-world data collected from a physical system. Comparative experiments show that pretraining on simulated data and fine-tuning with a small amount of real data significantly improves performance over simulation-only training. Extensive real-world experiments validate the effectiveness of the method, achieving millimeter-level grasp accuracy using only tactile input. To our knowledge, this is the first method to enable arbitrary in-hand pose refinement via multi-finger tactile sensing alone. Project website is available at https://sites.google.com/view/tacrefinenet