IA-VLA: Input Augmentation for Vision-Language-Action models in settings with semantically complex tasks

作者: Eric Hannus, Miika Malin, Tran Nguyen Le, Ville Kyrki

分类: cs.RO

发布日期: 2025-09-29

备注: Under review for ICRA 2026

💡 一句话要点

提出IA-VLA框架,利用大型视觉语言模型增强VLA在语义复杂任务中的表现

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉语言动作模型 机器人操作 语义理解 输入增强 视觉重复对象

📋 核心要点

- VLA模型在机器人操作中应用广泛,但受限于计算资源,其语言理解能力不足以处理复杂指令。

- IA-VLA框架利用大型视觉语言模型预处理输入,生成更丰富的上下文信息,增强VLA的输入。

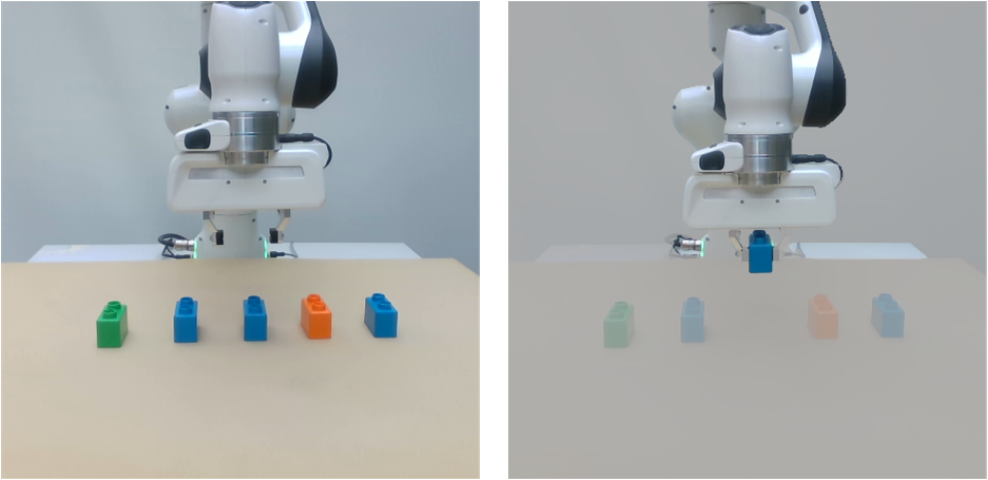

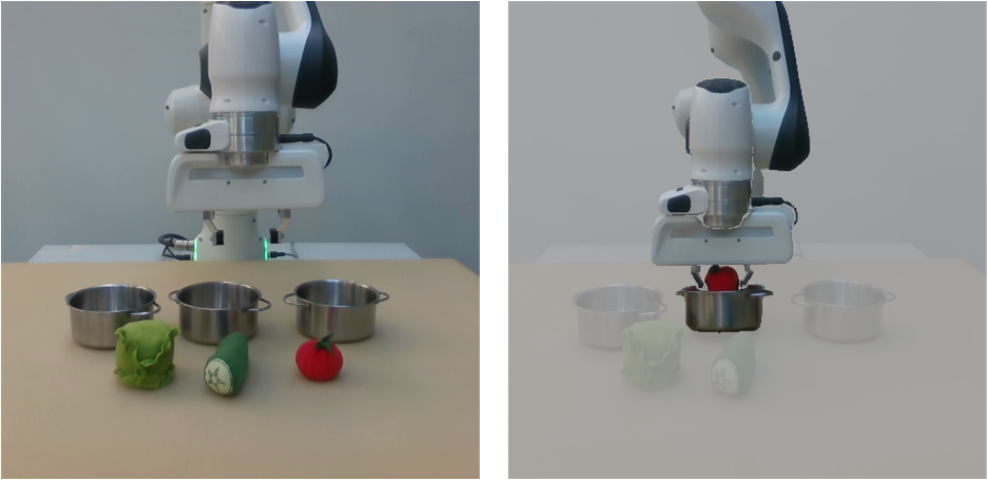

- 实验表明,IA-VLA在处理包含视觉重复对象的语义复杂任务时,性能优于基线VLA模型。

📝 摘要(中文)

近年来,视觉-语言-动作模型(VLA)已成为解决机器人操作问题的一种日益流行的方法。然而,此类模型需要以适合机器人控制的速率输出动作,这限制了它们所能基于的语言模型的大小,并因此限制了它们的语言理解能力。操作任务可能需要复杂的语言指令,例如通过相对位置识别目标对象,以指定人类意图。因此,我们引入了IA-VLA,该框架利用大型视觉语言模型的广泛语言理解能力作为预处理阶段,以生成改进的上下文来增强VLA的输入。我们在VLA文献中尚未充分探索的一组语义复杂任务上评估了该框架,即涉及视觉重复项(即视觉上无法区分的对象)的任务。使用包含三种类型重复对象场景的数据集来比较基线VLA与两个增强变体。实验表明,VLA受益于增强方案,尤其是在面对需要VLA从演示中看到的概括概念的语言指令时。代码、数据集和视频请参见https://sites.google.com/view/ia-vla。

🔬 方法详解

问题定义:现有的视觉-语言-动作模型(VLA)在处理需要复杂语义理解的任务时面临挑战,尤其是在指令涉及视觉上难以区分的对象时。由于VLA模型需要快速输出动作以适应机器人控制,因此其语言模型的规模受到限制,导致其语言理解能力不足,无法准确解析复杂的指令,从而影响操作的准确性。

核心思路:IA-VLA的核心思路是利用大型视觉语言模型(VLM)强大的语言理解能力,对输入进行预处理和增强。VLM能够理解复杂的语言指令,并提取关键信息,然后将这些信息以更易于VLA理解的形式传递给VLA模型。通过这种方式,VLA模型可以专注于动作的生成,而无需承担复杂的语言理解任务。

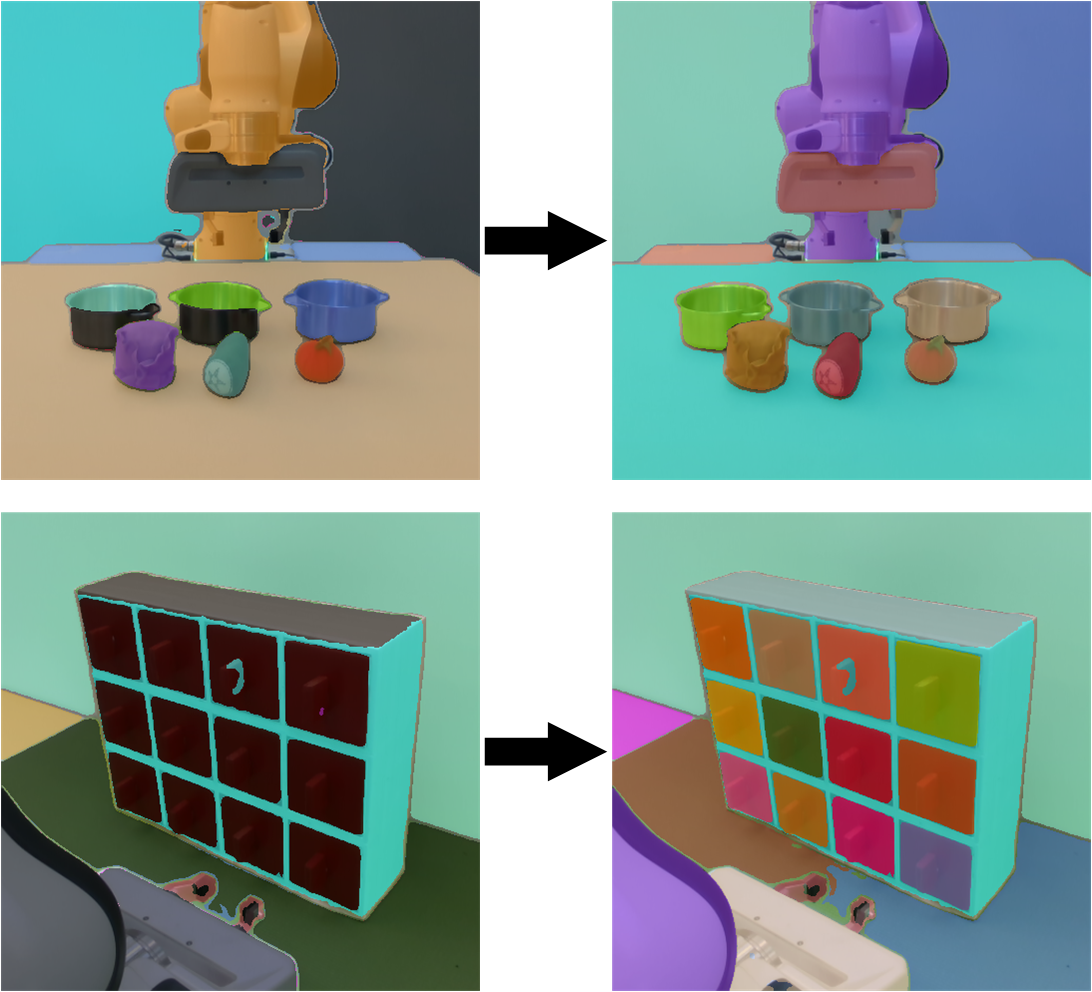

技术框架:IA-VLA框架包含两个主要阶段:预处理阶段和动作生成阶段。在预处理阶段,输入图像和语言指令被送入大型视觉语言模型(VLM)。VLM分析图像和指令,提取关键信息,并生成增强的上下文信息。这些增强的上下文信息与原始输入一起传递到动作生成阶段。在动作生成阶段,VLA模型接收增强的输入,并生成相应的动作指令,控制机器人执行任务。

关键创新:IA-VLA的关键创新在于利用大型视觉语言模型作为VLA的预处理器,从而将复杂的语言理解任务从VLA模型中解耦出来。这种方法允许VLA模型专注于动作生成,同时利用VLM强大的语言理解能力来处理复杂的指令。这种架构使得VLA模型能够更好地处理语义复杂的任务,例如涉及视觉重复对象的任务。

关键设计:IA-VLA框架的关键设计包括选择合适的视觉语言模型(VLM)和设计有效的上下文增强策略。论文中使用了特定的VLM(具体模型未知),并设计了一种将VLM的输出与原始输入相结合的策略。具体的损失函数和网络结构细节在论文中没有详细说明,但可以推测使用了标准的VLA训练方法,并针对增强的输入进行了调整。参数设置的具体数值未知。

🖼️ 关键图片

📊 实验亮点

实验结果表明,IA-VLA框架在处理包含视觉重复对象的语义复杂任务时,性能显著优于基线VLA模型。具体提升幅度未知,但论文强调了在需要VLA从演示中看到的概括概念的语言指令时,增强效果尤为明显。该结果验证了利用大型视觉语言模型增强VLA输入的有效性。

🎯 应用场景

IA-VLA框架可应用于各种需要机器人操作的复杂场景,例如:在仓库中拣选外观相似的物品、在家庭环境中根据复杂指令操作家务机器人、在医疗环境中辅助医生进行手术操作等。该研究有助于提升机器人在复杂环境中的自主性和智能化水平,具有广阔的应用前景。

📄 摘要(原文)

Vision-language-action models (VLAs) have become an increasingly popular approach for addressing robot manipulation problems in recent years. However, such models need to output actions at a rate suitable for robot control, which limits the size of the language model they can be based on, and consequently, their language understanding capabilities. Manipulation tasks may require complex language instructions, such as identifying target objects by their relative positions, to specify human intention. Therefore, we introduce IA-VLA, a framework that utilizes the extensive language understanding of a large vision language model as a pre-processing stage to generate improved context to augment the input of a VLA. We evaluate the framework on a set of semantically complex tasks which have been underexplored in VLA literature, namely tasks involving visual duplicates, i.e., visually indistinguishable objects. A dataset of three types of scenes with duplicate objects is used to compare a baseline VLA against two augmented variants. The experiments show that the VLA benefits from the augmentation scheme, especially when faced with language instructions that require the VLA to extrapolate from concepts it has seen in the demonstrations. For the code, dataset, and videos, see https://sites.google.com/view/ia-vla.