Game Theory to Study Cooperation in Human-Robot Mixed Groups: Exploring the Potential of the Public Good Game

作者: Giulia Pusceddu, Sara Mongile, Francesco Rea, Alessandra Sciutti

分类: cs.RO

发布日期: 2025-09-29

备注: Work presented at the workshop BAILAR in conjunction with IEEE RO-MAN 2023. Peer reviewed

💡 一句话要点

利用公共物品博弈研究人机混合群体中的合作行为

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 人机交互 公共物品博弈 合作行为 机器人策略 社交机器人

📋 核心要点

- 现有方法难以有效建模人机混合群体中的合作与信任关系,阻碍了社交机器人的发展。

- 论文采用公共物品博弈(PGG)框架,设计机器人策略来影响人类参与者的合作意愿。

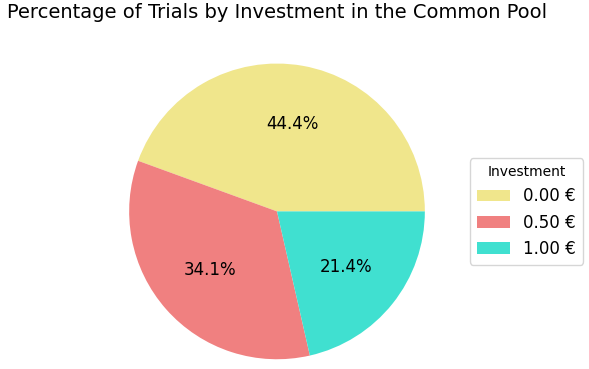

- 初步实验表明,人类参与者在与机器人互动时,合作意愿受到机器人策略的影响,但仍倾向于不投入公共池。

📝 摘要(中文)

本研究探索了博弈论在研究人机混合群体中的合作和信任方面的潜力。特别地,我们引入了公共物品博弈(PGG),该模型突出了个体私利与集体福祉之间的紧张关系。本文提出了一种改进的PGG版本,其中三名人类参与者与人形机器人iCub进行博弈,以评估不同的机器人博弈策略(例如,总是合作、总是搭便车和以牙还牙)是否会影响参与者合作的倾向。我们通过一项包含19名参与者的初步研究测试了我们的设置。初步分析表明,尽管参与者认为机器人是慷慨的,但他们更倾向于不将资金投入公共池。通过这项研究,我们旨在深入了解机器人在促进人机交互中信任和凝聚力方面的作用。这项研究的结果可能对开发能够促进人机混合群体中信任与合作的社交机器人具有相当大的潜力。

🔬 方法详解

问题定义:论文旨在解决人机混合群体中如何促进合作和信任的问题。现有方法通常难以量化和建模人类与机器人之间的复杂互动,尤其是在涉及个体利益与集体利益冲突的情况下。因此,如何设计合适的机器人行为策略来引导人类参与者进行合作,是本研究的核心问题。

核心思路:论文的核心思路是利用博弈论中的公共物品博弈(PGG)模型,模拟人机混合群体中的合作场景。通过设计不同的机器人策略(如总是合作、总是搭便车、以牙还牙),观察人类参与者在不同策略下的合作行为,从而评估机器人策略对人类合作意愿的影响。这种方法能够量化合作行为,并分析不同策略的有效性。

技术框架:整体框架包括以下几个主要步骤:1)设计改进的PGG游戏规则,允许人类参与者与机器人共同参与;2)设计不同的机器人博弈策略,例如总是合作、总是搭便车和以牙还牙;3)招募人类参与者,让他们与机器人进行多轮PGG游戏;4)收集参与者的投资数据,分析不同机器人策略下参与者的合作倾向;5)使用统计方法分析数据,评估机器人策略对合作行为的影响。

关键创新:本研究的关键创新在于将博弈论中的公共物品博弈模型应用于人机交互领域,并设计了可控的机器人策略来影响人类的合作行为。与传统的心理学实验相比,这种方法能够更精确地量化合作行为,并分析不同策略的有效性。此外,通过使用人形机器人iCub作为实验平台,可以模拟更真实的社交互动场景。

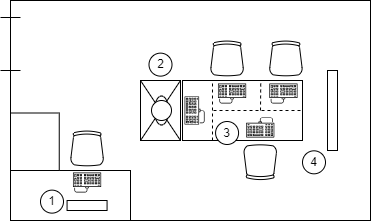

关键设计:实验中,三名人类参与者与一个iCub机器人共同参与PGG。每轮游戏开始时,每个参与者都会获得一定数量的初始资金。参与者可以选择将部分或全部资金投入公共池,也可以选择保留。投入公共池的资金会乘以一个系数(大于1但小于参与者人数),然后平均分配给所有参与者。机器人根据预设的策略(总是合作、总是搭便车、以牙还牙)决定其投资行为。实验记录每轮游戏中每个参与者的投资金额,并分析不同机器人策略下人类参与者的合作倾向。

🖼️ 关键图片

📊 实验亮点

初步实验结果表明,尽管参与者认为机器人是慷慨的,但他们更倾向于不将资金投入公共池。这表明,仅仅依靠机器人的慷慨行为可能不足以促进人类的合作。未来的研究需要探索更有效的机器人策略,例如基于信任建立和声誉管理的策略,以提高人机混合群体中的合作水平。

🎯 应用场景

该研究成果可应用于开发更具社交能力的机器人,例如在协作机器人、教育机器人和医疗机器人等领域。通过设计能够促进信任和合作的机器人行为策略,可以提高人机协作效率,改善用户体验,并增强机器人在社会环境中的适应性。未来的研究可以进一步探索更复杂的机器人策略,以及不同文化背景下人类的合作行为。

📄 摘要(原文)

In this study, we explore the potential of Game Theory as a means to investigate cooperation and trust in human-robot mixed groups. Particularly, we introduce the Public Good Game (PGG), a model highlighting the tension between individual self-interest and collective well-being. In this work, we present a modified version of the PGG, where three human participants engage in the game with the humanoid robot iCub to assess whether various robot game strategies (e.g., always cooperate, always free ride, and tit-for-tat) can influence the participants' inclination to cooperate. We test our setup during a pilot study with nineteen participants. A preliminary analysis indicates that participants prefer not to invest their money in the common pool, despite they perceive the robot as generous. By conducting this research, we seek to gain valuable insights into the role that robots can play in promoting trust and cohesion during human-robot interactions within group contexts. The results of this study may hold considerable potential for developing social robots capable of fostering trust and cooperation within mixed human-robot groups.