Preference-Based Long-Horizon Robotic Stacking with Multimodal Large Language Models

作者: Wanming Yu, Adrian Röfer, Abhinav Valada, Sethu Vijayakumar

分类: cs.RO

发布日期: 2025-09-29

💡 一句话要点

提出基于偏好的多模态大语言模型,用于长时程机器人堆叠任务

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态大语言模型 机器人堆叠 长时程规划 偏好学习 机器人操作

📋 核心要点

- 现有方法在长时程机器人操作任务中,尤其是在需要考虑物体物理属性的堆叠任务中,缺乏知识和有效性。

- 利用多模态LLM作为高层规划器,通过推理堆叠偏好来确定最佳堆叠顺序,无需显式指令即可同时考虑多个偏好。

- 通过定制数据集微调LLM,并在仿真和真实机器人实验中验证了其在长时程堆叠任务中的有效性和性能提升。

📝 摘要(中文)

本文提出了一种使用多模态大语言模型(LLM)作为高层规划器的方法,用于解决长时程机器人堆叠任务,特别是那些需要考虑物体物理属性的任务,例如堆叠内部藏有物体的容器。该方法利用LLM处理每个物体的多模态输入,并通过推理堆叠偏好来推断当前最佳堆叠顺序。为了使LLM能够同时推理多个偏好,本文构建了一个定制数据集,其中考虑了重量、稳定性、尺寸和占地面积等堆叠偏好,并对LLM进行微调。通过大规模仿真评估表明,与提示调整的预训练LLM相比,使用定制数据集微调的LLM在堆叠完成方面有所改进。此外,还在真实的人形机器人上展示了所提出的框架在长时程堆叠任务中的有效性。

🔬 方法详解

问题定义:论文旨在解决长时程机器人堆叠任务中,现有方法难以有效处理物体物理属性(如重量、稳定性)的问题。特别是在堆叠包含隐藏物体的容器时,需要推理物体的重量分布和稳定性,这对于传统的基于规则或优化的机器人规划方法来说是一个挑战。现有方法通常依赖于精确的物体模型和环境感知,难以泛化到复杂场景和未知物体。

核心思路:论文的核心思路是利用多模态大语言模型(LLM)的强大推理能力,将堆叠任务转化为一个基于偏好的决策问题。通过输入物体的多模态信息(例如图像、文本描述),LLM可以学习不同物体之间的堆叠偏好(例如重物在下、大物体在下),并根据这些偏好规划出最佳的堆叠顺序。这种方法的核心优势在于LLM能够从数据中学习复杂的物理关系,而无需显式地建模这些关系。

技术框架:整体框架包含以下几个主要模块:1) 多模态输入模块:负责收集每个物体的多模态信息,包括图像、文本描述等。2) LLM规划模块:将多模态输入传递给LLM,LLM根据学习到的堆叠偏好,输出最佳的堆叠顺序。3) 机器人执行模块:根据LLM的规划结果,控制机器人执行堆叠操作。论文重点关注LLM规划模块,并提出了定制数据集微调LLM的方法。

关键创新:论文的关键创新在于将多模态LLM应用于长时程机器人堆叠任务,并提出了定制数据集微调LLM的方法。与传统的基于规则或优化的方法相比,该方法能够更好地处理复杂场景和未知物体,并且能够同时考虑多个堆叠偏好。此外,通过定制数据集微调LLM,可以显著提高LLM在特定任务上的性能。

关键设计:论文的关键设计包括:1) 定制数据集:数据集包含了大量的堆叠示例,每个示例都包含了物体的多模态信息和对应的堆叠顺序。数据集的设计考虑了多种堆叠偏好,例如重量、稳定性、尺寸和占地面积。2) 微调策略:使用定制数据集对LLM进行微调,使其能够更好地理解堆叠偏好,并生成更合理的堆叠顺序。3) 提示工程:设计合适的提示语,引导LLM进行推理和规划。

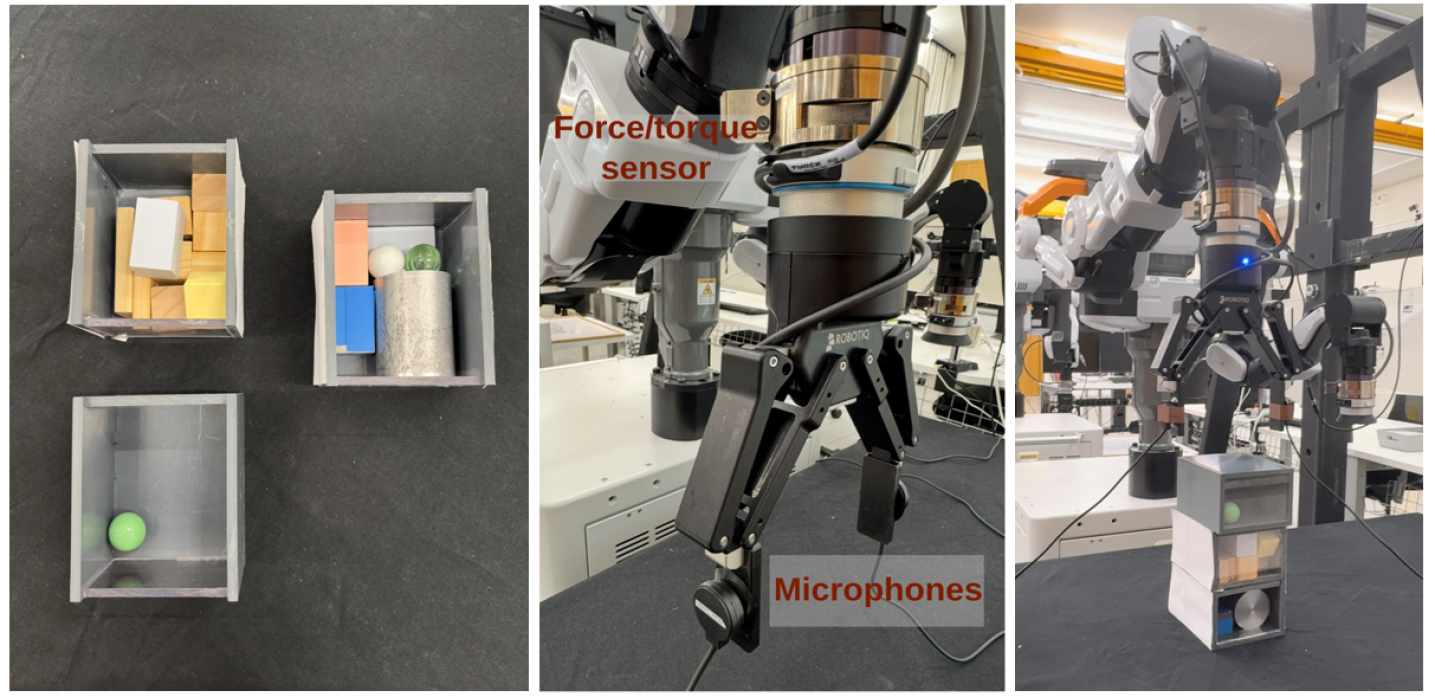

🖼️ 关键图片

📊 实验亮点

通过大规模仿真评估,使用定制数据集微调的LLM在堆叠完成方面优于提示调整的预训练LLM。此外,在真实的人形机器人上进行了实验,验证了该框架在长时程堆叠任务中的有效性。具体性能数据和提升幅度在论文中进行了详细描述。

🎯 应用场景

该研究成果可应用于自动化仓库、物流分拣、家庭服务机器人等领域。通过赋予机器人更强的推理和规划能力,可以实现更高效、更灵活的物体堆叠和整理,降低人工成本,提高工作效率。未来,该技术有望扩展到更复杂的机器人操作任务,例如装配、拆卸等。

📄 摘要(原文)

Pretrained large language models (LLMs) can work as high-level robotic planners by reasoning over abstract task descriptions and natural language instructions, etc. However, they have shown a lack of knowledge and effectiveness in planning long-horizon robotic manipulation tasks where the physical properties of the objects are essential. An example is the stacking of containers with hidden objects inside, which involves reasoning over hidden physics properties such as weight and stability. To this end, this paper proposes to use multimodal LLMs as high-level planners for such long-horizon robotic stacking tasks. The LLM takes multimodal inputs for each object to stack and infers the current best stacking sequence by reasoning over stacking preferences. Furthermore, in order to enable the LLM to reason over multiple preferences at the same time without giving explicit instructions, we propose to create a custom dataset considering stacking preferences including weight, stability, size, and footprint, to fine-tune the LLM. Compared to the pretrained LLM with prompt tuning, we demonstrate the improved stacking completion of the LLM fine-tuned with our custom dataset via large-scale simulation evaluation. Furthermore, we showcase the effectiveness of the proposed framework for the long-horizon stacking task on a real humanoid robot in an online manner.