Memory Transfer Planning: LLM-driven Context-Aware Code Adaptation for Robot Manipulation

作者: Tomoyuki Kagaya, Subramanian Lakshmi, Yuxuan Lou, Thong Jing Yuan, Jayashree Karlekar, Sugiri Pranata, Natsuki Murakami, Akira Kinose, Yang You

分类: cs.RO, cs.AI, cs.LG

发布日期: 2025-09-29

💡 一句话要点

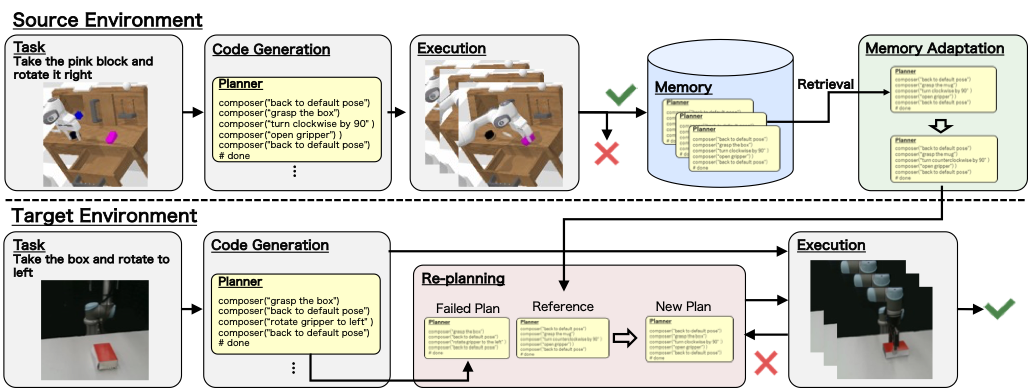

提出Memory Transfer Planning,利用LLM上下文学习实现机器人操作代码的跨环境迁移。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 机器人操作 大型语言模型 上下文学习 代码迁移 程序知识

📋 核心要点

- 现有机器人操作方法难以适应新环境,通常需要针对特定环境进行策略训练或依赖固定提示和单次代码生成,导致泛化能力受限。

- Memory Transfer Planning (MTP) 框架利用来自不同环境的成功控制代码作为上下文指导,通过检索和调整代码,提升LLM驱动规划的适应性。

- 在RLBench、CALVIN和真实机器人上的实验表明,MTP显著提高了成功率和适应性,并验证了模拟环境记忆库在真实机器人上的有效性。

📝 摘要(中文)

本文提出Memory Transfer Planning (MTP) 框架,旨在提升大型语言模型(LLM)在机器人操作任务中的环境适应性。MTP利用来自不同环境的成功控制代码作为程序知识,为LLM驱动的规划提供上下文指导。具体而言,MTP首先使用LLM生成初始计划和代码,然后从代码记忆库中检索相关的成功案例,最后将检索到的代码根据目标环境进行上下文调整,用于重新规划,无需更新模型参数。在RLBench、CALVIN和真实机器人上的评估表明,MTP在成功率和适应性方面均优于固定提示代码生成、朴素检索和无记忆重新规划。此外,在硬件实验中,利用在模拟环境中构建的记忆库也证明了有效性。MTP提供了一种实用的方法,利用程序知识来实现基于LLM的鲁棒规划,从而增强了对新环境的适应性,并弥合了模拟和真实世界部署之间的差距。

🔬 方法详解

问题定义:现有基于LLM的机器人操作方法在面对新环境时,泛化能力不足。许多方法依赖于环境特定的策略训练或固定的提示工程,无法有效利用已有的成功经验,需要大量的人工调整和重新训练。这限制了LLM在机器人操作中的实际应用。

核心思路:MTP的核心思想是将成功的控制代码视为程序知识,通过检索和迁移这些知识来指导LLM在新的环境中进行规划。通过构建一个代码记忆库,存储不同环境下的成功案例,并在新的任务中检索最相关的案例,然后对检索到的代码进行上下文调整,使其适应新的环境。这种方法避免了从头开始学习,提高了泛化能力和效率。

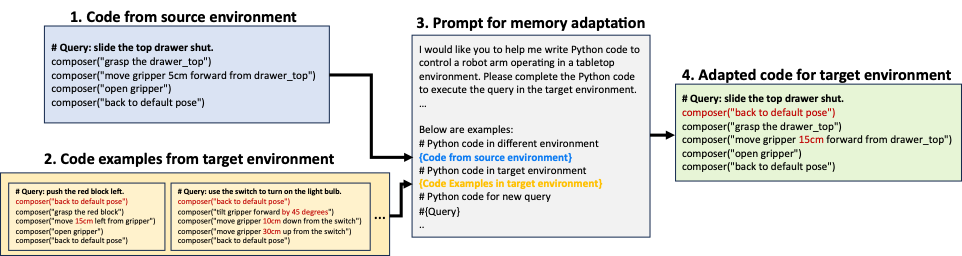

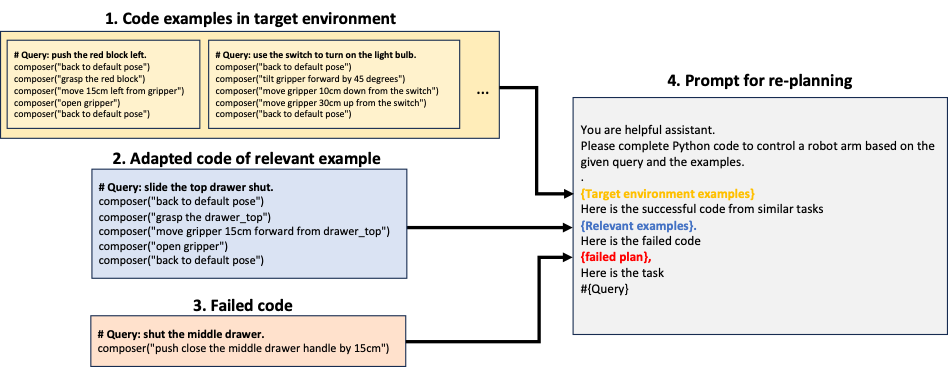

技术框架:MTP框架包含三个主要阶段:(1) 初始规划和代码生成:使用LLM根据任务描述生成初始的计划和控制代码。(2) 代码检索:从代码记忆库中检索与当前任务最相关的成功案例。检索过程可能涉及语义相似度匹配或基于环境特征的匹配。(3) 上下文代码调整和重新规划:将检索到的代码根据目标环境进行上下文调整,例如修改变量名、调整参数等,然后利用调整后的代码重新规划,生成最终的控制代码。

关键创新:MTP的关键创新在于利用代码记忆库和上下文调整机制,实现了程序知识的迁移。与传统的固定提示或从头开始学习的方法不同,MTP能够有效地利用已有的成功经验,提高LLM在新的环境中的适应性。此外,MTP无需更新模型参数,降低了计算成本和部署难度。

关键设计:代码记忆库的设计是关键。需要考虑如何存储和索引代码,以及如何定义代码之间的相似度。上下文调整机制也需要仔细设计,以确保调整后的代码能够正确地适应新的环境。具体的实现细节可能包括使用向量数据库存储代码,使用余弦相似度进行检索,以及使用LLM进行代码的上下文调整。

🖼️ 关键图片

📊 实验亮点

MTP在RLBench、CALVIN和真实机器人上的实验结果表明,其性能优于固定提示代码生成、朴素检索和无记忆重新规划。例如,在真实机器人实验中,MTP利用在模拟环境中构建的记忆库,成功率得到了显著提升。这些结果验证了MTP的有效性和实用性。

🎯 应用场景

MTP具有广泛的应用前景,可用于各种机器人操作任务,例如工业自动化、家庭服务机器人、医疗机器人等。通过利用已有的成功经验,MTP可以显著降低机器人部署的成本和难度,提高机器人的智能化水平。此外,MTP还可以促进机器人之间的知识共享和协作,加速机器人技术的发展。

📄 摘要(原文)

Large language models (LLMs) are increasingly explored in robot manipulation, but many existing methods struggle to adapt to new environments. Many systems require either environment-specific policy training or depend on fixed prompts and single-shot code generation, leading to limited transferability and manual re-tuning. We introduce Memory Transfer Planning (MTP), a framework that leverages successful control-code examples from different environments as procedural knowledge, using them as in-context guidance for LLM-driven planning. Specifically, MTP (i) generates an initial plan and code using LLMs, (ii) retrieves relevant successful examples from a code memory, and (iii) contextually adapts the retrieved code to the target setting for re-planning without updating model parameters. We evaluate MTP on RLBench, CALVIN, and a physical robot, demonstrating effectiveness beyond simulation. Across these settings, MTP consistently improved success rate and adaptability compared with fixed-prompt code generation, naive retrieval, and memory-free re-planning. Furthermore, in hardware experiments, leveraging a memory constructed in simulation proved effective. MTP provides a practical approach that exploits procedural knowledge to realize robust LLM-based planning across diverse robotic manipulation scenarios, enhancing adaptability to novel environments and bridging simulation and real-world deployment.