KiVi: Kinesthetic-Visuospatial Integration for Dynamic and Safe Egocentric Legged Locomotion

作者: Peizhuo Li, Hongyi Li, Yuxuan Ma, Linnan Chang, Xinrong Yang, Ruiqi Yu, Yifeng Zhang, Yuhong Cao, Qiuguo Zhu, Guillaume Sartoretti

分类: cs.RO

发布日期: 2025-09-28 (更新: 2025-10-06)

💡 一句话要点

KiVi:用于动态安全足式机器人自中心运动的动觉-视觉空间融合框架

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱六:视频提取与匹配 (Video Extraction)

关键词: 足式机器人 运动控制 视觉导航 本体感受 多模态融合 注意力机制 地形适应

📋 核心要点

- 现有基于视觉的足式机器人运动方法易受视觉信息干扰,导致运动不稳定,难以适应复杂环境。

- KiVi框架将本体感受和视觉信息分离,利用本体感受作为稳定骨干,选择性地融合视觉信息以增强地形感知和避障能力。

- 实验表明,KiVi使四足机器人能够在各种地形中稳定运动,并对训练中未见过的视觉噪声和遮挡具有鲁棒性。

📝 摘要(中文)

基于视觉的运动在使足式机器人感知和适应复杂环境方面显示出巨大的潜力。然而,视觉信息本质上是脆弱的,容易受到遮挡、反射和光照变化的影响,这些因素通常会导致运动不稳定。受动物感觉运动整合的启发,我们提出了KiVi,一个动觉-视觉空间融合框架,其中动觉编码了身体运动的本体感受,而视觉空间推理则捕捉了周围地形的视觉感知。具体来说,KiVi分离了这些路径,利用本体感受作为稳定的骨干,同时选择性地结合视觉以实现地形感知和避障。这种模态平衡但又具有整合性的设计,结合记忆增强的注意力机制,使机器人能够稳健地解释视觉线索,同时通过本体感受保持后备稳定性。大量的实验表明,我们的方法使四足机器人能够稳定地穿越各种地形,并在非结构化的户外环境中可靠地运行,对训练期间未见过的超出分布(OOD)的视觉噪声和遮挡保持鲁棒性,从而突出了其有效性和对现实世界足式运动的适用性。

🔬 方法详解

问题定义:论文旨在解决足式机器人在复杂和动态环境中,仅依赖视觉信息进行运动时,由于视觉信息的脆弱性(如遮挡、光照变化等)导致的运动不稳定问题。现有方法通常过度依赖视觉信息,缺乏对本体感受的有效利用,导致在视觉信息质量下降时,机器人容易失去平衡或无法有效导航。

核心思路:KiVi的核心思路是模仿动物的感觉运动整合机制,将本体感受(动觉)和视觉信息进行分离处理,并进行选择性融合。本体感受作为运动控制的稳定骨干,提供基础的平衡和运动能力;视觉信息则用于增强环境感知,实现地形适应和避障。通过这种方式,即使视觉信息受到干扰,机器人也能依靠本体感受维持基本的运动能力。

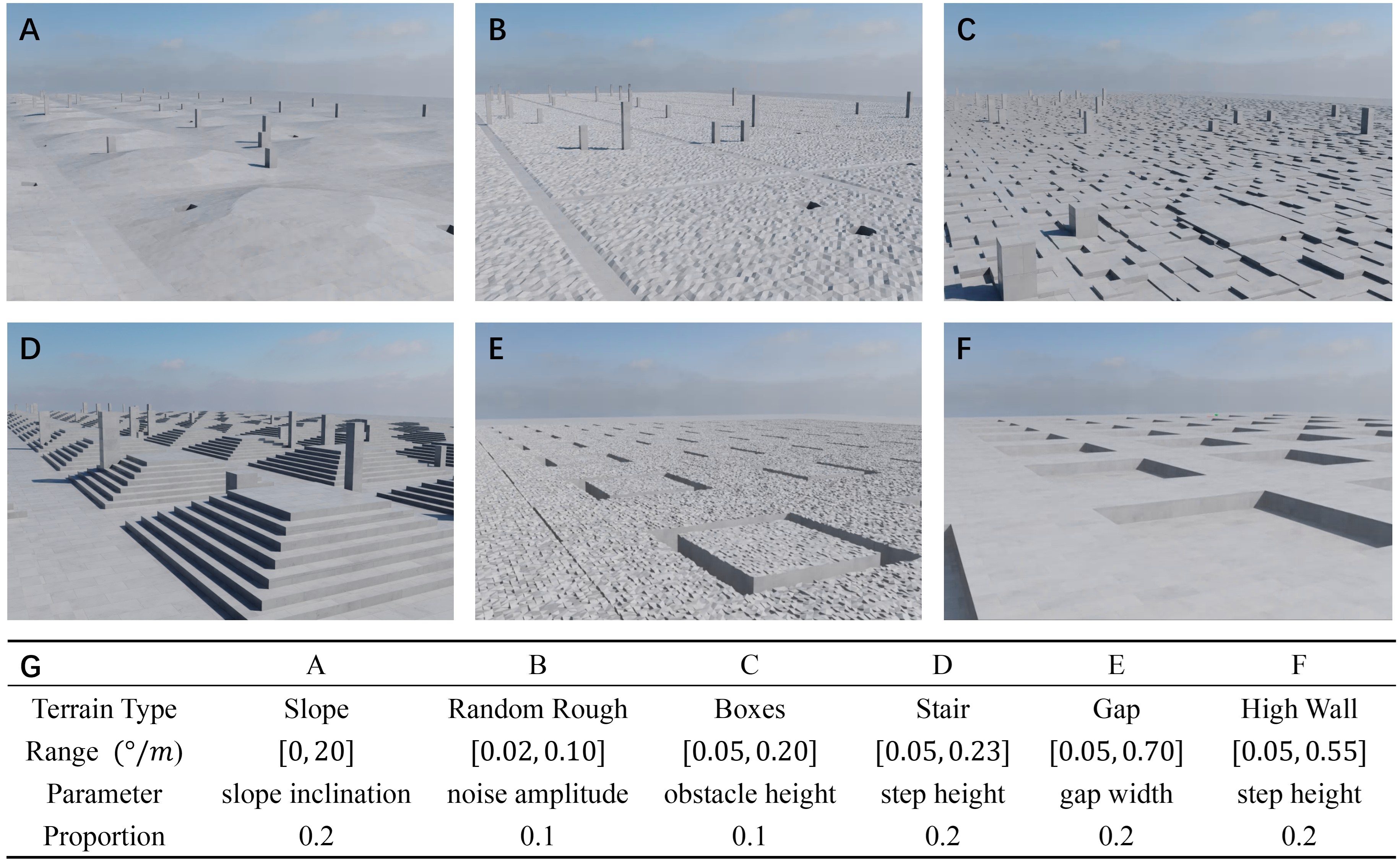

技术框架:KiVi框架包含两个主要分支:动觉分支和视觉空间分支。动觉分支主要处理来自机器人本体的传感器数据(如关节角度、角速度等),提供运动控制的基础。视觉空间分支则处理来自视觉传感器的图像数据,提取地形信息和障碍物信息。这两个分支的信息通过一个记忆增强的注意力机制进行融合,从而实现对视觉信息的选择性利用。整体流程是:本体感受数据驱动基础运动控制,视觉信息辅助进行地形适应和避障,并通过注意力机制动态调整视觉信息的权重。

关键创新:KiVi的关键创新在于其模态平衡和选择性融合的设计。与以往过度依赖视觉信息的方法不同,KiVi强调本体感受的重要性,并将其作为运动控制的稳定骨干。同时,通过记忆增强的注意力机制,KiVi能够根据环境的复杂程度和视觉信息的质量,动态调整视觉信息的权重,从而实现对视觉信息的选择性利用。这种设计使得机器人在视觉信息质量下降时,仍能保持稳定的运动能力。

关键设计:KiVi框架中,记忆增强的注意力机制是关键设计之一。该机制利用一个外部记忆模块来存储历史视觉信息,并利用注意力机制来选择性地提取记忆模块中的相关信息。损失函数的设计也至关重要,需要平衡本体感受和视觉信息之间的权重,并鼓励注意力机制学习到有效的视觉信息选择策略。具体的网络结构和参数设置需要在实际应用中进行调整和优化。

🖼️ 关键图片

📊 实验亮点

实验结果表明,KiVi框架在各种地形中均表现出良好的运动性能,并且对训练中未见过的视觉噪声和遮挡具有很强的鲁棒性。相比于其他基于视觉的运动控制方法,KiVi在视觉信息质量下降的情况下,能够更好地保持运动的稳定性和可靠性。具体的性能数据和对比基线在论文中有详细的展示。

🎯 应用场景

KiVi框架可应用于各种足式机器人,使其能够在复杂地形、恶劣天气或光照条件不佳的环境中稳定可靠地运动。例如,可用于搜救机器人、巡检机器人、农业机器人等,提高其在实际应用中的适应性和鲁棒性。该研究对提升足式机器人的自主导航能力具有重要意义。

📄 摘要(原文)

Vision-based locomotion has shown great promise in enabling legged robots to perceive and adapt to complex environments. However, visual information is inherently fragile, being vulnerable to occlusions, reflections, and lighting changes, which often cause instability in locomotion. Inspired by animal sensorimotor integration, we propose KiVi, a Kinesthetic-Visuospatial integration framework, where kinesthetics encodes proprioceptive sensing of body motion and visuospatial reasoning captures visual perception of surrounding terrain. Specifically, KiVi separates these pathways, leveraging proprioception as a stable backbone while selectively incorporating vision for terrain awareness and obstacle avoidance. This modality-balanced, yet integrative design, combined with memory-enhanced attention, allows the robot to robustly interpret visual cues while maintaining fallback stability through proprioception. Extensive experiments show that our method enables quadruped robots to stably traverse diverse terrains and operate reliably in unstructured outdoor environments, remaining robust to out-of-distribution (OOD) visual noise and occlusion unseen during training, thereby highlighting its effectiveness and applicability to real-world legged locomotion.