Zero-shot Whole-Body Manipulation with a Large-Scale Soft Robotic Torso via Guided Reinforcement Learning

作者: Curtis C. Johnson, Carlo Alessi, Egidio Falotico, Marc D. Killpack

分类: cs.RO

发布日期: 2025-09-28

备注: Submitted to IEEE Transactions on Robotics for review

💡 一句话要点

基于引导强化学习的大型软体机器人零样本全身操作

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 软体机器人 全身操作 强化学习 零样本迁移 运动原语 MuJoCo仿真 sim-to-real

📋 核心要点

- 软体机器人在全身操作中具有优势,但其不确定性给仿真和控制带来挑战。

- 提出一种基于引导强化学习的策略,利用运动原语提升学习效率和稳定性。

- 实验证明,该方法实现了零样本迁移,并在真实机器人上取得了88%的成功率。

📝 摘要(中文)

全身操作是一种强大的但未被充分探索的方法,它使机器人能够使用超出末端执行器的更多部分与大型、重型或笨拙的物体进行交互。软体机器人具有固有的被动柔顺性,特别适合这种富含接触的操作任务,但其运动学和动力学的不确定性给仿真和控制带来了重大挑战。本文利用可在 MuJoCo 中以单线程高达 350 倍实时速度运行的仿真来解决这一挑战,并详细分析了这种仿真的速度和精度之间的关键权衡。我们使用该框架成功地实现了学习到的全身操作策略的零样本 sim-to-real 迁移,在 Baloo 硬件平台上实现了 88% 的成功率。我们表明,用简单的运动原语引导强化学习对于这种成功至关重要,而标准的奖励塑造方法难以产生稳定且成功的全身操作策略。此外,我们的分析表明,学习到的策略不仅仅是模仿运动原语,它还表现出有益的反应行为,例如重新抓取和扰动恢复。我们将这种学习到的策略与开环基线进行分析和对比,表明该策略还可以在扰动下表现出激进的过度校正。据我们所知,这是首次在大型平台(10 公斤有效载荷)上使用两个连续软臂进行强力的六自由度全身操作,并实现零样本策略迁移。

🔬 方法详解

问题定义:论文旨在解决软体机器人在全身操作任务中,由于其复杂的运动学和动力学特性,难以进行有效控制的问题。现有方法通常依赖于复杂的模型或大量的数据,难以实现零样本的sim-to-real迁移,并且在面对扰动时鲁棒性较差。

核心思路:论文的核心思路是利用运动原语引导强化学习,从而加速策略学习过程并提高策略的稳定性。通过引入一个简单的运动原语作为先验知识,可以有效地约束策略的搜索空间,避免陷入局部最优解。同时,强化学习能够学习到运动原语无法覆盖的反应行为,例如重新抓取和扰动恢复。

技术框架:整体框架包括一个高效率的MuJoCo仿真环境,一个基于运动原语的引导策略,以及一个强化学习算法。首先,在仿真环境中训练强化学习策略,该策略以运动原语作为初始动作。然后,将训练好的策略直接迁移到真实机器人上进行测试,无需任何额外的微调。

关键创新:最重要的技术创新点在于将运动原语与强化学习相结合,实现了一种高效且鲁棒的全身操作策略。与传统的奖励塑造方法相比,运动原语能够提供更强的引导信号,从而加速策略学习并提高策略的稳定性。此外,该方法实现了零样本的sim-to-real迁移,避免了在真实环境中进行大量数据采集和训练的需要。

关键设计:论文中使用了PPO(Proximal Policy Optimization)算法进行强化学习。运动原语的选择需要根据具体的任务进行设计,例如,对于抓取任务,可以使用一个简单的直线运动作为运动原语。奖励函数的设计需要综合考虑任务目标和策略的稳定性,例如,可以使用一个奖励项来鼓励机器人接近目标物体,同时使用一个惩罚项来避免机器人发生碰撞。

🖼️ 关键图片

📊 实验亮点

该研究成功地在 Baloo 硬件平台上实现了零样本 sim-to-real 迁移,并在全身操作任务中取得了 88% 的成功率。与传统的奖励塑造方法相比,该方法能够更有效地学习到稳定且成功的策略。此外,实验结果表明,学习到的策略不仅能够模仿运动原语,还能够表现出有益的反应行为,例如重新抓取和扰动恢复。该研究是首次在大型平台(10 公斤有效载荷)上使用两个连续软臂进行强力的六自由度全身操作,并实现零样本策略迁移。

🎯 应用场景

该研究成果可应用于各种需要全身操作的场景,例如:在复杂环境中搬运重物、在狭小空间内进行操作、以及与人类进行协作等。该方法能够提高机器人的操作效率和鲁棒性,降低开发成本,并为软体机器人在实际应用中的推广奠定基础。未来,该技术有望在物流、医疗、救援等领域发挥重要作用。

📄 摘要(原文)

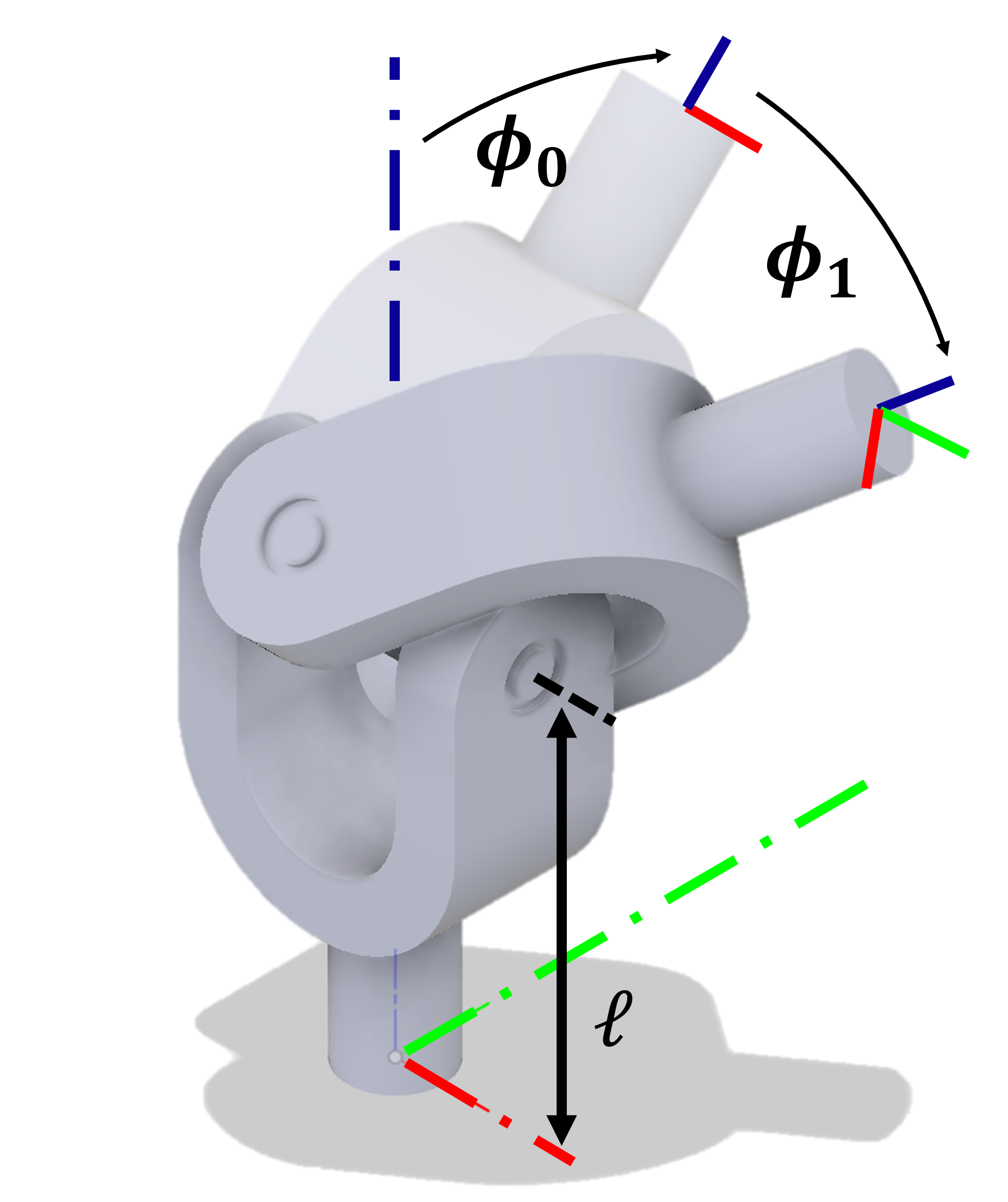

Whole-body manipulation is a powerful yet underexplored approach that enables robots to interact with large, heavy, or awkward objects using more than just their end-effectors. Soft robots, with their inherent passive compliance, are particularly well-suited for such contact-rich manipulation tasks, but their uncertainties in kinematics and dynamics pose significant challenges for simulation and control. In this work, we address this challenge with a simulation that can run up to 350x real time on a single thread in MuJoCo and provide a detailed analysis of the critical tradeoffs between speed and accuracy for this simulation. Using this framework, we demonstrate a successful zero-shot sim-to-real transfer of a learned whole-body manipulation policy, achieving an 88% success rate on the Baloo hardware platform. We show that guiding RL with a simple motion primitive is critical to this success where standard reward shaping methods struggled to produce a stable and successful policy for whole-body manipulation. Furthermore, our analysis reveals that the learned policy does not simply mimic the motion primitive. It exhibits beneficial reactive behavior, such as re-grasping and perturbation recovery. We analyze and contrast this learned policy against an open-loop baseline to show that the policy can also exhibit aggressive over-corrections under perturbation. To our knowledge, this is the first demonstration of forceful, six-DoF whole-body manipulation using two continuum soft arms on a large-scale platform (10 kg payloads), with zero-shot policy transfer.