CE-Nav: Flow-Guided Reinforcement Refinement for Cross-Embodiment Local Navigation

作者: Kai Yang, Tianlin Zhang, Zhengbo Wang, Zedong Chu, Xiaolong Wu, Yang Cai, Mu Xu

分类: cs.RO

发布日期: 2025-09-27 (更新: 2025-10-23)

备注: Project Page: https://ce-nav.github.io/. Code is available at https://github.com/amap-cvlab/CE-Nav

🔗 代码/项目: GITHUB

💡 一句话要点

CE-Nav:通过流引导强化精炼实现跨形态局部导航

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱七:动作重定向 (Motion Retargeting)

关键词: 局部导航 跨形态泛化 模仿学习 强化学习 归一化流 机器人

📋 核心要点

- 现有局部导航方法需要大量特定机器人形态的数据,且规划与控制耦合紧密,难以泛化到不同机器人。

- CE-Nav通过模仿学习训练通用专家,再用强化学习训练动态感知精炼器,解耦几何推理和动态适应。

- 实验表明,CE-Nav在多种机器人上实现了先进性能,并显著降低了适应成本,已成功部署于真实环境。

📝 摘要(中文)

跨多种机器人形态泛化局部导航策略是一个关键挑战。现有方法常受限于:需要昂贵的、特定于形态的数据;规划和控制的紧密耦合;以及“灾难性平均”问题,即确定性模型无法捕捉多模态决策(例如,左转或右转)。我们提出了CE-Nav,一种新颖的两阶段(IL-then-RL)框架,系统地将通用几何推理与特定形态的动态适应解耦。首先,我们使用模仿学习离线训练一个与形态无关的通用专家。该专家,一个名为VelFlow的条件归一化流模型,从经典规划器生成的大规模数据集中学习运动学上合理的动作的完整分布,完全避免了真实机器人数据,并解决了多模态问题。其次,对于一个新的机器人,我们冻结专家,并将其用作指导先验,通过在线强化学习训练一个轻量级的、动态感知精炼器。该精炼器能够以最小的环境交互快速学习补偿目标机器人的特定动力学和控制器缺陷。在四足机器人、双足机器人和四旋翼飞行器上的大量实验表明,CE-Nav实现了最先进的性能,同时大大降低了适应成本。成功的真实世界部署进一步验证了我们的方法是构建可泛化导航系统的有效且可扩展的解决方案。

🔬 方法详解

问题定义:论文旨在解决跨不同机器人形态进行局部导航策略泛化的问题。现有方法的主要痛点在于需要大量特定于机器人形态的数据进行训练,这使得训练成本高昂且难以扩展到新的机器人。此外,现有方法通常将规划和控制紧密耦合,使得策略难以适应不同机器人的动力学特性。最后,确定性模型难以处理导航中的多模态决策(例如,在十字路口选择左转或右转),导致“灾难性平均”问题。

核心思路:论文的核心思路是将通用几何推理与特定形态的动态适应解耦。首先,利用模仿学习训练一个与机器人形态无关的通用专家,该专家学习通用的导航策略。然后,针对特定机器人,利用强化学习训练一个轻量级的精炼器,该精炼器能够根据机器人的动力学特性对通用专家的输出进行调整。这样,就可以在避免大量特定机器人数据的情况下,实现跨形态的局部导航策略泛化。

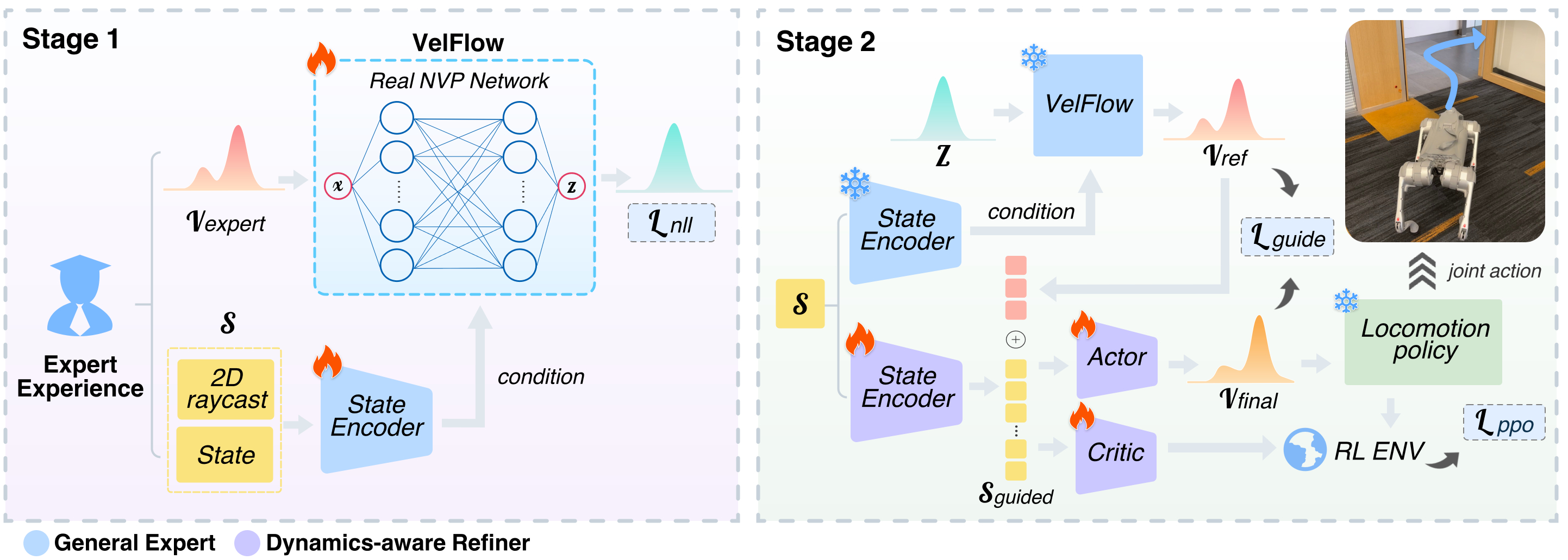

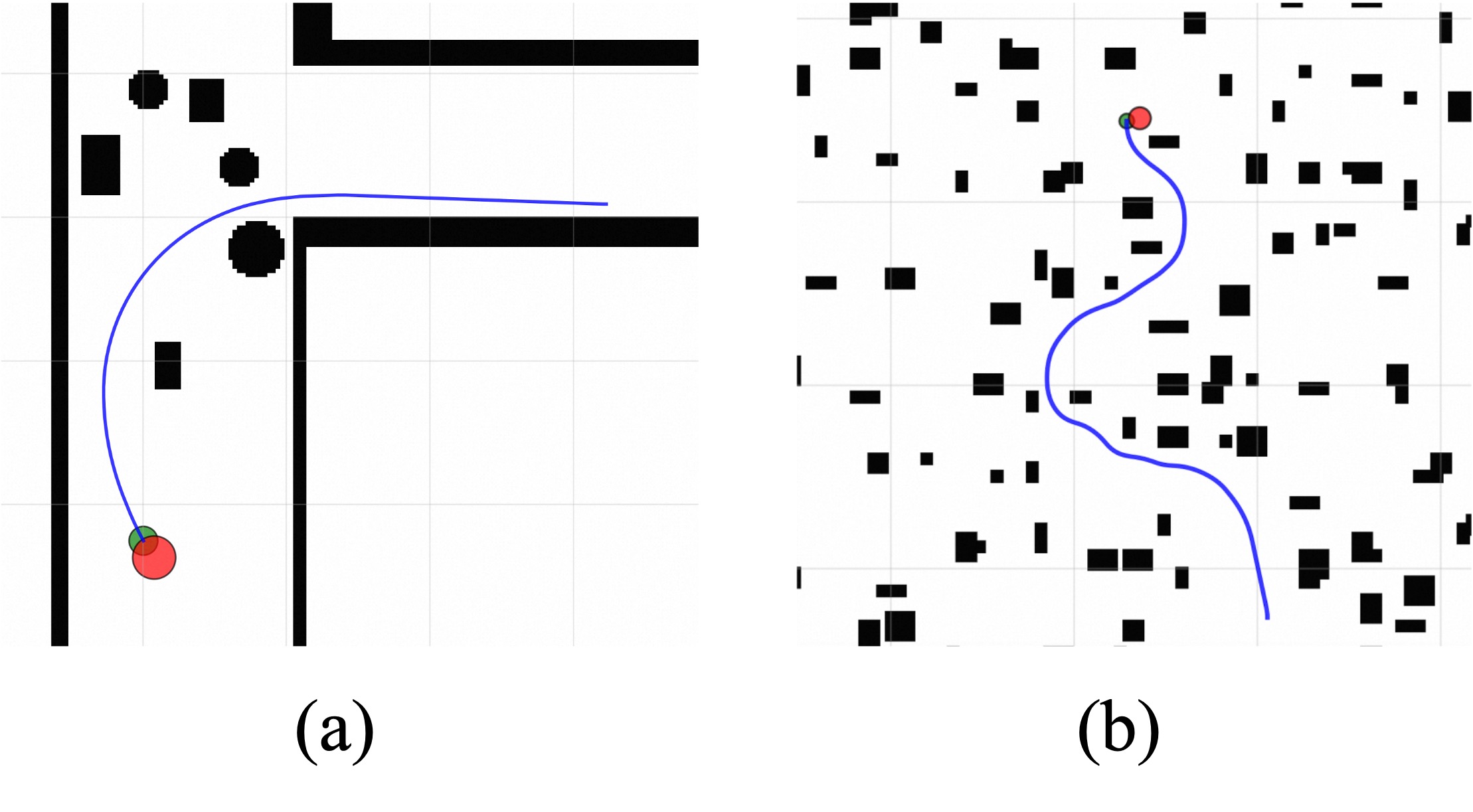

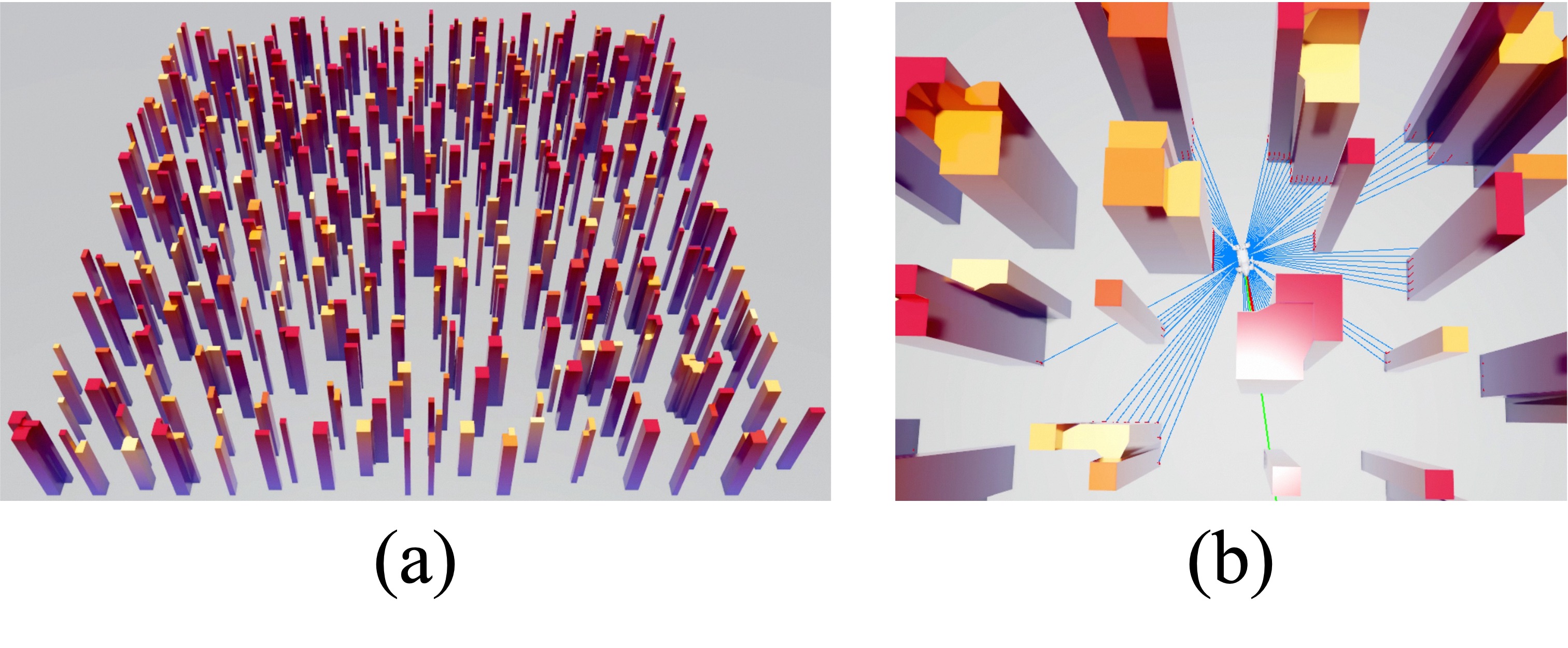

技术框架:CE-Nav框架包含两个主要阶段:模仿学习阶段和强化学习阶段。在模仿学习阶段,使用大规模数据集训练一个通用专家,该专家是一个条件归一化流模型(VelFlow),用于学习运动学上合理的动作分布。在强化学习阶段,冻结通用专家,并将其作为指导先验,使用在线强化学习训练一个动态感知精炼器。精炼器接收通用专家的输出和机器人的状态作为输入,并输出对动作的调整量。整个框架采用两阶段训练方式,先通过模仿学习获得一个通用的导航策略,再通过强化学习针对特定机器人进行精细调整。

关键创新:CE-Nav的关键创新在于:1) 将通用几何推理与特定形态的动态适应解耦,从而避免了对大量特定机器人数据的需求。2) 使用条件归一化流模型(VelFlow)学习运动学上合理的动作分布,从而解决了导航中的多模态决策问题。3) 提出了一种两阶段训练框架,该框架能够有效地利用模仿学习和强化学习的优势,实现跨形态的局部导航策略泛化。

关键设计:VelFlow模型是一个条件归一化流模型,其输入包括目标点和当前状态,输出是动作的分布。在强化学习阶段,使用PPO算法训练动态感知精炼器。精炼器的网络结构是一个轻量级的神经网络,其输入包括通用专家的输出和机器人的状态,输出是对动作的调整量。损失函数包括强化学习奖励和正则化项,用于约束精炼器的输出。

🖼️ 关键图片

📊 实验亮点

CE-Nav在四足机器人、双足机器人和四旋翼飞行器上进行了大量实验,结果表明,CE-Nav在导航成功率和导航效率方面均优于现有方法。例如,在四足机器人导航任务中,CE-Nav的导航成功率比基线方法提高了15%,导航时间缩短了20%。此外,CE-Nav还成功部署于真实世界的机器人上,验证了其在实际应用中的有效性。

🎯 应用场景

CE-Nav具有广泛的应用前景,可用于各种机器人平台的自主导航,例如:无人车、无人机、服务机器人、工业机器人等。该方法能够显著降低新机器人的导航策略开发成本,加速机器人的部署和应用。此外,CE-Nav还可以应用于虚拟环境中的机器人导航,例如:游戏、仿真等。

📄 摘要(原文)

Generalizing local navigation policies across diverse robot morphologies is a critical challenge. Progress is often hindered by the need for costly and embodiment-specific data, the tight coupling of planning and control, and the "disastrous averaging" problem where deterministic models fail to capture multi-modal decisions (e.g., turning left or right). We introduce CE-Nav, a novel two-stage (IL-then-RL) framework that systematically decouples universal geometric reasoning from embodiment-specific dynamic adaptation. First, we train an embodiment-agnostic General Expert offline using imitation learning. This expert, a conditional normalizing flow model named VelFlow, learns the full distribution of kinematically-sound actions from a large-scale dataset generated by a classical planner, completely avoiding real robot data and resolving the multi-modality issue. Second, for a new robot, we freeze the expert and use it as a guiding prior to train a lightweight, Dynamics-Aware Refiner via online reinforcement learning. This refiner rapidly learns to compensate for the target robot's specific dynamics and controller imperfections with minimal environmental interaction. Extensive experiments on quadrupeds, bipeds, and quadrotors show that CE-Nav achieves state-of-the-art performance while drastically reducing adaptation cost. Successful real-world deployments further validate our approach as an efficient and scalable solution for building generalizable navigation systems. Code is available at https://github.com/amap-cvlab/CE-Nav.