ARMimic: Learning Robotic Manipulation from Passive Human Demonstrations in Augmented Reality

作者: Rohan Walia, Yusheng Wang, Ralf Römer, Masahiro Nishio, Angela P. Schoellig, Jun Ota

分类: cs.RO

发布日期: 2025-09-26

💡 一句话要点

ARMimic:利用增强现实中被动的人类演示学习机器人操作

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱六:视频提取与匹配 (Video Extraction)

关键词: 机器人操作 模仿学习 增强现实 人机交互 技能学习

📋 核心要点

- 现有机器人技能学习方法,如动觉示教和遥操作,存在硬件依赖性强、操作繁琐等问题,限制了其在实际场景中的应用。

- ARMimic利用消费级XR头显和摄像头,结合手部跟踪、AR机器人叠加和深度感知,实现了轻量级的机器人操作演示数据采集。

- 实验结果表明,ARMimic在演示时间和任务成功率上均优于传统遥操作方法和现有基线,验证了其在机器人学习中的有效性。

📝 摘要(中文)

模仿学习是机器人技能获取的强大范例,但传统的演示方法(如动觉示教和遥操作)繁琐、硬件依赖性强且会中断工作流程。最近,使用扩展现实(XR)头显进行被动观察在以自我为中心的演示收集方面显示出希望,但当前的方法需要额外的硬件、复杂的校准或受限的记录条件,从而限制了可扩展性和可用性。我们提出了ARMimic,这是一个新颖的框架,它通过轻量级且硬件最小的设置,仅使用消费级XR头显和固定的工作场所摄像头,实现可扩展的、无需机器人的数据收集。ARMimic集成了以自我为中心的手部跟踪、增强现实(AR)机器人叠加和实时深度感知,以确保具有碰撞意识的、运动学上可行的演示。统一的模仿学习管道是我们方法的核心,将人类和虚拟机器人轨迹视为可互换的,从而使策略能够推广到不同的形态和环境。我们在两项操作任务(包括具有挑战性的长时程碗堆叠)上验证了ARMimic。在我们的实验中,与遥操作相比,ARMimic将演示时间减少了50%,并且比在遥操作数据上训练的最新基线ACT提高了11%的任务成功率。我们的结果表明,ARMimic能够实现安全、无缝和野外数据收集,为在各种现实环境中进行可扩展的机器人学习提供了巨大的潜力。

🔬 方法详解

问题定义:现有机器人模仿学习方法,如动觉示教和遥操作,需要特定的硬件设备,操作复杂,且容易中断正常的工作流程。这些方法难以扩展到大规模、真实世界的机器人学习场景,限制了机器人技能获取的效率和适用性。

核心思路:ARMimic的核心思想是利用增强现实(AR)技术,让人类在虚拟环境中演示机器人操作,并将人类的动作轨迹和虚拟机器人的轨迹视为等价的,从而实现机器人技能的学习。这种方法无需真实的机器人参与数据采集,降低了硬件成本和操作难度,提高了数据采集的效率和安全性。

技术框架:ARMimic的整体框架包括以下几个主要模块:1) 使用消费级XR头显进行以自我为中心的手部跟踪;2) 在AR环境中叠加虚拟机器人模型,允许用户在虚拟环境中进行操作演示;3) 使用摄像头进行实时深度感知,以确保演示过程中的碰撞避免和运动学可行性;4) 统一的模仿学习管道,将人类和虚拟机器人的轨迹作为输入,训练机器人控制策略。

关键创新:ARMimic的关键创新在于其轻量级的、基于AR的机器人操作演示数据采集方法。与传统的需要特定硬件或复杂校准的方法不同,ARMimic仅使用消费级XR头显和摄像头,即可实现安全、高效的数据采集。此外,ARMimic将人类和虚拟机器人的轨迹视为等价的,使得训练得到的策略能够泛化到不同的机器人形态和环境。

关键设计:ARMimic的关键设计包括:1) 使用深度相机进行环境感知,确保虚拟机器人在AR环境中的运动学可行性;2) 设计损失函数,鼓励学习到的策略能够模仿人类的动作轨迹,并避免碰撞;3) 使用统一的模仿学习管道,处理来自人类和虚拟机器人的数据,提高策略的泛化能力。具体的网络结构和参数设置未在摘要中详细说明,属于未知信息。

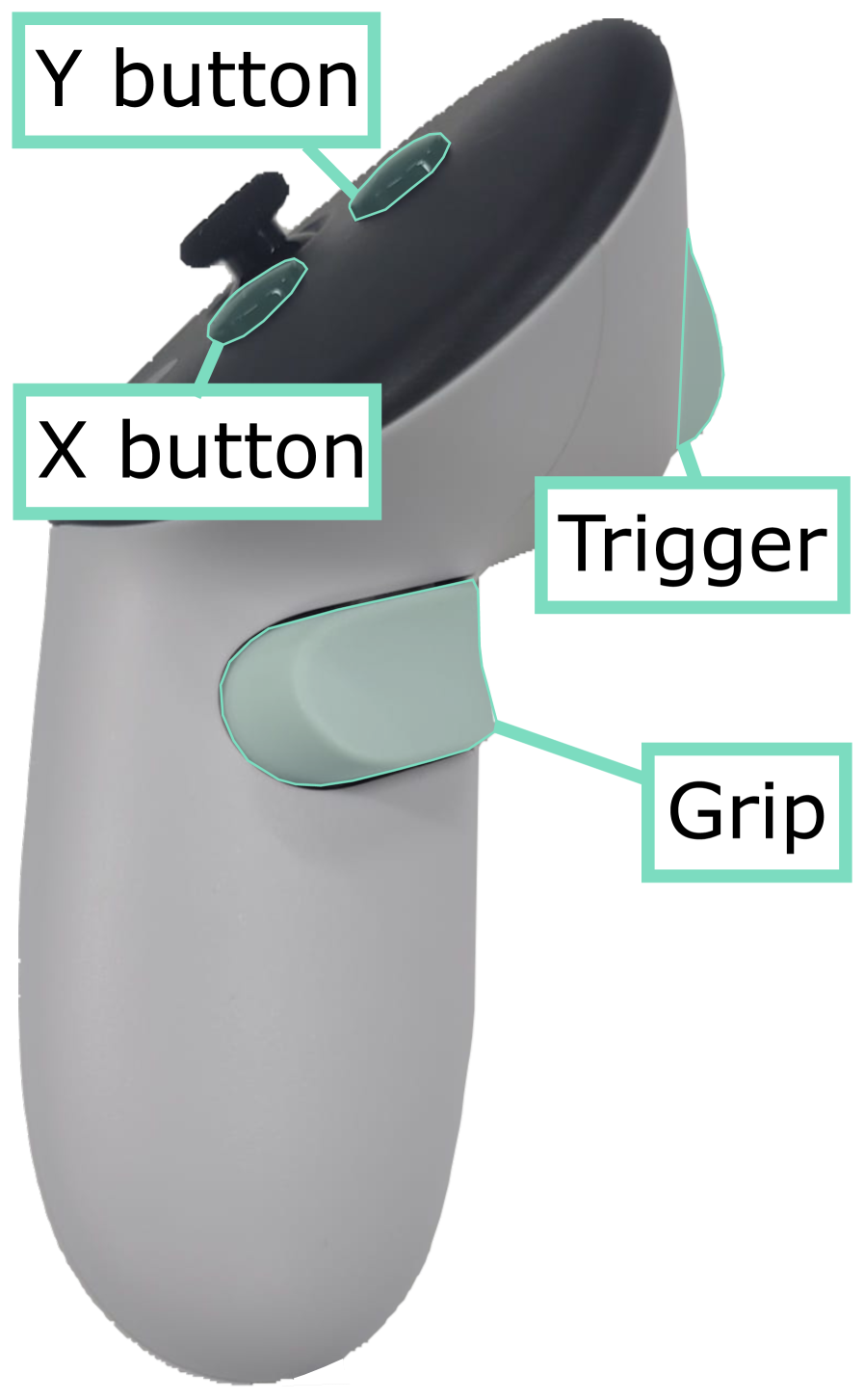

🖼️ 关键图片

📊 实验亮点

ARMimic在两项操作任务上进行了验证,包括具有挑战性的长时程碗堆叠。实验结果表明,与遥操作相比,ARMimic将演示时间减少了50%,并且比在遥操作数据上训练的最新基线ACT提高了11%的任务成功率。这些结果表明,ARMimic能够显著提高机器人技能学习的效率和性能。

🎯 应用场景

ARMimic具有广泛的应用前景,可用于工业机器人、服务机器人等领域的技能学习。该方法可以降低机器人技能学习的成本和难度,提高机器人适应新任务和环境的能力。未来,ARMimic有望应用于远程操作、人机协作等场景,实现更智能、更灵活的机器人应用。

📄 摘要(原文)

Imitation learning is a powerful paradigm for robot skill acquisition, yet conventional demonstration methods--such as kinesthetic teaching and teleoperation--are cumbersome, hardware-heavy, and disruptive to workflows. Recently, passive observation using extended reality (XR) headsets has shown promise for egocentric demonstration collection, yet current approaches require additional hardware, complex calibration, or constrained recording conditions that limit scalability and usability. We present ARMimic, a novel framework that overcomes these limitations with a lightweight and hardware-minimal setup for scalable, robot-free data collection using only a consumer XR headset and a stationary workplace camera. ARMimic integrates egocentric hand tracking, augmented reality (AR) robot overlays, and real-time depth sensing to ensure collision-aware, kinematically feasible demonstrations. A unified imitation learning pipeline is at the core of our method, treating both human and virtual robot trajectories as interchangeable, which enables policies that generalize across different embodiments and environments. We validate ARMimic on two manipulation tasks, including challenging long-horizon bowl stacking. In our experiments, ARMimic reduces demonstration time by 50% compared to teleoperation and improves task success by 11% over ACT, a state-of-the-art baseline trained on teleoperated data. Our results demonstrate that ARMimic enables safe, seamless, and in-the-wild data collection, offering great potential for scalable robot learning in diverse real-world settings.