Pixel Motion Diffusion is What We Need for Robot Control

作者: E-Ro Nguyen, Yichi Zhang, Kanchana Ranasinghe, Xiang Li, Michael S. Ryoo

分类: cs.RO, cs.CV

发布日期: 2025-09-26

备注: 16 pages, 7 figures

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

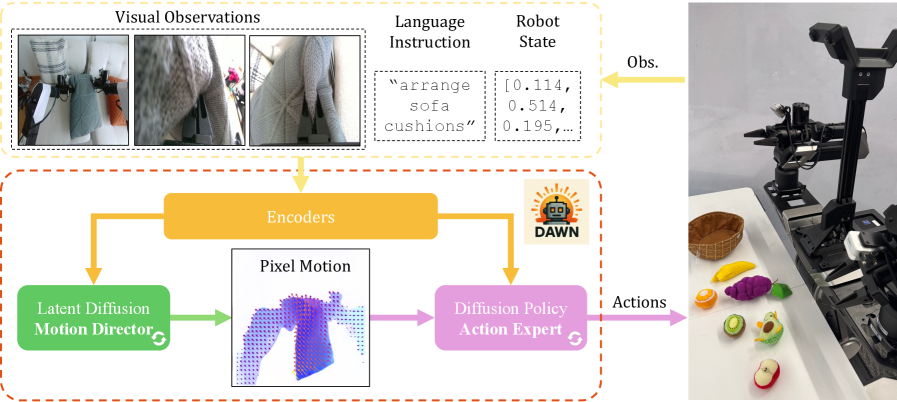

DAWN:基于像素运动扩散的机器人控制统一框架,实现语言条件下的机器人操作。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱四:生成式动作 (Generative Motion) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 机器人控制 扩散模型 语言条件控制 像素运动 端到端学习

📋 核心要点

- 现有机器人控制方法难以有效桥接高层意图和底层动作,DAWN框架旨在解决这一问题。

- DAWN利用扩散模型对高层和底层控制器进行建模,实现端到端训练,并引入可解释的中间运动抽象。

- DAWN在CALVIN和MetaWorld基准测试中表现出色,并通过少量微调实现了从仿真到现实的可靠迁移。

📝 摘要(中文)

本文提出DAWN(Diffusion is All We Need for robot control),一个统一的基于扩散模型的框架,用于语言条件下的机器人操作。DAWN通过结构化的像素运动表示,桥接了高层运动意图和底层机器人动作。在高层和底层控制器中,DAWN都采用扩散过程建模,从而产生一个完全可训练的端到端系统,并具有可解释的中间运动抽象。DAWN在具有挑战性的CALVIN基准测试中取得了最先进的结果,展示了强大的多任务性能,并在MetaWorld上进一步验证了其有效性。尽管仿真和现实之间存在巨大的领域差距,并且真实世界的数据有限,但我们通过最少的微调证明了可靠的真实世界迁移,说明了基于扩散的运动抽象在机器人控制中的实际可行性。我们的结果表明,将扩散建模与以运动为中心的表示相结合,可以作为可扩展和鲁棒的机器人学习的强大基线。

🔬 方法详解

问题定义:现有机器人控制方法通常难以有效地将高层语言指令转化为低层机器人动作,尤其是在复杂的多任务环境中。这些方法往往需要复杂的模块化设计或大量的领域知识,并且在仿真到现实的迁移过程中表现不佳。痛点在于缺乏一个统一且可解释的框架,能够同时处理高层意图和底层控制,并具备良好的泛化能力。

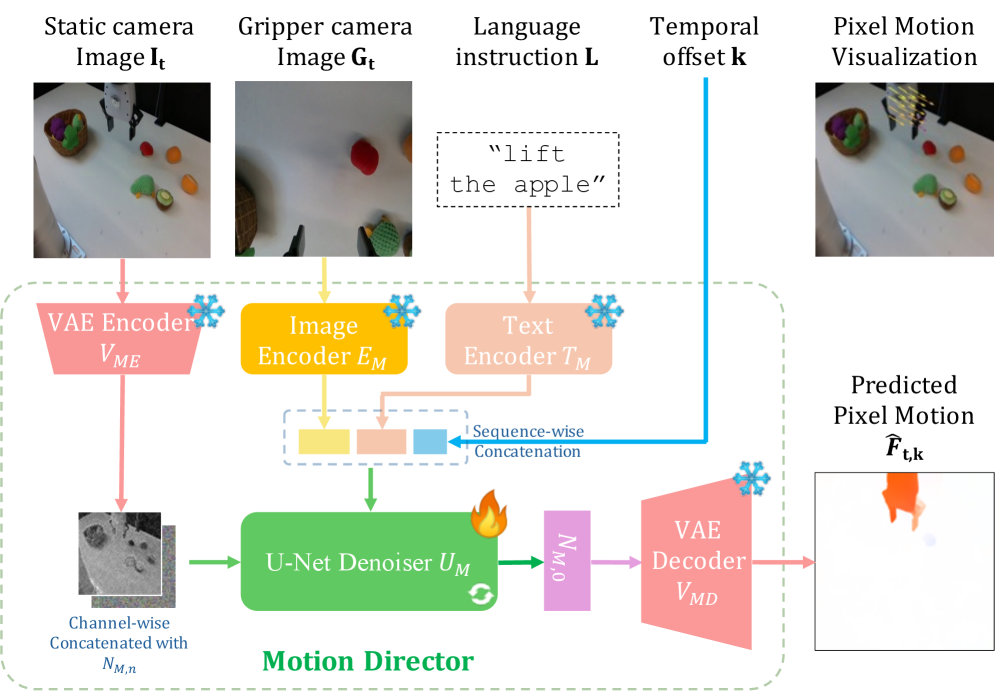

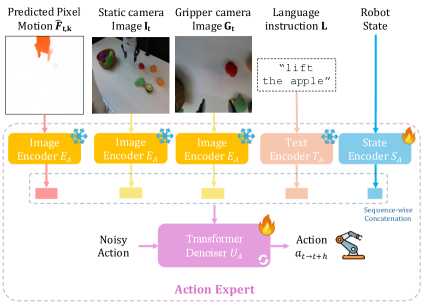

核心思路:DAWN的核心思路是将高层运动意图和底层机器人动作都建模为扩散过程。通过使用结构化的像素运动表示作为中间抽象,DAWN能够将语言指令转化为像素级别的运动轨迹,进而驱动机器人的动作。这种方法的核心在于利用扩散模型的强大生成能力和像素运动表示的可解释性,从而实现端到端的机器人控制。

技术框架:DAWN的整体框架包含两个主要的扩散模型:一个高层扩散模型和一个低层扩散模型。高层扩散模型接收语言指令作为输入,生成像素运动的表示。低层扩散模型接收高层扩散模型的输出,并将其转化为机器人的具体动作。整个框架通过端到端的方式进行训练,从而优化高层意图到低层动作的映射。

关键创新:DAWN最重要的技术创新在于将扩散模型应用于机器人控制,并使用像素运动表示作为中间抽象。这种方法与传统的基于规划或强化学习的机器人控制方法有着本质的区别。DAWN不需要显式的状态估计或奖励函数设计,而是通过学习数据中的运动模式来实现控制。此外,像素运动表示的可解释性使得DAWN能够更好地理解和调试控制策略。

关键设计:DAWN的关键设计包括像素运动表示的具体形式、扩散模型的网络结构和损失函数。像素运动表示通常采用光流或类似的运动估计方法来提取图像中的运动信息。扩散模型可以使用U-Net或Transformer等常见的网络结构。损失函数通常包括重构损失和正则化项,以保证生成运动轨迹的质量和稳定性。此外,DAWN还采用了数据增强和领域自适应等技术来提高模型的泛化能力。

🖼️ 关键图片

📊 实验亮点

DAWN在CALVIN基准测试中取得了state-of-the-art的结果,显著优于现有的机器人控制方法。此外,DAWN在MetaWorld上也表现出色,验证了其泛化能力。更重要的是,DAWN通过少量微调实现了从仿真到现实的可靠迁移,证明了其在实际应用中的可行性。这些实验结果表明,DAWN是一种非常有前景的机器人控制框架。

🎯 应用场景

DAWN框架具有广泛的应用前景,可应用于各种需要语言指令控制的机器人任务,例如家庭服务机器人、工业自动化机器人和医疗机器人。该研究的实际价值在于提供了一种更通用、更鲁棒的机器人控制方法,降低了机器人开发的门槛。未来,DAWN有望推动机器人技术在更多领域的应用,并促进人机协作的进一步发展。

📄 摘要(原文)

We present DAWN (Diffusion is All We Need for robot control), a unified diffusion-based framework for language-conditioned robotic manipulation that bridges high-level motion intent and low-level robot action via structured pixel motion representation. In DAWN, both the high-level and low-level controllers are modeled as diffusion processes, yielding a fully trainable, end-to-end system with interpretable intermediate motion abstractions. DAWN achieves state-of-the-art results on the challenging CALVIN benchmark, demonstrating strong multi-task performance, and further validates its effectiveness on MetaWorld. Despite the substantial domain gap between simulation and reality and limited real-world data, we demonstrate reliable real-world transfer with only minimal finetuning, illustrating the practical viability of diffusion-based motion abstractions for robotic control. Our results show the effectiveness of combining diffusion modeling with motion-centric representations as a strong baseline for scalable and robust robot learning. Project page: https://nero1342.github.io/DAWN/