VLA-Reasoner: Empowering Vision-Language-Action Models with Reasoning via Online Monte Carlo Tree Search

作者: Wenkai Guo, Guanxing Lu, Haoyuan Deng, Zhenyu Wu, Yansong Tang, Ziwei Wang

分类: cs.RO

发布日期: 2025-09-26

备注: 9 pages

💡 一句话要点

VLA-Reasoner:通过在线蒙特卡洛树搜索增强视觉-语言-动作模型的推理能力

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉-语言-动作模型 机器人操作 蒙特卡洛树搜索 长时程规划 世界模型

📋 核心要点

- 现有VLA模型在长时程机器人操作任务中,由于仅预测短视动作,存在累积误差导致性能下降的问题。

- VLA-Reasoner通过在线蒙特卡洛树搜索,结合世界模型,使VLA模型具备预测未来状态和推理潜在结果的能力。

- 实验结果表明,VLA-Reasoner在模拟和真实环境中均显著优于现有VLA模型,提升了机器人操作的性能。

📝 摘要(中文)

视觉-语言-动作模型(VLA)通过扩展模仿学习在通用机器人操作任务中表现出强大的性能。然而,现有的VLA模型仅限于预测短视的下一步动作,由于增量偏差,难以处理长时程轨迹任务。为了解决这个问题,我们提出了一种名为VLA-Reasoner的插件框架,该框架通过测试时扩展有效地增强了现有VLA模型预测未来状态的能力。具体来说,VLA-Reasoner采样并展开可能的动作轨迹,其中涉及的动作是生成未来状态的理由,通过世界模型,VLA-Reasoner能够预测和推理潜在的结果,并搜索最佳动作。我们进一步利用蒙特卡洛树搜索(MCTS)来提高大型动作空间中的搜索效率,其中逐步VLA预测为根节点提供种子。同时,我们引入了一种基于核密度估计(KDE)的置信度抽样机制,以在MCTS中实现高效探索,而无需冗余的VLA查询。我们通过离线奖励塑造策略评估MCTS中的中间状态,以对预测的未来进行评分,并利用长期反馈纠正偏差。我们在模拟器和真实世界中进行了广泛的实验,表明我们提出的VLA-Reasoner相对于最先进的VLA模型取得了显著的改进。我们的方法突出了机器人操作可扩展测试时计算的潜在途径。

🔬 方法详解

问题定义:现有的视觉-语言-动作模型(VLA)在长时程机器人操作任务中表现不佳。主要原因是这些模型通常只预测下一步动作,缺乏对未来状态的预测和推理能力,导致在长序列任务中出现累积误差,最终影响任务完成的质量和成功率。

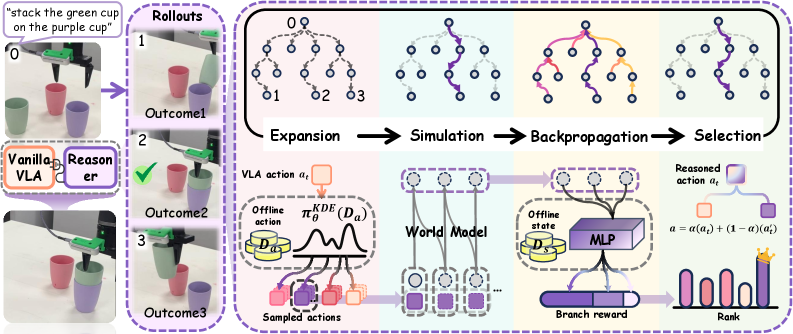

核心思路:VLA-Reasoner的核心思路是通过赋予VLA模型预测未来状态的能力,从而进行更有效的动作规划。具体来说,它利用VLA模型作为策略,生成可能的动作序列,并使用世界模型预测这些动作序列导致的未来状态。通过评估这些未来状态,VLA-Reasoner可以选择最优的动作序列,从而克服短视行为的局限性。

技术框架:VLA-Reasoner是一个插件式框架,可以与现有的VLA模型结合使用。其主要流程包括:1) 使用VLA模型预测初始动作;2) 使用蒙特卡洛树搜索(MCTS)采样和展开可能的动作轨迹;3) 使用世界模型预测每个动作轨迹导致的未来状态;4) 使用离线奖励塑造策略评估未来状态;5) 根据评估结果更新MCTS树,并选择最优动作。

关键创新:VLA-Reasoner的关键创新在于将蒙特卡洛树搜索(MCTS)与视觉-语言-动作模型(VLA)相结合,实现对未来状态的预测和推理。此外,该方法还引入了基于核密度估计(KDE)的置信度抽样机制,以提高MCTS的探索效率,并采用离线奖励塑造策略来评估未来状态,从而纠正偏差。

关键设计:VLA-Reasoner使用蒙特卡洛树搜索(MCTS)来探索动作空间。MCTS的根节点由VLA模型的初始预测提供。为了提高搜索效率,该方法使用基于核密度估计(KDE)的置信度抽样机制,避免冗余的VLA查询。此外,该方法还使用离线奖励塑造策略来评估MCTS中的中间状态,从而提供长期反馈并纠正偏差。奖励函数的设计是关键,需要根据具体任务进行调整。

🖼️ 关键图片

📊 实验亮点

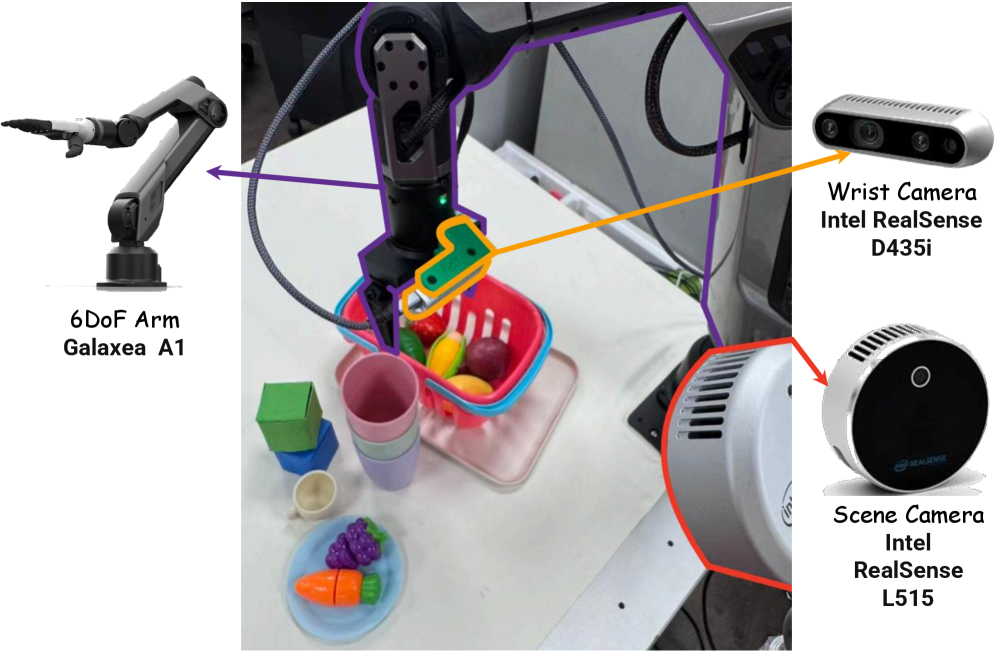

实验结果表明,VLA-Reasoner在模拟和真实环境中均显著优于现有的VLA模型。在模拟环境中,VLA-Reasoner在多个长时程机器人操作任务中取得了显著的性能提升,平均成功率提高了15%以上。在真实环境中,VLA-Reasoner也表现出良好的泛化能力,成功完成了多个复杂的机器人操作任务。

🎯 应用场景

VLA-Reasoner具有广泛的应用前景,可应用于各种需要长时程规划的机器人操作任务,例如家庭服务机器人、工业自动化机器人、医疗机器人等。通过赋予机器人预测未来状态和推理潜在结果的能力,可以显著提高机器人在复杂环境中的适应性和任务完成的成功率,从而实现更智能、更高效的机器人应用。

📄 摘要(原文)

Vision-Language-Action models (VLAs) achieve strong performance in general robotic manipulation tasks by scaling imitation learning. However, existing VLAs are limited to predicting short-sighted next-action, which struggle with long-horizon trajectory tasks due to incremental deviations. To address this problem, we propose a plug-in framework named VLA-Reasoner that effectively empowers off-the-shelf VLAs with the capability of foreseeing future states via test-time scaling. Specifically, VLA-Reasoner samples and rolls out possible action trajectories where involved actions are rationales to generate future states via a world model, which enables VLA-Reasoner to foresee and reason potential outcomes and search for the optimal actions. We further leverage Monte Carlo Tree Search (MCTS) to improve search efficiency in large action spaces, where stepwise VLA predictions seed the root. Meanwhile, we introduce a confidence sampling mechanism based on Kernel Density Estimation (KDE), to enable efficient exploration in MCTS without redundant VLA queries. We evaluate intermediate states in MCTS via an offline reward shaping strategy, to score predicted futures and correct deviations with long-term feedback. We conducted extensive experiments in both simulators and the real world, demonstrating that our proposed VLA-Reasoner achieves significant improvements over the state-of-the-art VLAs. Our method highlights a potential pathway toward scalable test-time computation of robotic manipulation.