EgoDemoGen: Novel Egocentric Demonstration Generation Enables Viewpoint-Robust Manipulation

作者: Yuan Xu, Jiabing Yang, Xiaofeng Wang, Yixiang Chen, Zheng Zhu, Bowen Fang, Guan Huang, Xinze Chen, Yun Ye, Qiang Zhang, Peiyan Li, Xiangnan Wu, Kai Wang, Bing Zhan, Shuo Lu, Jing Liu, Nianfeng Liu, Yan Huang, Liang Wang

分类: cs.RO

发布日期: 2025-09-26

💡 一句话要点

EgoDemoGen:生成新颖的自我中心视角演示,实现视角鲁棒的机器人操作

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱六:视频提取与匹配 (Video Extraction)

关键词: 机器人操作 模仿学习 视角鲁棒性 自我中心视角 视频生成

📋 核心要点

- 模仿学习策略在机器人操作中面临视角变化的挑战,尤其是在自我中心视角下,性能会显著下降。

- EgoDemoGen通过生成新颖的自我中心视角演示来解决此问题,利用视角转换和视频生成技术,扩充训练数据。

- 实验表明,结合EgoDemoGen生成的数据进行训练,能显著提升机器人操作在不同视角下的成功率,仿真和真实环境均有提升。

📝 摘要(中文)

本文提出EgoDemoGen框架,旨在解决模仿学习策略在机器人操作中因自我中心视角变化而性能下降的问题。EgoDemoGen通过重定向新视角下的动作,并利用提出的生成视频修复模型EgoViewTransfer合成相应的自我中心视角视频,从而生成配对的新颖自我中心视角演示。EgoViewTransfer模型基于预训练的视频生成模型,并使用自监督双重重投影策略进行微调。在仿真环境(RoboTwin2.0)和真实机器人上的评估表明,结合EgoDemoGen生成的新视角演示和原始演示进行训练后,标准视角和新视角的策略成功率分别绝对提升了+17.0%和+17.7%。在真实机器人上,绝对提升分别为+18.3%和+25.8%。性能随着EgoDemoGen生成演示比例的增加而持续提高,但收益递减。这些结果表明EgoDemoGen为实现自我中心视角鲁棒的机器人操作提供了一条有效的途径。

🔬 方法详解

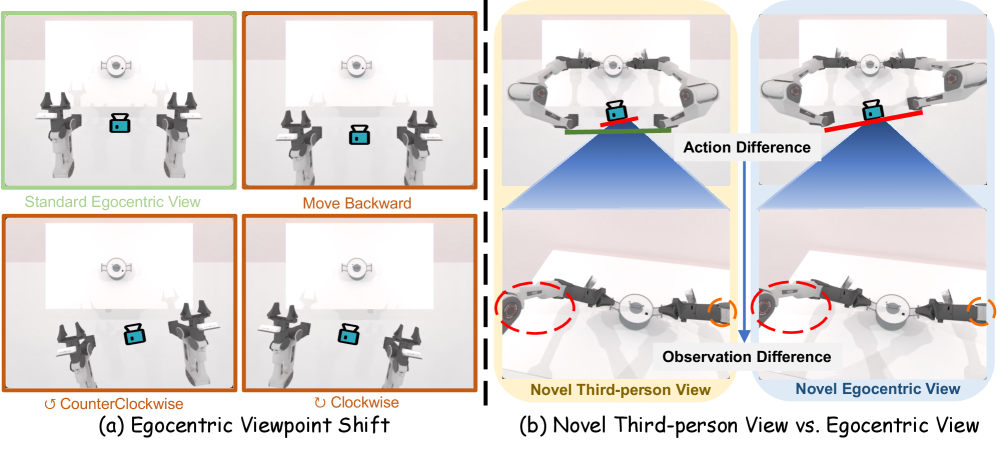

问题定义:现有的基于模仿学习的机器人操作策略,在单一自我中心视角下训练时表现良好,但当视角发生变化时,性能会显著下降。这限制了策略的泛化能力和鲁棒性。因此,需要解决如何在不同自我中心视角下,提升机器人操作策略的性能问题。

核心思路:论文的核心思路是通过生成新颖的自我中心视角演示来扩充训练数据,从而提高策略的视角鲁棒性。具体来说,通过重定向新视角下的动作,并合成相应的自我中心视角视频,为策略提供更多样化的训练样本。

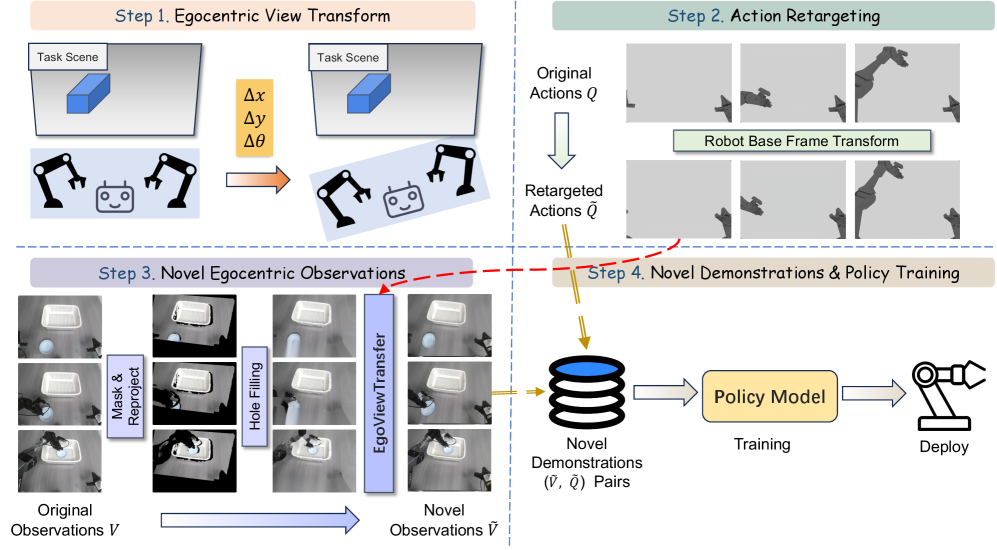

技术框架:EgoDemoGen框架包含两个主要模块:动作重定向模块和视频生成模块(EgoViewTransfer)。动作重定向模块负责将原始演示中的动作映射到新的自我中心视角下。EgoViewTransfer模型则基于新视角下的场景视频和重定向后的机器人动作,生成对应的自我中心视角视频。整体流程是:原始演示 -> 动作重定向 -> 新视角场景视频 + 重定向动作 -> EgoViewTransfer -> 新视角自我中心演示。

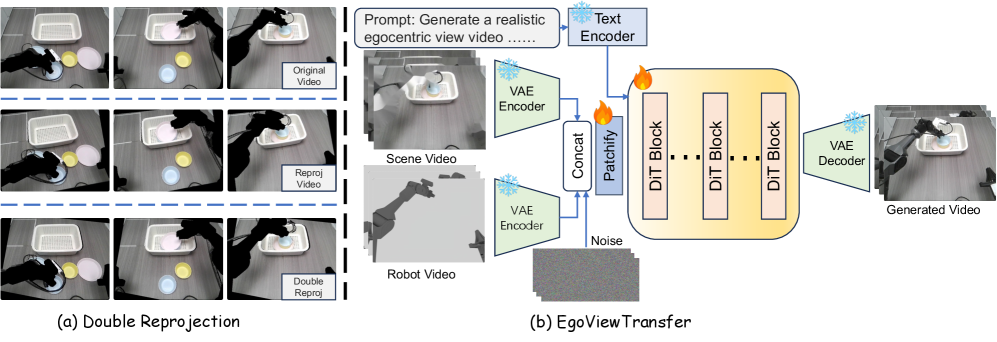

关键创新:EgoViewTransfer模型是关键创新点。它是一个生成视频修复模型,能够根据新视角的场景视频和重定向后的机器人动作,生成逼真的自我中心视角视频。该模型利用自监督双重重投影策略进行微调,从而提高生成视频的质量和一致性。

关键设计:EgoViewTransfer模型基于预训练的视频生成模型,并使用自监督双重重投影策略进行微调。具体来说,该策略通过将生成的视频重投影回原始视角,并计算重投影误差,来约束模型的学习。此外,模型还使用了对抗损失和感知损失,以提高生成视频的真实感。网络结构细节和损失函数选择等具体设计未在摘要中详细描述,属于未知信息。

🖼️ 关键图片

📊 实验亮点

在仿真环境(RoboTwin2.0)中,使用EgoDemoGen生成的数据进行训练后,标准视角和新视角的策略成功率分别绝对提升了+17.0%和+17.7%。在真实机器人上,绝对提升分别为+18.3%和+25.8%。这些结果表明EgoDemoGen能够显著提高机器人操作策略的视角鲁棒性。

🎯 应用场景

EgoDemoGen技术可应用于各种需要视角鲁棒性的机器人操作任务,例如家庭服务机器人、工业机器人和医疗机器人。通过提高机器人对不同视角的适应能力,可以使其在更复杂和动态的环境中执行任务,从而提高工作效率和安全性。该技术还有潜力应用于虚拟现实和增强现实等领域,以生成更逼真的虚拟环境。

📄 摘要(原文)

Imitation learning based policies perform well in robotic manipulation, but they often degrade under egocentric viewpoint shifts when trained from a single egocentric viewpoint. To address this issue, we present EgoDemoGen, a framework that generates paired novel egocentric demonstrations by retargeting actions in the novel egocentric frame and synthesizing the corresponding egocentric observation videos with proposed generative video repair model EgoViewTransfer, which is conditioned by a novel-viewpoint reprojected scene video and a robot-only video rendered from the retargeted joint actions. EgoViewTransfer is finetuned from a pretrained video generation model using self-supervised double reprojection strategy. We evaluate EgoDemoGen on both simulation (RoboTwin2.0) and real-world robot. After training with a mixture of EgoDemoGen-generated novel egocentric demonstrations and original standard egocentric demonstrations, policy success rate improves absolutely by +17.0% for standard egocentric viewpoint and by +17.7% for novel egocentric viewpoints in simulation. On real-world robot, the absolute improvements are +18.3% and +25.8%. Moreover, performance continues to improve as the proportion of EgoDemoGen-generated demonstrations increases, with diminishing returns. These results demonstrate that EgoDemoGen provides a practical route to egocentric viewpoint-robust robotic manipulation.