MINT-RVAE: Multi-Cues Intention Prediction of Human-Robot Interaction using Human Pose and Emotion Information from RGB-only Camera Data

作者: Farida Mohsen, Ali Safa

分类: cs.RO, cs.CV

发布日期: 2025-09-26

💡 一句话要点

MINT-RVAE:利用RGB相机的人体姿态和情感信息进行人机交互意图预测

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 人机交互 意图预测 RGB图像 深度学习 数据增强 类别不平衡 RVAE

📋 核心要点

- 现有的人机交互意图预测方法依赖RGB-D等多模态输入,成本较高且限制了应用场景。

- 提出MINT-RVAE模型,通过合成数据增强和优化损失函数,提升模型在类别不平衡数据集上的泛化能力。

- 实验结果表明,该方法仅使用RGB输入即可达到SOTA性能,AUROC达到0.95,并发布了新的帧级标注数据集。

📝 摘要(中文)

为了实现有效的人机交互与协作,高效地检测人类与机器人的交互意图至关重要。过去十年,深度学习在该领域备受关注,但现有方法大多依赖于多模态输入,例如RGB结合深度信息(RGB-D),将感觉数据的时间序列窗口分类为交互或非交互。本文提出了一种新颖的仅使用RGB的流水线,用于以帧级精度预测人类交互意图,从而加快机器人响应速度并提高服务质量。意图预测的一个关键挑战是真实世界人机交互数据集中固有的类别不平衡,这会阻碍模型的训练和泛化。为了解决这个问题,我们引入了MINT-RVAE,一种合成序列生成方法,以及新的损失函数和训练策略,以增强对样本外数据的泛化能力。我们的方法实现了最先进的性能(AUROC:0.95),优于先前的工作(AUROC:0.90-0.912),同时仅需要RGB输入并支持精确的帧起始预测。最后,为了支持未来的研究,我们公开了我们新的数据集,其中包含人类交互意图的帧级标注。

🔬 方法详解

问题定义:现有的人机交互意图预测方法通常依赖于RGB-D数据,这限制了其在资源受限环境中的应用。此外,真实世界的人机交互数据集往往存在严重的类别不平衡问题,即交互行为的样本远少于非交互行为的样本,导致模型训练困难,泛化能力差。

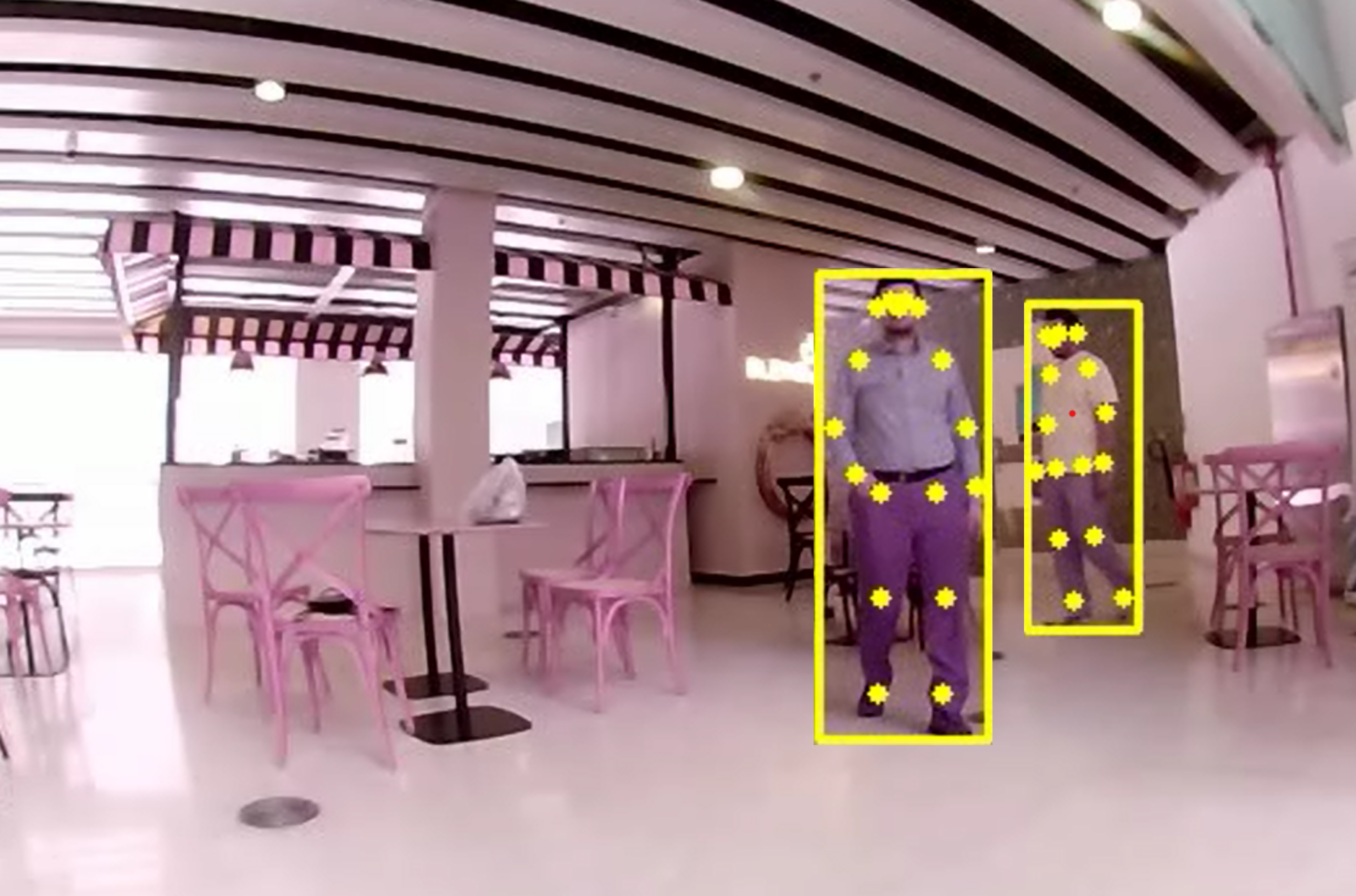

核心思路:本文的核心思路是利用RGB图像中的人体姿态和情感信息来预测人机交互意图,并采用数据增强和损失函数优化策略来解决类别不平衡问题。通过生成合成的交互序列,增加模型对交互行为的识别能力,并设计特定的损失函数来平衡不同类别的权重。

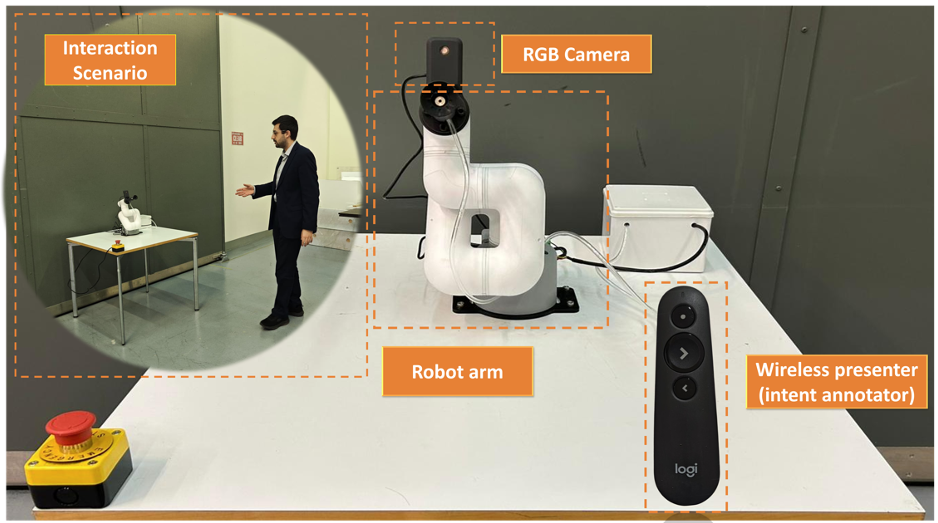

技术框架:该方法主要包含以下几个模块:1) 使用RGB图像提取人体姿态和情感特征;2) 利用RVAE(Recurrent Variational Autoencoder)生成合成的交互序列,以扩充训练数据集;3) 设计新的损失函数,包括类别平衡损失和对抗损失,以提高模型对交互意图的识别精度;4) 使用训练好的模型进行帧级别的交互意图预测。

关键创新:该方法的主要创新点在于:1) 提出了一种基于RVAE的合成序列生成方法MINT-RVAE,能够有效地扩充训练数据集,缓解类别不平衡问题;2) 设计了一种新的损失函数,能够平衡不同类别的权重,并提高模型对交互意图的识别精度;3) 实现了仅使用RGB输入即可达到SOTA性能的交互意图预测。

关键设计:MINT-RVAE使用循环神经网络(RNN)作为编码器和解码器,学习交互序列的潜在表示。损失函数包括重构损失、KL散度损失、类别平衡损失和对抗损失。类别平衡损失用于平衡不同类别的权重,对抗损失用于提高生成序列的真实性。具体的网络结构和参数设置在论文中有详细描述。

🖼️ 关键图片

📊 实验亮点

该研究提出的MINT-RVAE模型在人机交互意图预测任务上取得了显著的性能提升。在公开数据集上,该模型仅使用RGB输入就达到了0.95的AUROC,超越了以往依赖RGB-D数据的SOTA方法(AUROC: 0.90-0.912)。此外,该研究还发布了一个新的帧级别标注的人机交互数据集,为未来的研究提供了宝贵资源。

🎯 应用场景

该研究成果可广泛应用于各种人机交互场景,例如:智能家居、服务机器人、自动驾驶等。通过准确预测人类的交互意图,机器人可以更智能地响应人类的需求,提供更优质的服务,从而提升用户体验和人机协作效率。该技术还有助于开发更安全、更可靠的人机协作系统。

📄 摘要(原文)

Efficiently detecting human intent to interact with ubiquitous robots is crucial for effective human-robot interaction (HRI) and collaboration. Over the past decade, deep learning has gained traction in this field, with most existing approaches relying on multimodal inputs, such as RGB combined with depth (RGB-D), to classify time-sequence windows of sensory data as interactive or non-interactive. In contrast, we propose a novel RGB-only pipeline for predicting human interaction intent with frame-level precision, enabling faster robot responses and improved service quality. A key challenge in intent prediction is the class imbalance inherent in real-world HRI datasets, which can hinder the model's training and generalization. To address this, we introduce MINT-RVAE, a synthetic sequence generation method, along with new loss functions and training strategies that enhance generalization on out-of-sample data. Our approach achieves state-of-the-art performance (AUROC: 0.95) outperforming prior works (AUROC: 0.90-0.912), while requiring only RGB input and supporting precise frame onset prediction. Finally, to support future research, we openly release our new dataset with frame-level labeling of human interaction intent.