An Ontology for Unified Modeling of Tasks, Actions, Environments, and Capabilities in Personal Service Robotics

作者: Margherita Martorana, Francesca Urgese, Ilaria Tiddi, Stefan Schlobach

分类: cs.RO, cs.AI

发布日期: 2025-09-26

💡 一句话要点

提出OntoBOT本体,统一建模服务机器人任务、动作、环境与能力

🎯 匹配领域: 支柱七:动作重定向 (Motion Retargeting)

关键词: 服务机器人 本体 知识图 任务规划 形式推理

📋 核心要点

- 现有服务机器人解决方案通常与特定平台绑定,缺乏互操作性、可重用性和知识共享能力。

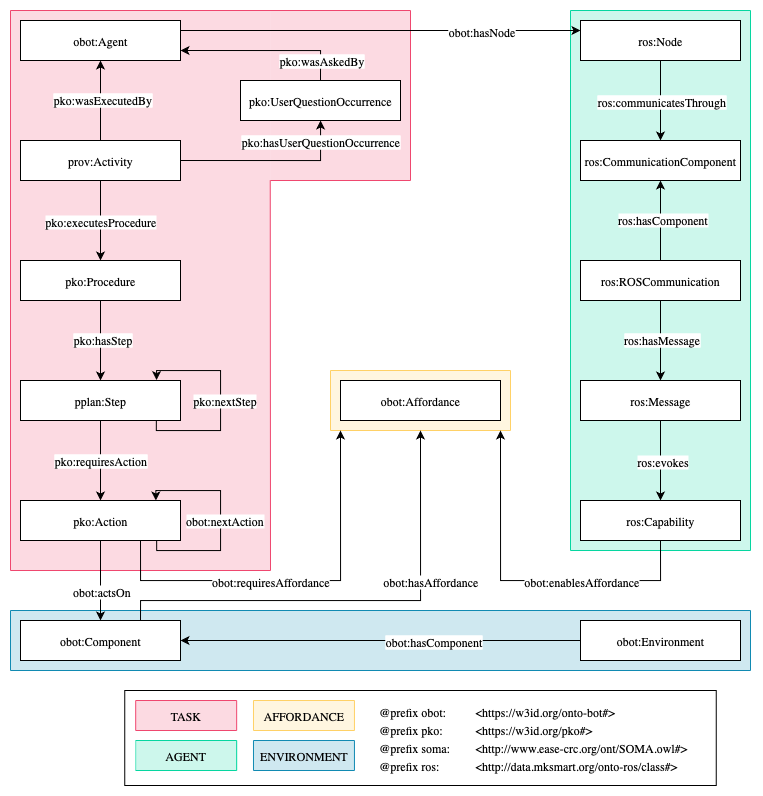

- OntoBOT本体通过扩展现有本体,统一表示任务、动作、环境和机器人能力,支持形式推理。

- 通过在多种机器人平台上评估能力问题,验证了OntoBOT的通用性,展示了其上下文感知推理能力。

📝 摘要(中文)

个人服务机器人越来越多地应用于家庭环境中,以帮助老年人和需要支持的人。有效的操作不仅涉及物理交互,还包括解释动态环境、理解任务以及根据上下文选择适当动作的能力。这需要集成硬件组件(例如传感器、执行器)和能够推理任务、环境和机器人能力的软件系统。机器人操作系统(ROS)等框架提供了开源工具,可帮助将底层硬件与更高级别的功能连接起来。然而,实际部署仍然与特定平台紧密相关。因此,解决方案通常是孤立且硬编码的,从而限制了互操作性、可重用性和知识共享。本体和知识图提供了一种结构化的方式来表示任务、环境和机器人能力。现有的本体,例如活动社会物理模型(SOMA)和语言和认知工程描述本体(DOLCE),提供了活动、空间关系和推理结构的建模。然而,它们通常侧重于特定领域,并且没有完全捕获环境、动作、机器人能力和系统级集成之间的联系。在这项工作中,我们提出了机器人和动作本体(OntoBOT),它扩展了现有的本体,以提供任务、动作、环境和能力的统一表示。我们的贡献是双重的:(1)我们将这些方面统一到一个有凝聚力的本体中,以支持关于任务执行的形式推理,以及(2)我们通过评估TIAGo、HSR、UR3和Stretch这四个具身代理上的能力问题来证明其通用性,展示了OntoBOT如何在服务机器人中实现上下文感知推理、面向任务的执行和知识共享。

🔬 方法详解

问题定义:现有服务机器人系统在任务规划和执行方面存在互操作性差、知识难以共享和重用的问题。现有的本体虽然可以描述活动、空间关系等,但无法全面捕捉环境、动作、机器人能力和系统集成之间的联系,导致难以进行有效的任务推理和执行。

核心思路:OntoBOT的核心思路是构建一个统一的本体,将任务、动作、环境和机器人能力整合到一个连贯的模型中。通过形式化的知识表示,实现上下文感知的任务推理和执行,并促进不同机器人平台之间的知识共享和重用。这样设计的目的是为了解决现有服务机器人系统在互操作性、可重用性和知识共享方面的局限性。

技术框架:OntoBOT本体扩展了现有的本体,例如SOMA和DOLCE,并在此基础上构建了新的概念和关系,以全面描述任务、动作、环境和机器人能力。该本体可以用于构建知识图,从而支持基于知识的推理和任务规划。整体框架包括本体定义、知识图构建、推理引擎和任务执行模块。

关键创新:OntoBOT的关键创新在于其统一的知识表示方法,它将任务、动作、环境和机器人能力整合到一个本体中,从而实现了上下文感知的任务推理和执行。与现有方法相比,OntoBOT更加全面和灵活,可以适应不同的机器人平台和应用场景。

关键设计:OntoBOT本体的关键设计包括对任务、动作、环境和机器人能力的精确定义和建模。例如,任务被分解为一系列动作,每个动作都与特定的环境和机器人能力相关联。本体中还定义了各种关系,例如因果关系、空间关系和时间关系,从而支持复杂的推理过程。具体的参数设置和损失函数未知,因为论文主要关注本体的设计和构建,而非具体的机器学习模型。

🖼️ 关键图片

📊 实验亮点

论文通过在TIAGo、HSR、UR3和Stretch这四个不同的机器人平台上评估能力问题,验证了OntoBOT的通用性和有效性。实验结果表明,OntoBOT可以支持上下文感知的任务推理和执行,并促进不同平台之间的知识共享。具体的性能数据未知,但实验结果表明OntoBOT具有良好的应用前景。

🎯 应用场景

OntoBOT本体可应用于各种服务机器人应用场景,例如家庭助手、医疗护理、物流运输等。通过OntoBOT,机器人可以更好地理解用户的意图,适应动态环境,并选择合适的动作来完成任务。此外,OntoBOT还可以促进不同机器人平台之间的知识共享和协作,从而加速服务机器人技术的发展。

📄 摘要(原文)

Personal service robots are increasingly used in domestic settings to assist older adults and people requiring support. Effective operation involves not only physical interaction but also the ability to interpret dynamic environments, understand tasks, and choose appropriate actions based on context. This requires integrating both hardware components (e.g. sensors, actuators) and software systems capable of reasoning about tasks, environments, and robot capabilities. Frameworks such as the Robot Operating System (ROS) provide open-source tools that help connect low-level hardware with higher-level functionalities. However, real-world deployments remain tightly coupled to specific platforms. As a result, solutions are often isolated and hard-coded, limiting interoperability, reusability, and knowledge sharing. Ontologies and knowledge graphs offer a structured way to represent tasks, environments, and robot capabilities. Existing ontologies, such as the Socio-physical Model of Activities (SOMA) and the Descriptive Ontology for Linguistic and Cognitive Engineering (DOLCE), provide models for activities, spatial relationships, and reasoning structures. However, they often focus on specific domains and do not fully capture the connection between environment, action, robot capabilities, and system-level integration. In this work, we propose the Ontology for roBOts and acTions (OntoBOT), which extends existing ontologies to provide a unified representation of tasks, actions, environments, and capabilities. Our contributions are twofold: (1) we unify these aspects into a cohesive ontology to support formal reasoning about task execution, and (2) we demonstrate its generalizability by evaluating competency questions across four embodied agents - TIAGo, HSR, UR3, and Stretch - showing how OntoBOT enables context-aware reasoning, task-oriented execution, and knowledge sharing in service robotics.