Developing Vision-Language-Action Model from Egocentric Videos

作者: Tomoya Yoshida, Shuhei Kurita, Taichi Nishimura, Shinsuke Mori

分类: cs.RO, cs.AI

发布日期: 2025-09-26

💡 一句话要点

提出基于第一视角视频的视觉-语言-动作模型训练方法,无需人工标注。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱六:视频提取与匹配 (Video Extraction) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉-语言-动作模型 第一视角视频 机器人操作 预训练 EgoScaler

📋 核心要点

- 现有VLA模型训练依赖昂贵的人工遥操作或需要额外的手部姿态标注,限制了数据规模和泛化能力。

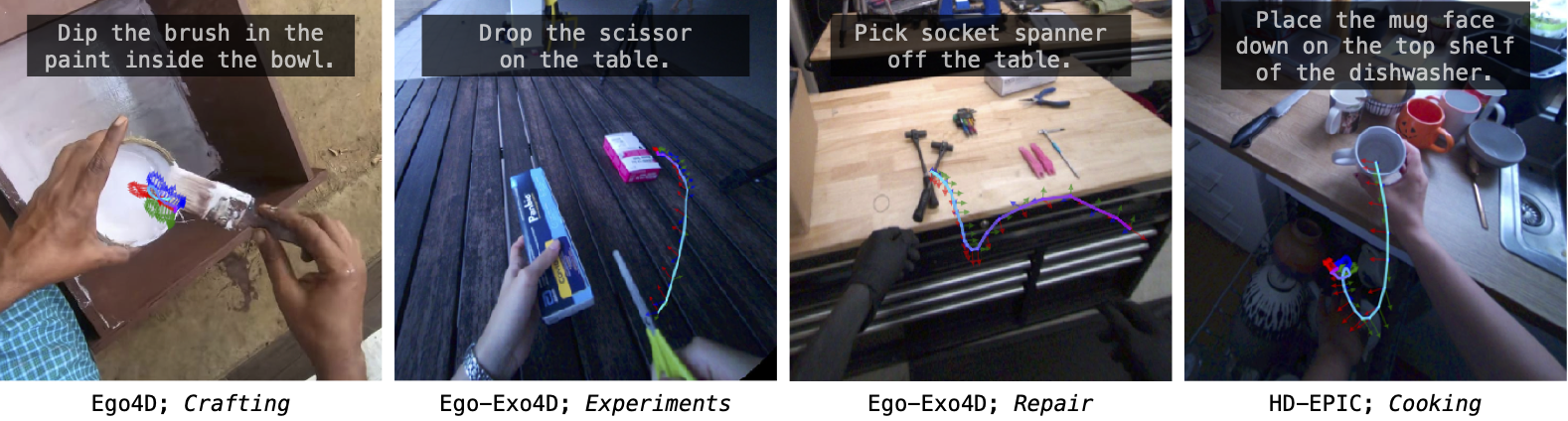

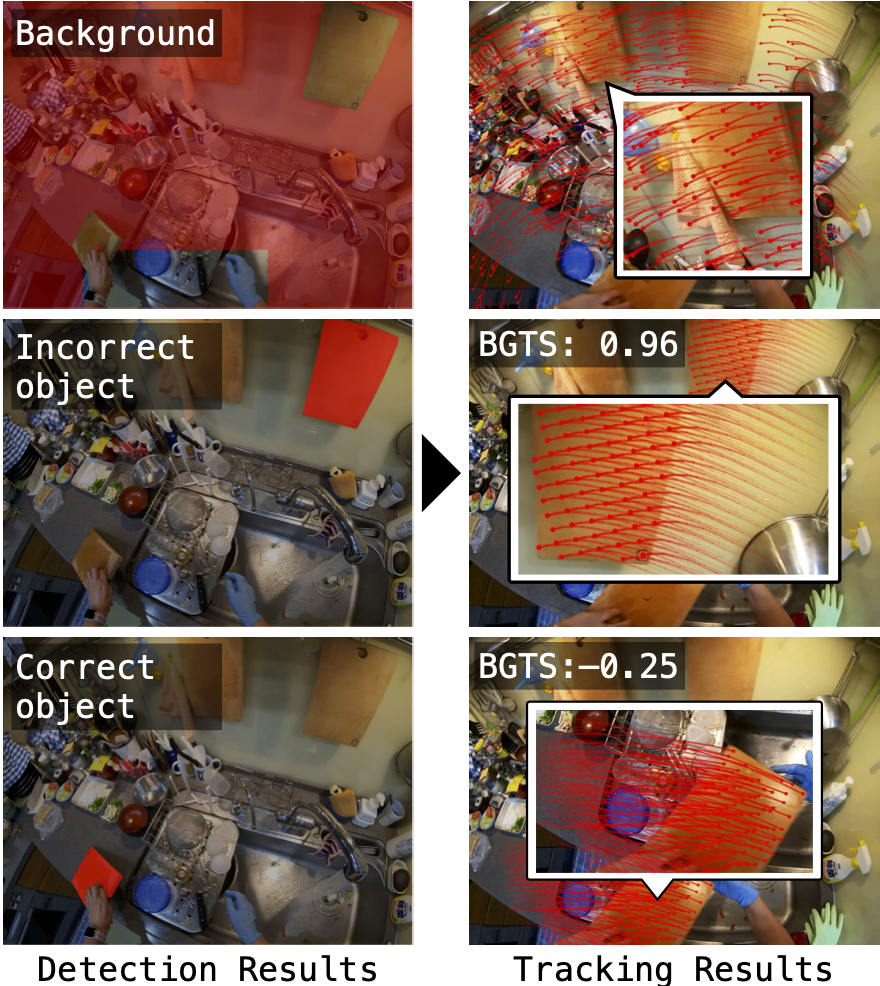

- 利用EgoScaler从第一视角视频中提取物体操作轨迹,自动构建大规模VLA预训练数据集,无需人工干预。

- 实验表明,使用该数据集预训练的VLA模型在模拟和真实机器人环境中均显著提升了任务成功率。

📝 摘要(中文)

本文提出了一种利用第一视角视频开发视觉-语言-动作模型(VLA)的方法。与通常使用的、成本高昂的专家手动遥操作训练VLA不同,第一视角视频提供了一种可扩展的替代方案,用于学习物体操作。为了解决直接从原始第一视角视频训练VLA的挑战,本文利用EgoScaler框架,该框架可以从第一视角视频中提取6DoF物体操作轨迹,而无需辅助记录。作者将EgoScaler应用于四个大规模第一视角视频数据集,并自动细化噪声或不完整的轨迹,从而构建了一个新的大规模数据集用于VLA预训练。在模拟和真实机器人环境中使用最先进的$π_0$架构进行的实验表明:(i)与从头开始训练相比,在本文数据集上进行预训练可将任务成功率提高20%以上;(ii)性能与使用真实机器人数据集获得的性能相当;(iii)将本文数据集与真实机器人数据相结合可进一步提高性能。这些结果表明,第一视角视频是推进VLA研究的一种有前途且可扩展的资源。

🔬 方法详解

问题定义:论文旨在解决如何利用大规模第一视角视频数据,高效地训练视觉-语言-动作模型(VLA),从而提升机器人操作的性能。现有方法主要依赖于人工遥操作或需要额外的手部姿态标注,这些方法成本高昂且难以扩展到大规模数据集,限制了VLA模型的泛化能力。

核心思路:论文的核心思路是利用EgoScaler框架,从第一视角视频中自动提取6DoF物体操作轨迹,从而构建大规模的VLA预训练数据集。这种方法避免了人工标注的成本,并能够利用大量的现有第一视角视频数据。通过预训练,VLA模型可以学习到通用的物体操作知识,从而提升在特定任务上的性能。

技术框架:整体框架包括以下几个主要步骤:1) 使用EgoScaler从第一视角视频中提取物体操作轨迹;2) 对提取的轨迹进行自动细化,去除噪声和补全缺失部分;3) 使用处理后的轨迹数据训练VLA模型。论文使用了$π_0$架构作为VLA模型,该模型将视觉输入(视频帧)和语言指令作为输入,输出机器人的动作。

关键创新:最重要的技术创新点在于利用EgoScaler自动提取物体操作轨迹,从而避免了人工标注的成本。与现有方法相比,该方法能够利用大规模的第一视角视频数据,从而提升VLA模型的泛化能力。此外,论文还提出了一种自动细化轨迹的方法,进一步提高了数据的质量。

关键设计:EgoScaler框架的具体实现细节未知,论文重点在于利用该框架生成的数据集进行VLA模型的预训练。$π_0$架构的具体参数设置和损失函数等细节在论文中可能有所描述(未知)。自动细化轨迹的方法的具体实现细节也未知。

🖼️ 关键图片

📊 实验亮点

实验结果表明,在本文数据集上进行预训练可将任务成功率提高20%以上,性能与使用真实机器人数据集获得的性能相当,将本文数据集与真实机器人数据相结合可进一步提高性能。这些结果验证了第一视角视频作为VLA模型训练数据的有效性。

🎯 应用场景

该研究成果可应用于各种机器人操作任务,例如家庭服务机器人、工业机器人等。通过利用大量的用户第一视角视频数据,可以训练出更加智能和灵活的机器人,从而更好地完成各种任务。该方法降低了机器人学习的成本,加速了机器人技术的发展。

📄 摘要(原文)

Egocentric videos capture how humans manipulate objects and tools, providing diverse motion cues for learning object manipulation. Unlike the costly, expert-driven manual teleoperation commonly used in training Vision-Language-Action models (VLAs), egocentric videos offer a scalable alternative. However, prior studies that leverage such videos for training robot policies typically rely on auxiliary annotations, such as detailed hand-pose recordings. Consequently, it remains unclear whether VLAs can be trained directly from raw egocentric videos. In this work, we address this challenge by leveraging EgoScaler, a framework that extracts 6DoF object manipulation trajectories from egocentric videos without requiring auxiliary recordings. We apply EgoScaler to four large-scale egocentric video datasets and automatically refine noisy or incomplete trajectories, thereby constructing a new large-scale dataset for VLA pre-training. Our experiments with a state-of-the-art $π_0$ architecture in both simulated and real-robot environments yield three key findings: (i) pre-training on our dataset improves task success rates by over 20\% compared to training from scratch, (ii) the performance is competitive with that achieved using real-robot datasets, and (iii) combining our dataset with real-robot data yields further improvements. These results demonstrate that egocentric videos constitute a promising and scalable resource for advancing VLA research.