EEG-Driven AR-Robot System for Zero-Touch Grasping Manipulation

作者: Junzhe Wang, Jiarui Xie, Pengfei Hao, Zheng Li, Yi Cai

分类: cs.RO

发布日期: 2025-09-25

备注: 8 pages, 14 figures, submitted to ICRA 2026

💡 一句话要点

提出基于脑电的AR-机器人系统,实现零接触抓取操作

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 脑机接口 增强现实 机器人控制 运动想象 神经反馈 辅助机器人 零接触操作

📋 核心要点

- 现有BCI-机器人系统面临脑电信号噪声大、目标选择不灵活以及缺乏闭环验证等问题,限制了其在辅助场景中的实际应用。

- 本文提出一种闭环 BCI-AR-Robot 系统,利用 AR 神经反馈增强脑电控制的稳定性,结合视觉信息实现自主抓取。

- 实验结果表明,该系统在运动想象训练、AR神经反馈和闭环抓取任务中均取得了优异的性能,验证了其有效性。

📝 摘要(中文)

本文提出了一种闭环的脑机接口(BCI)-增强现实(AR)-机器人系统,用于零接触操作。该系统集成了基于运动想象(MI)的脑电(EEG)解码、AR神经反馈和机器人抓取。使用14通道脑电设备进行个体化的MI校准,基于智能手机的AR界面支持多目标导航,并提供方向一致的反馈以增强稳定性。机器人手臂结合决策输出和基于视觉的姿态估计,实现自主抓取。实验验证了该框架:MI训练达到93.1%的准确率,平均信息传输速率(ITR)为14.8 bit/min;AR神经反馈显著提高了持续控制(SCI = 0.210),并实现了最高的ITR (21.3 bit/min);闭环抓取成功率为97.2%,具有良好的效率和用户控制感。结果表明,AR反馈显著稳定了基于脑电的控制,该框架实现了鲁棒的零接触抓取,推动了辅助机器人应用和未来人机交互模式的发展。

🔬 方法详解

问题定义:现有基于脑机接口的机器人控制系统,尤其是在辅助机器人领域,面临着脑电信号的不稳定性和噪声干扰,导致控制精度和效率低下。此外,传统的目标选择方式通常是预定义的,缺乏灵活性,难以适应复杂环境。最重要的是,许多研究停留在仿真阶段,缺乏真实的闭环验证,限制了其在实际场景中的应用。

核心思路:本文的核心思路是利用增强现实(AR)技术提供的神经反馈来稳定脑电信号控制,并结合视觉信息实现自主抓取。通过AR界面提供方向一致的视觉反馈,增强用户对运动想象的控制能力,从而提高脑机接口的性能。同时,利用视觉信息进行目标姿态估计,使机器人能够自主完成抓取任务。

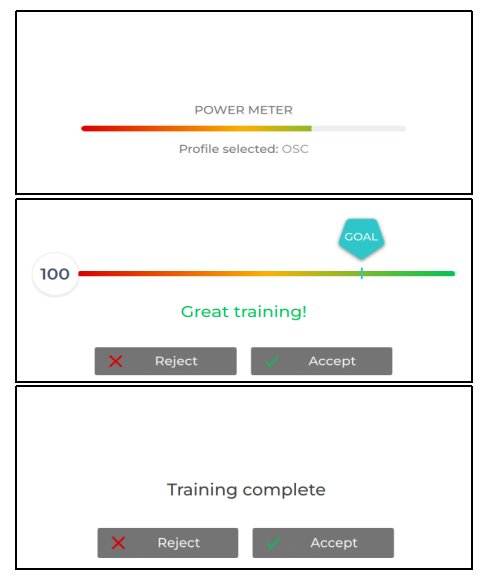

技术框架:该系统主要包含三个模块:基于运动想象(MI)的脑电(EEG)解码模块、增强现实(AR)神经反馈模块和机器人抓取模块。首先,使用14通道脑电设备采集脑电信号,并进行个体化的MI校准。然后,通过智能手机上的AR界面呈现多目标导航,并提供方向一致的视觉反馈。最后,机器人手臂结合脑电解码的决策输出和基于视觉的姿态估计,实现自主抓取。

关键创新:该论文的关键创新在于将AR神经反馈引入到脑机接口机器人控制系统中。AR反馈能够显著提高脑电控制的稳定性和信息传输速率,从而改善系统的整体性能。此外,该系统实现了闭环控制,能够根据用户的意图自主完成抓取任务,更贴近实际应用场景。

关键设计:在AR神经反馈模块中,设计了方向一致的视觉反馈,即AR界面上的指示箭头与用户想象的运动方向一致,从而增强用户的控制感。在机器人抓取模块中,采用了基于视觉的姿态估计方法,使机器人能够准确识别目标的位置和姿态。此外,还对脑电信号的预处理和特征提取方法进行了优化,以提高解码的准确性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该系统在多个方面取得了显著的性能提升。运动想象训练达到93.1%的准确率,平均信息传输速率(ITR)为14.8 bit/min。AR神经反馈显著提高了持续控制(SCI = 0.210),并实现了最高的ITR (21.3 bit/min),相比于静态、虚假和无AR基线有显著提升。闭环抓取成功率高达97.2%,表明该系统具有良好的鲁棒性和实用性。

🎯 应用场景

该研究成果可应用于辅助机器人领域,帮助运动障碍人士实现自主生活。例如,患者可以通过脑电控制机器人完成日常物品的抓取和操作,提高生活质量。此外,该技术还可应用于远程操作、危险环境作业等领域,实现更安全、高效的人机协作。未来,随着脑机接口技术的不断发展,该系统有望成为一种重要的人机交互方式。

📄 摘要(原文)

Reliable brain-computer interface (BCI) control of robots provides an intuitive and accessible means of human-robot interaction, particularly valuable for individuals with motor impairments. However, existing BCI-Robot systems face major limitations: electroencephalography (EEG) signals are noisy and unstable, target selection is often predefined and inflexible, and most studies remain restricted to simulation without closed-loop validation. These issues hinder real-world deployment in assistive scenarios. To address them, we propose a closed-loop BCI-AR-Robot system that integrates motor imagery (MI)-based EEG decoding, augmented reality (AR) neurofeedback, and robotic grasping for zero-touch operation. A 14-channel EEG headset enabled individualized MI calibration, a smartphone-based AR interface supported multi-target navigation with direction-congruent feedback to enhance stability, and the robotic arm combined decision outputs with vision-based pose estimation for autonomous grasping. Experiments are conducted to validate the framework: MI training achieved 93.1 percent accuracy with an average information transfer rate (ITR) of 14.8 bit/min; AR neurofeedback significantly improved sustained control (SCI = 0.210) and achieved the highest ITR (21.3 bit/min) compared with static, sham, and no-AR baselines; and closed-loop grasping achieved a 97.2 percent success rate with good efficiency and strong user-reported control. These results show that AR feedback substantially stabilizes EEG-based control and that the proposed framework enables robust zero-touch grasping, advancing assistive robotic applications and future modes of human-robot interaction.