LLM Trainer: Automated Robotic Data Generating via Demonstration Augmentation using LLMs

作者: Abraham George, Amir Barati Farimani

分类: cs.RO

发布日期: 2025-09-24

备注: 9 pages, 5 figures, 4 tables. Submitted to ICRA 2026

💡 一句话要点

LLM Trainer:利用LLM增强的自动化机器人数据生成,用于模仿学习。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 机器人模仿学习 大型语言模型 数据增强 自动化数据生成 关键帧提取

📋 核心要点

- 现有机器人模仿学习依赖大量人工标注数据,成本高昂且泛化性差,难以适应新场景。

- LLM Trainer利用LLM的世界知识,将少量人工演示转化为大量机器人训练数据,降低数据收集成本。

- 实验表明,该方法在多种任务上优于专家设计的基线,并在Franka Emika Panda机器人上验证了硬件可行性。

📝 摘要(中文)

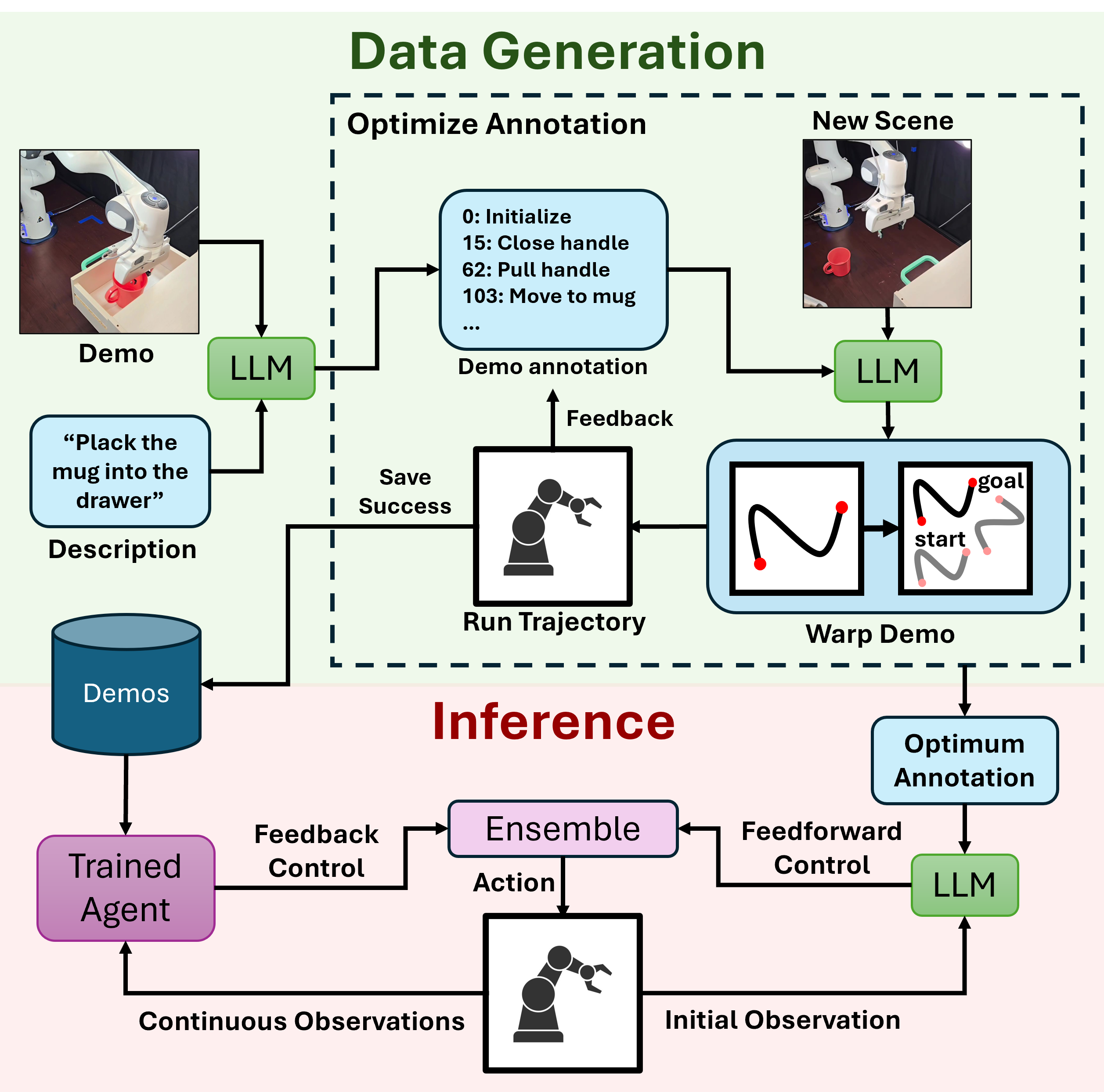

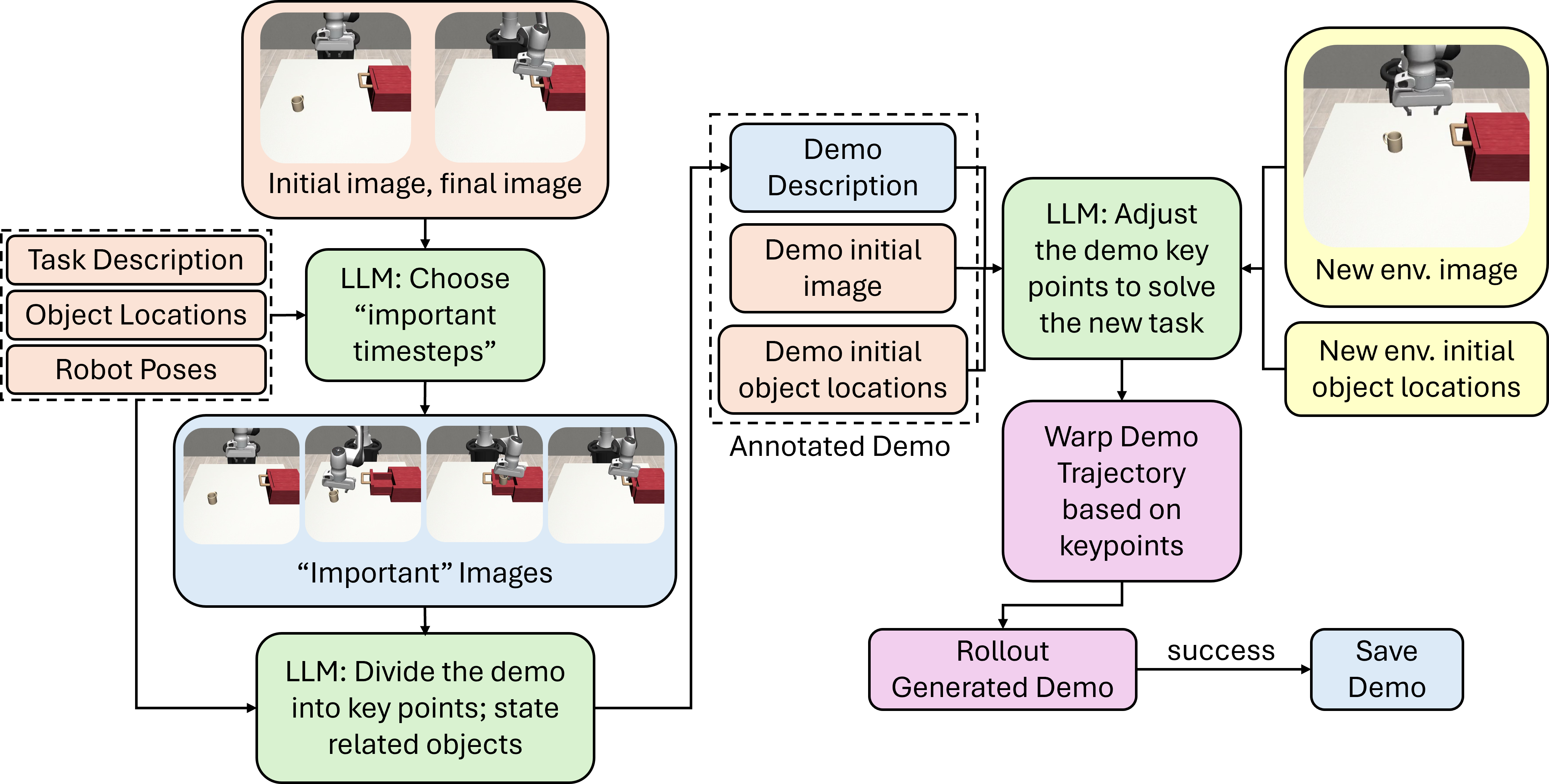

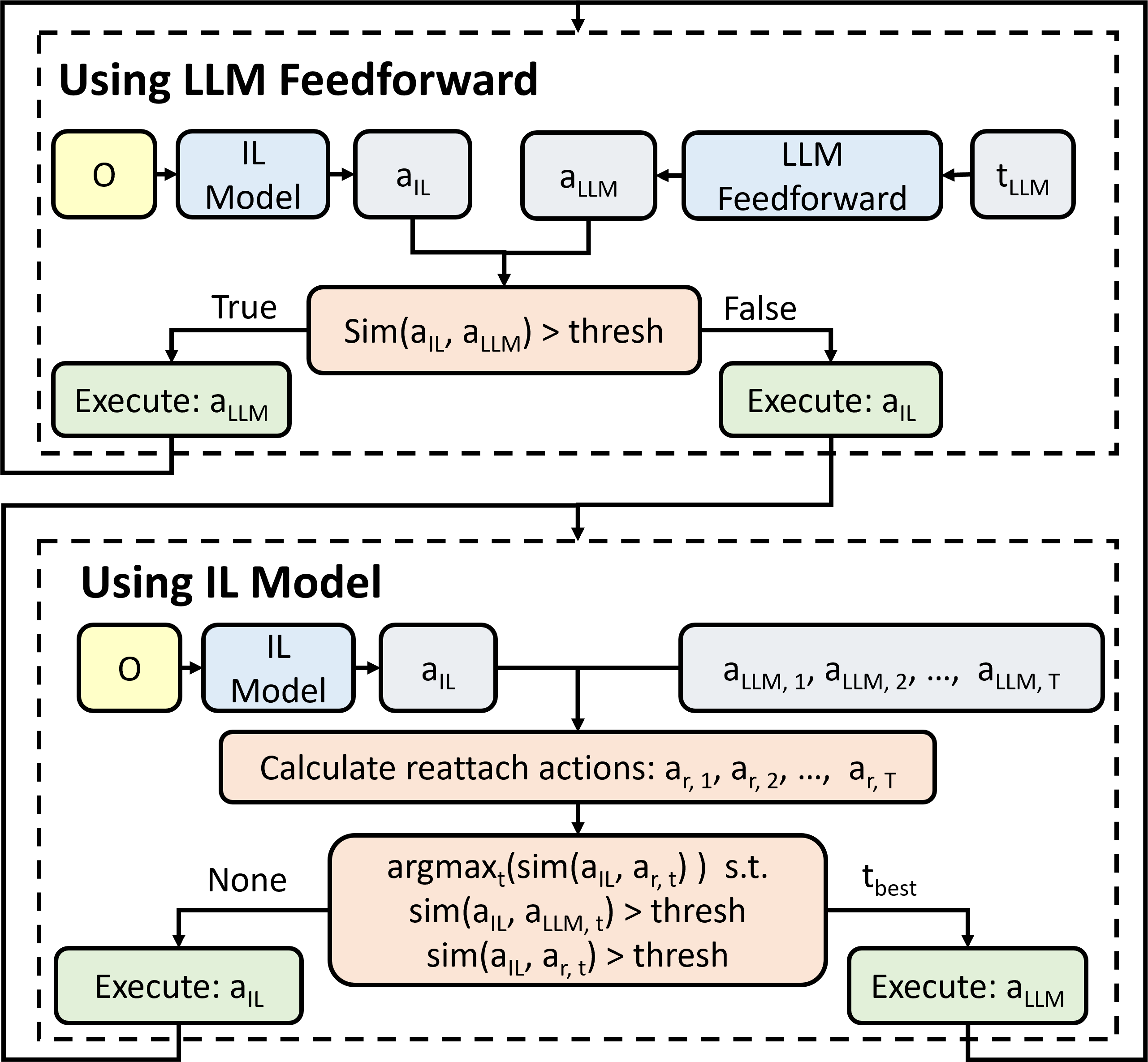

本文提出LLM Trainer,一个全自动化的流程,利用大型语言模型(LLM)的世界知识,将少量的人工演示(甚至只有一个)转化为用于模仿学习的大型机器人数据集。该方法将演示生成分解为两个步骤:(1)离线演示标注,提取关键帧、显著物体和姿势-物体关系;(2)在线关键姿势重定向,根据初始观察将这些关键帧适应到新场景。利用这些修改后的关键点,系统扭曲原始演示以生成新的轨迹,然后执行该轨迹,如果成功,则保存生成的演示。由于标注可以在不同场景中重复使用,我们使用Thompson采样来优化标注,从而显著提高生成成功率。我们在各种任务上评估了该方法,发现我们的数据标注方法始终优于专家设计的基线。我们进一步展示了一个集成策略,该策略将优化的LLM前馈计划与学习的反馈模仿学习控制器相结合。最后,我们在Franka Emika Panda机器人上展示了硬件可行性。

🔬 方法详解

问题定义:机器人模仿学习需要大量高质量的训练数据,而人工标注成本高昂,且难以泛化到新的场景。现有的数据增强方法通常依赖于专家知识或手工设计的规则,难以充分利用环境信息和任务约束。因此,如何利用少量的人工演示,自动生成大量适用于模仿学习的机器人数据,是一个亟待解决的问题。

核心思路:LLM Trainer的核心思路是利用大型语言模型(LLM)的世界知识,将少量的人工演示进行分解和重组,从而生成大量适用于模仿学习的机器人数据。具体来说,该方法首先利用LLM对人工演示进行标注,提取关键帧、显著物体和姿势-物体关系。然后,根据新的场景信息,对这些标注进行重定向和调整,生成新的轨迹。最后,通过执行这些轨迹,生成新的演示数据。

技术框架:LLM Trainer包含两个主要模块:(1)离线演示标注模块:该模块利用LLM对人工演示进行分析,提取关键帧、显著物体和姿势-物体关系。这些标注包含了任务的关键信息,可以用于后续的轨迹生成。(2)在线关键姿势重定向模块:该模块根据新的场景信息,对离线标注进行调整,生成新的轨迹。具体来说,该模块首先根据初始观察,确定新的场景中物体的位置和姿态。然后,利用这些信息,对离线标注中的关键帧进行重定向,生成新的关键姿势。最后,利用这些关键姿势,生成新的轨迹。

关键创新:LLM Trainer的关键创新在于利用LLM的世界知识,实现了自动化机器人数据生成。与传统的数据增强方法相比,LLM Trainer无需人工设计规则或专家知识,可以自动地根据场景信息生成新的数据。此外,LLM Trainer还采用了Thompson采样来优化标注,从而显著提高了生成成功率。

关键设计:在离线演示标注模块中,使用了预训练的LLM模型,并针对机器人任务进行了微调。在在线关键姿势重定向模块中,使用了逆运动学算法来计算机器人的关节角度。此外,还设计了一个成功率评估器,用于判断生成的轨迹是否成功。如果轨迹执行成功,则将生成的演示数据保存到数据集中。

🖼️ 关键图片

📊 实验亮点

实验结果表明,LLM Trainer在多种任务上优于专家设计的基线。例如,在物体抓取任务中,LLM Trainer的成功率比专家设计的基线提高了15%。此外,通过Thompson采样优化标注,生成成功率提高了20%。在Franka Emika Panda机器人上的硬件实验验证了该方法的可行性。

🎯 应用场景

LLM Trainer可应用于各种机器人模仿学习任务,例如物体抓取、装配、导航等。该方法可以显著降低数据收集成本,提高机器人学习效率和泛化能力。未来,该方法可以扩展到更复杂的任务和环境,例如多机器人协作、人机交互等。

📄 摘要(原文)

We present LLM Trainer, a fully automated pipeline that leverages the world knowledge of Large Language Models (LLMs) to transform a small number of human demonstrations (as few as one) into a large robot dataset for imitation learning. Our approach decomposes demonstration generation into two steps: (1) offline demonstration annotation that extracts keyframes, salient objects, and pose-object relations; and (2) online keypose retargeting that adapts those keyframes to a new scene, given an initial observation. Using these modified keypoints, our system warps the original demonstration to generate a new trajectory, which is then executed, and the resulting demo, if successful, is saved. Because the annotation is reusable across scenes, we use Thompson sampling to optimize the annotation, significantly improving generation success rate. We evaluate our method on a range of tasks, and find that our data annotation method consistently outperforms expert-engineered baselines. We further show an ensemble policy that combines the optimized LLM feed-forward plan with a learned feedback imitation learning controller. Finally, we demonstrate hardware feasibility on a Franka Emika Panda robot. For additional materials and demonstration videos, please see the project website: https://sites.google.com/andrew.cmu.edu/llm-trainer