EgoBridge: Domain Adaptation for Generalizable Imitation from Egocentric Human Data

作者: Ryan Punamiya, Dhruv Patel, Patcharapong Aphiwetsa, Pranav Kuppili, Lawrence Y. Zhu, Simar Kareer, Judy Hoffman, Danfei Xu

分类: cs.RO, cs.CV, cs.LG

发布日期: 2025-09-23

备注: Accepted at 39th Conference on Neural Information Processing Systems (NeurIPS 2025) and Oral at Conference on Robot Learning (CoRL 2025)

💡 一句话要点

EgoBridge:利用领域自适应实现从第一视角人类数据中泛化模仿学习

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱六:视频提取与匹配 (Video Extraction) 支柱七:动作重定向 (Motion Retargeting)

关键词: 模仿学习 领域自适应 机器人操作 第一视角数据 最优传输

📋 核心要点

- 现有模仿学习方法难以弥合人类与机器人之间在视觉、传感器和运动学上的领域差异,限制了从人类数据中学习策略的泛化能力。

- EgoBridge通过协同训练框架,利用领域自适应对齐人类和机器人的策略潜在空间,从而学习到领域不变且动作相关的观测表示。

- 实验表明,EgoBridge在真实世界的操作任务中显著提升了策略成功率,并且能够泛化到仅在人类数据中出现的新场景和任务。

📝 摘要(中文)

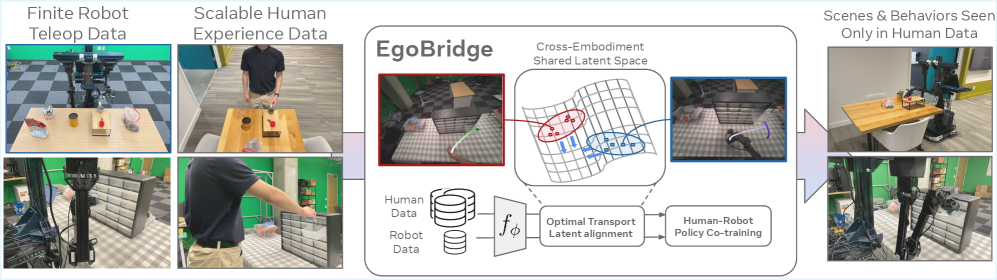

第一视角的人类经验数据为扩展机器人操作的端到端模仿学习提供了丰富的资源。然而,人类和机器人之间在视觉外观、传感器模态和运动学方面的显著领域差距阻碍了知识转移。本文提出了EgoBridge,一个统一的协同训练框架,它使用领域自适应显式地对齐人类和机器人数据之间的策略潜在空间。通过基于最优传输(OT)的联合策略潜在特征和动作的差异度量,我们学习到的观测表示不仅在人类和机器人领域之间对齐,而且保留了对策略学习至关重要的动作相关信息。在三个真实世界的单臂和双臂操作任务中,EgoBridge比人类增强的跨具身基线实现了44%的显著绝对策略成功率提升。EgoBridge还可以推广到仅在人类数据中出现的新对象、场景和任务,而基线方法完全失败。

🔬 方法详解

问题定义:论文旨在解决如何利用第一视角人类数据进行机器人模仿学习的问题。现有方法由于人类和机器人之间存在显著的领域差异(例如视觉外观、传感器模态、运动学),导致直接从人类数据训练的策略难以泛化到机器人上,性能显著下降。现有方法无法有效对齐不同领域的数据,导致策略学习效果不佳。

核心思路:论文的核心思路是通过领域自适应技术,显式地对齐人类和机器人的策略潜在空间。通过学习领域不变的观测表示,使得策略能够更好地从人类数据泛化到机器人上。关键在于保留动作相关信息,避免领域对齐过程中信息丢失。

技术框架:EgoBridge是一个协同训练框架,包含以下主要模块:1) 观测编码器:将人类和机器人的观测数据编码到潜在空间;2) 策略网络:基于潜在表示生成动作;3) 领域判别器:用于区分人类和机器人数据,并指导观测编码器进行领域对齐;4) 最优传输(OT)模块:用于度量人类和机器人数据在策略潜在特征和动作上的差异,并作为损失函数的一部分。整体流程是,首先使用人类和机器人数据训练观测编码器和策略网络,然后使用领域判别器和OT损失函数进行领域自适应训练,最终得到一个能够泛化到机器人上的策略。

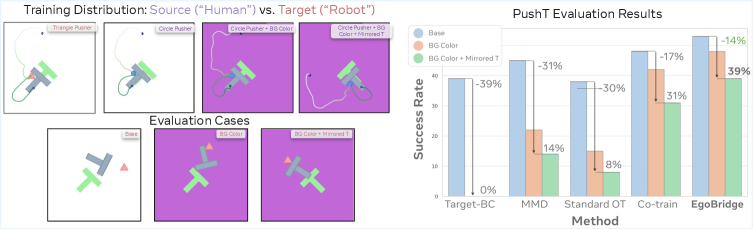

关键创新:论文的关键创新在于使用最优传输(OT)来度量人类和机器人数据在策略潜在特征和动作上的差异。与传统的领域自适应方法(例如对抗训练)相比,OT能够更精确地度量分布之间的距离,从而更好地对齐策略潜在空间。此外,通过联合优化观测编码器、策略网络和领域判别器,EgoBridge能够学习到领域不变且动作相关的观测表示。

关键设计:论文的关键设计包括:1) 使用ResNet-18作为观测编码器;2) 使用多层感知机(MLP)作为策略网络;3) 使用梯度反转层(GRL)进行对抗训练;4) 使用Sinkhorn算法计算最优传输距离;5) 使用加权损失函数,平衡领域对齐损失和策略学习损失。具体参数设置未知,可能在补充材料中。

🖼️ 关键图片

📊 实验亮点

EgoBridge在三个真实世界的单臂和双臂操作任务中,比人类增强的跨具身基线实现了44%的显著绝对策略成功率提升。更重要的是,EgoBridge能够泛化到仅在人类数据中出现的新对象、场景和任务,而基线方法完全失败。这些结果表明,EgoBridge能够有效地利用人类数据进行机器人模仿学习,并具有良好的泛化能力。

🎯 应用场景

EgoBridge具有广泛的应用前景,例如可以用于训练机器人执行各种复杂的操作任务,如家庭服务、工业自动化、医疗辅助等。通过利用大量的人类演示数据,可以降低机器人编程的成本和难度,提高机器人的智能化水平。该研究还可以促进人机协作的发展,使机器人能够更好地理解人类的意图并与之协同工作。

📄 摘要(原文)

Egocentric human experience data presents a vast resource for scaling up end-to-end imitation learning for robotic manipulation. However, significant domain gaps in visual appearance, sensor modalities, and kinematics between human and robot impede knowledge transfer. This paper presents EgoBridge, a unified co-training framework that explicitly aligns the policy latent spaces between human and robot data using domain adaptation. Through a measure of discrepancy on the joint policy latent features and actions based on Optimal Transport (OT), we learn observation representations that not only align between the human and robot domain but also preserve the action-relevant information critical for policy learning. EgoBridge achieves a significant absolute policy success rate improvement by 44% over human-augmented cross-embodiment baselines in three real-world single-arm and bimanual manipulation tasks. EgoBridge also generalizes to new objects, scenes, and tasks seen only in human data, where baselines fail entirely. Videos and additional information can be found at https://ego-bridge.github.io