A Bimanual Gesture Interface for ROS-Based Mobile Manipulators Using TinyML and Sensor Fusion

作者: Najeeb Ahmed Bhuiyan, M. Nasimul Huq, Sakib H. Chowdhury, Rahul Mangharam

分类: cs.RO

发布日期: 2025-09-23

备注: 12 pages, 11 figures

💡 一句话要点

提出基于TinyML和传感器融合的双手动势接口,用于ROS移动机械臂控制

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 双手动势控制 TinyML 传感器融合 ROS 移动机械臂 人机交互 手势识别

📋 核心要点

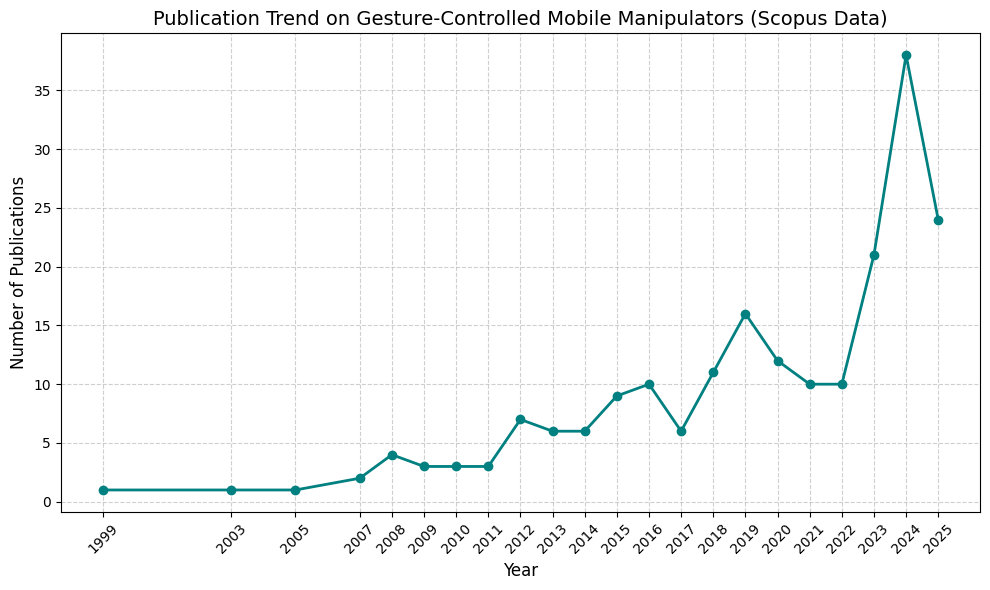

- 移动机械臂的手势控制面临可靠性、效率和直观性方面的挑战,现有方法难以兼顾。

- 论文提出一种双手动势接口,融合TinyML、频谱分析和传感器融合,实现高效直观的控制。

- 该系统在ROS框架下实现,支持同步导航和操作,提升了人机交互的效率和协调性。

📝 摘要(中文)

本文提出了一种双手动势接口,集成了TinyML、频谱分析和传感器融合技术,并在ROS框架下运行,旨在解决移动机械臂手势控制中存在的可靠性、效率和直观性问题。该系统利用左手的倾斜和手指弯曲(通过加速度计和弯曲传感器捕获)进行移动底座导航,同时对右手IMU信号进行频谱分析,并通过轻量级神经网络进行分类。这种流程实现了基于TinyML的手势识别,从而控制一个7自由度的Kinova Gen3机械臂。通过支持同步导航和操作,该框架提高了效率和协调性,优于传统的顺序方法。主要贡献包括双手动势控制架构、实时低功耗手势识别、鲁棒的多模态传感器融合以及可扩展的基于ROS的实现。该方法推进了工业自动化、辅助机器人和危险环境中的人机交互(HRI),提供了一种经济高效的开源解决方案,具有强大的实际部署和进一步优化潜力。

🔬 方法详解

问题定义:现有的移动机械臂手势控制方法在可靠性、效率和直观性方面存在不足。尤其是在复杂环境中,单手控制或顺序控制方式难以满足实时性和协调性的要求。此外,传统方法计算量大,难以在低功耗设备上实现,限制了其在资源受限场景中的应用。

核心思路:论文的核心思路是利用双手的协同操作,分别控制移动底座和机械臂,从而提高控制效率和直观性。通过TinyML技术,将复杂的机器学习模型部署到低功耗设备上,实现实时手势识别。同时,采用传感器融合技术,结合多种传感器信息,提高手势识别的鲁棒性。

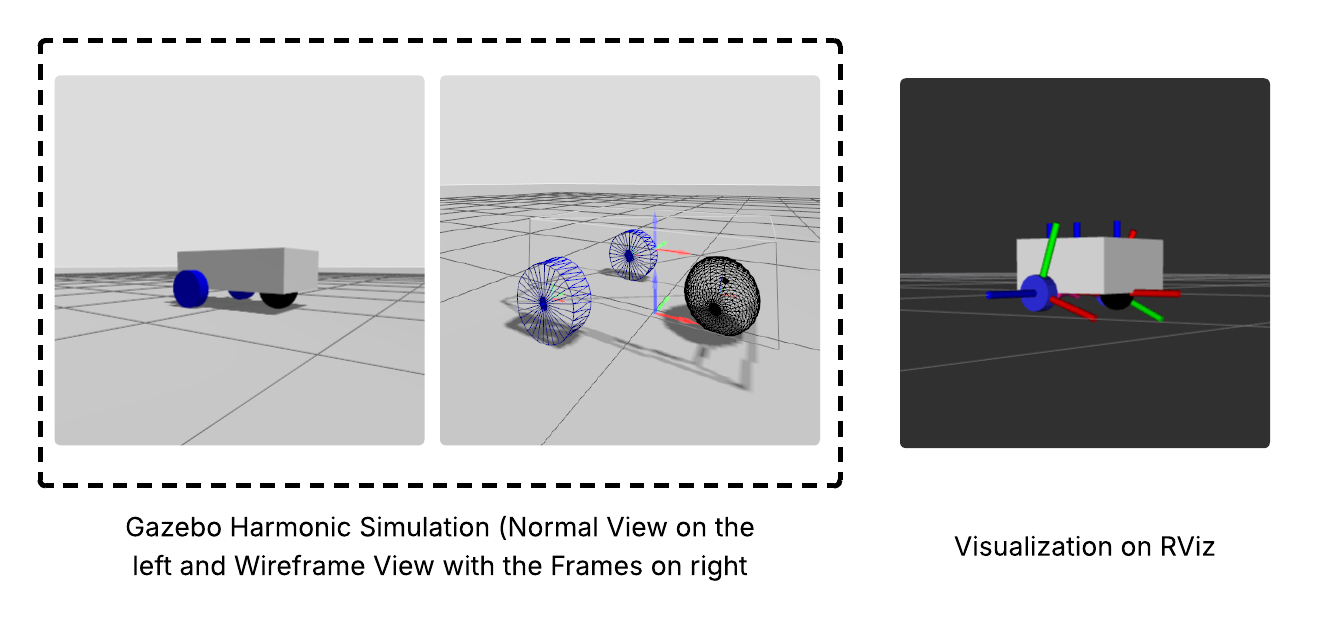

技术框架:整体框架包含三个主要模块:1) 左手控制模块,使用加速度计和弯曲传感器捕获左手的倾斜和手指弯曲信息,用于控制移动底座的导航;2) 右手控制模块,使用IMU捕获右手的运动信息,通过频谱分析和TinyML模型进行手势识别,用于控制机械臂的操作;3) ROS集成模块,将左右手控制模块的信息融合,并通过ROS框架控制移动机械臂。

关键创新:该论文的关键创新在于:1) 提出了双手动势控制架构,实现了同步导航和操作;2) 采用了TinyML技术,在低功耗设备上实现了实时手势识别;3) 实现了鲁棒的多模态传感器融合,提高了手势识别的准确性。

关键设计:右手IMU信号的处理流程包括:首先进行频谱分析,提取运动特征;然后,使用轻量级神经网络(具体结构未知)进行手势分类。该网络经过TinyML优化,可以在低功耗设备上运行。损失函数和训练细节未知。左手控制模块使用简单的阈值判断和映射关系,将传感器数据转换为移动底座的控制指令。传感器融合的具体算法未知。

🖼️ 关键图片

📊 实验亮点

论文展示了在Kinova Gen3机械臂上的实验结果,验证了双手动势接口的有效性。虽然具体的性能数据(如手势识别准确率、控制延迟等)未在摘要中明确给出,但强调了该系统能够实现实时、低功耗的手势识别,并支持同步导航和操作,从而提高了控制效率和协调性。与传统的顺序控制方法相比,该方法在效率方面具有显著优势。

🎯 应用场景

该研究成果可应用于工业自动化、辅助机器人和危险环境等领域。在工业自动化中,操作人员可以通过手势直观地控制机械臂进行装配、搬运等任务。在辅助机器人领域,可以帮助残疾人或老年人完成日常生活中的任务。在危险环境中,可以远程控制机器人进行探测、救援等工作,降低人员风险。未来,该技术有望进一步推广到医疗、教育等领域。

📄 摘要(原文)

Gesture-based control for mobile manipulators faces persistent challenges in reliability, efficiency, and intuitiveness. This paper presents a dual-hand gesture interface that integrates TinyML, spectral analysis, and sensor fusion within a ROS framework to address these limitations. The system uses left-hand tilt and finger flexion, captured using accelerometer and flex sensors, for mobile base navigation, while right-hand IMU signals are processed through spectral analysis and classified by a lightweight neural network. This pipeline enables TinyML-based gesture recognition to control a 7-DOF Kinova Gen3 manipulator. By supporting simultaneous navigation and manipulation, the framework improves efficiency and coordination compared to sequential methods. Key contributions include a bimanual control architecture, real-time low-power gesture recognition, robust multimodal sensor fusion, and a scalable ROS-based implementation. The proposed approach advances Human-Robot Interaction (HRI) for industrial automation, assistive robotics, and hazardous environments, offering a cost-effective, open-source solution with strong potential for real-world deployment and further optimization.