MagiClaw: A Dual-Use, Vision-Based Soft Gripper for Bridging the Human Demonstration to Robotic Deployment Gap

作者: Tianyu Wu, Xudong Han, Haoran Sun, Zishang Zhang, Bangchao Huang, Chaoyang Song, Fang Wan

分类: cs.RO

发布日期: 2025-09-23

备注: 8 pages, 4 figures, accepted to Data@CoRL2025 Workshop

💡 一句话要点

MagiClaw:一种双用途、基于视觉的软爪,弥合人类演示到机器人部署的差距

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 机器人操作 软体机器人 视觉伺服 多模态感知 人机协作

📋 核心要点

- 现有方法难以将人类操作技能迁移到机器人,主要瓶颈在于感知和形态上的差异造成的“领域差距”。

- MagiClaw的核心思想是设计一种既能用于人类演示数据采集,又能作为机器人末端执行器的通用工具,从而消除硬件差异。

- 该系统集成了软体手指、嵌入式摄像头、iPhone等多模态传感器,并通过定制iOS应用实现数据同步和控制,加速策略学习。

📝 摘要(中文)

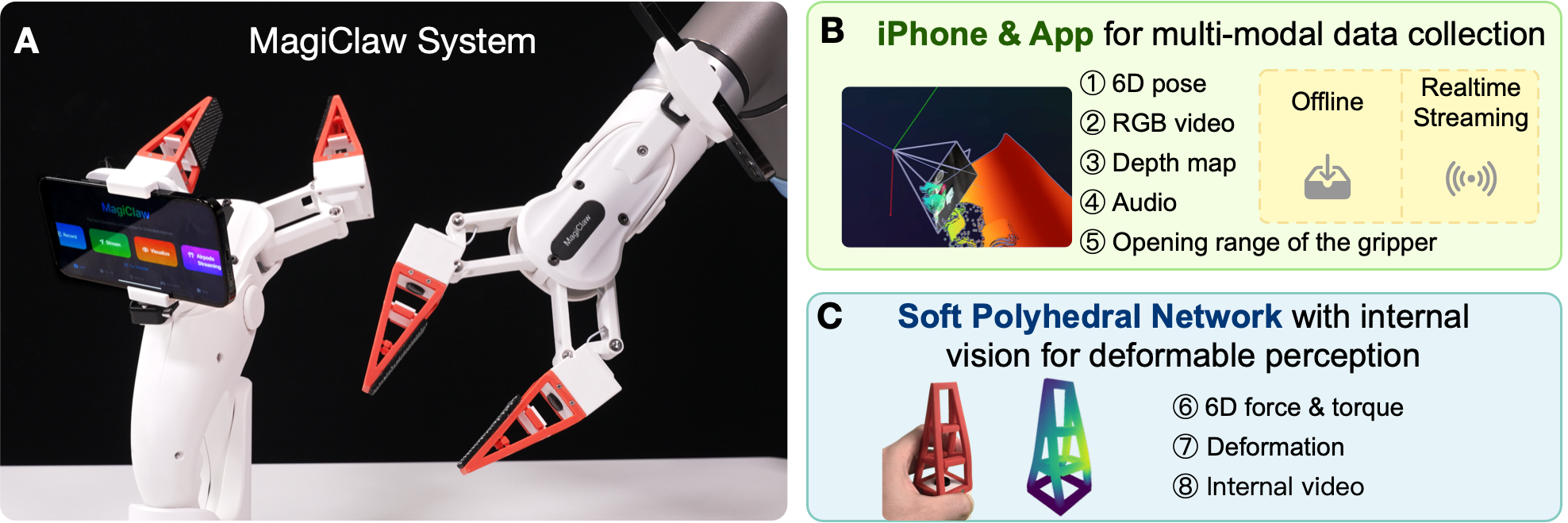

本文介绍了一种名为MagiClaw的多功能双指末端执行器,旨在弥合人类演示到机器人执行之间在感知和形态上的“领域差距”。MagiClaw可互换地用作直观数据收集的手持工具和策略部署的机器人末端执行器,从而确保硬件一致性和可靠性。每个手指都包含一个带有嵌入式摄像头的软多面体网络(SPN),从而能够基于视觉估计6自由度的力和接触变形。这种本体感受数据与来自集成iPhone的外部环境感知数据融合,iPhone提供6D姿势、RGB视频和基于LiDAR的深度图。通过定制的iOS应用程序,MagiClaw流式传输同步的多模态数据,用于实时遥操作、离线策略学习以及通过混合现实界面进行沉浸式控制。我们展示了这种统一的系统架构如何降低收集高保真、富接触数据集的门槛,并加速通用操作策略的开发。

🔬 方法详解

问题定义:现有方法在将人类演示的操控技能迁移到机器人执行时,面临着严重的“领域差距”问题。这种差距主要体现在两个方面:一是人类和机器人之间的形态差异,导致人类的操控方式难以直接应用于机器人;二是感知方式的差异,人类依靠视觉、触觉等多种感觉进行操作,而机器人通常依赖于单一的传感器数据,难以准确感知环境和自身状态。这些问题导致机器人难以学习到通用且鲁棒的操作策略。

核心思路:MagiClaw的核心思路是设计一种双用途的末端执行器,它既可以作为人类的手持工具进行数据采集,又可以作为机器人的末端执行器进行策略部署。通过这种方式,可以消除硬件形态上的差异,保证数据采集和策略执行的一致性。同时,MagiClaw集成了多种传感器,包括嵌入式摄像头、iPhone等,可以提供多模态的感知信息,从而更全面地了解环境和自身状态。

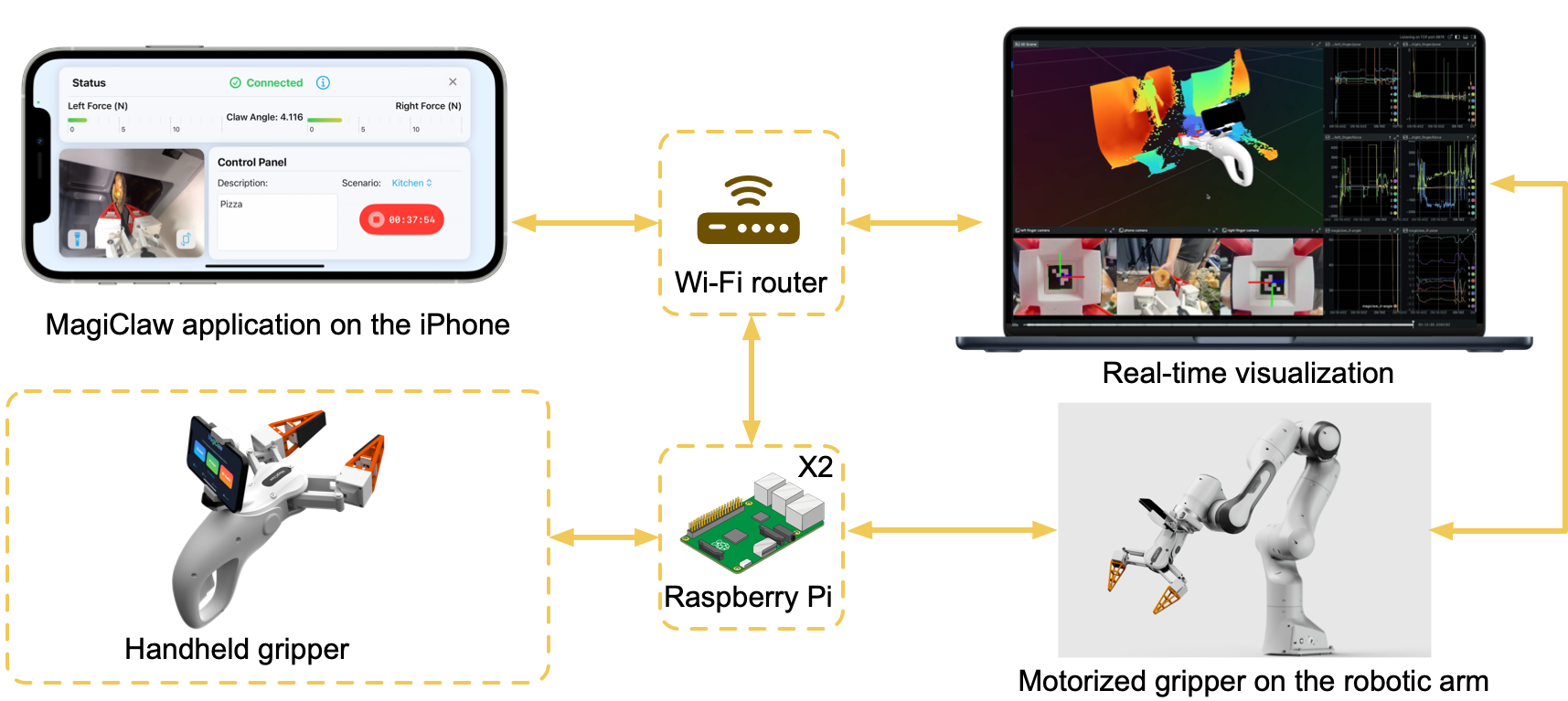

技术框架:MagiClaw系统的整体架构包括以下几个主要模块:1) MagiClaw末端执行器:包含两个带有嵌入式摄像头的软体手指;2) iPhone:用于提供6D姿势、RGB视频和LiDAR深度图等外部环境感知数据;3) iOS应用程序:用于数据同步、实时遥操作、离线策略学习和混合现实控制;4) 数据处理和策略学习模块:用于融合多模态数据,学习通用的操作策略。整个流程包括:人类使用MagiClaw进行演示数据采集 -> iOS应用程序同步多模态数据 -> 数据处理和策略学习模块学习操作策略 -> 机器人使用MagiClaw执行学习到的策略。

关键创新:MagiClaw最重要的技术创新点在于其双用途的设计和多模态传感器的集成。双用途设计消除了硬件形态上的差异,保证了数据采集和策略执行的一致性。多模态传感器的集成提供了更全面、更准确的感知信息,有助于机器人更好地理解环境和自身状态。此外,嵌入式摄像头和软体手指的结合,使得MagiClaw能够基于视觉估计6自由度的力和接触变形,这是一种新颖的本体感受感知方式。

关键设计:MagiClaw的关键设计包括:1) 软多面体网络(SPN):用于实现手指的柔性运动和接触感知;2) 嵌入式摄像头:用于提供手指的内部视觉信息,估计力和接触变形;3) iPhone集成:用于提供外部环境感知数据,包括6D姿势、RGB视频和LiDAR深度图;4) iOS应用程序:用于数据同步、实时遥操作和混合现实控制。具体的参数设置、损失函数和网络结构等技术细节在论文中未详细描述,属于未知信息。

🖼️ 关键图片

📊 实验亮点

论文展示了MagiClaw在数据采集和策略学习方面的优势。通过MagiClaw,可以更方便地收集高保真、富接触的数据集,从而加速通用操作策略的开发。具体的性能数据和对比基线在摘要中未提及,属于未知信息。但论文强调,该系统降低了数据采集的门槛,并加速了通用操作策略的开发。

🎯 应用场景

MagiClaw在机器人操作领域具有广泛的应用前景,例如:工业自动化、医疗机器人、家庭服务机器人等。它可以用于执行各种复杂的抓取、装配和操作任务。通过降低数据采集的门槛,MagiClaw可以加速机器人操作策略的开发,并促进机器人技术的普及。未来,MagiClaw有望成为一种通用的机器人操作平台,为各行各业提供智能化的解决方案。

📄 摘要(原文)

The transfer of manipulation skills from human demonstration to robotic execution is often hindered by a "domain gap" in sensing and morphology. This paper introduces MagiClaw, a versatile two-finger end-effector designed to bridge this gap. MagiClaw functions interchangeably as both a handheld tool for intuitive data collection and a robotic end-effector for policy deployment, ensuring hardware consistency and reliability. Each finger incorporates a Soft Polyhedral Network (SPN) with an embedded camera, enabling vision-based estimation of 6-DoF forces and contact deformation. This proprioceptive data is fused with exteroceptive environmental sensing from an integrated iPhone, which provides 6D pose, RGB video, and LiDAR-based depth maps. Through a custom iOS application, MagiClaw streams synchronized, multi-modal data for real-time teleoperation, offline policy learning, and immersive control via mixed-reality interfaces. We demonstrate how this unified system architecture lowers the barrier to collecting high-fidelity, contact-rich datasets and accelerates the development of generalizable manipulation policies. Please refer to the iOS app at https://apps.apple.com/cn/app/magiclaw/id6661033548 for further details.