BiGraspFormer: End-to-End Bimanual Grasp Transformer

作者: Kangmin Kim, Seunghyeok Back, Geonhyup Lee, Sangbeom Lee, Sangjun Noh, Kyoobin Lee

分类: cs.RO

发布日期: 2025-09-23

备注: 8 pages, 5 figures

💡 一句话要点

BiGraspFormer:端到端双臂抓取Transformer,解决复杂物体操作中的协调问题。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 双臂抓取 机器人操作 Transformer 点云处理 单引导双臂 端到端学习 机器人视觉

📋 核心要点

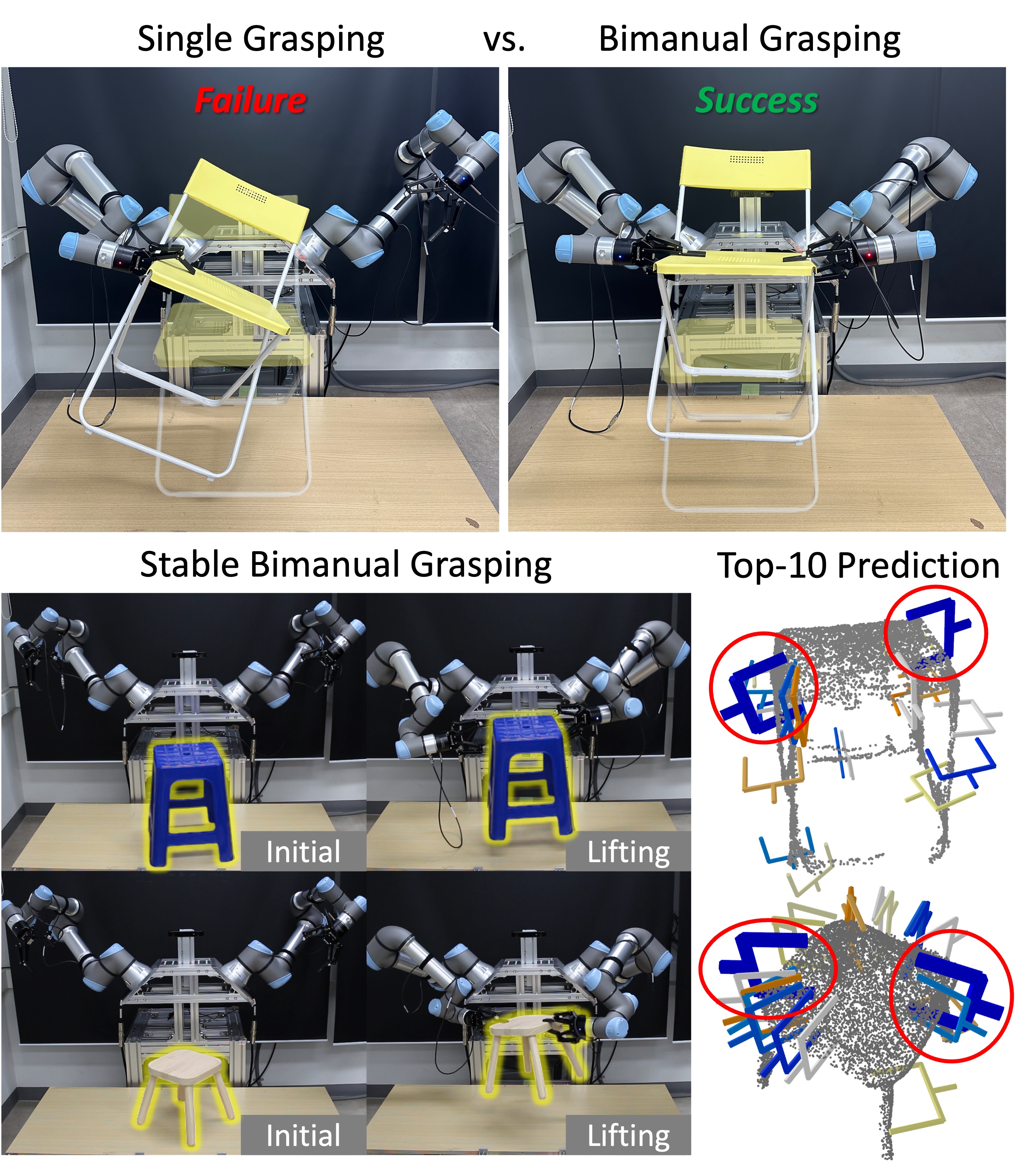

- 现有双臂抓取方法在协调性方面存在不足,容易出现碰撞和力分布不均等问题。

- BiGraspFormer采用单引导双臂(SGB)策略,利用Transformer直接生成协调的双臂抓取。

- 实验结果表明,BiGraspFormer在性能上优于现有方法,并保持了高效的推理速度。

📝 摘要(中文)

双臂抓取对于机器人处理大型和复杂物体至关重要。然而,现有方法要么只关注单臂抓取,要么采用分离的抓取生成和双臂评估阶段,导致协调问题,包括碰撞风险和不平衡的力分布。为了解决这些限制,我们提出了BiGraspFormer,一个统一的端到端Transformer框架,可以直接从物体点云生成协调的双臂抓取。我们的核心思想是单引导双臂(SGB)策略,该策略首先使用Transformer解码器生成多样化的单抓取候选,然后利用其学习到的特征,通过专门的注意力机制来联合预测双臂姿态和质量分数。这种条件策略降低了12自由度搜索空间的复杂性,同时确保了协调的双臂操作。全面的仿真实验和真实世界验证表明,BiGraspFormer始终优于现有方法,同时保持了高效的推理速度(<0.05秒),证实了我们框架的有效性。

🔬 方法详解

问题定义:现有双臂抓取方法通常采用分离的抓取生成和评估流程,导致左右臂之间缺乏有效的协调,容易出现碰撞风险和力分布不平衡的问题。此外,直接搜索12自由度的双臂抓取空间计算量巨大,效率低下。

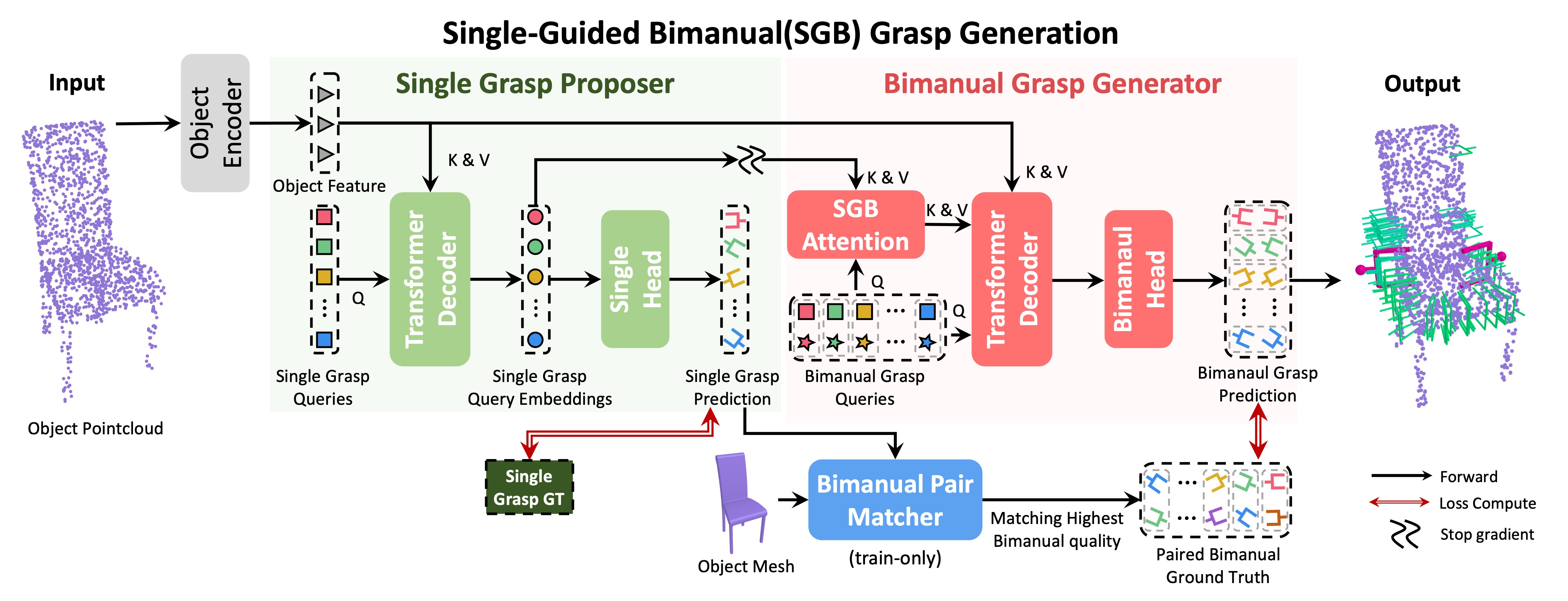

核心思路:BiGraspFormer的核心思路是采用“单引导双臂”(Single-Guided Bimanual, SGB)策略。首先,利用Transformer生成高质量的单臂抓取候选,然后将这些单臂抓取的特征作为引导,通过注意力机制来预测最终的双臂抓取姿态和质量评分。这种方式有效地降低了搜索空间的维度,并保证了双臂抓取的协调性。

技术框架:BiGraspFormer整体是一个端到端的Transformer框架。它主要包含以下几个模块:1) 点云特征提取模块:用于提取输入物体点云的特征表示。2) 单臂抓取候选生成模块:使用Transformer解码器生成多个单臂抓取候选,并学习其特征。3) 双臂抓取预测模块:利用单臂抓取候选的特征,通过注意力机制联合预测双臂的姿态和质量评分。4) 抓取评估模块:根据预测的双臂姿态,评估抓取的质量,例如稳定性、碰撞情况等。

关键创新:BiGraspFormer的关键创新在于其SGB策略,即先生成单臂抓取候选,再利用这些候选引导双臂抓取的预测。这种策略将复杂的12自由度搜索问题分解为更易处理的子问题,显著降低了计算复杂度,并保证了双臂抓取的协调性。此外,端到端的Transformer架构也使得模型能够直接从点云预测双臂抓取,避免了中间步骤的误差累积。

关键设计:在单臂抓取候选生成模块中,使用了Transformer解码器来生成多样化的抓取姿态。在双臂抓取预测模块中,采用了注意力机制来融合单臂抓取候选的特征,并预测最终的双臂姿态。损失函数包括抓取姿态回归损失和抓取质量评分损失。为了平衡左右臂的力分布,可以引入额外的力平衡损失。具体的网络结构和参数设置需要根据实际应用场景进行调整。

🖼️ 关键图片

📊 实验亮点

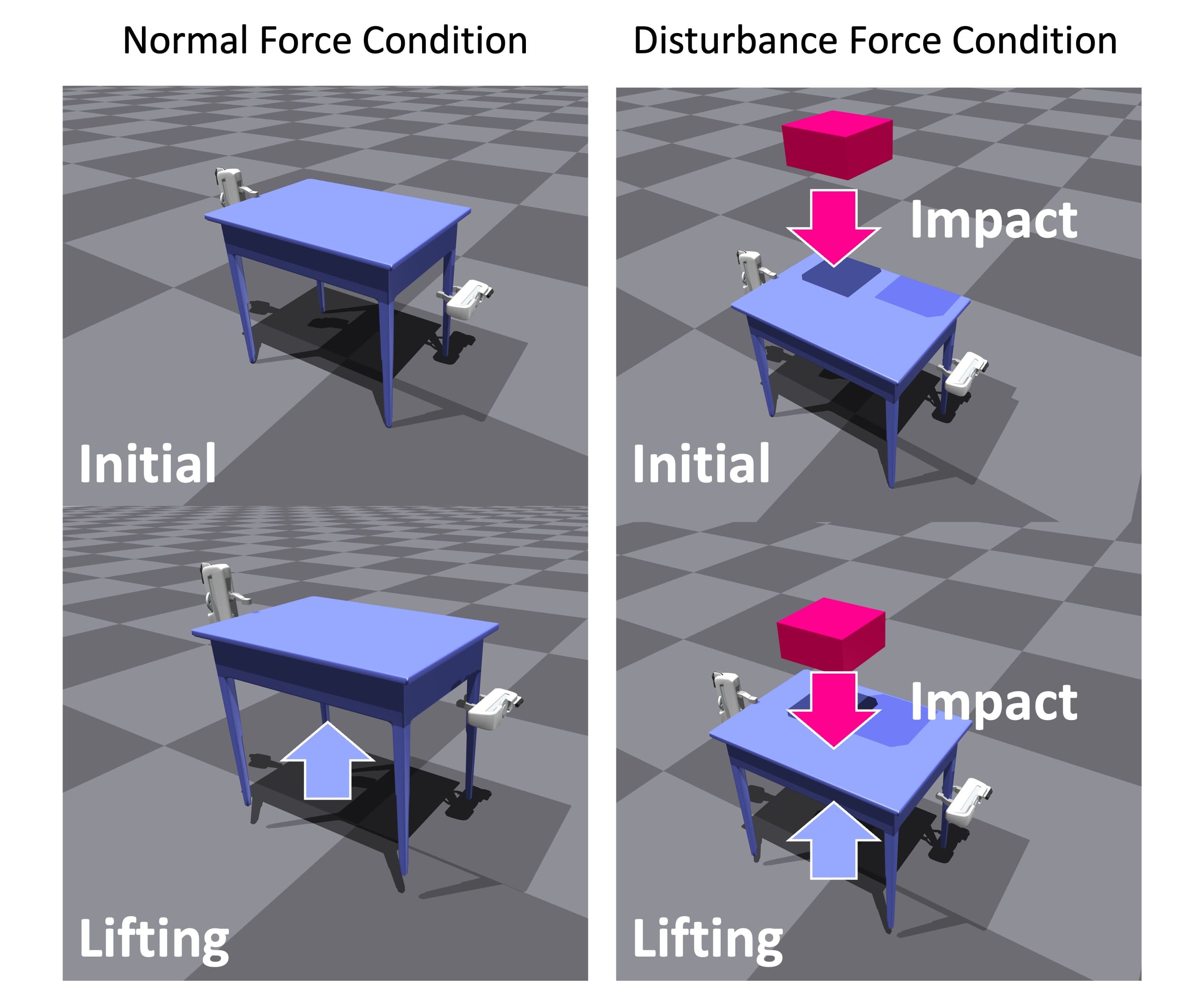

BiGraspFormer在仿真实验和真实世界实验中均表现出色,显著优于现有方法。在仿真实验中,BiGraspFormer的抓取成功率明显高于其他基线方法。更重要的是,BiGraspFormer保持了高效的推理速度,小于0.05秒,使其能够满足实时性要求较高的应用场景。

🎯 应用场景

BiGraspFormer在工业自动化、家庭服务机器人等领域具有广泛的应用前景。例如,它可以用于机器人组装线,实现对复杂零件的双臂抓取和装配;也可以用于家庭服务机器人,帮助老年人或残疾人完成日常物品的取放。该研究的突破将推动机器人操作的智能化和自动化水平。

📄 摘要(原文)

Bimanual grasping is essential for robots to handle large and complex objects. However, existing methods either focus solely on single-arm grasping or employ separate grasp generation and bimanual evaluation stages, leading to coordination problems including collision risks and unbalanced force distribution. To address these limitations, we propose BiGraspFormer, a unified end-to-end transformer framework that directly generates coordinated bimanual grasps from object point clouds. Our key idea is the Single-Guided Bimanual (SGB) strategy, which first generates diverse single grasp candidates using a transformer decoder, then leverages their learned features through specialized attention mechanisms to jointly predict bimanual poses and quality scores. This conditioning strategy reduces the complexity of the 12-DoF search space while ensuring coordinated bimanual manipulation. Comprehensive simulation experiments and real-world validation demonstrate that BiGraspFormer consistently outperforms existing methods while maintaining efficient inference speed (<0.05s), confirming the effectiveness of our framework. Code and supplementary materials are available at https://sites.google.com/bigraspformer