Spectral Signature Mapping from RGB Imagery for Terrain-Aware Navigation

作者: Sarvesh Prajapati, Ananya Trivedi, Nathaniel Hanson, Bruce Maxwell, Taskin Padir

分类: cs.RO

发布日期: 2025-09-23 (更新: 2025-11-28)

备注: 8 pages, 11 figures, accepted to Robotic Computing & Communication

💡 一句话要点

提出RS-Net,利用RGB图像预测光谱特征,实现地形感知导航

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: RGB图像 光谱特征 深度学习 地形感知 机器人导航

📋 核心要点

- 现有基于几何或语义标签的地形分类方法无法区分视觉相似但材料属性不同的表面,限制了户外导航的准确性。

- RS-Net通过深度学习,从易于获取的RGB图像中预测光谱特征,从而推断材料成分,无需昂贵的光谱传感器。

- 该框架将预测的光谱特征用于地形分类和摩擦系数估计,并成功应用于轮式和四足机器人的运动规划和控制。

📝 摘要(中文)

在户外环境中成功导航需要准确预测机器人与地形之间的物理交互。许多现有方法依赖于几何或语义标签来分类可通行表面,但这些标签无法区分视觉上相似但材料属性不同的表面。光谱传感器能够从跨多个波长带测量的表面反射率推断材料成分。尽管光谱传感在机器人技术中越来越受欢迎,但由于需要定制硬件集成、高传感器成本和计算密集型处理流程,其广泛部署仍然受到限制。本文提出了一种名为RGB图像到光谱特征神经网络(RS-Net)的深度神经网络,旨在弥合RGB传感的可访问性与光谱数据提供的丰富材料信息之间的差距。RS-Net从RGB图像块预测光谱特征,然后将其映射到地形标签和摩擦系数。由此产生的地形分类被集成到基于采样的运动规划器中,用于在户外环境中运行的轮式机器人。同样,摩擦估计被纳入基于接触力的模型预测控制(MPC)中,用于在湿滑表面上导航的四足机器人。总的来说,我们的框架在训练期间离线学习任务相关的物理属性,然后在运行时仅依赖于RGB传感。

🔬 方法详解

问题定义:现有户外导航方法依赖几何或语义信息进行地形分类,无法有效区分视觉相似但物理属性不同的表面。光谱传感器虽能提供更丰富的材料信息,但成本高昂且计算复杂,难以广泛应用。因此,需要一种方法,能够利用廉价的RGB图像获取类似光谱信息的材料属性,从而提升地形感知的导航能力。

核心思路:论文的核心思路是训练一个深度神经网络(RS-Net),将RGB图像映射到光谱特征。通过学习RGB图像与光谱特征之间的对应关系,RS-Net能够从普通的RGB图像中预测出类似光谱传感器才能获取的材料信息,从而克服了传统方法对昂贵光谱传感器的依赖。

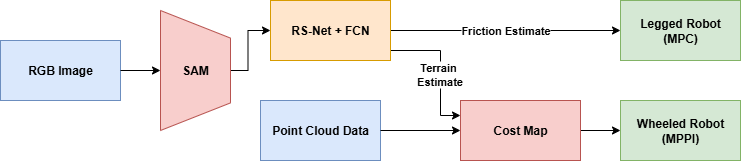

技术框架:整体框架包含以下几个主要阶段:1) 使用RGB相机获取图像;2) 使用RS-Net从RGB图像块中预测光谱特征;3) 将预测的光谱特征映射到地形标签和摩擦系数;4) 将地形分类结果集成到轮式机器人的采样运动规划器中;5) 将摩擦系数估计集成到四足机器人的基于接触力的模型预测控制(MPC)中。

关键创新:该论文的关键创新在于提出了RS-Net,这是一个能够从RGB图像预测光谱特征的深度神经网络。与直接使用RGB图像进行地形分类的方法相比,RS-Net通过预测光谱特征,能够更好地捕捉材料的物理属性,从而提高地形分类的准确性。此外,该方法无需昂贵的光谱传感器,降低了硬件成本。

关键设计:RS-Net的具体网络结构未知(论文中未详细说明)。关键设计可能包括:合适的网络架构(例如,卷积神经网络或Transformer),用于提取RGB图像的特征;损失函数的设计,用于衡量预测光谱特征与真实光谱特征之间的差异;训练数据的选择,需要包含各种地形的RGB图像和对应的光谱数据。此外,将预测的光谱特征映射到地形标签和摩擦系数的具体方法也需要精心设计,例如,可以使用机器学习算法(如支持向量机或随机森林)进行分类和回归。

🖼️ 关键图片

📊 实验亮点

论文通过实验验证了RS-Net的有效性,表明其能够从RGB图像中准确预测光谱特征,并将其成功应用于轮式和四足机器人的运动规划和控制。虽然论文中没有给出具体的性能数据和对比基线,但强调了该方法在无需昂贵光谱传感器的情况下,实现了与使用光谱传感器类似的地形感知能力。

🎯 应用场景

该研究成果可广泛应用于户外机器人导航领域,例如农业机器人、巡检机器人、搜救机器人等。通过利用廉价的RGB相机和RS-Net,机器人可以更好地感知地形,从而实现更安全、更高效的导航。此外,该技术还可以应用于自动驾驶领域,提高车辆对复杂路况的适应能力。未来,该研究有望推动机器人技术在户外环境中的广泛应用。

📄 摘要(原文)

Successful navigation in outdoor environments requires accurate prediction of the physical interactions between the robot and the terrain. Many prior methods rely on geometric or semantic labels to classify traversable surfaces. However, such labels cannot distinguish visually similar surfaces that differ in material properties. Spectral sensors enable inference of material composition from surface reflectance measured across multiple wavelength bands. Although spectral sensing is gaining traction in robotics, widespread deployment remains constrained by the need for custom hardware integration, high sensor costs, and compute-intensive processing pipelines. In this paper, we present the RGB Image to Spectral Signature Neural Network (RS-Net), a deep neural network designed to bridge the gap between the accessibility of RGB sensing and the rich material information provided by spectral data. RS-Net predicts spectral signatures from RGB patches, which we map to terrain labels and friction coefficients. The resulting terrain classifications are integrated into a sampling-based motion planner for a wheeled robot operating in outdoor environments. Likewise, the friction estimates are incorporated into a contact-force-based MPC for a quadruped robot navigating slippery surfaces. Overall, our framework learns the task-relevant physical properties offline during training and thereafter relies solely on RGB sensing at run time.