ManipForce: Force-Guided Policy Learning with Frequency-Aware Representation for Contact-Rich Manipulation

作者: Geonhyup Lee, Yeongjin Lee, Kangmin Kim, Seongju Lee, Sangjun Noh, Seunghyeok Back, Kyoobin Lee

分类: cs.RO

发布日期: 2025-09-23

备注: 9 pages, 9 figures

💡 一句话要点

ManipForce:提出力引导的策略学习方法,用于接触式操作任务

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 接触式操作 力引导策略学习 多模态融合 频率感知 Transformer 模仿学习

📋 核心要点

- 接触式操作任务需要精确控制交互力,但现有模仿学习方法主要依赖于视觉信息,忽略了力觉信息的重要性。

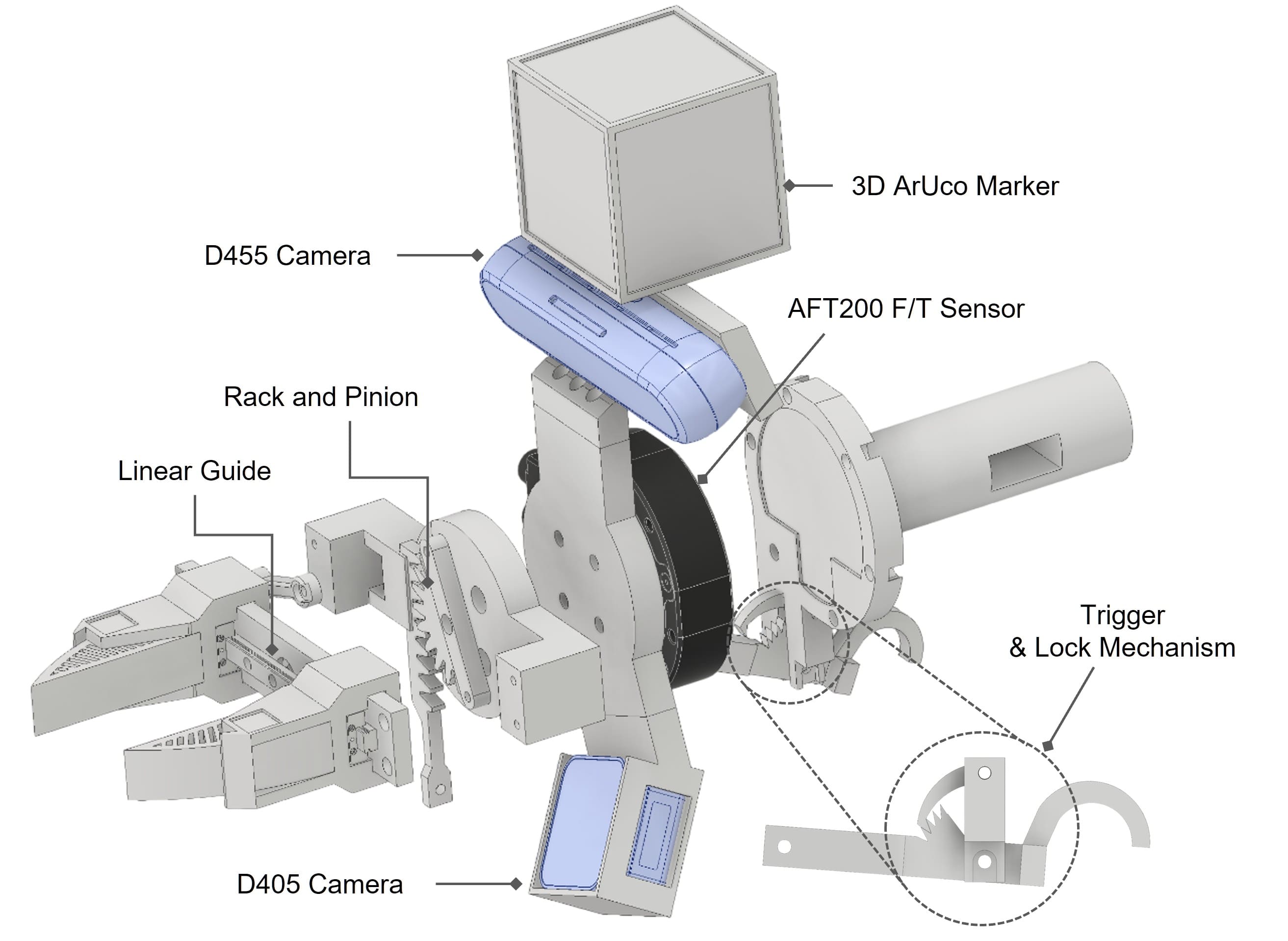

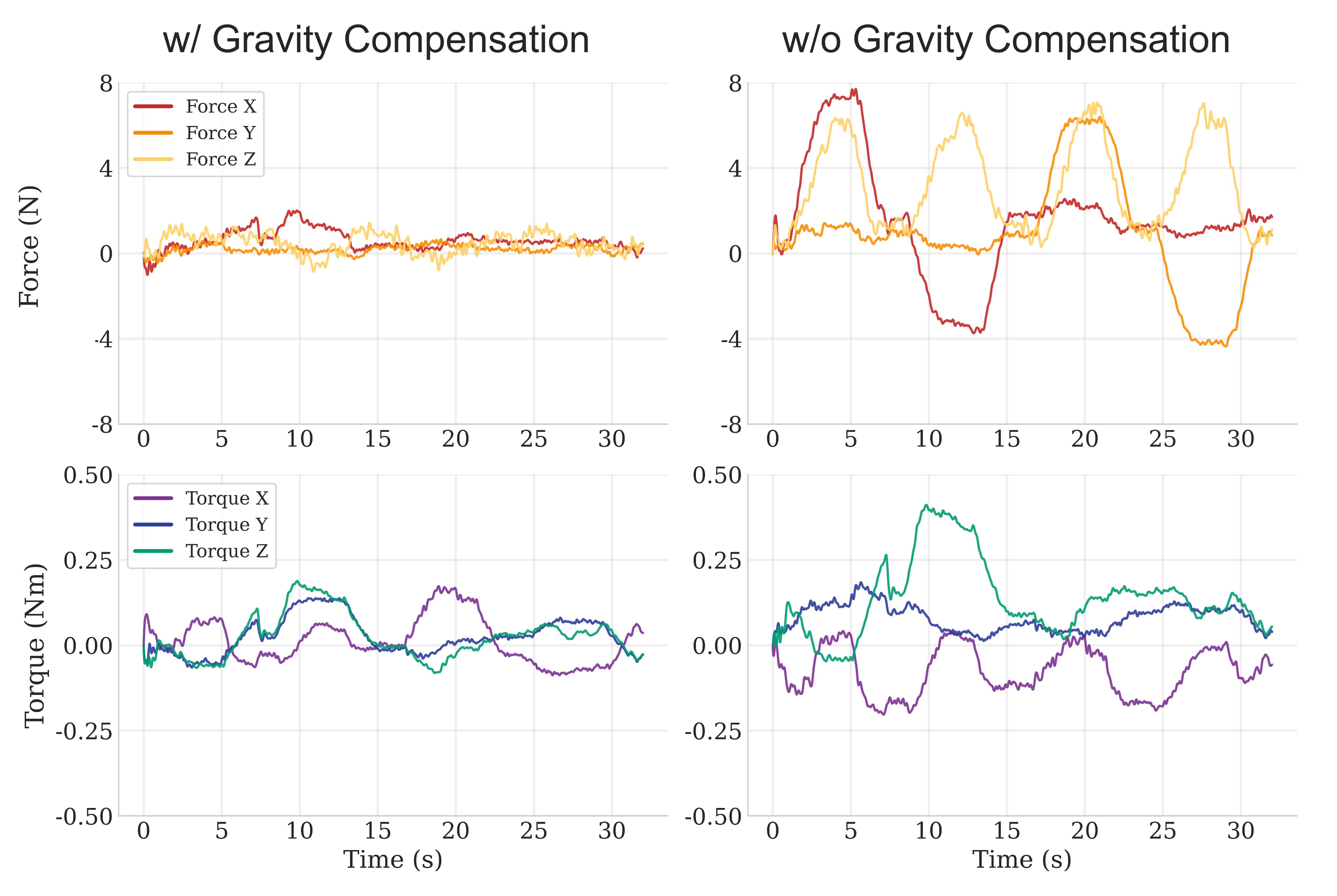

- ManipForce系统采集高频力/扭矩和RGB数据,并提出频率感知多模态Transformer (FMT)进行跨模态融合,学习力引导的策略。

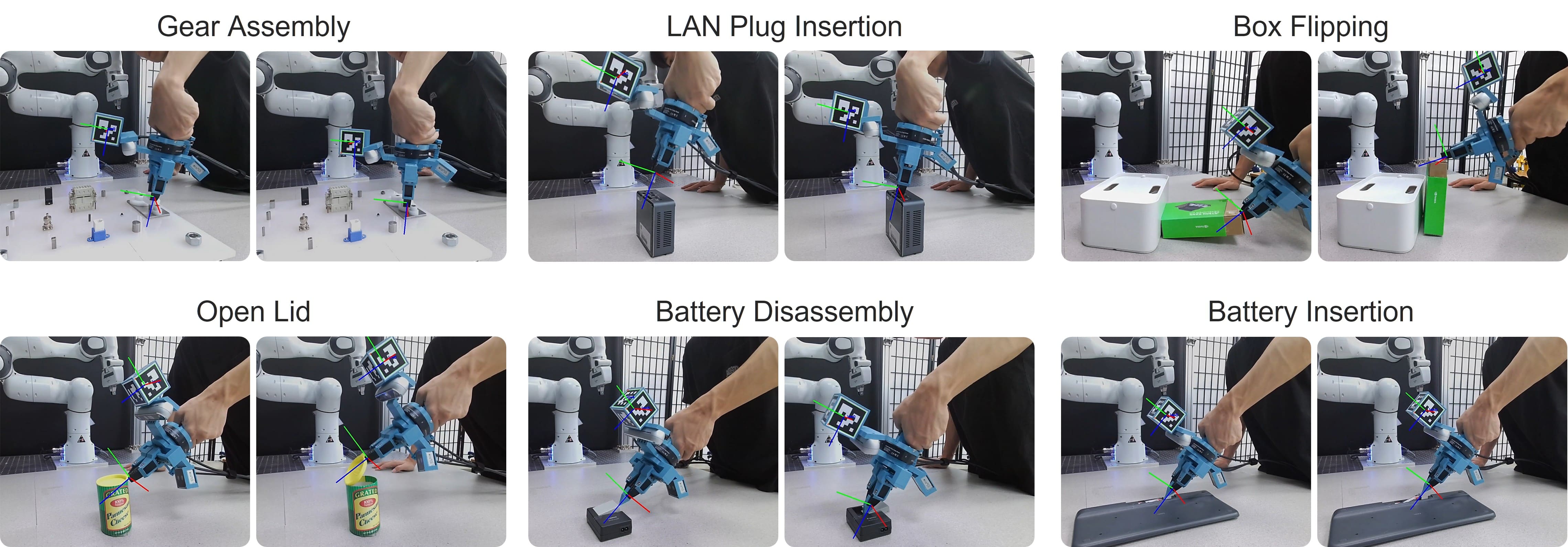

- 在六个真实接触式操作任务中,FMT的平均成功率达到83%,显著优于RGB-only基线,验证了高频力/扭矩数据和跨模态融合的有效性。

📝 摘要(中文)

本文提出ManipForce,一个手持系统,用于在接触式操作的人工示教过程中捕获高频力/扭矩(F/T)和RGB数据。基于这些示教数据,本文引入了频率感知多模态Transformer (FMT)。FMT使用频率和模态感知的嵌入来编码异步RGB和F/T信号,并通过Transformer扩散策略中的双向交叉注意力融合它们。在六个真实世界的接触式操作任务(如齿轮组装、盒子翻转和电池插入)上的大量实验表明,在ManipForce示教数据上训练的FMT实现了稳健的性能,在所有任务中的平均成功率为83%,大大优于仅使用RGB的基线方法。消融实验和采样频率分析进一步证实,结合高频F/T数据和跨模态融合可以提高策略性能,尤其是在需要高精度和稳定接触的任务中。

🔬 方法详解

问题定义:现有接触式操作任务的模仿学习方法主要依赖视觉信息,忽略了力/扭矩信息,导致难以精确控制交互力,影响任务成功率。尤其是在需要高精度和稳定接触的任务中,仅依靠视觉信息难以达到理想效果。

核心思路:本文的核心思路是利用高频力/扭矩信息来引导策略学习。通过设计手持系统ManipForce采集高质量的多模态数据,并提出频率感知多模态Transformer (FMT) 来有效融合视觉和力觉信息,从而学习更精确的控制策略。

技术框架:ManipForce系统用于采集RGB图像和力/扭矩数据。FMT模型是核心,它包含以下几个主要模块:1) 频率和模态感知的嵌入模块,用于将RGB和F/T信号编码成向量表示;2) 双向交叉注意力模块,用于融合不同模态的信息;3) Transformer扩散策略模块,用于生成控制动作。整体流程是:首先使用ManipForce采集数据,然后训练FMT模型,最后使用训练好的模型进行控制。

关键创新:最重要的技术创新点在于频率感知多模态Transformer (FMT) 的设计。FMT能够有效地处理异步的RGB和F/T信号,并利用频率信息来提高表示的质量。与现有方法相比,FMT能够更好地融合视觉和力觉信息,从而学习更鲁棒和精确的控制策略。

关键设计:FMT的关键设计包括:1) 使用傅里叶变换提取F/T信号的频率特征,并将其融入嵌入向量中;2) 使用双向交叉注意力机制来融合RGB和F/T信息,允许模型同时关注视觉和力觉信息;3) 使用Transformer扩散策略来生成控制动作,提高策略的探索能力和鲁棒性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,在六个真实世界的接触式操作任务中,使用ManipForce采集的数据训练的FMT模型,平均成功率达到83%,显著优于RGB-only基线方法。消融实验表明,高频F/T数据和跨模态融合对策略性能有显著提升。例如,在齿轮组装任务中,FMT的成功率比RGB-only基线提高了约20%。

🎯 应用场景

该研究成果可应用于各种需要精确接触控制的机器人操作任务,例如精密装配、医疗手术、以及复杂环境下的物体操作。通过结合视觉和力觉信息,机器人可以更好地理解环境并做出更精确的动作,从而提高自动化水平和工作效率。未来,该技术有望在工业自动化、医疗机器人等领域发挥重要作用。

📄 摘要(原文)

Contact-rich manipulation tasks such as precision assembly require precise control of interaction forces, yet existing imitation learning methods rely mainly on vision-only demonstrations. We propose ManipForce, a handheld system designed to capture high-frequency force-torque (F/T) and RGB data during natural human demonstrations for contact-rich manipulation. Building on these demonstrations, we introduce the Frequency-Aware Multimodal Transformer (FMT). FMT encodes asynchronous RGB and F/T signals using frequency- and modality-aware embeddings and fuses them via bi-directional cross-attention within a transformer diffusion policy. Through extensive experiments on six real-world contact-rich manipulation tasks - such as gear assembly, box flipping, and battery insertion - FMT trained on ManipForce demonstrations achieves robust performance with an average success rate of 83% across all tasks, substantially outperforming RGB-only baselines. Ablation and sampling-frequency analyses further confirm that incorporating high-frequency F/T data and cross-modal integration improves policy performance, especially in tasks demanding high precision and stable contact.