Eva-VLA: Evaluating Vision-Language-Action Models' Robustness Under Real-World Physical Variations

作者: Hanqing Liu, Jiahuan Long, Junqi Wu, Jiacheng Hou, Huili Tang, Tingsong Jiang, Weien Zhou, Wen Yao

分类: cs.RO, cs.AI

发布日期: 2025-09-23

💡 一句话要点

Eva-VLA:评估视觉-语言-动作模型在真实物理变化下的鲁棒性

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱三:空间感知与语义 (Perception & Semantics) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉-语言-动作模型 机器人操作 鲁棒性评估 物理变化 黑盒优化

📋 核心要点

- 现有VLA模型在真实物理变化下的鲁棒性不足,难以应对实际部署中的复杂环境。

- 提出Eva-VLA框架,将离散物理变化转化为连续优化问题,系统评估VLA模型的鲁棒性。

- 实验表明,各种物理变化会导致VLA模型出现高失败率,突显了实验室环境与实际部署之间的差距。

📝 摘要(中文)

视觉-语言-动作(VLA)模型已成为机器人操作的有前景的解决方案,但它们在真实物理变化下的鲁棒性仍未得到充分探索。为了弥补这一差距,我们提出了Eva-VLA,这是第一个统一的框架,通过将离散的物理变化转化为连续的优化问题,系统地评估VLA模型的鲁棒性。然而,全面评估VLA的鲁棒性面临两个关键挑战:(1)如何在保持评估可重复性的同时,系统地表征真实部署中遇到的各种物理变化?(2)如何在不产生过高的真实数据收集成本的情况下,有效地发现最坏情况?为了解决第一个挑战,我们将真实世界的变化分解为三个关键领域:影响空间推理的物体3D变换、挑战视觉感知的照明变化以及扰乱场景理解的对抗性补丁。对于第二个挑战,我们引入了一个连续的黑盒优化框架,将离散的物理变化转化为参数优化,从而能够系统地探索最坏情况。对最先进的OpenVLA模型在多个基准上的大量实验表明,存在令人震惊的漏洞:所有变化类型都会触发超过60%的失败率,其中物体变换在长时程任务中导致高达97.8%的失败率。我们的研究结果揭示了受控实验室成功与不可预测的部署准备之间的关键差距,而Eva-VLA框架为加强基于VLA的机器人操作模型以应对真实部署挑战提供了一条实用的途径。

🔬 方法详解

问题定义:现有VLA模型在理想的实验室环境下表现良好,但在实际部署中,由于光照、物体姿态、遮挡等物理变化的影响,其性能会显著下降。现有方法缺乏系统性的评估框架,难以发现和解决这些鲁棒性问题。

核心思路:将离散的物理变化(如物体旋转角度、光照强度等)转化为连续的优化参数,通过优化这些参数来寻找使VLA模型性能最差的“最坏情况”。这种方法避免了大量真实数据的收集,并能系统地探索各种物理变化的影响。

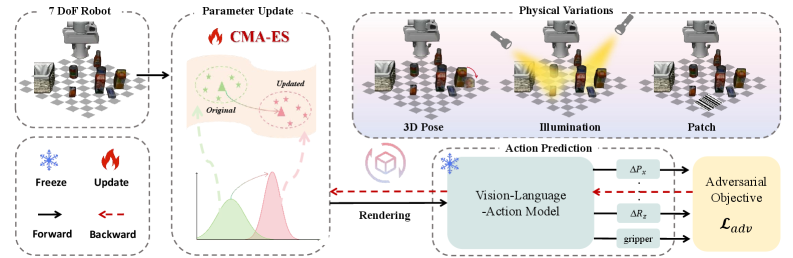

技术框架:Eva-VLA框架包含三个主要模块:1) 物理变化建模模块,将真实世界的物理变化分解为物体3D变换、照明变化和对抗性补丁三个领域。2) 连续优化模块,将离散的物理变化参数化,并使用黑盒优化算法(如CMA-ES)寻找最坏情况。3) 评估模块,使用VLA模型在优化后的物理环境下执行任务,并评估其性能。

关键创新:将离散的物理变化转化为连续优化问题,从而能够使用黑盒优化算法高效地搜索最坏情况。这种方法避免了对VLA模型内部结构的了解,使其适用于各种不同的VLA模型。此外,将物理变化分解为三个关键领域,使得评估更加全面和系统。

关键设计:物体3D变换使用旋转矩阵和平移向量进行参数化;照明变化使用环境光强度和方向进行参数化;对抗性补丁使用位置、大小和颜色进行参数化。使用CMA-ES算法进行黑盒优化,目标函数为VLA模型在特定任务上的性能指标(如成功率)。

🖼️ 关键图片

📊 实验亮点

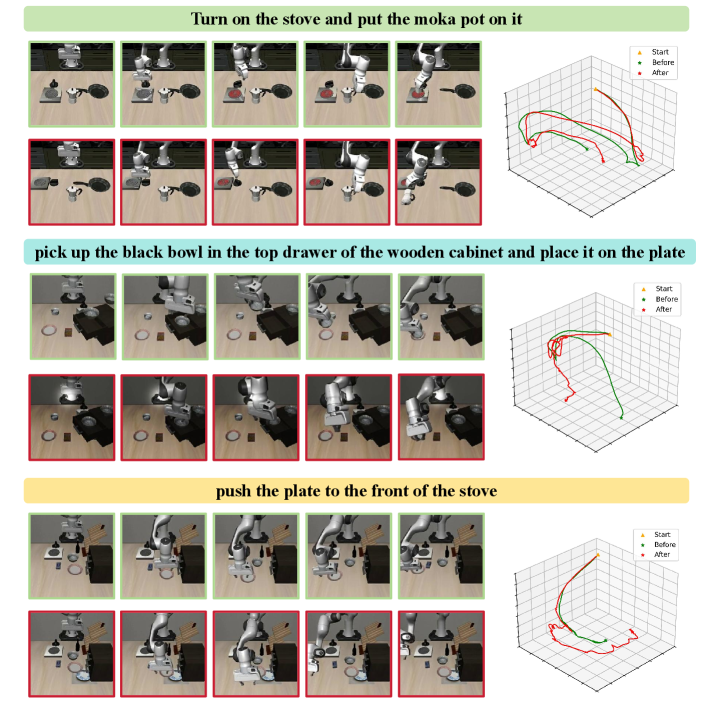

实验结果表明,所有类型的物理变化都会导致VLA模型出现显著的性能下降,失败率超过60%。其中,物体变换对长时程任务的影响最为严重,导致高达97.8%的失败率。这些结果突显了现有VLA模型在真实物理变化下的脆弱性,并验证了Eva-VLA框架的有效性。

🎯 应用场景

该研究成果可应用于提升机器人操作的可靠性和鲁棒性,使其能够在更复杂的真实环境中执行任务。例如,在仓库自动化、家庭服务机器人、自动驾驶等领域,可以利用Eva-VLA框架评估和改进VLA模型的性能,提高其在各种物理变化下的适应能力,从而实现更安全、更高效的机器人应用。

📄 摘要(原文)

Vision-Language-Action (VLA) models have emerged as promising solutions for robotic manipulation, yet their robustness to real-world physical variations remains critically underexplored. To bridge this gap, we propose Eva-VLA, the first unified framework that systematically evaluates the robustness of VLA models by transforming discrete physical variations into continuous optimization problems. However, comprehensively assessing VLA robustness presents two key challenges: (1) how to systematically characterize diverse physical variations encountered in real-world deployments while maintaining evaluation reproducibility, and (2) how to discover worst-case scenarios without prohibitive real-world data collection costs efficiently. To address the first challenge, we decompose real-world variations into three critical domains: object 3D transformations that affect spatial reasoning, illumination variations that challenge visual perception, and adversarial patches that disrupt scene understanding. For the second challenge, we introduce a continuous black-box optimization framework that transforms discrete physical variations into parameter optimization, enabling systematic exploration of worst-case scenarios. Extensive experiments on state-of-the-art OpenVLA models across multiple benchmarks reveal alarming vulnerabilities: all variation types trigger failure rates exceeding 60%, with object transformations causing up to 97.8% failure in long-horizon tasks. Our findings expose critical gaps between controlled laboratory success and unpredictable deployment readiness, while the Eva-VLA framework provides a practical pathway for hardening VLA-based robotic manipulation models against real-world deployment challenges.