Lang2Morph: Language-Driven Morphological Design of Robotic Hands

作者: Yanyuan Qiao, Kieran Gilday, Yutong Xie, Josie Hughes

分类: cs.RO

发布日期: 2025-09-23

💡 一句话要点

Lang2Morph:提出一种基于语言驱动的机器人手部形态自动设计框架

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱五:交互与反应 (Interaction & Reaction) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 机器人手部设计 大型语言模型 自然语言处理 形态生成 零样本学习

📋 核心要点

- 现有机器人手部形态设计方法依赖专家经验和手动调整,自动化方法计算成本高昂且依赖仿真,难以设计出灵巧的手部。

- Lang2Morph利用大型语言模型理解任务描述,并将其转化为机器人手部设计的参数,实现零样本的任务特定手部形态设计。

- 实验结果表明,Lang2Morph能够为各种任务生成多样且相关的机器人手部形态,验证了该方法的可行性。

📝 摘要(中文)

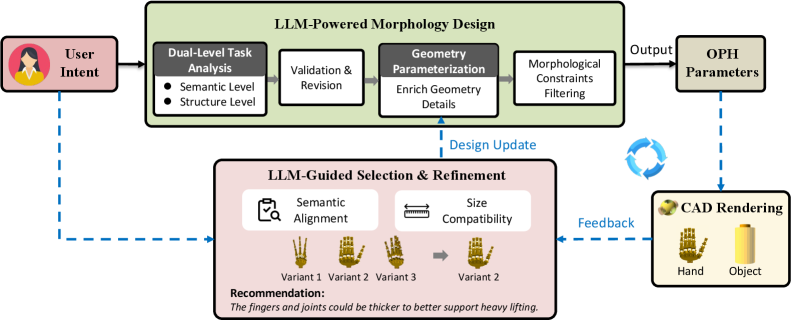

针对机器人手部形态设计在灵巧性、可制造性和任务特定功能之间难以平衡的问题,以及现有方法依赖专家经验、计算密集、仿真依赖等局限性,本文提出了一种名为Lang2Morph的语言驱动的机器人手部设计流程。该流程利用大型语言模型(LLM)将自然语言任务描述转换为符号结构和与OPH兼容的参数,从而实现可3D打印的、任务特定的手部形态。该流程包括:(i) 形态设计,将任务映射到语义标签、结构语法和OPH兼容参数;(ii) 选择和细化,基于语义对齐和尺寸兼容性评估设计候选方案,并可选择性地应用LLM引导的细化。实验结果表明,Lang2Morph能够生成多样化的、与任务相关的形态。据我们所知,这是首次尝试开发基于LLM的、任务条件下的机器人手部设计框架。

🔬 方法详解

问题定义:机器人手部形态设计需要在灵巧性、可制造性和任务特定功能之间取得平衡。传统方法依赖于专家经验和手动调整,耗时且难以推广。基于优化的方法虽然可以自动化设计过程,但计算成本高昂,严重依赖仿真环境,并且很少能设计出真正灵巧的手部。

核心思路:利用大型语言模型(LLM)强大的自然语言理解和生成能力,将自然语言描述的任务需求直接转化为机器人手部形态设计的参数。这种方法避免了对大量仿真数据的依赖,并且能够利用LLM中蕴含的关于人类-物体交互的知识,从而实现零样本的任务特定手部设计。

技术框架:Lang2Morph流程主要包含两个阶段:形态设计和选择与细化。在形态设计阶段,首先将自然语言任务描述映射到语义标签,然后利用结构语法生成初始的机器人手部形态,并将其转化为与OPH(Open Hand Project)兼容的参数。在选择与细化阶段,根据语义对齐和尺寸兼容性对候选设计进行评估和筛选,并可选择性地使用LLM引导的细化过程来进一步优化设计。

关键创新:该方法的核心创新在于利用LLM直接从自然语言任务描述生成机器人手部形态参数,从而避免了对大量仿真数据的依赖和人工设计过程。这是首次尝试将LLM应用于机器人手部形态设计领域,为自动化机器人设计提供了一种新的思路。

关键设计:该方法使用LLM将任务描述映射到语义标签,这些标签用于指导结构语法的生成过程。结构语法定义了机器人手部的基本结构和连接方式。生成的结构随后被转化为与OPH兼容的参数,以便于后续的3D打印和仿真。在选择和细化阶段,使用语义对齐度量来评估候选设计的与任务的相关性,并使用尺寸兼容性度量来确保设计能够适应目标物体。LLM引导的细化过程利用LLM生成新的设计参数,以进一步优化设计。

🖼️ 关键图片

📊 实验亮点

实验结果表明,Lang2Morph能够为各种任务生成多样化的、与任务相关的机器人手部形态。例如,对于“抓取易碎物体”的任务,Lang2Morph能够生成具有更多接触点和更柔性材料的手部设计。该方法无需任何训练数据或人工干预,即可实现零样本的任务特定手部设计。

🎯 应用场景

Lang2Morph可应用于各种需要定制化机器人手部的场景,例如:特定物体的抓取、特定环境下的操作、以及为残疾人设计的辅助设备等。该研究有望降低机器人手部设计的门槛,加速机器人技术在各个领域的应用,并促进人机协作的进一步发展。

📄 摘要(原文)

Designing robotic hand morphologies for diverse manipulation tasks requires balancing dexterity, manufacturability, and task-specific functionality. While open-source frameworks and parametric tools support reproducible design, they still rely on expert heuristics and manual tuning. Automated methods using optimization are often compute-intensive, simulation-dependent, and rarely target dexterous hands. Large language models (LLMs), with their broad knowledge of human-object interactions and strong generative capabilities, offer a promising alternative for zero-shot design reasoning. In this paper, we present Lang2Morph, a language-driven pipeline for robotic hand design. It uses LLMs to translate natural-language task descriptions into symbolic structures and OPH-compatible parameters, enabling 3D-printable task-specific morphologies. The pipeline consists of: (i) Morphology Design, which maps tasks into semantic tags, structural grammars, and OPH-compatible parameters; and (ii) Selection and Refinement, which evaluates design candidates based on semantic alignment and size compatibility, and optionally applies LLM-guided refinement when needed. We evaluate Lang2Morph across varied tasks, and results show that our approach can generate diverse, task-relevant morphologies. To our knowledge, this is the first attempt to develop an LLM-based framework for task-conditioned robotic hand design.