RadarSFD: Single-Frame Diffusion with Pretrained Priors for Radar Point Clouds

作者: Bin Zhao, Nakul Garg

分类: cs.RO, eess.SP

发布日期: 2025-09-22

💡 一句话要点

RadarSFD:利用预训练先验的单帧雷达点云扩散重建

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 雷达点云 单帧重建 扩散模型 预训练先验 深度估计

📋 核心要点

- 现有雷达成像方法依赖合成孔径或多帧聚合来提高分辨率,这对于小型无人机或可穿戴系统是不切实际的。

- RadarSFD利用预训练的单目深度估计器的几何先验,通过条件潜在扩散模型,从单帧雷达数据重建高密度点云。

- 实验表明,RadarSFD在RadarHD数据集上显著优于单帧基线,并能与多帧方法竞争,同时具有良好的泛化能力。

📝 摘要(中文)

本文提出RadarSFD,一个条件潜在扩散框架,用于从单个雷达帧重建密集的、类似LiDAR的点云,无需运动或合成孔径雷达(SAR)。该方法将预训练的单目深度估计器的几何先验知识迁移到扩散骨干网络中,通过通道级的潜在空间拼接将这些先验与雷达输入对齐,并使用结合潜在空间和像素空间损失的双空间目标函数来正则化输出。在RadarHD基准测试中,RadarSFD实现了35厘米的Chamfer距离和28厘米的修正Hausdorff距离,优于单帧RadarHD基线(56厘米,45厘米),并与使用5-41帧的多帧方法相比仍具有竞争力。定性结果表明,该方法能够恢复精细的墙壁和狭窄的间隙,并且跨新环境的实验证实了其强大的泛化能力。消融研究突出了预训练初始化、雷达BEV条件和双空间损失的重要性。这些结果共同确立了第一个实用的单帧、无SAR毫米波雷达流水线,用于紧凑型机器人系统中的密集点云感知。

🔬 方法详解

问题定义:论文旨在解决单帧毫米波雷达点云稀疏且分辨率低的问题,现有方法依赖多帧数据或合成孔径雷达技术,不适用于对尺寸、重量和功耗敏感的机器人平台,例如小型无人机或可穿戴设备。

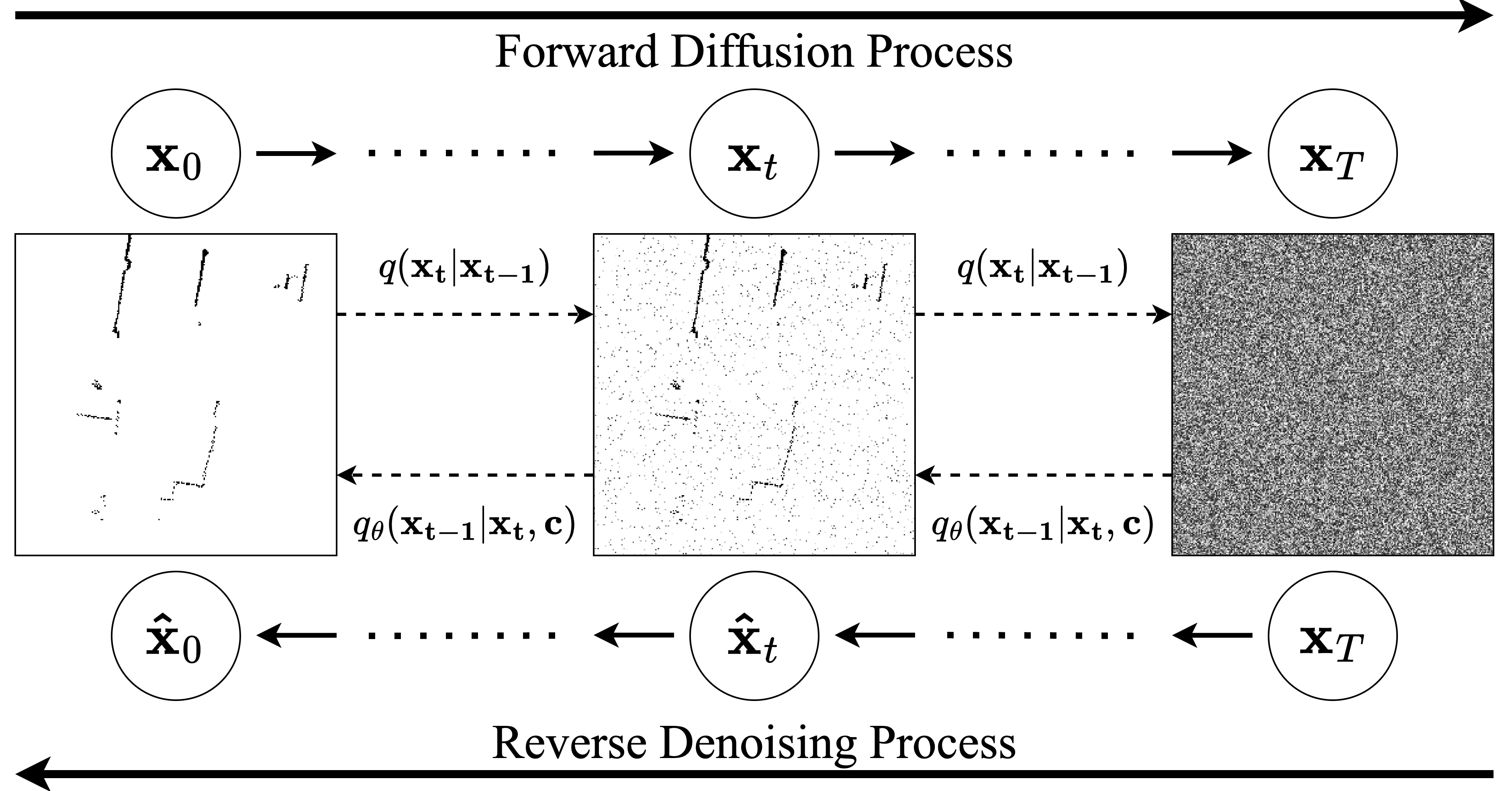

核心思路:核心思路是将预训练的单目深度估计器的几何先验知识迁移到雷达点云重建任务中。通过扩散模型学习从稀疏雷达数据到密集点云的映射,并利用预训练的深度估计器提供额外的几何约束,从而提高重建质量。

技术框架:RadarSFD是一个条件潜在扩散框架。首先,使用雷达鸟瞰图(BEV)作为条件输入。其次,将预训练的单目深度估计器的潜在表示与雷达输入的潜在表示进行通道级联接,作为扩散模型的条件。最后,通过扩散过程逐步生成密集点云。整体流程包括编码器、扩散模型和解码器三个主要模块。

关键创新:最重要的创新点在于将预训练的单目深度估计器的先验知识有效地融入到雷达点云重建任务中。通过潜在空间的特征融合和双空间损失函数,实现了雷达数据和视觉先验的有效结合,从而在单帧雷达数据下实现了高质量的点云重建。与现有方法相比,无需多帧数据或SAR技术。

关键设计:关键设计包括:1) 使用预训练的单目深度估计器初始化扩散模型的编码器;2) 使用雷达BEV图像作为条件输入,引导扩散过程;3) 设计双空间损失函数,包括潜在空间损失和像素空间损失,以正则化输出;4) 采用通道级联接的方式融合雷达特征和深度先验。

🖼️ 关键图片

📊 实验亮点

RadarSFD在RadarHD基准测试中取得了显著的性能提升,Chamfer距离从单帧基线的56厘米降低到35厘米,修正Hausdorff距离从45厘米降低到28厘米。该方法在单帧雷达数据下实现了与使用5-41帧的多帧方法相竞争的性能,同时具有良好的泛化能力,在新的环境中也能有效重建精细的几何结构。

🎯 应用场景

该研究成果可应用于小型无人机、巡检机器人和可穿戴设备等平台,为这些平台提供在恶劣环境(如雾、烟、尘和弱光)下的鲁棒感知能力。通过单帧雷达数据重建高密度点云,可以支持导航、避障、三维重建等任务,具有重要的实际应用价值和广阔的应用前景。

📄 摘要(原文)

Millimeter-wave radar provides perception robust to fog, smoke, dust, and low light, making it attractive for size, weight, and power constrained robotic platforms. Current radar imaging methods, however, rely on synthetic aperture or multi-frame aggregation to improve resolution, which is impractical for small aerial, inspection, or wearable systems. We present RadarSFD, a conditional latent diffusion framework that reconstructs dense LiDAR-like point clouds from a single radar frame without motion or SAR. Our approach transfers geometric priors from a pretrained monocular depth estimator into the diffusion backbone, anchors them to radar inputs via channel-wise latent concatenation, and regularizes outputs with a dual-space objective combining latent and pixel-space losses. On the RadarHD benchmark, RadarSFD achieves 35 cm Chamfer Distance and 28 cm Modified Hausdorff Distance, improving over the single-frame RadarHD baseline (56 cm, 45 cm) and remaining competitive with multi-frame methods using 5-41 frames. Qualitative results show recovery of fine walls and narrow gaps, and experiments across new environments confirm strong generalization. Ablation studies highlight the importance of pretrained initialization, radar BEV conditioning, and the dual-space loss. Together, these results establish the first practical single-frame, no-SAR mmWave radar pipeline for dense point cloud perception in compact robotic systems.