TranTac: Leveraging Transient Tactile Signals for Contact-Rich Robotic Manipulation

作者: Yinghao Wu, Shuhong Hou, Haowen Zheng, Yichen Li, Weiyi Lu, Xun Zhou, Yitian Shao

分类: cs.RO, cs.AI, eess.SY

发布日期: 2025-09-20

备注: 8 pages, 7 figures

💡 一句话要点

TranTac:利用瞬态触觉信号实现高接触力度的机器人操作

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 触觉感知 机器人操作 瞬态信号 Transformer 扩散策略

📋 核心要点

- 现有机器人操作任务在视觉感知不足时易失败,依赖触觉感知进行状态监测和调整,但现有方案存在灵敏度不足或数据冗余问题。

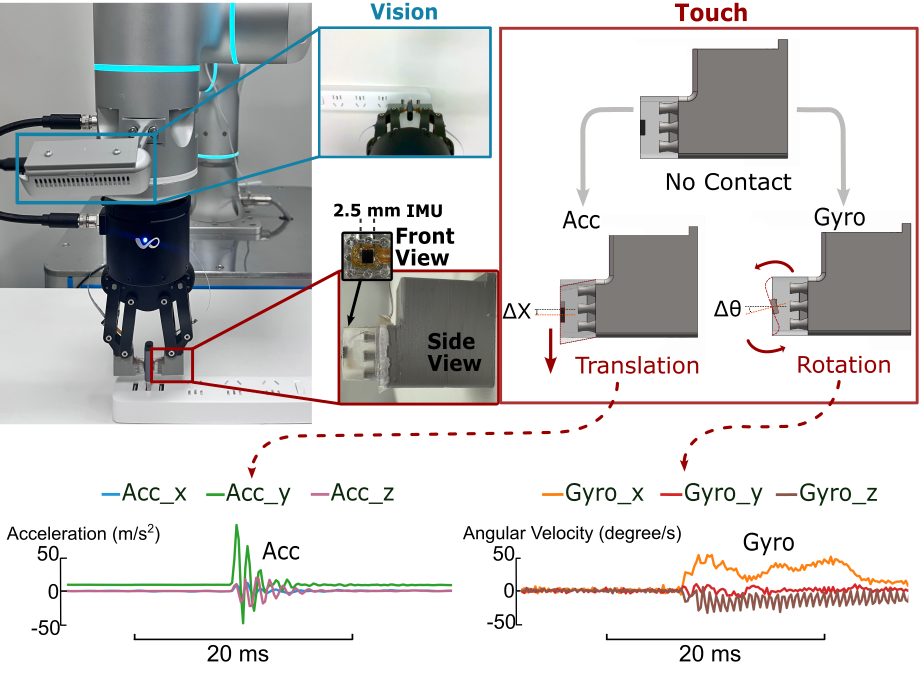

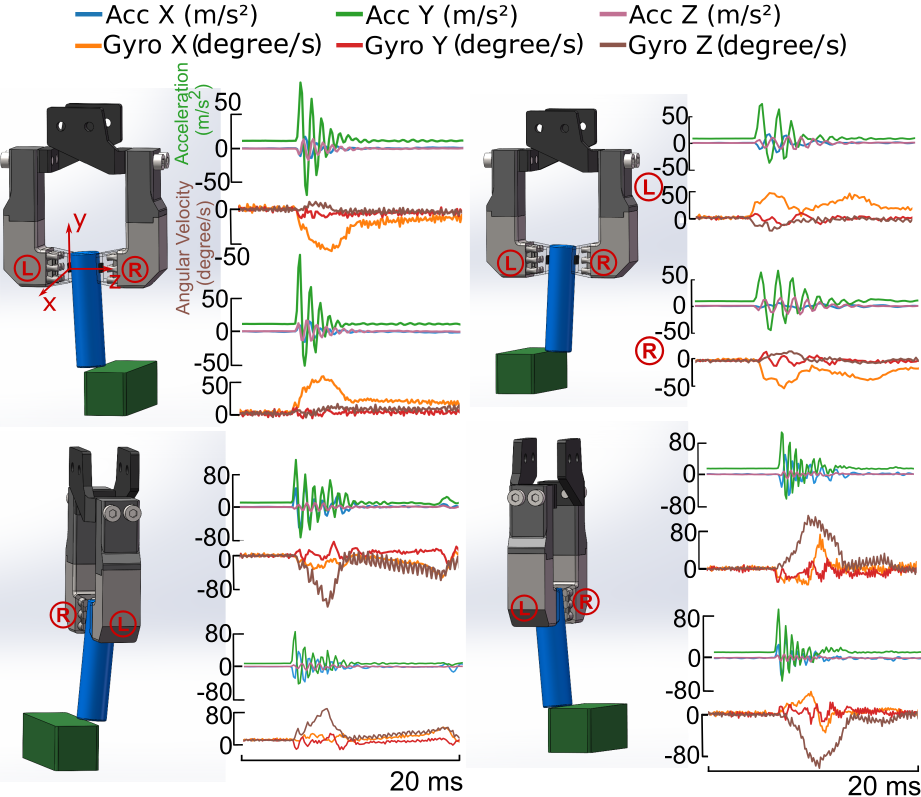

- TranTac框架将6轴IMU集成到机器人夹具弹性尖端,检测微米级动态变形,跟踪物体姿态变化,并结合Transformer和扩散策略模仿人类插入行为。

- 实验表明,TranTac结合视觉的抓取和插入任务成功率达79%,优于其他方案;仅触觉的未对准插入任务成功率达88%,并具有良好的泛化能力。

📝 摘要(中文)

在视觉感知不足以检测错位的情况下,机器人操作任务(如钥匙插入锁或USB设备插入端口)可能会失败。触觉感知对于机器人监测任务状态并进行精确、及时的调整至关重要。现有的触觉感知解决方案要么对细微变化不敏感,要么需要过多的传感器数据。本文介绍了一种数据高效且低成本的触觉感知和控制框架TranTac,它将单个接触敏感的6轴惯性测量单元集成到机器人夹具的弹性尖端中,以完成精细的插入任务。我们定制的传感系统可以检测微米级的动态平移和扭转变形,从而能够跟踪被抓取物体视觉上难以察觉的姿态变化。通过利用基于Transformer的编码器和扩散策略,TranTac可以模仿人类在插入过程中夹具尖端检测到的瞬态触觉线索来模仿人类的插入行为。这些线索使机器人能够动态控制和校正被抓取物体的6自由度姿态。当与视觉结合使用时,TranTac在物体抓取和插入任务中的平均成功率为79%,优于仅使用视觉策略以及使用末端执行器6D力/扭矩传感增强的策略。接触定位性能也通过仅触觉的未对准插入任务得到验证,平均成功率为88%。我们通过在单个棱柱-槽对上训练TranTac并在未见过的数据(包括USB插头和金属钥匙)上进行测试来评估其泛化能力,发现插入任务仍然可以完成,平均成功率接近70%。所提出的框架可能会激发用于精细操作任务的新型机器人触觉传感系统。

🔬 方法详解

问题定义:论文旨在解决机器人精细操作任务中,由于视觉感知局限性导致的插入失败问题。现有触觉感知方案存在两个主要痛点:一是灵敏度不足,无法捕捉细微的接触变化;二是数据量过大,增加了计算负担和系统复杂性。

核心思路:论文的核心思路是利用安装在机器人夹具弹性尖端的微型6轴惯性测量单元(IMU)来感知瞬态触觉信号。通过捕捉夹具与环境接触时产生的微小变形,推断被操作物体的姿态变化,并利用这些信息进行精确的姿态调整。这种方法旨在提高触觉感知的灵敏度和数据效率。

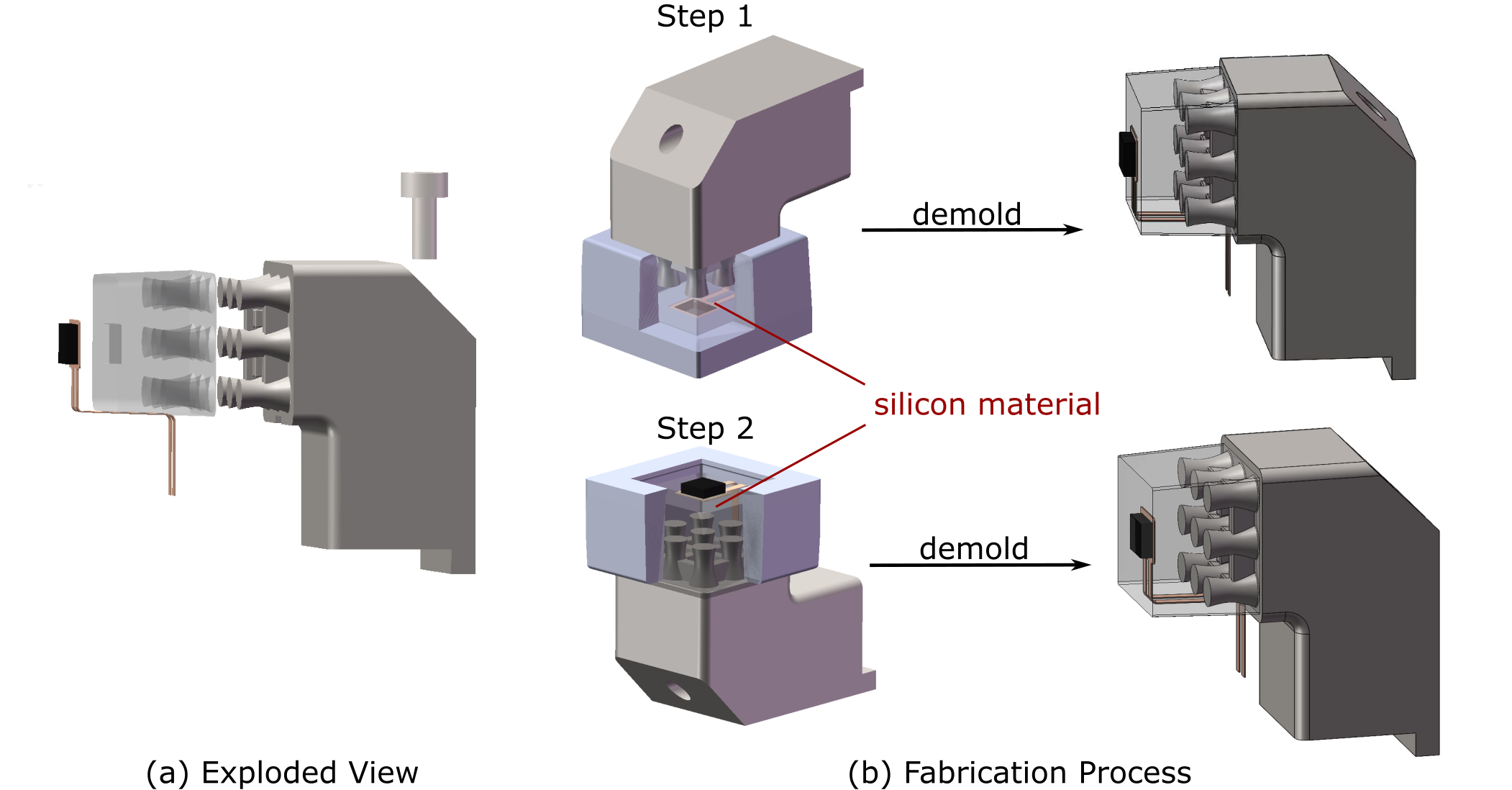

技术框架:TranTac框架主要包含以下几个模块:1) 触觉传感模块:使用定制的触觉传感器,将6轴IMU嵌入到机器人夹具的弹性尖端中,用于捕捉接触过程中的动态变形。2) 数据处理模块:对IMU采集的原始数据进行滤波和校准,提取有用的触觉特征。3) 策略学习模块:使用Transformer编码器提取触觉特征,并结合扩散策略学习模仿人类的插入行为,生成控制指令。4) 控制执行模块:根据策略学习模块生成的控制指令,控制机器人夹具的运动,实现精确的姿态调整。

关键创新:论文最重要的技术创新点在于将瞬态触觉信号应用于机器人精细操作任务。与传统的力/扭矩传感器相比,TranTac能够感知更细微的接触变化,并提供更丰富的触觉信息。此外,TranTac使用Transformer编码器和扩散策略,能够有效地学习人类的插入行为,并生成鲁棒的控制策略。

关键设计:在触觉传感模块中,IMU的安装位置和弹性材料的选择至关重要,需要仔细设计以保证传感器的灵敏度和稳定性。在策略学习模块中,Transformer编码器的结构和参数需要根据具体的任务进行调整,以获得最佳的性能。扩散策略的设计也需要考虑控制的平滑性和鲁棒性。论文中具体参数设置、损失函数和网络结构等技术细节未知。

🖼️ 关键图片

📊 实验亮点

TranTac框架在物体抓取和插入任务中取得了显著的性能提升。与仅使用视觉策略相比,TranTac结合视觉的平均成功率提高了约30%。与使用末端执行器6D力/扭矩传感增强的策略相比,TranTac的性能也更优。在仅触觉的未对准插入任务中,TranTac的平均成功率达到了88%。此外,TranTac在未见过的数据上的泛化能力也得到了验证,平均成功率接近70%。

🎯 应用场景

TranTac框架在需要高精度操作的机器人应用中具有广泛的应用前景,例如电子元件组装、医疗器械操作、精密仪器维护等。该技术能够提高机器人在复杂环境中的适应性和操作精度,降低对视觉感知的依赖,从而实现更安全、更可靠的自动化操作。未来,TranTac有望应用于更广泛的机器人领域,例如服务机器人、工业机器人和医疗机器人。

📄 摘要(原文)

Robotic manipulation tasks such as inserting a key into a lock or plugging a USB device into a port can fail when visual perception is insufficient to detect misalignment. In these situations, touch sensing is crucial for the robot to monitor the task's states and make precise, timely adjustments. Current touch sensing solutions are either insensitive to detect subtle changes or demand excessive sensor data. Here, we introduce TranTac, a data-efficient and low-cost tactile sensing and control framework that integrates a single contact-sensitive 6-axis inertial measurement unit within the elastomeric tips of a robotic gripper for completing fine insertion tasks. Our customized sensing system can detect dynamic translational and torsional deformations at the micrometer scale, enabling the tracking of visually imperceptible pose changes of the grasped object. By leveraging transformer-based encoders and diffusion policy, TranTac can imitate human insertion behaviors using transient tactile cues detected at the gripper's tip during insertion processes. These cues enable the robot to dynamically control and correct the 6-DoF pose of the grasped object. When combined with vision, TranTac achieves an average success rate of 79% on object grasping and insertion tasks, outperforming both vision-only policy and the one augmented with end-effector 6D force/torque sensing. Contact localization performance is also validated through tactile-only misaligned insertion tasks, achieving an average success rate of 88%. We assess the generalizability by training TranTac on a single prism-slot pair and testing it on unseen data, including a USB plug and a metal key, and find that the insertion tasks can still be completed with an average success rate of nearly 70%. The proposed framework may inspire new robotic tactile sensing systems for delicate manipulation tasks.