Agentic Aerial Cinematography: From Dialogue Cues to Cinematic Trajectories

作者: Yifan Lin, Sophie Ziyu Liu, Ran Qi, George Z. Xue, Xinping Song, Chao Qin, Hugh H. -T. Liu

分类: cs.RO

发布日期: 2025-09-19

💡 一句话要点

ACDC:提出一种基于对话提示的自主无人机电影摄影系统

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 无人机电影摄影 自然语言控制 大型语言模型 视觉基础模型 贝叶斯优化 运动规划 具身智能

📋 核心要点

- 现有无人机电影摄影流程依赖手动选择航点和视角,效率低且效果不稳定。

- ACDC利用大型语言模型和视觉基础模型,将自然语言提示转化为无人机可执行的飞行轨迹。

- 通过仿真和硬件实验验证,ACDC无需专业知识即可生成高质量的室内无人机视频。

📝 摘要(中文)

本文提出了一种名为Agentic Aerial Cinematography: From Dialogue Cues to Cinematic Trajectories (ACDC)的自主无人机电影摄影系统,该系统由人类导演和无人机之间的自然语言通信驱动。以往无人机电影摄影工作流程的主要限制在于,它们需要基于预定义的人类意图手动选择航点和视角,这既费力又导致性能不一致。本文提出采用大型语言模型(LLMs)和视觉基础模型(VFMs)将自由形式的自然语言提示直接转换为可执行的室内无人机视频巡览。具体而言,我们的方法包括用于初始航点选择的视觉-语言检索管道、使用美学反馈细化姿势的基于偏好的贝叶斯优化框架,以及生成安全四旋翼飞行器轨迹的运动规划器。我们通过仿真和硬件在环实验验证了ACDC,证明了它能够在各种室内场景中稳健地生成专业质量的镜头,而无需机器人或电影摄影方面的专业知识。这些结果突出了具身AI智能体在闭环从开放词汇对话到现实世界自主空中电影摄影方面的潜力。

🔬 方法详解

问题定义:现有的无人机电影摄影工作流程需要人工干预,手动设置航点和视角,这不仅耗时耗力,而且最终拍摄效果很大程度上依赖于操作人员的经验和水平,难以保证一致性和专业性。因此,如何实现从自然语言指令到高质量无人机电影摄影的自动转换是一个亟待解决的问题。

核心思路:ACDC的核心思路是利用大型语言模型(LLMs)理解人类导演的自然语言指令,并结合视觉基础模型(VFMs)感知环境信息,从而自动生成无人机的飞行轨迹和拍摄角度。通过将自然语言指令转化为可执行的无人机动作,降低了无人机电影摄影的技术门槛,提高了效率和一致性。

技术框架:ACDC系统主要包含三个模块:1) 视觉-语言检索管道:用于根据自然语言提示,从场景中选择初始航点。2) 基于偏好的贝叶斯优化框架:利用美学反馈,迭代优化无人机的姿态,以获得更佳的拍摄效果。3) 运动规划器:生成安全、平滑的四旋翼飞行器轨迹,确保无人机能够安全地到达目标航点并执行拍摄任务。

关键创新:ACDC的关键创新在于将大型语言模型和视觉基础模型应用于无人机电影摄影领域,实现了从自然语言指令到无人机自主飞行的闭环控制。通过视觉-语言检索和基于偏好的贝叶斯优化,ACDC能够根据人类导演的意图,自动生成高质量的无人机视频,无需人工干预。

关键设计:在视觉-语言检索管道中,使用了CLIP等模型来计算文本和图像之间的相似度,从而选择与自然语言提示相关的航点。在基于偏好的贝叶斯优化框架中,使用高斯过程模型来建模美学偏好,并利用采集函数来选择下一个需要评估的姿态。运动规划器则采用了常见的RRT*算法,确保生成的轨迹是安全且平滑的。

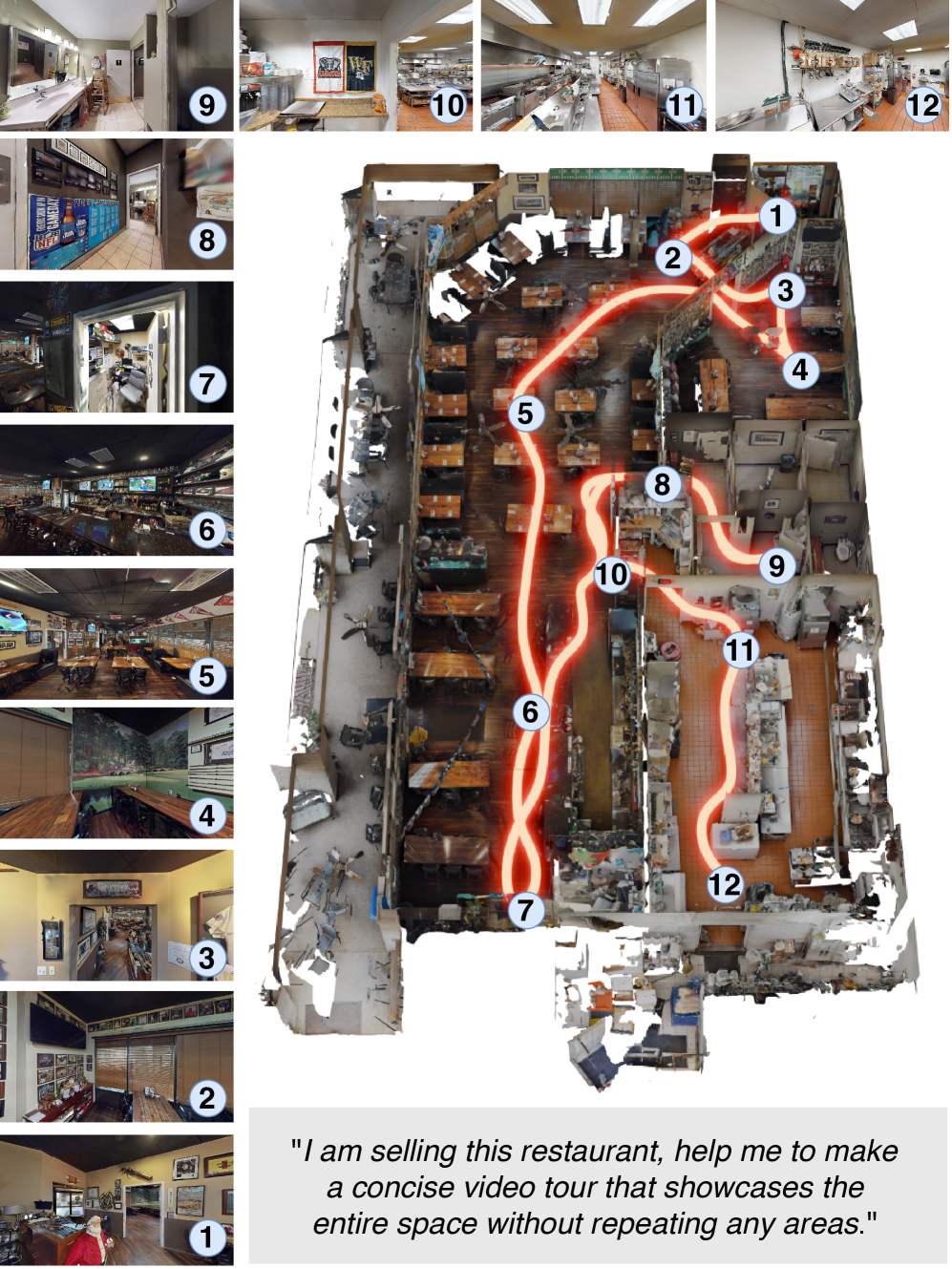

🖼️ 关键图片

📊 实验亮点

通过仿真和硬件在环实验,ACDC展示了其在各种室内场景中生成专业质量镜头的能力。实验结果表明,ACDC能够根据自然语言提示,自动选择合适的航点和视角,并生成安全、平滑的飞行轨迹。与传统的手动控制方法相比,ACDC显著提高了无人机电影摄影的效率和一致性。

🎯 应用场景

ACDC具有广泛的应用前景,例如:室内导航、安防巡检、房地产展示、游戏场景制作等。该系统可以降低无人机电影摄影的技术门槛,使得非专业人士也能轻松制作高质量的无人机视频。未来,ACDC有望应用于更复杂的场景,例如户外拍摄、多人协作等,为无人机电影摄影带来更多可能性。

📄 摘要(原文)

We present Agentic Aerial Cinematography: From Dialogue Cues to Cinematic Trajectories (ACDC), an autonomous drone cinematography system driven by natural language communication between human directors and drones. The main limitation of previous drone cinematography workflows is that they require manual selection of waypoints and view angles based on predefined human intent, which is labor-intensive and yields inconsistent performance. In this paper, we propose employing large language models (LLMs) and vision foundation models (VFMs) to convert free-form natural language prompts directly into executable indoor UAV video tours. Specifically, our method comprises a vision-language retrieval pipeline for initial waypoint selection, a preference-based Bayesian optimization framework that refines poses using aesthetic feedback, and a motion planner that generates safe quadrotor trajectories. We validate ACDC through both simulation and hardware-in-the-loop experiments, demonstrating that it robustly produces professional-quality footage across diverse indoor scenes without requiring expertise in robotics or cinematography. These results highlight the potential of embodied AI agents to close the loop from open-vocabulary dialogue to real-world autonomous aerial cinematography.