Latent Conditioned Loco-Manipulation Using Motion Priors

作者: Maciej Stępień, Rafael Kourdis, Constant Roux, Olivier Stasse

分类: cs.RO

发布日期: 2025-09-19

备注: https://gepetto.github.io/LaCoLoco/

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

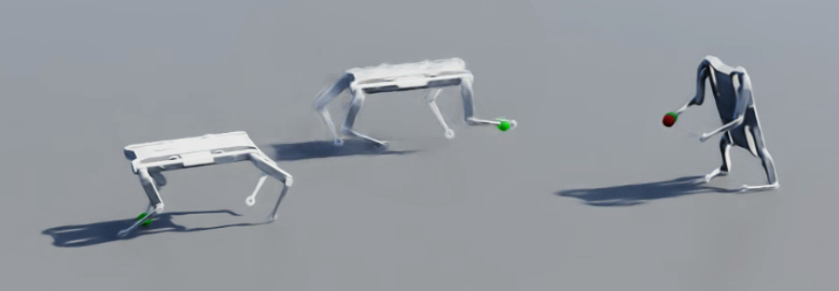

提出基于运动先验的潜在条件Loco-Manipulation方法,用于人形和四足机器人的复杂操作任务

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: Loco-Manipulation 运动先验 潜在条件策略 模仿学习 人形机器人 四足机器人 扩散判别器 运动控制

📋 核心要点

- 现有深度强化学习方法在解决人形和四足机器人复杂操作任务时,主要关注单一技能,效率较低。

- 该方法通过模仿学习训练多用途运动策略,利用潜在空间控制技能执行,并扩展到处理约束以确保安全。

- 在H1人形机器人和Solo12四足机器人仿真及Solo12硬件上验证了该方法,实现了Loco-Manipulation。

📝 摘要(中文)

本文提出了一种基于运动先验的潜在条件Loco-Manipulation方法,旨在解决人形和四足机器人复杂操作任务中,现有深度强化学习方法专注于单一技能的局限性。该方法首先通过模仿学习获得多用途运动策略,从而获取低级技能,并通过潜在空间控制技能的执行。为了提高模仿质量,本文使用了扩散判别器,并扩展了原始公式以处理约束,确保部署安全性。该方法在H1人形机器人和Solo12四足机器人的仿真环境中进行了验证,并成功部署到Solo12硬件上,实现了Loco-Manipulation。

🔬 方法详解

问题定义:现有控制方法,特别是深度强化学习,在人形和四足机器人上主要关注单一技能,无法有效解决需要考虑高层目标、物理限制和运动风格的复杂操作任务。这些方法难以泛化到新的任务和环境,并且训练成本高昂。

核心思路:该论文的核心思路是首先通过模仿学习训练一个多用途的运动策略,该策略能够学习到各种低级运动技能。然后,通过潜在空间来控制这些技能的执行,从而实现对机器人运动的灵活控制。这种方法借鉴了计算机图形学中成功的经验,将复杂的任务分解为一系列可控的运动基元。

技术框架:整体框架包含以下几个主要模块:1) 运动数据收集:通过合成运动或运动学重定向(如狗的运动)获取训练数据。2) 运动策略学习:使用模仿学习训练一个潜在条件运动策略,该策略能够根据潜在变量生成不同的运动。3) 约束处理:扩展原始公式以处理约束,例如关节限制和力矩限制,以确保部署安全。4) 扩散判别器:使用扩散判别器来提高模仿学习的质量,使生成的运动更逼真。5) 任务执行:利用训练好的运动策略,通过调整潜在变量来实现Loco-Manipulation任务。

关键创新:该论文的关键创新在于将潜在条件运动策略应用于人形和四足机器人的Loco-Manipulation任务,并结合了约束处理和扩散判别器来提高性能和安全性。与传统的深度强化学习方法相比,该方法能够更有效地学习和控制复杂的运动技能,并且具有更好的泛化能力。

关键设计:论文中使用了模仿学习来训练运动策略,具体的损失函数可能包括运动学损失、动力学损失等,以确保生成的运动与训练数据相似。潜在空间的维度和结构需要根据具体的任务进行设计,以实现对运动的有效控制。扩散判别器的具体结构和训练方法需要根据实际情况进行调整,以提高模仿学习的质量。约束处理的具体方法可能包括使用惩罚函数或投影法来确保满足约束条件。

🖼️ 关键图片

📊 实验亮点

该论文在H1人形机器人和Solo12四足机器人的仿真环境中进行了验证,并成功部署到Solo12硬件上。实验结果表明,该方法能够有效地实现Loco-Manipulation任务,并且具有良好的鲁棒性和泛化能力。通过使用扩散判别器,模仿学习的质量得到了显著提高,生成的运动更加逼真。

🎯 应用场景

该研究成果可应用于人形和四足机器人在复杂环境中的操作任务,例如搜救、物流、巡检等。通过学习通用的运动技能,机器人可以适应不同的任务需求,提高工作效率和安全性。未来,该方法有望扩展到更多类型的机器人和更复杂的任务场景,实现更智能、更自主的机器人操作。

📄 摘要(原文)

Although humanoid and quadruped robots provide a wide range of capabilities, current control methods, such as Deep Reinforcement Learning, focus mainly on single skills. This approach is inefficient for solving more complicated tasks where high-level goals, physical robot limitations and desired motion style might all need to be taken into account. A more effective approach is to first train a multipurpose motion policy that acquires low-level skills through imitation, while providing latent space control over skill execution. Then, this policy can be used to efficiently solve downstream tasks. This method has already been successful for controlling characters in computer graphics. In this work, we apply the approach to humanoid and quadrupedal loco-manipulation by imitating either simple synthetic motions or kinematically retargeted dog motions. We extend the original formulation to handle constraints, ensuring deployment safety, and use a diffusion discriminator for better imitation quality. We verify our methods by performing loco-manipulation in simulation for the H1 humanoid and Solo12 quadruped, as well as deploying policies on Solo12 hardware. Videos and code are available at https://gepetto.github.io/LaCoLoco/