Right-Side-Out: Learning Zero-Shot Sim-to-Real Garment Reversal

作者: Chang Yu, Siyu Ma, Wenxin Du, Zeshun Zong, Han Xue, Wendi Chen, Cewu Lu, Yin Yang, Xuchen Han, Joseph Masterjohn, Alejandro Castro, Chenfanfu Jiang

分类: cs.RO

发布日期: 2025-09-19

备注: More details and supplementary material are on the website: https://right-side-out.github.io

💡 一句话要点

提出Right-Side-Out框架,解决服装翻转中零样本Sim-to-Real难题

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 服装操作 机器人操作 Sim-to-Real 零样本学习 任务分解

📋 核心要点

- 服装翻转任务因其高度动态性、快速接触变化和严重视觉遮挡而极具挑战性,现有方法难以有效解决。

- Right-Side-Out框架通过任务分解和关键点参数化动作原语,降低动作空间复杂度的同时保证鲁棒性,实现高效的策略学习。

- 该方法利用高保真MPM模拟器生成大量无标注数据,并在真实机器人上实现高达81.3%的零样本成功率。

📝 摘要(中文)

本文提出Right-Side-Out框架,通过利用任务结构有效解决服装正面翻转这一挑战性操作任务。该任务具有高度动态性、快速接触变化和严重视觉遮挡等特点。我们将任务分解为“拖拽/抛掷”以创建和稳定开口,然后进行“插入和拉动”以反转服装。每个步骤都使用深度推断、关键点参数化的双手动手操作原语,从而在保持鲁棒性的同时显著减少动作空间。我们定制的高保真GPU并行材料点法(MPM)模拟器能够模拟薄壳变形,并为批量rollout提供鲁棒高效的接触处理,从而实现高效的数据生成。基于该模拟器,我们构建了全自动流水线,通过随机化服装几何形状、材料参数和视点来扩展数据生成,无需任何人工标注即可生成深度、掩码和每个原语的关键点标签。仅使用单个深度相机,完全在模拟中训练的策略即可在真实硬件上进行零样本部署,成功率高达81.3%。通过采用任务分解和高保真模拟,我们的框架能够处理高度动态、严重遮挡的任务,而无需费力的人工演示。

🔬 方法详解

问题定义:论文旨在解决服装翻转这一复杂操作任务,该任务的难点在于其高度的动态性、频繁的接触变化以及严重的视觉遮挡。现有方法通常依赖于大量人工标注数据或复杂的强化学习算法,难以实现零样本的Sim-to-Real迁移,泛化能力有限。

核心思路:论文的核心思路是将复杂的服装翻转任务分解为几个简单的子任务,并为每个子任务设计特定的动作原语。通过这种方式,可以显著降低动作空间的维度,简化策略学习过程。同时,利用高保真度的物理模拟器生成大量训练数据,实现从模拟到真实的零样本迁移。

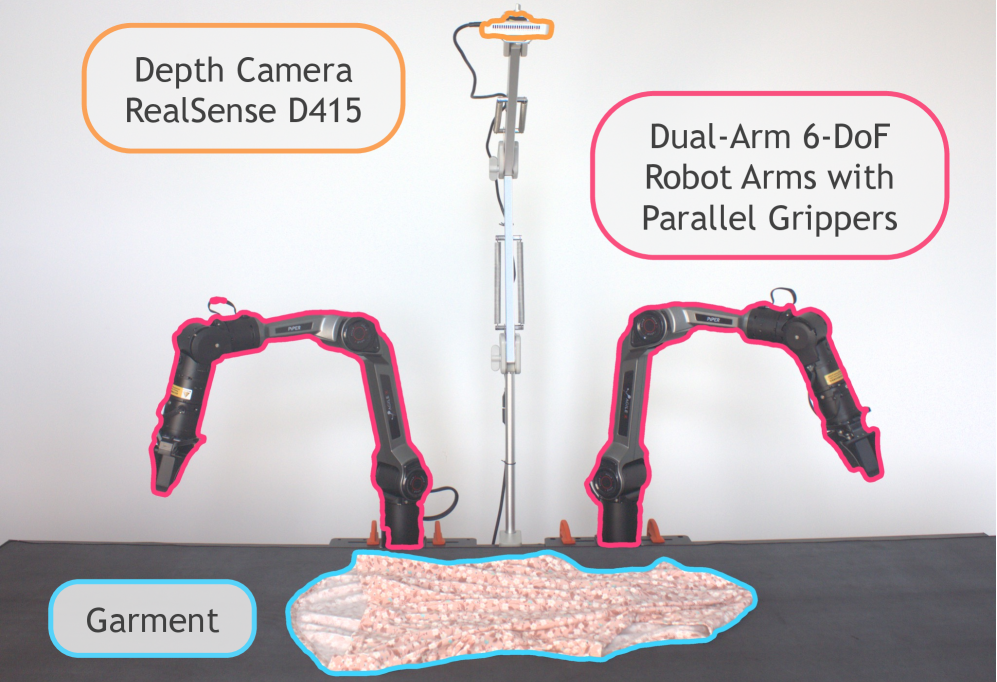

技术框架:整体框架包含三个主要阶段:首先是任务分解,将服装翻转任务分解为“拖拽/抛掷”和“插入和拉动”两个阶段。其次是数据生成,利用GPU并行的MPM模拟器,随机化服装的几何形状、材料参数和视点,生成大量的深度图像和关键点标签。最后是策略学习,在模拟环境中训练基于深度图像和关键点信息的策略,并在真实机器人上进行零样本部署。

关键创新:论文的关键创新在于以下几个方面:1) 提出了一种基于任务分解和关键点参数化动作原语的方法,有效降低了动作空间的复杂度。2) 开发了一种高保真度的GPU并行MPM模拟器,能够高效地生成大量的训练数据。3) 实现了从模拟到真实的零样本迁移,无需任何人工标注数据。

关键设计:在数据生成方面,论文随机化了服装的几何形状、材料参数和视点,以增加数据的多样性。在策略学习方面,论文使用深度图像和关键点信息作为输入,训练了一个深度神经网络来预测动作。此外,论文还设计了一个奖励函数,鼓励机器人完成服装翻转任务。

🖼️ 关键图片

📊 实验亮点

该研究在真实机器人上实现了高达81.3%的零样本成功率,显著优于现有方法。通过与基于人工演示的基线方法进行对比,证明了该方法的有效性和优越性。此外,该研究还展示了高保真物理模拟器在机器人操作任务中的潜力。

🎯 应用场景

该研究成果可应用于服装制造、家政服务、医疗护理等领域,实现服装的自动化整理和操作。例如,在服装制造过程中,可以利用该技术实现服装的自动翻转和检查。在家政服务领域,可以帮助机器人完成衣物的整理和叠放。在医疗护理领域,可以辅助医护人员进行病患服装的更换。

📄 摘要(原文)

Turning garments right-side out is a challenging manipulation task: it is highly dynamic, entails rapid contact changes, and is subject to severe visual occlusion. We introduce Right-Side-Out, a zero-shot sim-to-real framework that effectively solves this challenge by exploiting task structures. We decompose the task into Drag/Fling to create and stabilize an access opening, followed by Insert&Pull to invert the garment. Each step uses a depth-inferred, keypoint-parameterized bimanual primitive that sharply reduces the action space while preserving robustness. Efficient data generation is enabled by our custom-built, high-fidelity, GPU-parallel Material Point Method (MPM) simulator that models thin-shell deformation and provides robust and efficient contact handling for batched rollouts. Built on the simulator, our fully automated pipeline scales data generation by randomizing garment geometry, material parameters, and viewpoints, producing depth, masks, and per-primitive keypoint labels without any human annotations. With a single depth camera, policies trained entirely in simulation deploy zero-shot on real hardware, achieving up to 81.3% success rate. By employing task decomposition and high fidelity simulation, our framework enables tackling highly dynamic, severely occluded tasks without laborious human demonstrations.