Robot Control Stack: A Lean Ecosystem for Robot Learning at Scale

作者: Tobias Jülg, Pierre Krack, Seongjin Bien, Yannik Blei, Khaled Gamal, Ken Nakahara, Johannes Hechtl, Roberto Calandra, Wolfram Burgard, Florian Walter

分类: cs.RO, cs.LG

发布日期: 2025-09-18

💡 一句话要点

提出机器人控制栈RCS,用于大规模机器人学习的精简生态系统

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 机器人控制栈 机器人学习 视觉-语言-动作模型 sim-to-real 通用策略

📋 核心要点

- 现有机器人软件框架难以满足大规模机器人学习的需求,且仿真环境与真实环境存在较大差距,限制了策略的迁移。

- 提出Robot Control Stack (RCS),一个精简且模块化的机器人控制生态系统,旨在弥合仿真与现实之间的差距,支持大规模通用策略的学习。

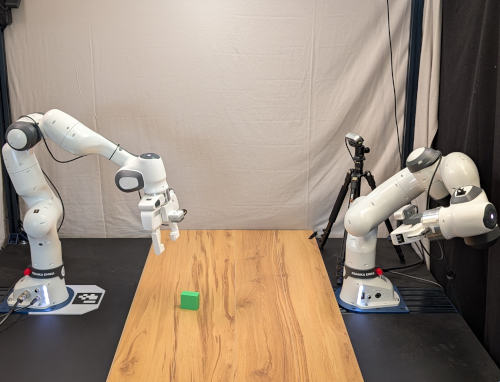

- 通过实验验证了RCS的可用性和性能,并评估了Octo、OpenVLA和Pi Zero在多个机器人上的表现,证明了仿真数据可以提升真实世界策略性能。

📝 摘要(中文)

视觉-语言-动作模型(VLA)标志着机器人学习的重大转变。它们用大规模数据收集和特定设置的微调取代了专家策略的专用架构和任务定制组件。在这种以模型和可扩展训练为中心的机器学习工作流程中,传统的机器人软件框架成为瓶颈,而机器人仿真对从真实世界实验的过渡支持有限。本文介绍了机器人控制栈(RCS),这是一个从头开始设计的精简生态系统,旨在支持大规模通用策略的机器人学习研究。RCS的核心是一个模块化且易于扩展的分层架构,具有用于模拟和物理机器人的统一接口,从而促进了sim-to-real的迁移。尽管其占用空间和依赖性最小,但它提供了完整的功能集,从而可以在仿真中进行真实世界的实验和大规模训练。我们的贡献是双重的:首先,我们介绍了RCS的架构并解释了其设计原则。其次,我们评估了其在VLA和RL策略开发周期中的可用性和性能。我们的实验还对Octo、OpenVLA和Pi Zero在多个机器人上进行了广泛的评估,并阐明了仿真数据如何提高真实世界策略的性能。我们的代码、数据集、权重和视频可在https://robotcontrolstack.github.io/上找到。

🔬 方法详解

问题定义:现有机器人学习框架在处理大规模数据和通用策略时面临瓶颈。传统的机器人软件框架通常是为特定任务定制的,难以适应VLA模型对数据和计算资源的需求。此外,仿真环境与真实环境的差异使得在仿真环境中训练的策略难以直接迁移到真实机器人上。

核心思路:RCS的核心思路是构建一个精简、模块化且易于扩展的机器人控制生态系统,该系统能够统一处理仿真和真实机器人,并支持大规模数据收集和训练。通过提供统一的接口和灵活的架构,RCS旨在降低机器人学习研究的门槛,并促进sim-to-real的迁移。

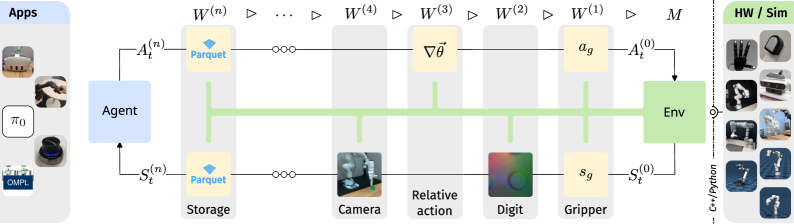

技术框架:RCS采用分层架构,包括硬件抽象层、控制层和应用层。硬件抽象层提供统一的接口,用于与不同类型的机器人进行交互。控制层实现各种控制算法,如运动规划和轨迹跟踪。应用层则构建在控制层之上,用于实现具体的机器人任务。RCS还提供了一套工具,用于数据收集、模型训练和策略部署。

关键创新:RCS的关键创新在于其精简的设计和对大规模机器人学习的优化。与传统的机器人软件框架相比,RCS具有更小的代码库和更少的依赖项,从而降低了维护成本和部署难度。此外,RCS还针对VLA模型的特点进行了优化,例如,支持大规模数据并行训练和高效的sim-to-real迁移。

关键设计:RCS的关键设计包括:1) 统一的机器人接口,允许在仿真和真实机器人之间无缝切换;2) 模块化的架构,方便用户根据自己的需求进行定制和扩展;3) 轻量级的依赖,降低了部署和维护的成本;4) 对大规模数据收集和训练的支持,满足了VLA模型的需求。

🖼️ 关键图片

📊 实验亮点

实验结果表明,RCS能够有效地支持VLA和RL策略的开发。通过RCS,研究人员可以轻松地在仿真环境中训练策略,并将其迁移到真实机器人上。实验还表明,使用仿真数据可以显著提高真实世界策略的性能。例如,通过在仿真环境中进行预训练,可以在真实机器人上获得更高的任务成功率和更快的学习速度。

🎯 应用场景

RCS可应用于各种机器人学习场景,例如,自动驾驶、工业自动化、家庭服务机器人等。它能够加速VLA模型的开发和部署,并促进机器人技术在各个领域的应用。RCS的开源特性也使其成为机器人研究人员和开发人员的理想平台,可以促进社区的合作和创新。

📄 摘要(原文)

Vision-Language-Action models (VLAs) mark a major shift in robot learning. They replace specialized architectures and task-tailored components of expert policies with large-scale data collection and setup-specific fine-tuning. In this machine learning-focused workflow that is centered around models and scalable training, traditional robotics software frameworks become a bottleneck, while robot simulations offer only limited support for transitioning from and to real-world experiments. In this work, we close this gap by introducing Robot Control Stack (RCS), a lean ecosystem designed from the ground up to support research in robot learning with large-scale generalist policies. At its core, RCS features a modular and easily extensible layered architecture with a unified interface for simulated and physical robots, facilitating sim-to-real transfer. Despite its minimal footprint and dependencies, it offers a complete feature set, enabling both real-world experiments and large-scale training in simulation. Our contribution is twofold: First, we introduce the architecture of RCS and explain its design principles. Second, we evaluate its usability and performance along the development cycle of VLA and RL policies. Our experiments also provide an extensive evaluation of Octo, OpenVLA, and Pi Zero on multiple robots and shed light on how simulation data can improve real-world policy performance. Our code, datasets, weights, and videos are available at: https://robotcontrolstack.github.io/