MCGS-SLAM: A Multi-Camera SLAM Framework Using Gaussian Splatting for High-Fidelity Mapping

作者: Zhihao Cao, Hanyu Wu, Li Wa Tang, Zizhou Luo, Zihan Zhu, Wei Zhang, Marc Pollefeys, Martin R. Oswald

分类: cs.RO, cs.CV

发布日期: 2025-09-17 (更新: 2025-10-03)

💡 一句话要点

MCGS-SLAM:基于高斯溅射的多相机SLAM框架,实现高保真地图构建

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 多相机SLAM 高斯溅射 三维重建 捆绑调整 尺度一致性 机器人导航 自动驾驶

📋 核心要点

- 现有稠密SLAM主要集中在单目视觉,但往往牺牲了鲁棒性和几何覆盖范围,难以满足高精度建图需求。

- MCGS-SLAM利用多相机RGB输入,构建基于3D高斯溅射的SLAM系统,通过联合优化位姿和深度,实现高保真地图构建。

- 实验结果表明,MCGS-SLAM在轨迹精度和重建质量上优于单目基线,尤其在侧视区域的重建方面表现突出。

📝 摘要(中文)

本文提出MCGS-SLAM,这是一个完全基于RGB多相机输入的SLAM系统,它构建于3D高斯溅射(3DGS)之上。与依赖稀疏地图或惯性数据的现有方法不同,MCGS-SLAM将来自多个视角的密集RGB输入融合到一个统一的、持续优化的高斯地图中。多相机捆绑调整(MCBA)通过密集的光度和几何残差联合优化位姿和深度,而尺度一致性模块使用低秩先验来强制跨视角的尺度对齐。该系统支持RGB输入,并在大规模场景下保持实时性能。在合成和真实世界数据集上的实验表明,MCGS-SLAM始终产生准确的轨迹和逼真的重建效果,通常优于单目基线。值得注意的是,来自多相机输入的宽视野能够重建单目设置遗漏的侧视区域,这对于安全的自主操作至关重要。这些结果突出了多相机高斯溅射SLAM在机器人和自动驾驶领域高保真地图构建方面的潜力。

🔬 方法详解

问题定义:现有稠密SLAM系统,特别是基于单目视觉的系统,在鲁棒性和几何覆盖范围上存在局限性,难以重建完整的场景几何结构。此外,尺度不确定性也是单目SLAM面临的挑战。

核心思路:利用多相机系统提供的多视角信息,结合3D高斯溅射(3DGS)的强大表达能力,构建一个能够实时优化、高精度重建场景的SLAM系统。通过多视角几何约束和尺度一致性约束,解决单目SLAM的局限性。

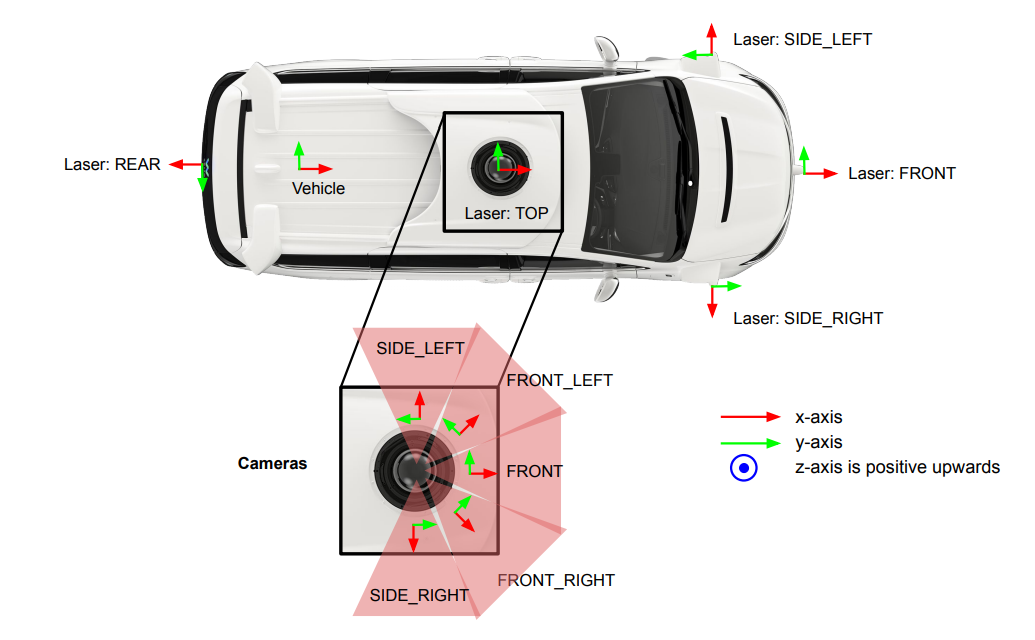

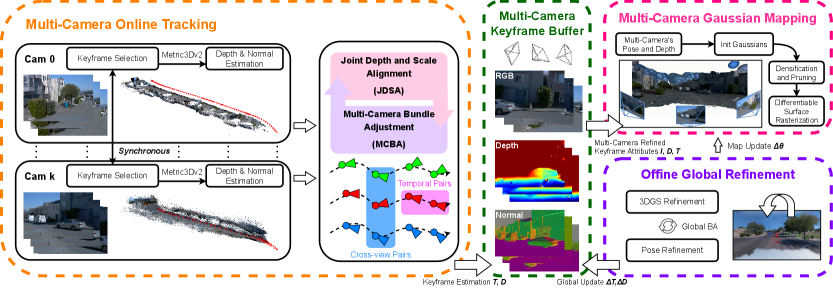

技术框架:MCGS-SLAM包含以下主要模块:1) 多相机数据采集;2) 基于3DGS的场景表示;3) 多相机捆绑调整(MCBA),联合优化相机位姿和3DGS参数;4) 尺度一致性模块,利用低秩先验保证多视角之间的尺度一致性。整个系统以实时性能运行,并持续优化高斯地图。

关键创新:1) 首次将3D高斯溅射应用于多相机SLAM系统,实现高保真场景重建;2) 提出了多相机捆绑调整(MCBA)方法,有效融合多视角信息,提高位姿和深度估计的准确性;3) 设计了尺度一致性模块,利用低秩先验保证多视角之间的尺度一致性,解决了多相机系统中的尺度漂移问题。

关键设计:1) 多相机捆绑调整(MCBA)采用密集光度误差和几何误差作为优化目标,提高优化精度;2) 尺度一致性模块使用低秩先验约束多视角之间的尺度关系,并通过优化算法实现尺度对齐;3) 系统采用高效的3DGS渲染技术,保证实时性能。

🖼️ 关键图片

📊 实验亮点

MCGS-SLAM在合成和真实数据集上进行了评估,结果表明其在轨迹精度和重建质量上均优于单目基线。尤其是在侧视区域的重建方面,MCGS-SLAM能够有效重建单目系统遗漏的区域。实验结果验证了多相机高斯溅射SLAM在高保真地图构建方面的潜力。

🎯 应用场景

MCGS-SLAM在高精度地图构建方面具有显著优势,可应用于机器人导航、自动驾驶、虚拟现实/增强现实等领域。在机器人导航中,可以提供更准确的环境地图,提高导航的可靠性。在自动驾驶中,可以重建更完整的场景几何结构,提高环境感知能力。在VR/AR中,可以创建更逼真的虚拟场景,提升用户体验。

📄 摘要(原文)

Recent progress in dense SLAM has primarily targeted monocular setups, often at the expense of robustness and geometric coverage. We present MCGS-SLAM, the first purely RGB-based multi-camera SLAM system built on 3D Gaussian Splatting (3DGS). Unlike prior methods relying on sparse maps or inertial data, MCGS-SLAM fuses dense RGB inputs from multiple viewpoints into a unified, continuously optimized Gaussian map. A multi-camera bundle adjustment (MCBA) jointly refines poses and depths via dense photometric and geometric residuals, while a scale consistency module enforces metric alignment across views using low-rank priors. The system supports RGB input and maintains real-time performance at large scale. Experiments on synthetic and real-world datasets show that MCGS-SLAM consistently yields accurate trajectories and photorealistic reconstructions, usually outperforming monocular baselines. Notably, the wide field of view from multi-camera input enables reconstruction of side-view regions that monocular setups miss, critical for safe autonomous operation. These results highlight the promise of multi-camera Gaussian Splatting SLAM for high-fidelity mapping in robotics and autonomous driving.