TreeIRL: Safe Urban Driving with Tree Search and Inverse Reinforcement Learning

作者: Momchil S. Tomov, Sang Uk Lee, Hansford Hendrago, Jinwook Huh, Teawon Han, Forbes Howington, Rafael da Silva, Gianmarco Bernasconi, Marc Heim, Samuel Findler, Xiaonan Ji, Alexander Boule, Michael Napoli, Kuo Chen, Jesse Miller, Boaz Floor, Yunqing Hu

分类: cs.RO, cs.AI, cs.LG

发布日期: 2025-09-16 (更新: 2025-10-25)

💡 一句话要点

TreeIRL:结合树搜索与逆强化学习的安全城市自动驾驶规划器

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 自动驾驶 蒙特卡洛树搜索 逆强化学习 运动规划 城市交通

📋 核心要点

- 现有自动驾驶规划方法难以在安全性、效率和类人行为之间取得平衡,尤其是在复杂的城市环境中。

- TreeIRL结合蒙特卡洛树搜索(MCTS)生成候选轨迹,并使用逆强化学习(IRL)对轨迹进行评分,选择最安全且类人的轨迹。

- 在仿真和真实道路测试中,TreeIRL在安全性、行驶效率、舒适性和类人行为方面均优于现有规划器,实现了最佳的整体性能。

📝 摘要(中文)

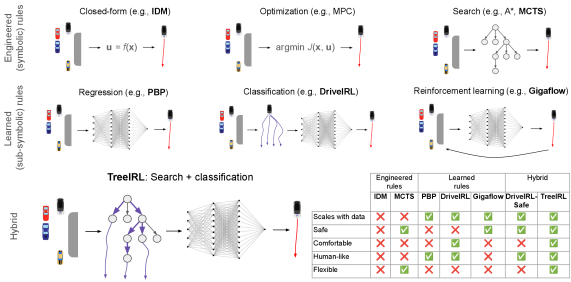

本文提出了一种名为TreeIRL的自动驾驶规划器,它结合了蒙特卡洛树搜索(MCTS)和逆强化学习(IRL),在仿真和真实驾驶中均实现了最先进的性能。核心思想是利用MCTS找到一组有希望的安全候选轨迹,并使用深度IRL评分函数从中选择最像人类驾驶行为的轨迹。我们在大规模仿真以及拉斯维加斯都市区超过500英里的真实自动驾驶中,针对经典和最先进的规划器对TreeIRL进行了评估。测试场景包括密集的城市交通、自适应巡航控制、车辆切入和交通信号灯。TreeIRL实现了最佳的整体性能,在安全性、行驶效率、舒适性和类人行为之间取得了平衡。据我们所知,我们的工作是首次在公共道路上演示基于MCTS的规划,并强调了在各种指标和真实环境中评估规划器的重要性。TreeIRL具有高度的可扩展性,可以通过强化学习和模仿学习进一步改进,从而为探索经典方法和基于学习的方法的不同组合以解决自动驾驶中的规划瓶颈提供了一个框架。

🔬 方法详解

问题定义:自动驾驶规划旨在生成安全、高效且舒适的车辆行驶轨迹。现有方法,如基于规则的规划器,难以适应复杂多变的城市交通环境,而基于学习的规划器,如强化学习,可能存在安全风险且泛化能力有限。因此,如何在复杂城市环境中实现安全、高效且类人的自动驾驶规划是一个关键问题。

核心思路:TreeIRL的核心思路是将蒙特卡洛树搜索(MCTS)的全局搜索能力与逆强化学习(IRL)的类人行为建模能力相结合。MCTS用于生成多个候选轨迹,保证规划的安全性和探索性;IRL则用于学习人类驾驶员的偏好,并对候选轨迹进行评分,选择最符合人类驾驶习惯的轨迹。这种结合既保证了安全性,又提高了规划的自然性和舒适性。

技术框架:TreeIRL的整体框架包含以下几个主要模块:1) 环境模型:用于模拟车辆周围的交通环境,包括其他车辆、行人、交通信号灯等。2) 蒙特卡洛树搜索(MCTS):基于环境模型,通过模拟生成多个候选轨迹。MCTS的搜索过程考虑了车辆的动力学约束和安全约束,确保生成的轨迹是可行的和安全的。3) 逆强化学习(IRL):利用人类驾驶数据学习奖励函数,该奖励函数反映了人类驾驶员的偏好,例如安全性、效率和舒适性。4) 轨迹选择:使用学习到的奖励函数对MCTS生成的候选轨迹进行评分,选择得分最高的轨迹作为最终的规划结果。

关键创新:TreeIRL的关键创新在于将MCTS和IRL有效结合,利用MCTS的全局搜索能力和IRL的类人行为建模能力,实现了安全、高效且类人的自动驾驶规划。与传统的基于规则的规划器相比,TreeIRL能够更好地适应复杂多变的城市交通环境。与纯粹基于学习的规划器相比,TreeIRL通过MCTS保证了规划的安全性。

关键设计:TreeIRL的关键设计包括:1) MCTS的搜索策略:采用了Upper Confidence Bound applied to Trees (UCT)算法,平衡了探索和利用。2) IRL的奖励函数:使用深度神经网络学习奖励函数,输入包括车辆的状态、动作和周围环境信息。3) 安全约束:在MCTS的搜索过程中,加入了安全约束,例如碰撞避免约束和速度限制约束。4) 类人行为建模:通过IRL学习人类驾驶员的偏好,使得规划的轨迹更符合人类驾驶习惯。

🖼️ 关键图片

📊 实验亮点

TreeIRL在仿真和真实道路测试中均取得了显著的成果。在仿真环境中,TreeIRL在安全性、行驶效率、舒适性和类人行为方面均优于现有的规划器。在拉斯维加斯都市区超过500英里的真实道路测试中,TreeIRL成功应对了各种复杂的交通场景,包括密集的城市交通、自适应巡航控制、车辆切入和交通信号灯。实验结果表明,TreeIRL能够有效地平衡安全性、行驶效率、舒适性和类人行为,实现了最佳的整体性能。

🎯 应用场景

TreeIRL具有广泛的应用前景,可用于各种自动驾驶车辆,包括乘用车、卡车和无人巴士。该方法尤其适用于复杂的城市交通环境,可以提高自动驾驶车辆的安全性、效率和舒适性。此外,TreeIRL还可以应用于辅助驾驶系统,帮助驾驶员更好地应对复杂的交通状况。未来,该方法有望成为自动驾驶技术的重要组成部分,推动自动驾驶技术的商业化应用。

📄 摘要(原文)

We present TreeIRL, a novel planner for autonomous driving that combines Monte Carlo tree search (MCTS) and inverse reinforcement learning (IRL) to achieve state-of-the-art performance in simulation and in real-world driving. The core idea is to use MCTS to find a promising set of safe candidate trajectories and a deep IRL scoring function to select the most human-like among them. We evaluate TreeIRL against both classical and state-of-the-art planners in large-scale simulations and on 500+ miles of real-world autonomous driving in the Las Vegas metropolitan area. Test scenarios include dense urban traffic, adaptive cruise control, cut-ins, and traffic lights. TreeIRL achieves the best overall performance, striking a balance between safety, progress, comfort, and human-likeness. To our knowledge, our work is the first demonstration of MCTS-based planning on public roads and underscores the importance of evaluating planners across a diverse set of metrics and in real-world environments. TreeIRL is highly extensible and could be further improved with reinforcement learning and imitation learning, providing a framework for exploring different combinations of classical and learning-based approaches to solve the planning bottleneck in autonomous driving.