RAPTOR: A Foundation Policy for Quadrotor Control

作者: Jonas Eschmann, Dario Albani, Giuseppe Loianno

分类: cs.RO, cs.AI, cs.LG

发布日期: 2025-09-15

💡 一句话要点

RAPTOR:一种用于四旋翼飞行器控制的基础策略,实现零样本泛化。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 四旋翼飞行器控制 强化学习 元学习 模仿学习 零样本学习

📋 核心要点

- 现有基于强化学习的机器人控制系统泛化性差,难以适应仿真到现实的差距以及系统参数的微小变化。

- RAPTOR通过元模仿学习训练一个基础策略,该策略能够通过上下文学习快速适应各种四旋翼飞行器。

- 实验表明,一个小型神经网络策略能够在多种真实四旋翼飞行器上实现零样本自适应控制,并具有良好的鲁棒性。

📝 摘要(中文)

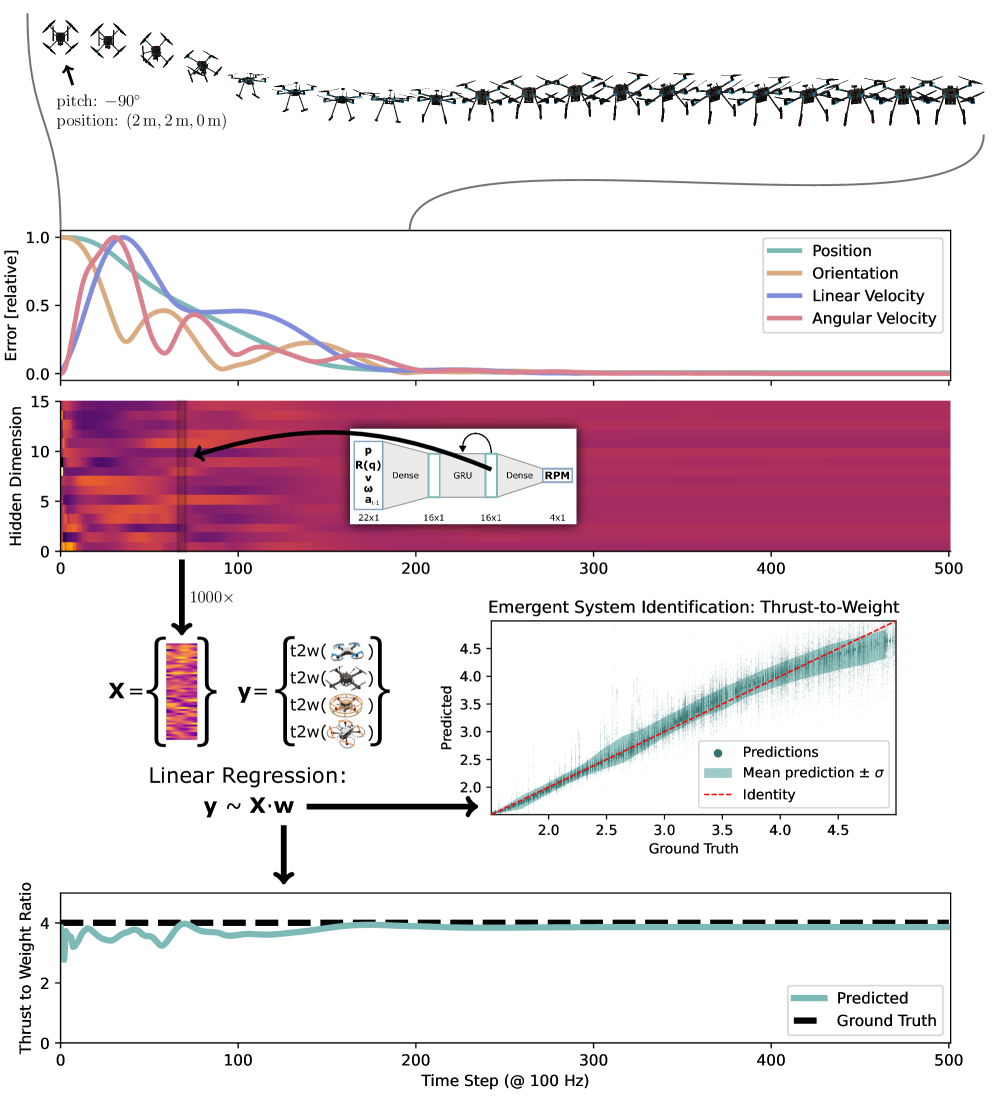

本文提出了一种名为RAPTOR的方法,用于训练高度自适应的四旋翼飞行器控制基础策略。该方法能够训练单个端到端神经网络策略,以控制各种四旋翼飞行器。作者在10种不同的真实四旋翼飞行器上进行了测试,这些飞行器的重量从32克到2.4千克不等,电机类型(有刷与无刷)、框架类型(软与硬)、螺旋桨类型(2/3/4叶)和飞控(PX4/Betaflight/Crazyflie/M5StampFly)也各不相同。实验表明,一个仅有2084个参数的三层策略足以零样本适应各种平台。通过隐藏层的循环机制,实现了上下文学习的适应性。该策略通过一种新颖的元模仿学习算法进行训练,该算法对1000个四旋翼飞行器进行采样,并使用强化学习为每个飞行器训练一个教师策略。随后,1000个教师策略被提炼成一个自适应的学生策略。实验结果表明,所得到的基础策略能够在毫秒内零样本适应未见过的四旋翼飞行器。作者在多种条件下(轨迹跟踪、室内/室外、风扰动、戳刺、不同螺旋桨)广泛测试了该基础策略的能力。

🔬 方法详解

问题定义:现有基于强化学习的四旋翼飞行器控制策略通常针对特定环境和平台进行优化,缺乏泛化能力。即使是微小的系统变化,如电机类型、螺旋桨类型或框架刚度的改变,都可能导致性能显著下降,需要重新进行系统辨识和策略训练。这限制了这些策略在实际应用中的灵活性和可扩展性。

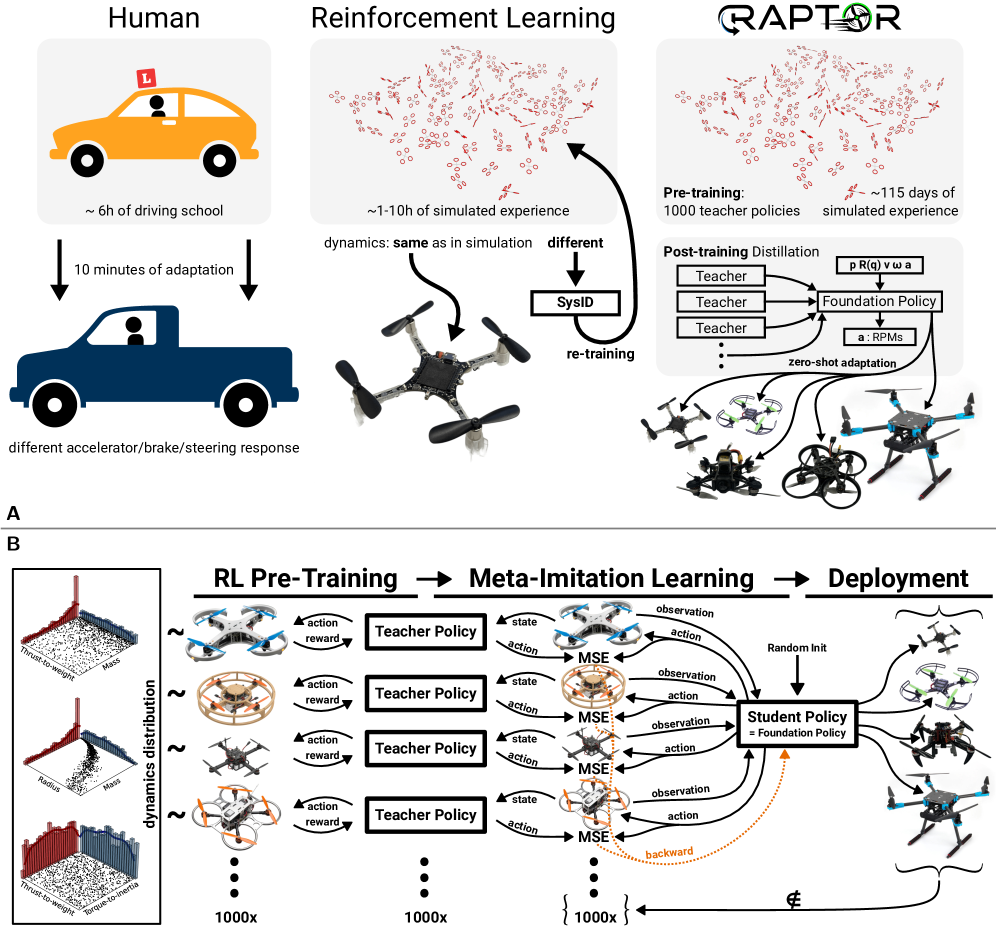

核心思路:RAPTOR的核心思路是训练一个能够快速适应新环境和新平台的基础策略。通过元模仿学习,将大量不同四旋翼飞行器的教师策略知识提炼到一个通用的学生策略中。该学生策略利用循环神经网络的上下文学习能力,根据当前观测到的飞行器状态和历史信息,快速推断出适应当前飞行器的控制策略。

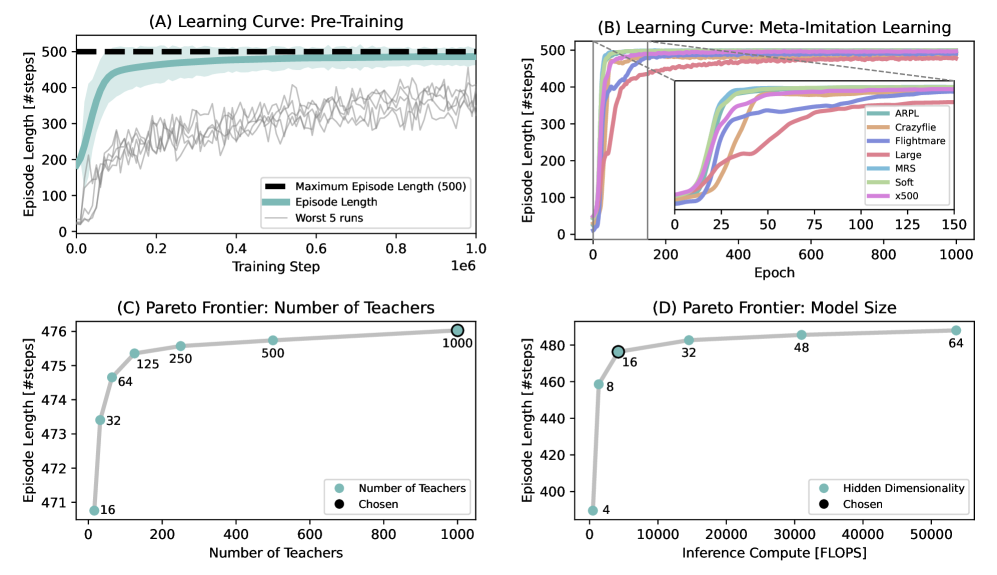

技术框架:RAPTOR的训练流程包括两个主要阶段:首先,对1000个不同的四旋翼飞行器进行采样,并使用强化学习为每个飞行器训练一个教师策略。这些教师策略针对各自的飞行器进行了优化,能够实现良好的控制性能。其次,使用元模仿学习将这些教师策略的知识提炼到一个通用的学生策略中。学生策略是一个小型循环神经网络,它接收飞行器的状态作为输入,并输出控制指令。在训练过程中,学生策略的目标是模仿教师策略的行为,从而学习到适应各种飞行器的能力。

关键创新:RAPTOR的关键创新在于其元模仿学习框架和循环神经网络的应用。元模仿学习使得学生策略能够从大量不同的教师策略中学习到通用的控制知识,而循环神经网络则赋予了学生策略上下文学习的能力,使其能够根据历史信息快速适应新的飞行器。这种结合使得RAPTOR能够实现零样本自适应控制,无需针对每个新的飞行器进行额外的训练。

关键设计:RAPTOR的学生策略是一个三层循环神经网络,仅包含2084个参数。隐藏层使用循环单元,以实现上下文学习。元模仿学习的损失函数包括行为克隆损失和正则化项,以防止过拟合。训练过程中,对1000个四旋翼飞行器的参数进行随机采样,包括质量、惯性矩、电机推力系数等。强化学习使用PPO算法训练教师策略。

🖼️ 关键图片

📊 实验亮点

RAPTOR在10种不同的真实四旋翼飞行器上进行了测试,这些飞行器的参数和配置各不相同。实验结果表明,RAPTOR能够实现零样本自适应控制,无需针对每个新的飞行器进行额外的训练。在轨迹跟踪任务中,RAPTOR能够实现与针对特定飞行器优化的策略相当的性能。此外,RAPTOR还具有良好的鲁棒性,能够抵抗风扰动和外部干扰。

🎯 应用场景

RAPTOR具有广泛的应用前景,可用于快速部署和控制各种四旋翼飞行器,例如在物流、巡检、搜索救援等领域。该方法能够降低对特定平台进行系统辨识和策略训练的需求,提高机器人系统的灵活性和可扩展性。未来,可以将RAPTOR扩展到其他类型的机器人,例如无人车和机械臂。

📄 摘要(原文)

Humans are remarkably data-efficient when adapting to new unseen conditions, like driving a new car. In contrast, modern robotic control systems, like neural network policies trained using Reinforcement Learning (RL), are highly specialized for single environments. Because of this overfitting, they are known to break down even under small differences like the Simulation-to-Reality (Sim2Real) gap and require system identification and retraining for even minimal changes to the system. In this work, we present RAPTOR, a method for training a highly adaptive foundation policy for quadrotor control. Our method enables training a single, end-to-end neural-network policy to control a wide variety of quadrotors. We test 10 different real quadrotors from 32 g to 2.4 kg that also differ in motor type (brushed vs. brushless), frame type (soft vs. rigid), propeller type (2/3/4-blade), and flight controller (PX4/Betaflight/Crazyflie/M5StampFly). We find that a tiny, three-layer policy with only 2084 parameters is sufficient for zero-shot adaptation to a wide variety of platforms. The adaptation through In-Context Learning is made possible by using a recurrence in the hidden layer. The policy is trained through a novel Meta-Imitation Learning algorithm, where we sample 1000 quadrotors and train a teacher policy for each of them using Reinforcement Learning. Subsequently, the 1000 teachers are distilled into a single, adaptive student policy. We find that within milliseconds, the resulting foundation policy adapts zero-shot to unseen quadrotors. We extensively test the capabilities of the foundation policy under numerous conditions (trajectory tracking, indoor/outdoor, wind disturbance, poking, different propellers).