Quantum deep reinforcement learning for humanoid robot navigation task

作者: Romerik Lokossou, Birhanu Shimelis Girma, Ozan K. Tonguz, Ahmed Biyabani

分类: cs.RO

发布日期: 2025-09-14

💡 一句话要点

提出量子深度强化学习(QDRL)用于人形机器人导航,加速复杂环境学习。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 量子深度强化学习 人形机器人导航 参数化量子电路 混合量子-经典计算 Soft Actor-Critic

📋 核心要点

- 经典强化学习在高维、随机环境中面临参数量大和学习效率低下的问题,难以有效训练人形机器人。

- 论文提出量子深度强化学习(QDRL),利用参数化量子电路直接处理高维状态空间,避免传统映射和规划。

- 实验结果表明,量子SAC算法在人形机器人导航任务中,比经典SAC算法在更少的步数下获得更高的平均回报。

📝 摘要(中文)

本研究针对经典强化学习方法在高维复杂环境中参数需求大和随机非确定性挑战,提出了量子深度强化学习(QDRL)以高效训练人形机器人。不同于以往量子强化学习模型侧重于轮式机器人和机械臂等较小环境,本工作率先将QDRL应用于人形机器人,特别是在具有大量观察和动作空间的环境中,如MuJoCo的Humanoid-v4和Walker2d-v4。通过参数化量子电路,探索了一种混合量子-经典设置,以直接导航高维状态空间,绕过传统的映射和规划。通过将量子计算与深度强化学习相结合,旨在开发能够有效学习人形机器人复杂导航任务的模型。评估了经典强化学习中的Soft Actor-Critic (SAC)及其量子实现。结果表明,量子SAC在减少92%的步数后,实现了比经典SAC高8%的平均回报(246.40 vs 228.36),突出了量子计算在强化学习任务中的加速学习潜力。

🔬 方法详解

问题定义:论文旨在解决人形机器人在复杂、高维环境中进行高效导航的问题。现有经典强化学习方法由于参数需求庞大以及环境的随机性和非确定性,在训练人形机器人时面临挑战,导致学习效率低下,难以快速适应复杂环境。

核心思路:论文的核心思路是将量子计算与深度强化学习相结合,利用量子计算的优势来加速强化学习过程。具体而言,通过参数化量子电路(Parameterized Quantum Circuits, PQC)直接处理高维状态空间,从而避免了传统强化学习中复杂的特征工程和状态空间映射过程。这种方法旨在利用量子计算的并行性和量子纠缠等特性,提高学习效率和性能。

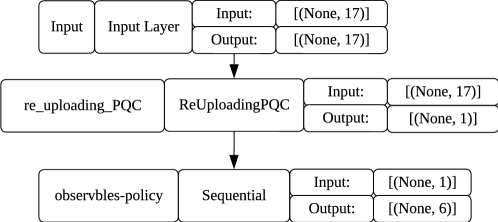

技术框架:整体框架采用混合量子-经典架构。首先,使用经典深度神经网络提取环境的状态特征。然后,将这些特征输入到参数化量子电路中进行处理,得到量子策略。最后,使用经典优化算法(如梯度下降)来更新量子电路的参数,从而优化策略。该框架结合了经典深度学习的特征提取能力和量子计算的策略优化能力。

关键创新:最重要的技术创新点在于将参数化量子电路直接应用于人形机器人的高维状态空间导航任务。与以往量子强化学习主要集中在较小环境(如轮式机器人和机械臂)不同,本研究首次探索了QDRL在复杂人形机器人环境中的应用。此外,通过混合量子-经典架构,充分利用了经典计算和量子计算的优势。

关键设计:论文使用了Soft Actor-Critic (SAC)算法作为基础强化学习算法,并将其量子化。参数化量子电路的具体结构和参数设置(如量子比特数、量子门类型和连接方式)需要根据具体任务进行调整。损失函数的设计也至关重要,需要考虑量子电路的特性和优化目标。此外,如何有效地将经典神经网络的输出映射到量子电路的输入,以及如何将量子电路的输出映射回经典控制信号,也是关键的设计细节。

🖼️ 关键图片

📊 实验亮点

实验结果表明,量子SAC算法在MuJoCo的Humanoid-v4和Walker2d-v4环境中,相比经典SAC算法,在减少92%的训练步数后,获得了更高的平均回报。具体而言,量子SAC的平均回报为246.40,而经典SAC的平均回报为228.36,提升了约8%。这表明量子计算在加速强化学习任务方面具有显著潜力。

🎯 应用场景

该研究成果可应用于人形机器人在复杂环境中的自主导航,例如在灾难救援、医疗辅助、智能家居等领域。通过提高人形机器人的导航效率和适应性,可以使其更好地完成各种任务,提升其在实际应用中的价值。未来,该技术有望扩展到其他类型的机器人和智能体,推动人工智能和机器人技术的进一步发展。

📄 摘要(原文)

Classical reinforcement learning (RL) methods often struggle in complex, high-dimensional environments because of their extensive parameter requirements and challenges posed by stochastic, non-deterministic settings. This study introduces quantum deep reinforcement learning (QDRL) to train humanoid agents efficiently. While previous quantum RL models focused on smaller environments, such as wheeled robots and robotic arms, our work pioneers the application of QDRL to humanoid robotics, specifically in environments with substantial observation and action spaces, such as MuJoCo's Humanoid-v4 and Walker2d-v4. Using parameterized quantum circuits, we explored a hybrid quantum-classical setup to directly navigate high-dimensional state spaces, bypassing traditional mapping and planning. By integrating quantum computing with deep RL, we aim to develop models that can efficiently learn complex navigation tasks in humanoid robots. We evaluated the performance of the Soft Actor-Critic (SAC) in classical RL against its quantum implementation. The results show that the quantum SAC achieves an 8% higher average return (246.40) than the classical SAC (228.36) after 92% fewer steps, highlighting the accelerated learning potential of quantum computing in RL tasks.