RoVerFly: Robust and Versatile Implicit Hybrid Control of Quadrotor-Payload Systems

作者: Mintae Kim, Jiaze Cai, Koushil Sreenath

分类: cs.RO, cs.AI, cs.LG

发布日期: 2025-09-14 (更新: 2025-10-01)

备注: 8 pages, 5 figures

🔗 代码/项目: GITHUB

💡 一句话要点

RoVerFly:四旋翼-负载系统的鲁棒通用隐式混合控制框架

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 四旋翼 负载系统 强化学习 鲁棒控制 隐式混合控制 零样本泛化 领域随机化

📋 核心要点

- 传统四旋翼控制方法难以适应负载变化,需要大量调参,鲁棒性不足。

- RoVerFly采用强化学习,将控制器设计为隐式混合控制器,无需显式模式切换。

- 通过领域随机化训练,RoVerFly在不同负载配置下实现了零样本泛化,无需重新调参。

📝 摘要(中文)

针对四旋翼飞行器精确轨迹跟踪控制的鲁棒性设计面临非线性动力学和欠驱动的挑战,而柔性缆绳悬挂负载进一步增加了自由度和混合动力学,使得问题更加复杂。传统的基于模型的方法虽然提供稳定性保证,但需要大量的调参,并且在配置发生变化时(例如增加或移除负载,或者负载的质量或缆绳长度变化时)通常无法适应。我们提出了RoVerFly,一个统一的基于学习的控制框架,其中单个强化学习(RL)策略充当隐式混合控制器,无需显式模式检测或控制器切换即可管理复杂动力学。通过任务和领域随机化训练,该控制器对扰动和变化的动力学具有弹性。它在各种负载设置(包括无负载以及变化的质量和缆绳长度)中实现了强大的零样本泛化,无需重新调整,同时保留了反馈跟踪控制器的可解释性和结构。代码和补充材料可在https://github.com/mintaeshkim/roverfly获取。

🔬 方法详解

问题定义:论文旨在解决四旋翼飞行器携带缆绳悬挂负载时,精确轨迹跟踪控制的鲁棒性和泛化性问题。现有基于模型的方法需要针对不同的负载质量和缆绳长度进行大量的参数调整,并且在面对外部扰动时表现不佳。此外,显式的混合控制策略需要精确的模式检测和切换,增加了系统的复杂性。

核心思路:论文的核心思路是利用强化学习训练一个隐式混合控制器,该控制器能够自动适应不同的负载配置和外部扰动,而无需显式地进行模式检测或控制器切换。通过领域随机化,控制器可以学习到对各种负载参数和环境变化的鲁棒性。

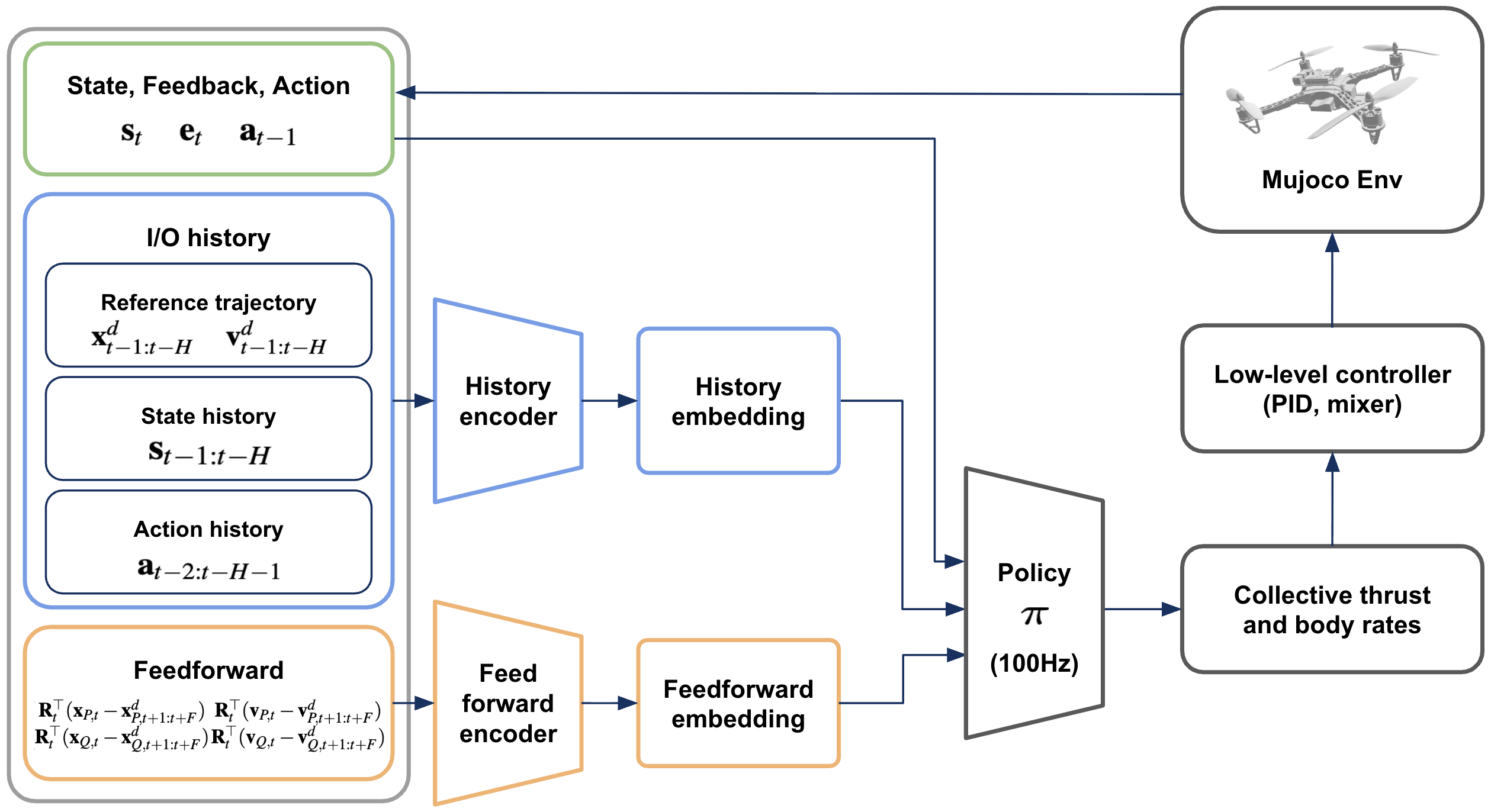

技术框架:RoVerFly框架包含一个强化学习智能体,该智能体直接输出四旋翼的控制指令。智能体在一个模拟环境中进行训练,该环境模拟了四旋翼-负载系统的动力学。为了提高控制器的泛化能力,训练过程中使用了任务和领域随机化技术,即随机改变负载的质量、缆绳长度、环境扰动等参数。训练完成后,控制器可以直接部署到真实的四旋翼飞行器上。

关键创新:RoVerFly的关键创新在于其隐式混合控制策略。传统的混合控制方法需要显式地定义不同的控制模式,并根据系统的状态进行模式切换。而RoVerFly通过强化学习自动学习到一种能够适应不同状态的控制策略,避免了显式的模式检测和切换。此外,通过领域随机化,RoVerFly实现了对不同负载配置的零样本泛化。

关键设计:论文使用了PPO(Proximal Policy Optimization)算法进行强化学习训练。奖励函数的设计考虑了轨迹跟踪误差、控制指令的平滑性以及避免碰撞等因素。网络结构使用了多层感知机(MLP)。领域随机化的参数包括负载质量、缆绳长度、环境风力等。为了提高训练效率,使用了并行训练技术。

🖼️ 关键图片

📊 实验亮点

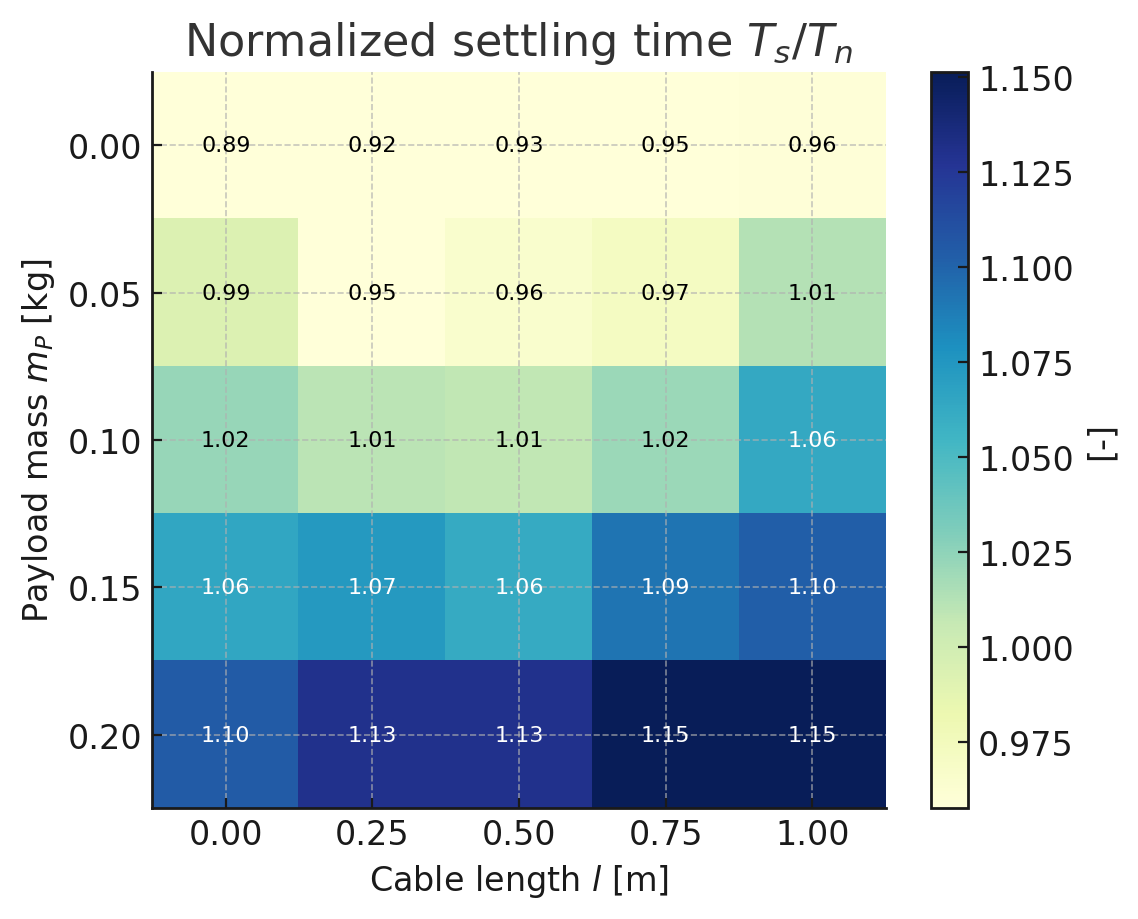

RoVerFly在仿真实验中表现出强大的零样本泛化能力,能够直接应用于不同负载质量和缆绳长度的四旋翼-负载系统,无需重新训练或调整参数。实验结果表明,RoVerFly在轨迹跟踪精度和鲁棒性方面优于传统的PID控制器和其他基于学习的控制器。例如,在面对强风扰动时,RoVerFly能够保持稳定的飞行姿态,而PID控制器则容易失稳。

🎯 应用场景

RoVerFly技术可应用于物流配送、桥梁检测、灾害救援等领域,在这些场景中,四旋翼飞行器需要携带不同质量和形状的负载,并在复杂的环境中执行任务。该技术能够提高飞行器的自主性和鲁棒性,降低人工干预的需求,从而提高工作效率和安全性。未来,该技术还可以扩展到其他类型的机器人系统,例如多足机器人和水下机器人。

📄 摘要(原文)

Designing robust controllers for precise trajectory tracking with quadrotors is challenging due to nonlinear dynamics and underactuation, and becomes harder with flexible cable-suspended payloads that add degrees of freedom and hybrid dynamics. Classical model-based methods offer stability guarantees but require extensive tuning and often fail to adapt when the configuration changes-when a payload is added or removed, or when its mass or cable length varies. We present RoVerFly, a unified learning-based control framework where a single reinforcement learning (RL) policy functions as an implicit hybrid controller, managing complex dynamics without explicit mode detection or controller switching. Trained with task and domain randomization, the controller is resilient to disturbances and varying dynamics. It achieves strong zero-shot generalization across payload settings-including no payload as well as varying mass and cable length-without re-tuning, while retaining the interpretability and structure of a feedback tracking controller. Code and supplementary materials are available at https://github.com/mintaeshkim/roverfly.