SMapper: A Multi-Modal Data Acquisition Platform for SLAM Benchmarking

作者: Pedro Miguel Bastos Soares, Ali Tourani, Miguel Fernandez-Cortizas, Asier Bikandi-Noya, Holger Voos, Jose Luis Sanchez-Lopez

分类: cs.RO

发布日期: 2025-09-11 (更新: 2025-10-10)

备注: 13 pages, 5 figures, 6 tables

DOI: 10.1007/s10846-026-02351-7

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

SMapper:用于SLAM基准测试的多模态数据采集开源平台

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: SLAM 多模态数据 开源硬件 数据集 基准测试 机器人导航 三维重建

📋 核心要点

- 现有SLAM数据集在传感器模态、环境多样性和硬件设置可重复性方面存在局限性。

- SMapper平台通过集成多种传感器(LiDAR、多相机、IMU)并提供精确校准和同步,解决了数据模态单一问题。

- SMapper-light数据集包含室内外场景,并提供亚厘米级精度的真值轨迹,用于SLAM算法的基准测试。

📝 摘要(中文)

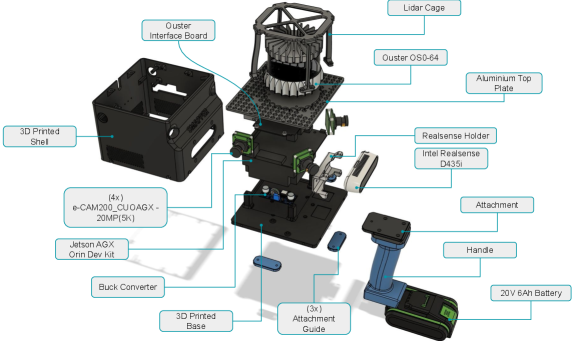

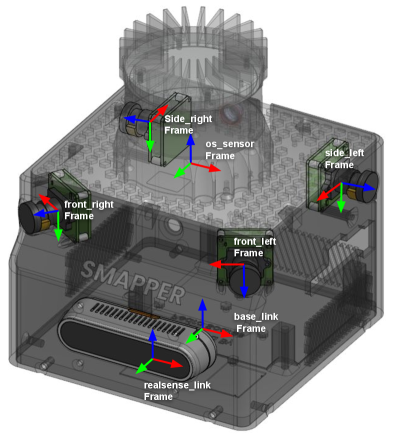

为了推进同步定位与地图构建(SLAM)和自主导航领域的研究,本文提出了一种新型的开源硬件多传感器平台SMapper。该平台集成了同步的激光雷达、多相机和惯性传感器,并配备了强大的校准和同步流程,确保跨模态的精确时空对齐。其开放和可复制的设计允许研究人员扩展其功能,并在手持和机器人安装场景中复现实验。此外,我们发布了SMapper-light,一个包含代表性室内和室外序列的公开SLAM数据集。该数据集包含紧密同步的多模态数据和亚厘米级精度的基于离线激光雷达SLAM的真值轨迹,以及密集的3D重建。论文还包含使用SMapper-light数据集对最先进的激光雷达和视觉SLAM框架进行的基准测试结果。通过结合开源硬件设计、可重复的数据收集和全面的基准测试,SMapper为推进SLAM算法的开发、评估和可重复性奠定了坚实的基础。

🔬 方法详解

问题定义:现有的SLAM数据集通常在传感器模态、环境多样性和硬件设置的可重复性方面存在不足。这限制了SLAM算法的开发、评估和比较。缺乏高质量、多模态、可复现的数据集是SLAM研究面临的一个主要痛点。

核心思路:SMapper的核心思路是构建一个开源、可复制的多传感器平台,并提供配套的数据集和基准测试。通过开放硬件设计,鼓励研究人员扩展和定制平台,从而促进SLAM算法的创新和可重复性。

技术框架:SMapper平台包含以下主要模块:1) 多传感器集成:集成了LiDAR、多相机和IMU等多种传感器。2) 精确校准和同步:提供强大的校准和同步流程,确保跨模态数据的精确时空对齐。3) 数据集采集:采集了包含室内和室外场景的多模态数据集SMapper-light。4) 基准测试:使用SMapper-light数据集对现有的SLAM算法进行基准测试。

关键创新:SMapper的关键创新在于其开源硬件设计和可复制的数据采集流程。这使得研究人员可以轻松地构建自己的SMapper平台,并生成具有精确真值轨迹的多模态数据集。此外,SMapper-light数据集的发布也为SLAM算法的基准测试提供了一个新的平台。与现有数据集相比,SMapper更注重可重复性和可扩展性。

关键设计:SMapper平台的设计考虑了传感器的选择、安装位置和数据同步。校准流程采用了标准方法,但针对多传感器融合进行了优化。数据集的采集过程中,使用了高精度的激光雷达SLAM算法生成真值轨迹。SMapper-light数据集包含了多种室内和室外场景,以评估SLAM算法在不同环境下的性能。

🖼️ 关键图片

📊 实验亮点

论文发布了SMapper-light数据集,包含室内和室外场景的多模态数据,并提供了亚厘米级精度的真值轨迹。通过对现有SLAM算法进行基准测试,验证了SMapper平台和数据集的有效性。实验结果表明,SMapper-light数据集可以用于评估SLAM算法在不同环境下的性能。

🎯 应用场景

SMapper平台和数据集可广泛应用于机器人导航、自动驾驶、三维重建、虚拟现实等领域。它为SLAM算法的开发、评估和比较提供了一个可靠的平台,有助于推动这些领域的技术进步。未来,SMapper可以扩展到更多的传感器和应用场景,例如水下机器人、无人机等。

📄 摘要(原文)

Advancing research in fields such as Simultaneous Localization and Mapping (SLAM) and autonomous navigation critically depends on the availability of reliable and reproducible multimodal datasets. While several influential datasets have driven progress in these domains, they often suffer from limitations in sensing modalities, environmental diversity, and the reproducibility of the underlying hardware setups. To address these challenges, this paper introduces SMapper, a novel open-hardware, multi-sensor platform designed explicitly for, though not limited to, SLAM research. The device integrates synchronized LiDAR, multi-camera, and inertial sensing, supported by a robust calibration and synchronization pipeline that ensures precise spatio-temporal alignment across modalities. Its open and replicable design allows researchers to extend its capabilities and reproduce experiments across both handheld and robot-mounted scenarios. To demonstrate its practicality, we additionally release SMapper-light, a publicly available SLAM dataset containing representative indoor and outdoor sequences. The dataset includes tightly synchronized multimodal data and ground truth trajectories derived from offline LiDAR-based SLAM with sub-centimeter accuracy, alongside dense 3D reconstructions. Furthermore, the paper contains benchmarking results on state-of-the-art LiDAR and visual SLAM frameworks using the SMapper-light dataset. By combining open-hardware design, reproducible data collection, and comprehensive benchmarking, SMapper establishes a robust foundation for advancing SLAM algorithm development, evaluation, and reproducibility. The project's documentation, including source code, CAD models, and dataset links, is publicly available at https://snt-arg.github.io/smapper_docs.