CLAP: Clustering to Localize Across n Possibilities, A Simple, Robust Geometric Approach in the Presence of Symmetries

作者: Gabriel I. Fernandez, Ruochen Hou, Alex Xu, Colin Togashi, Dennis W. Hong

分类: cs.RO

发布日期: 2025-09-10

💡 一句话要点

CLAP:一种基于聚类的鲁棒几何定位方法,解决对称场景下的定位问题

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 机器人定位 聚类算法 鲁棒性 立体视觉 惯性导航

📋 核心要点

- 现有定位方法在光照变化、特征遮挡和噪声干扰下鲁棒性不足,难以满足复杂环境下的机器人定位需求。

- CLAP通过聚类来自多个特征的机器人状态估计,区分正确和错误估计,从而实现对噪声和错误输入的鲁棒性。

- 实验表明,CLAP在精度上与其他方法相当,但在高误报率下表现出更强的鲁棒性,减少了发散和速度跳跃。

📝 摘要(中文)

本文提出了一种名为CLAP(Clustering to Localize Across $n$ Possibilities)的定位方法,该方法助力我们在RoboCup 2024成人尺寸人形机器人足球比赛中获胜。比赛规则限制我们只能使用立体视觉和惯性传感器,类似于人类。此外,我们的机器人必须应对不同的光照条件、动态特征遮挡、高强度步进产生的噪声以及来自旁观者和邻近场地的错误特征。因此,我们需要一种准确且最重要的是鲁棒的定位算法,作为路径规划和博弈策略算法的基础。CLAP通过对来自场地特征对的机器人估计状态进行聚类,从而定位其全局位置和方向,满足了这些要求。正确的状态估计自然地聚集在一起,而错误的估计则分散开来,这使得CLAP能够抵抗噪声和错误的输入。CLAP与粒子滤波器和扩展卡尔曼滤波器相结合,以提高一致性和平滑性。与其他基于地标的定位方法的测试表明,CLAP具有相似的精度。然而,增加误报特征检测的测试表明,CLAP在鲁棒性方面优于其他方法,发散和速度跳跃非常小。我们的定位在比赛中表现良好,使我们的机器人能够射门远距离目标并严密防守我们的目标。

🔬 方法详解

问题定义:论文旨在解决在具有对称性的复杂环境中,机器人利用有限的传感器(立体视觉和惯性传感器)进行鲁棒定位的问题。现有方法在光照变化、动态遮挡、噪声干扰以及误检特征存在的情况下,容易出现定位精度下降甚至发散的问题,无法满足足球机器人等实时性要求高的应用场景。

核心思路:CLAP的核心思路是利用多个地标特征对机器人状态进行估计,然后通过聚类算法将正确的状态估计与错误的状态估计区分开来。正确的状态估计由于对应于真实的位置,因此会在状态空间中聚集在一起,而错误的估计则会分散开来。通过识别和利用这些聚集的正确状态估计,可以实现鲁棒的定位。

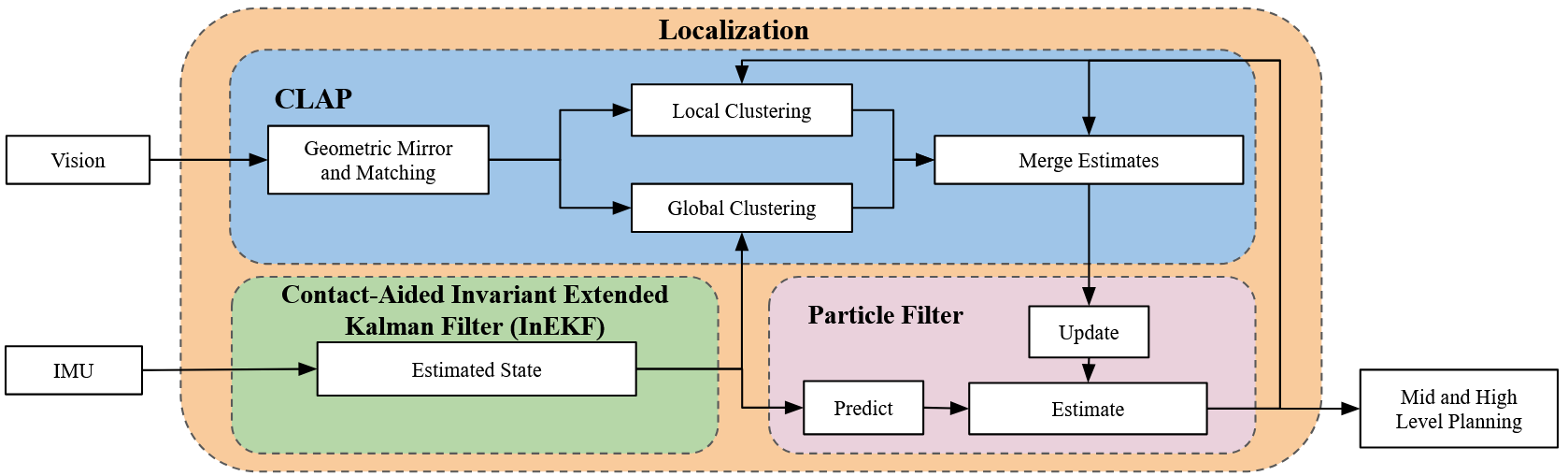

技术框架:CLAP的整体框架包括以下几个主要步骤:1) 利用立体视觉和惯性传感器获取环境特征信息;2) 基于特征对计算机器人状态的多个可能估计;3) 使用聚类算法对这些状态估计进行分组;4) 识别最大的聚类,并将其中心作为机器人的最终状态估计;5) 将CLAP的输出与粒子滤波器和扩展卡尔曼滤波器结合,以进一步提高定位的平滑性和一致性。

关键创新:CLAP的关键创新在于其利用聚类算法来过滤错误的状态估计,从而提高定位的鲁棒性。与传统的基于滤波的定位方法不同,CLAP不需要对环境和传感器噪声进行精确建模,而是通过数据驱动的方式来识别和排除错误信息。这种方法对于处理复杂和动态的环境非常有效。

关键设计:CLAP的关键设计包括:1) 使用特征对进行状态估计,以提高定位的精度;2) 选择合适的聚类算法(例如,DBSCAN或K-means)来区分正确和错误的状态估计;3) 设计合适的距离度量,用于衡量状态估计之间的相似性;4) 调整聚类算法的参数,以优化定位的性能。论文中没有明确说明具体的参数设置和损失函数,这部分信息未知。

🖼️ 关键图片

📊 实验亮点

实验结果表明,CLAP算法在精度上与其他基于地标的定位方法相当。更重要的是,在高误报率的特征检测场景下,CLAP算法表现出更强的鲁棒性,能够有效抑制定位结果的发散和速度跳跃。这表明CLAP算法在实际应用中具有更高的可靠性和稳定性,尤其是在传感器数据质量较差的情况下。

🎯 应用场景

CLAP算法具有广泛的应用前景,可应用于机器人足球、自动驾驶、无人机导航等领域。尤其是在环境复杂、传感器噪声大、存在对称性的场景下,CLAP的鲁棒性优势将更加明显。该算法的成功应用将有助于提高机器人的自主性和适应性,使其能够在更具挑战性的环境中完成任务。

📄 摘要(原文)

In this paper, we present our localization method called CLAP, Clustering to Localize Across $n$ Possibilities, which helped us win the RoboCup 2024 adult-sized autonomous humanoid soccer competition. Competition rules limited our sensor suite to stereo vision and an inertial sensor, similar to humans. In addition, our robot had to deal with varying lighting conditions, dynamic feature occlusions, noise from high-impact stepping, and mistaken features from bystanders and neighboring fields. Therefore, we needed an accurate, and most importantly robust localization algorithm that would be the foundation for our path-planning and game-strategy algorithms. CLAP achieves these requirements by clustering estimated states of our robot from pairs of field features to localize its global position and orientation. Correct state estimates naturally cluster together, while incorrect estimates spread apart, making CLAP resilient to noise and incorrect inputs. CLAP is paired with a particle filter and an extended Kalman filter to improve consistency and smoothness. Tests of CLAP with other landmark-based localization methods showed similar accuracy. However, tests with increased false positive feature detection showed that CLAP outperformed other methods in terms of robustness with very little divergence and velocity jumps. Our localization performed well in competition, allowing our robot to shoot faraway goals and narrowly defend our goal.