Sample-Efficient Online Control Policy Learning with Real-Time Recursive Model Updates

作者: Zixin Zhang, James Avtges, Todd D. Murphey

分类: cs.RO, eess.SY

发布日期: 2025-09-10

💡 一句话要点

提出递归Koopman学习(RKL),解决数据驱动控制中样本效率和实时更新问题。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: Koopman理论 递归学习 数据驱动控制 样本效率 实时控制 非线性系统 模型更新

📋 核心要点

- 传统数据驱动控制方法需要大量数据,且难以实时更新模型,限制了其在动态环境中的性能。

- RKL基于Koopman理论,将非线性系统线性化,并递归更新模型,实现高效的样本利用和快速模型调整。

- 实验表明,RKL在样本效率和稳定性方面优于基准方法,仅需少量数据即可实现有效的控制器合成。

📝 摘要(中文)

本文提出了一种高效的、基于Koopman理论的数据驱动控制方法,称为递归Koopman学习(RKL)。该方法旨在解决数据驱动控制在样本效率和实时模型更新方面的挑战,尤其是在数据获取和计算资源受限的硬件学习环境中。RKL利用Koopman理论将非线性系统表示为可观测量的线性模型,并采用优化友好的方式从数据中确定Koopman表示,从而实现快速的模型更新。论文提供了模型收敛的充分条件,并进行了算法分析,证明RKL具有轻量级和快速的特点,其复杂度与数据集大小无关。在模拟的平面二连杆机械臂和具有软执行器的混合非线性硬件系统上的实验结果表明,实时递归Koopman模型更新提高了数据驱动控制器合成的样本效率和稳定性,所需数据量仅为基准方法的10%。该方法的高性能C++代码已开源。

🔬 方法详解

问题定义:现有数据驱动控制方法在样本效率和实时模型更新方面存在不足,尤其是在硬件平台上进行学习时,数据获取和计算资源往往受限。这些方法通常需要大量数据才能训练出有效的模型,并且难以适应动态变化的环境。因此,如何设计一种样本效率高、计算量小、能够实时更新模型的控制策略学习方法是一个关键问题。

核心思路:本文的核心思路是利用Koopman理论将非线性系统表示为线性系统,从而简化控制器的设计和学习过程。Koopman理论通过将状态空间映射到高维可观测空间,使得非线性动力学可以在该空间中近似线性化。此外,论文采用递归的方式更新Koopman模型,使其能够快速适应环境变化,提高控制器的鲁棒性。

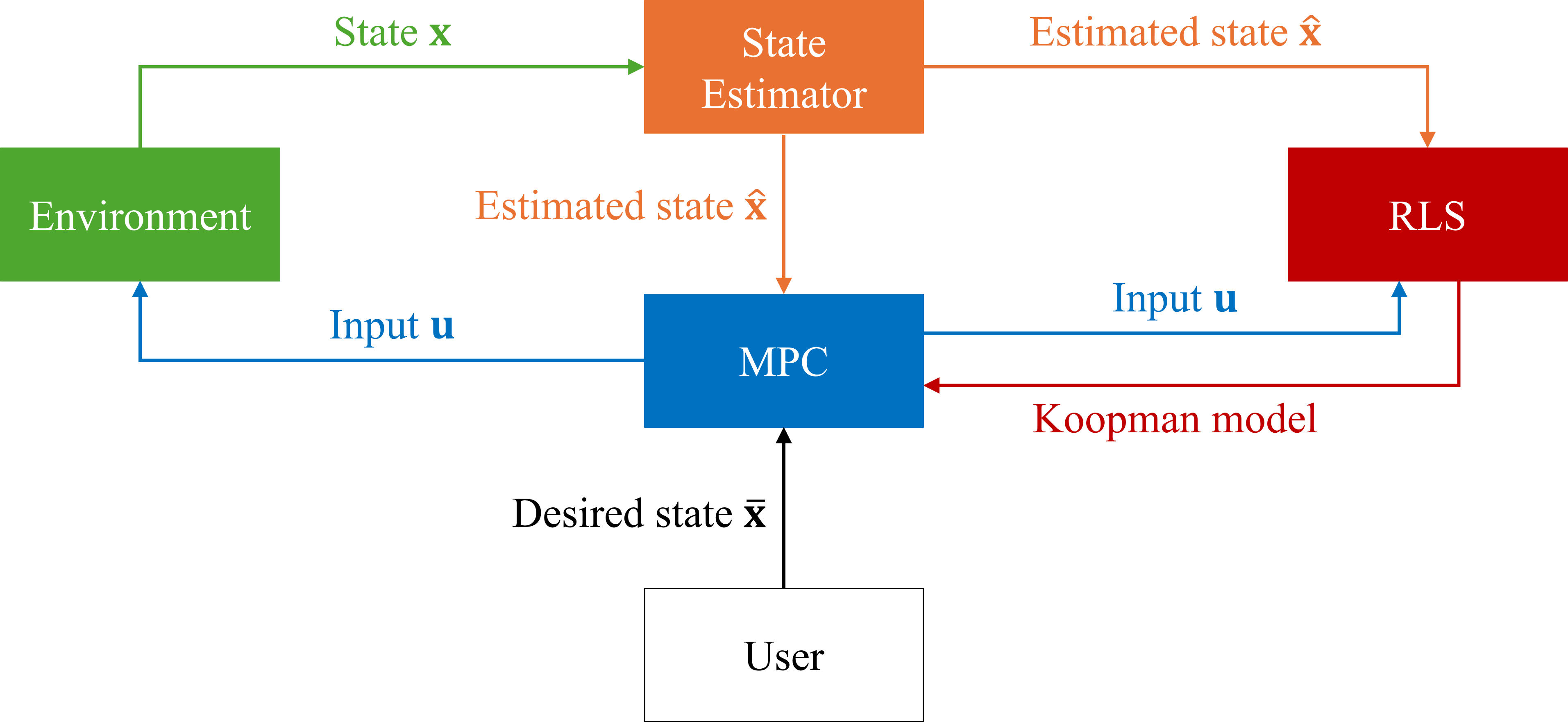

技术框架:RKL的学习流程主要包括以下几个阶段:1) 数据采集:从系统中采集状态和控制输入数据;2) Koopman模型学习:利用采集到的数据,通过递归最小二乘法或其他优化方法,估计Koopman算子;3) 控制器设计:基于学习到的Koopman模型,设计线性控制器,例如LQR或MPC;4) 控制器执行:将设计的控制器应用于实际系统,并不断采集新的数据,用于更新Koopman模型。

关键创新:RKL的关键创新在于将Koopman理论与递归学习相结合,实现了一种样本效率高、实时性强的控制策略学习方法。与传统的Koopman方法相比,RKL能够在线更新模型,适应环境变化。与其他的递归学习方法相比,RKL利用Koopman理论将非线性系统线性化,简化了学习过程,提高了学习效率。

关键设计:RKL的关键设计包括:1) 可观测函数的选择:选择合适的可观测函数对于Koopman模型的性能至关重要。论文可能采用多项式、径向基函数或其他非线性函数作为可观测函数;2) 递归最小二乘法:采用递归最小二乘法在线估计Koopman算子,并根据新采集到的数据不断更新模型;3) 正则化:为了防止过拟合,论文可能采用L1或L2正则化方法,约束Koopman算子的参数。

🖼️ 关键图片

📊 实验亮点

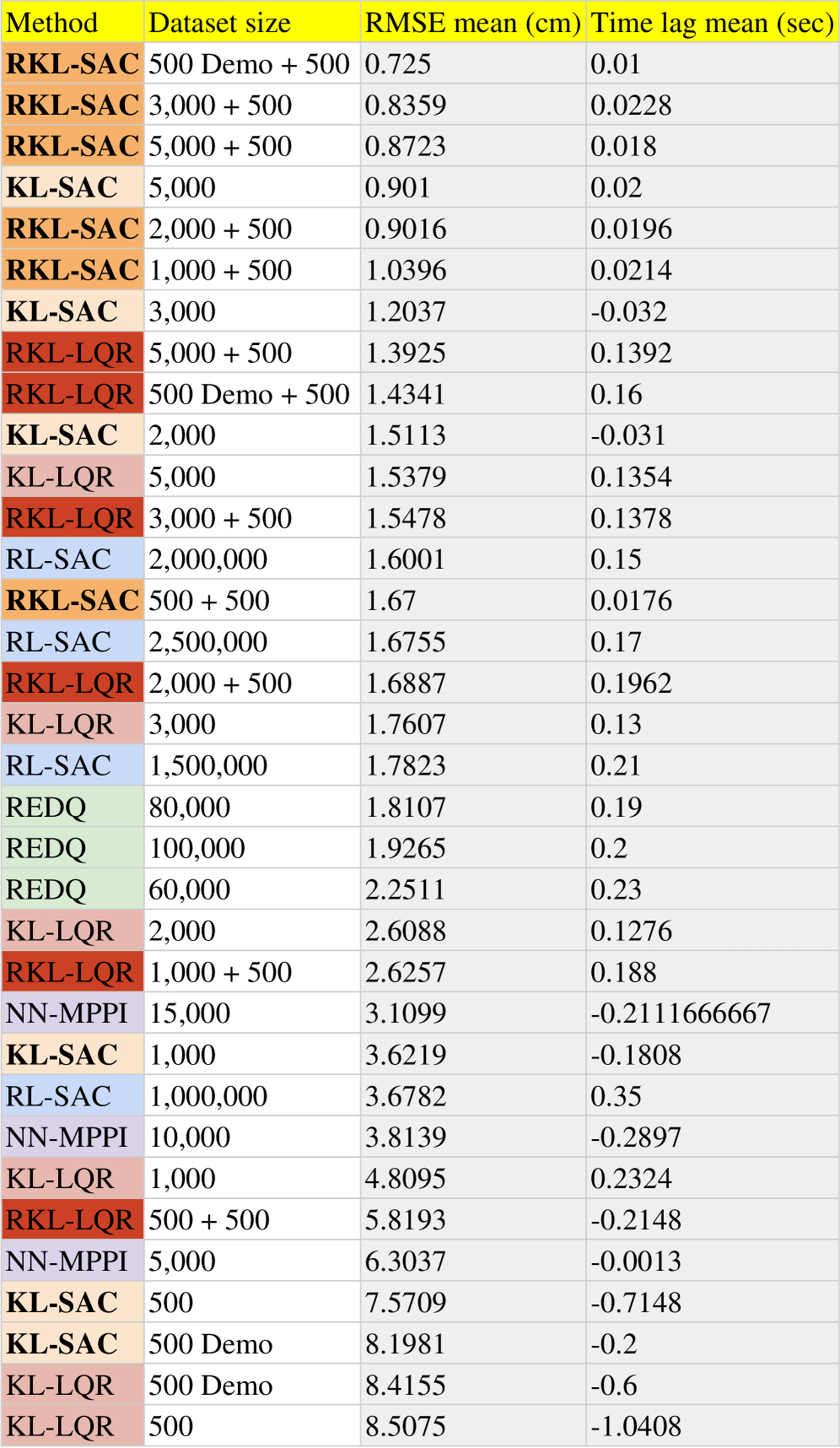

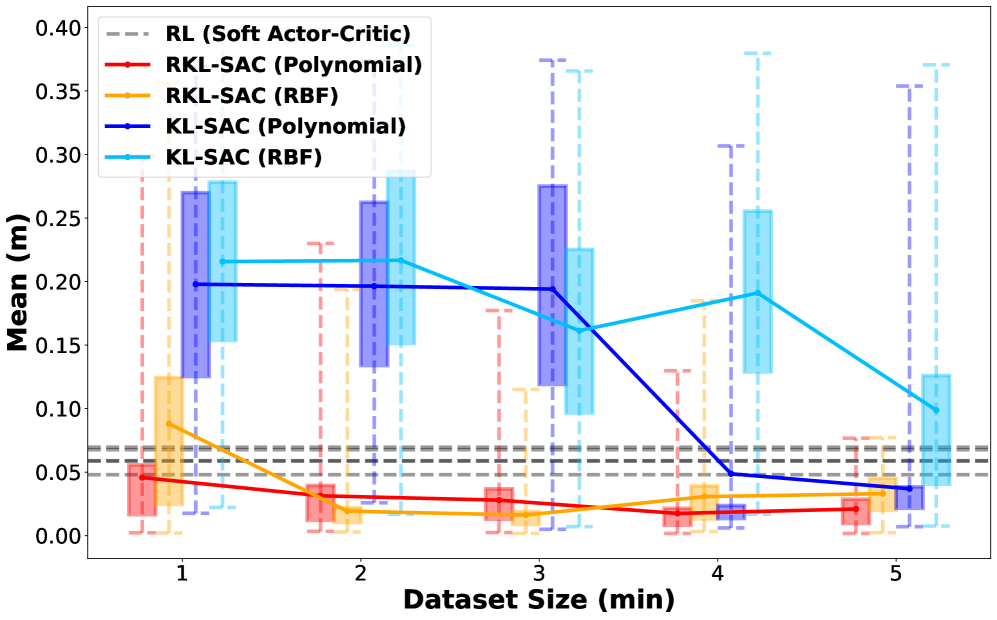

实验结果表明,RKL在平面二连杆机械臂和具有软执行器的混合非线性硬件系统上均取得了显著的性能提升。与基准方法相比,RKL仅需10%的数据即可实现相当甚至更好的控制性能,验证了其样本效率优势。此外,实验还表明,RKL能够实时更新模型,适应环境变化,提高了控制器的鲁棒性和稳定性。

🎯 应用场景

RKL具有广泛的应用前景,例如机器人控制、无人机控制、自动驾驶、过程控制等领域。特别是在资源受限的环境中,如小型机器人或嵌入式系统,RKL的样本效率和实时性优势更加明显。该方法可以用于开发自适应控制器,使其能够根据环境变化自动调整控制策略,提高系统的鲁棒性和性能。未来,RKL可以与其他机器学习方法相结合,例如强化学习,进一步提高控制器的学习效率和泛化能力。

📄 摘要(原文)

Data-driven control methods need to be sample-efficient and lightweight, especially when data acquisition and computational resources are limited -- such as during learning on hardware. Most modern data-driven methods require large datasets and struggle with real-time updates of models, limiting their performance in dynamic environments. Koopman theory formally represents nonlinear systems as linear models over observables, and Koopman representations can be determined from data in an optimization-friendly setting with potentially rapid model updates. In this paper, we present a highly sample-efficient, Koopman-based learning pipeline: Recursive Koopman Learning (RKL). We identify sufficient conditions for model convergence and provide formal algorithmic analysis supporting our claim that RKL is lightweight and fast, with complexity independent of dataset size. We validate our method on a simulated planar two-link arm and a hybrid nonlinear hardware system with soft actuators, showing that real-time recursive Koopman model updates improve the sample efficiency and stability of data-driven controller synthesis -- requiring only <10% of the data compared to benchmarks. The high-performance C++ codebase is open-sourced. Website: https://www.zixinatom990.com/home/robotics/corl-2025-recursive-koopman-learning.