Deep Visual Odometry for Stereo Event Cameras

作者: Sheng Zhong, Junkai Niu, Yi Zhou

分类: cs.RO

发布日期: 2025-09-10

💡 一句话要点

提出Stereo-DEVO,解决事件相机在HDR低光照下的高精度、实时视觉里程计问题。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 事件相机 视觉里程计 深度学习 立体视觉 高动态范围

📋 核心要点

- 现有基于事件的视觉里程计在低光照HDR条件下,数据关联的可靠性不足,限制了其在机器人领域的应用。

- Stereo-DEVO利用深度学习克服上述挑战,通过静态立体关联策略进行稀疏深度估计,并集成到紧耦合的BA优化中。

- 该系统在多个数据集上表现出优越的性能,尤其是在夜间HDR场景中,并能实时处理VGA分辨率的事件数据。

📝 摘要(中文)

本文提出了一种基于学习的立体事件视觉里程计(Stereo-DEVO)。该系统基于Deep Event Visual Odometry (DEVO),引入了一种新颖高效的静态立体关联策略,用于稀疏深度估计,且几乎没有额外的计算负担。通过将其集成到紧耦合的捆绑调整(BA)优化方案中,并受益于循环网络通过基于体素的事件表示执行精确光流估计以建立可靠的patch关联的能力,该系统实现了度量尺度下的高精度位姿估计。与DEVO的离线性能相比,该系统可以实时处理VGA分辨率的事件数据。在多个公共真实世界数据集和自采集数据上的广泛评估证明了该系统的通用性,表明其性能优于最先进的基于事件的VO方法。更重要的是,该系统即使在大型夜间HDR场景中也能实现稳定的位姿估计。

🔬 方法详解

问题定义:现有基于事件相机的视觉里程计方法,特别是依赖手工设计数据关联的方法,在低光照、高动态范围(HDR)环境下表现不佳。这些环境下的动态范围巨大,信噪比在时间和空间上变化剧烈,导致数据关联的可靠性降低,进而影响位姿估计的精度和稳定性。

核心思路:本文的核心思路是利用深度学习来克服传统方法的局限性。具体来说,通过学习事件数据中的模式,实现更鲁棒的光流估计和数据关联。同时,利用立体视觉信息来提供深度信息,并将其融入到紧耦合的优化框架中,从而提高位姿估计的精度和鲁棒性。

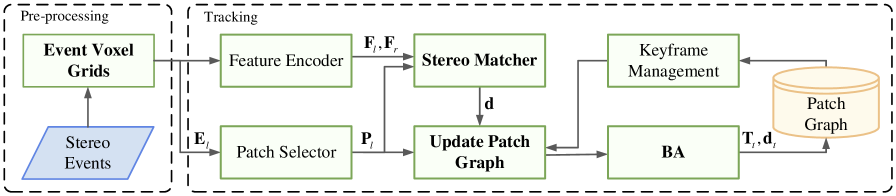

技术框架:Stereo-DEVO系统建立在DEVO的基础上,主要包含以下几个模块:1) 基于体素的事件表示:将事件数据转换为体素网格表示,以便于神经网络处理。2) 循环神经网络:使用循环神经网络(RNN)来估计事件体素之间的光流。3) 静态立体关联:引入一种新的静态立体关联策略,用于稀疏深度估计。4) 紧耦合捆绑调整(BA):将光流估计和深度估计集成到BA优化框架中,以实现高精度的位姿估计。

关键创新:该论文的关键创新在于:1) 提出了一种新颖且高效的静态立体关联策略,用于稀疏深度估计,且计算负担很小。2) 将该策略集成到紧耦合的BA优化框架中,充分利用了立体视觉信息和光流估计。3) 系统能够实时处理VGA分辨率的事件数据,使其更适用于实际应用。

关键设计:该系统使用循环神经网络来估计光流,网络的具体结构未知,但强调了其在建立可靠的patch关联中的作用。静态立体关联策略的具体实现细节未知,但强调了其高效性。损失函数和BA优化的具体细节未知。

🖼️ 关键图片

📊 实验亮点

Stereo-DEVO在多个公开数据集和自采集数据集上进行了评估,结果表明其性能优于现有的基于事件的视觉里程计方法。更重要的是,该系统即使在大型夜间HDR场景中也能实现稳定的位姿估计,并且能够实时处理VGA分辨率的事件数据。具体性能提升的数据未知,但强调了其在HDR环境下的稳定性和实时性。

🎯 应用场景

该研究成果可应用于机器人、自动驾驶、无人机等领域,尤其是在光照条件恶劣或动态范围大的场景下,例如夜间导航、隧道巡检、高动态范围环境下的视觉SLAM等。该系统能够提供更准确、更鲁棒的位姿估计,从而提高机器人的自主导航能力和环境感知能力。未来,该技术有望进一步推动事件相机在实际场景中的应用。

📄 摘要(原文)

Event-based cameras are bio-inspired sensors with pixels that independently and asynchronously respond to brightness changes at microsecond resolution, offering the potential to handle state estimation tasks involving motion blur and high dynamic range (HDR) illumination conditions. However, the versatility of event-based visual odometry (VO) relying on handcrafted data association (either direct or indirect methods) is still unreliable, especially in field robot applications under low-light HDR conditions, where the dynamic range can be enormous and the signal-to-noise ratio is spatially-and-temporally varying. Leveraging deep neural networks offers new possibilities for overcoming these challenges. In this paper, we propose a learning-based stereo event visual odometry. Building upon Deep Event Visual Odometry (DEVO), our system (called Stereo-DEVO) introduces a novel and efficient static-stereo association strategy for sparse depth estimation with almost no additional computational burden. By integrating it into a tightly coupled bundle adjustment (BA) optimization scheme, and benefiting from the recurrent network's ability to perform accurate optical flow estimation through voxel-based event representations to establish reliable patch associations, our system achieves high-precision pose estimation in metric scale. In contrast to the offline performance of DEVO, our system can process event data of \zs{Video Graphics Array} (VGA) resolution in real time. Extensive evaluations on multiple public real-world datasets and self-collected data justify our system's versatility, demonstrating superior performance compared to state-of-the-art event-based VO methods. More importantly, our system achieves stable pose estimation even in large-scale nighttime HDR scenarios.