T-araVLN: Translator for Agricultural Robotic Agents on Vision-and-Language Navigation

作者: Xiaobei Zhao, Xingqi Lyu, Xiang Li

分类: cs.RO

发布日期: 2025-09-08 (更新: 2025-09-18)

🔗 代码/项目: GITHUB

💡 一句话要点

提出T-araVLN,通过指令翻译提升农业机器人视觉语言导航性能

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 农业机器人 视觉语言导航 指令翻译 机器人导航 自然语言处理

📋 核心要点

- 现有农业机器人视觉语言导航方法难以理解复杂指令,限制了其在实际农业场景中的应用。

- T-araVLN通过指令翻译模块,将原始指令转化为更精确的形式,从而提升机器人对复杂指令的理解能力。

- 在A2A基准测试中,T-araVLN显著提高了导航成功率并降低了导航误差,验证了其有效性。

📝 摘要(中文)

农业机器人正在成为各种农业任务的强大助手,但仍然严重依赖于手动操作或固定轨道进行移动。为了解决这个限制,AgriVLN方法和A2A基准率先将视觉语言导航(VLN)扩展到农业领域,使机器人能够按照自然语言指令导航到目标位置。AgriVLN能够有效地理解简单的指令,但经常误解复杂的指令。为了弥合这一差距,我们提出了一种用于农业机器人视觉语言导航的翻译器方法(T-araVLN),其中指令翻译模块将原始指令翻译得更加精炼和精确。在A2A基准上进行评估时,我们的T-araVLN有效地将成功率从0.47提高到0.63,并将导航误差从2.91米降低到2.28米,展示了在农业领域的最先进性能。

🔬 方法详解

问题定义:论文旨在解决农业机器人视觉语言导航(VLN)中,现有方法难以理解复杂指令的问题。现有方法在处理简单指令时表现良好,但面对更复杂、更细致的指令时,导航性能会显著下降,这限制了农业机器人在复杂农业环境中的应用。

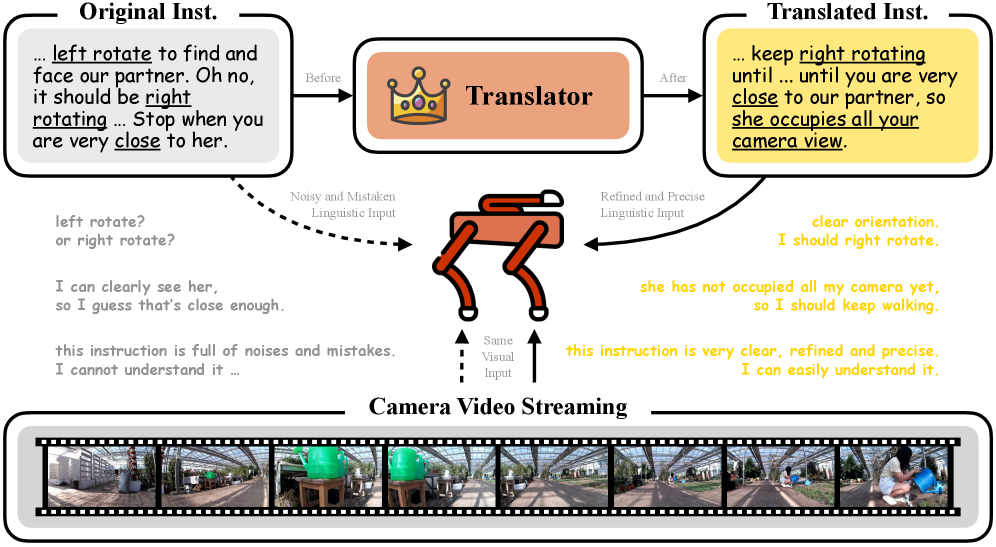

核心思路:论文的核心思路是通过引入一个指令翻译模块,将原始的复杂指令转化为更精炼、更精确的表达形式。这种翻译后的指令更易于机器人理解和执行,从而提高导航的准确性和成功率。作者认为,原始指令的模糊性和歧义性是导致导航失败的主要原因,因此通过翻译可以消除这些问题。

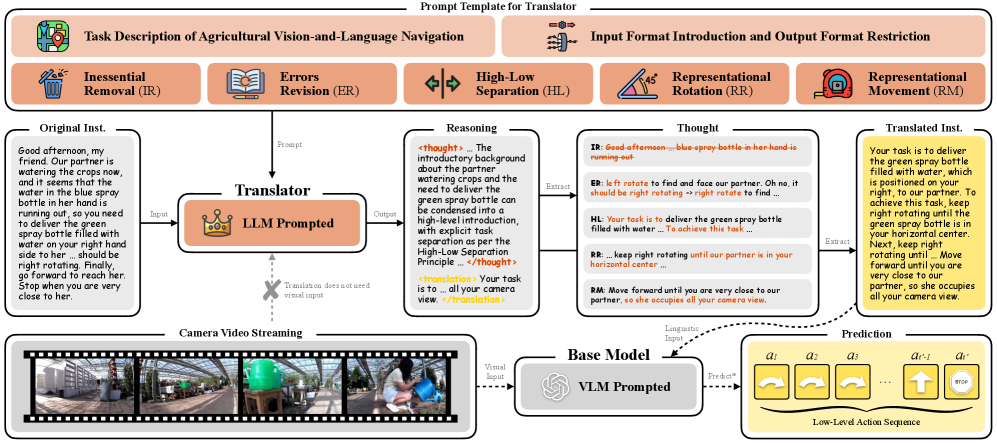

技术框架:T-araVLN的整体框架包含三个主要模块:视觉感知模块、语言理解模块和指令翻译模块。视觉感知模块负责从环境中提取视觉信息,语言理解模块负责解析自然语言指令,而指令翻译模块则负责将原始指令转化为更精确的表达。这三个模块协同工作,使机器人能够根据自然语言指令在农业环境中进行导航。具体流程是,首先通过视觉感知模块获取环境信息,然后通过语言理解模块解析用户输入的自然语言指令,接着指令翻译模块将原始指令翻译成更精炼的指令,最后机器人根据翻译后的指令进行导航。

关键创新:T-araVLN的关键创新在于指令翻译模块的设计。该模块能够自动地将原始指令转化为更精确、更易于理解的形式。与现有方法相比,T-araVLN不是直接使用原始指令进行导航,而是先对指令进行“提纯”和“精炼”,从而提高了导航的鲁棒性和准确性。这种指令翻译的思想可以有效地解决复杂指令带来的歧义性问题。

关键设计:指令翻译模块的具体实现细节未知,论文中可能没有详细描述其内部结构和算法。但是,可以推测该模块可能使用了某种形式的序列到序列模型(如Transformer)或基于规则的翻译方法。损失函数和网络结构等技术细节也未知,需要参考论文的补充材料或代码才能进一步了解。

🖼️ 关键图片

📊 实验亮点

T-araVLN在A2A基准测试中取得了显著的性能提升。具体而言,成功率从0.47提高到0.63,提升了约34%;导航误差从2.91米降低到2.28米,降低了约21%。这些数据表明,T-araVLN能够更准确地理解复杂指令,并引导机器人在农业环境中进行更精确的导航。该结果证明了指令翻译模块的有效性,并为农业机器人视觉语言导航领域的研究提供了新的思路。

🎯 应用场景

T-araVLN技术可应用于多种农业场景,例如自动驾驶收割、精准喷洒农药、田间巡检等。通过自然语言指令,农民可以轻松地指挥机器人完成各种任务,无需专业的编程知识。该技术有望降低农业生产成本,提高生产效率,并促进农业智能化发展。未来,该技术还可以扩展到其他机器人导航领域,例如仓储物流、家庭服务等。

📄 摘要(原文)

Agricultural robotic agents have been becoming powerful helpers in a wide range of agricultural tasks, however, still heavily rely on manual operation or fixed railways for movement. To address this limitation, the AgriVLN method and the A2A benchmark pioneeringly extend Vision-and-Language Navigation (VLN) to the agricultural domain, enabling agents to navigate to the target positions following the natural language instructions. AgriVLN effectively understands the simple instructions, but often misunderstands the complex ones. To bridge this gap, we propose the method of Translator for Agricultural Robotic Agents on Vision-and-Language Navigation (T-araVLN), in which the Instruction Translator module translates the original instruction to be more refined and precise. When evaluated on the A2A benchmark, our T-araVLN effectively improves Success Rate from 0.47 to 0.63 and reduces Navigation Error from 2.91m to 2.28m, demonstrating the state-of-the-art performance in the agricultural domain. Code: https://github.com/AlexTraveling/T-araVLN.