Learning to Walk in Costume: Adversarial Motion Priors for Aesthetically Constrained Humanoids

作者: Arturo Flores Alvarez, Fatemeh Zargarbashi, Havel Liu, Shiqi Wang, Liam Edwards, Jessica Anz, Alex Xu, Fan Shi, Stelian Coros, Dennis W. Hong

分类: cs.RO, cs.AI, eess.SY

发布日期: 2025-09-06

备注: 8 pages, 11 figures, accepted at IEEE-RAS International Conference on Humanoid Robots (Humanoids) 2025

💡 一句话要点

针对审美约束人形机器人,提出基于对抗运动先验的强化学习步态控制方法

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱八:物理动画 (Physics-based Animation)

关键词: 强化学习 对抗运动先验 人形机器人 运动控制 领域随机化

📋 核心要点

- 传统人形机器人设计通常不考虑审美因素,而娱乐机器人则面临审美与功能性之间的权衡难题。

- 论文提出使用对抗运动先验(AMP)的强化学习方法,使机器人学习自然运动,同时保持物理稳定。

- 实验表明,该方法能使头部质量占比过大的Cosmo机器人实现稳定的站立和行走,验证了方法的有效性。

📝 摘要(中文)

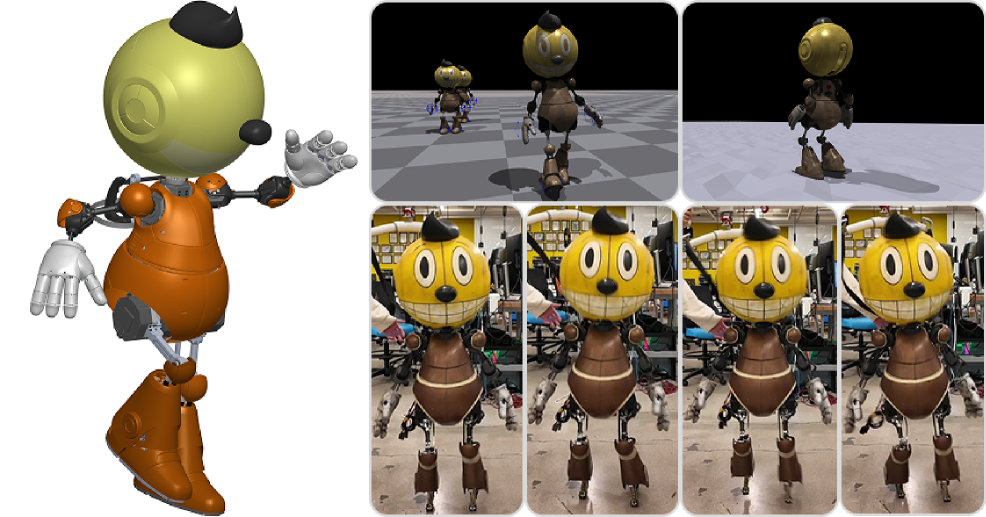

本文提出了一种基于强化学习(RL)的运动系统,用于Cosmo,这是一款专为娱乐应用而定制的人形机器人。与传统人形机器人不同,娱乐机器人由于审美驱动的设计选择而面临独特的挑战。Cosmo体现了这些挑战,其头部不成比例地大(占总质量的16%),传感能力有限,并且保护壳大大限制了运动。为了应对这些挑战,我们应用对抗运动先验(AMP),使机器人能够在保持物理稳定性的同时学习自然外观的运动。我们开发了定制的领域随机化技术和专门的奖励结构,以确保安全的从仿真到现实的迁移,从而在部署期间保护有价值的硬件组件。我们的实验表明,尽管Cosmo具有极端的质量分布和运动约束,AMP仍能生成稳定的站立和行走行为。这些结果为平衡审美吸引力与功能性能的机器人建立了一个有希望的方向,表明基于学习的方法可以有效地适应审美驱动的设计约束。

🔬 方法详解

问题定义:论文旨在解决审美驱动设计约束下的人形机器人运动控制问题。现有方法难以兼顾机器人的美观性和运动性能,尤其是在机器人具有非典型质量分布和运动限制时,传统的控制方法可能无法有效地生成稳定且自然的运动。

核心思路:论文的核心思路是利用对抗运动先验(AMP)来引导强化学习过程,从而使机器人能够学习到既美观又稳定的运动策略。通过模仿参考运动数据,AMP可以约束学习到的运动轨迹,使其更接近人类或动物的自然运动模式,同时利用强化学习优化控制策略,以适应机器人的物理特性和环境。

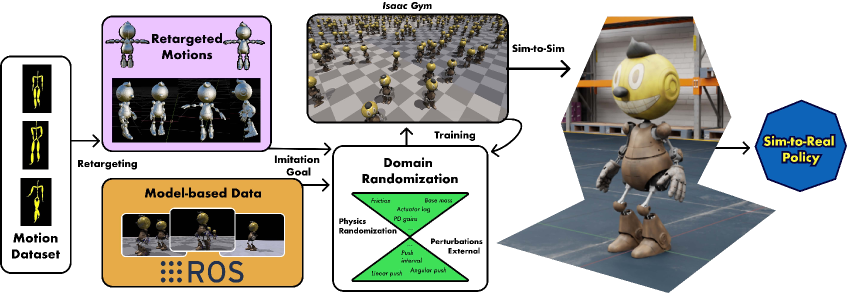

技术框架:整体框架包括以下几个主要模块:1) 运动捕捉数据:收集人类或动物的运动数据作为参考运动。2) 对抗运动先验(AMP):使用判别器来区分机器人生成的运动和参考运动,并使用生成器(强化学习智能体)来生成更接近参考运动的运动。3) 强化学习:使用强化学习算法(例如PPO)来训练智能体,使其能够根据环境状态和奖励函数生成控制指令。4) 领域随机化:在仿真环境中随机化机器人的物理参数和环境条件,以提高策略的泛化能力。5) Sim-to-Real迁移:将训练好的策略迁移到真实机器人上。

关键创新:论文的关键创新在于将对抗运动先验与强化学习相结合,从而能够在审美约束下学习到自然且稳定的运动。与传统的强化学习方法相比,AMP可以有效地利用参考运动数据,加速学习过程并提高运动质量。此外,论文还针对娱乐机器人的特点,设计了定制的领域随机化技术和奖励函数,以提高策略的鲁棒性和安全性。

关键设计:关键设计包括:1) 判别器网络结构:用于区分机器人运动和参考运动,通常采用卷积神经网络或循环神经网络。2) 奖励函数设计:包括生存奖励、运动奖励、模仿奖励和惩罚项,用于引导智能体学习期望的运动行为。3) 领域随机化参数:包括质量分布、摩擦系数、关节阻尼等,用于提高策略的泛化能力。4) 强化学习算法选择:例如PPO,用于优化控制策略。

🖼️ 关键图片

📊 实验亮点

实验结果表明,在Cosmo机器人上,使用AMP的强化学习方法能够生成稳定的站立和行走行为,尽管Cosmo的头部质量占比高达16%,且运动受到限制。与没有使用AMP的方法相比,该方法能够更快地学习到自然的运动,并且具有更好的鲁棒性。实验还验证了定制的领域随机化技术和奖励函数在Sim-to-Real迁移中的有效性。

🎯 应用场景

该研究成果可应用于娱乐机器人、虚拟角色动画、康复机器人等领域。通过学习自然运动,机器人可以更好地与人类互动,提高用户体验。在虚拟现实和游戏领域,该方法可以生成更逼真的角色动画。在康复领域,可以帮助患者恢复运动能力,提高生活质量。此外,该方法也为其他具有审美约束的机器人设计提供了参考。

📄 摘要(原文)

We present a Reinforcement Learning (RL)-based locomotion system for Cosmo, a custom-built humanoid robot designed for entertainment applications. Unlike traditional humanoids, entertainment robots present unique challenges due to aesthetic-driven design choices. Cosmo embodies these with a disproportionately large head (16% of total mass), limited sensing, and protective shells that considerably restrict movement. To address these challenges, we apply Adversarial Motion Priors (AMP) to enable the robot to learn natural-looking movements while maintaining physical stability. We develop tailored domain randomization techniques and specialized reward structures to ensure safe sim-to-real, protecting valuable hardware components during deployment. Our experiments demonstrate that AMP generates stable standing and walking behaviors despite Cosmo's extreme mass distribution and movement constraints. These results establish a promising direction for robots that balance aesthetic appeal with functional performance, suggesting that learning-based methods can effectively adapt to aesthetic-driven design constraints.