Learning Tool-Aware Adaptive Compliant Control for Autonomous Regolith Excavation

作者: Andrej Orsula, Matthieu Geist, Miguel Olivares-Mendez, Carol Martinez

分类: cs.RO, cs.AI, cs.LG

发布日期: 2025-09-05

备注: The source code is available at https://github.com/AndrejOrsula/space_robotics_bench

💡 一句话要点

提出工具感知自适应柔顺控制,用于月球土壤自主挖掘

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 月球土壤挖掘 强化学习 自适应柔顺控制 程序生成 机器人 原位资源利用 工具感知

📋 核心要点

- 月球土壤自主挖掘面临颗粒介质交互复杂和工具多样性的挑战。

- 提出基于模型的强化学习框架,通过动态调节刚度和阻尼学习自适应交互策略。

- 实验表明,程序化工具分布训练和视觉反馈增强显著提升了任务成功率和泛化能力。

📝 摘要(中文)

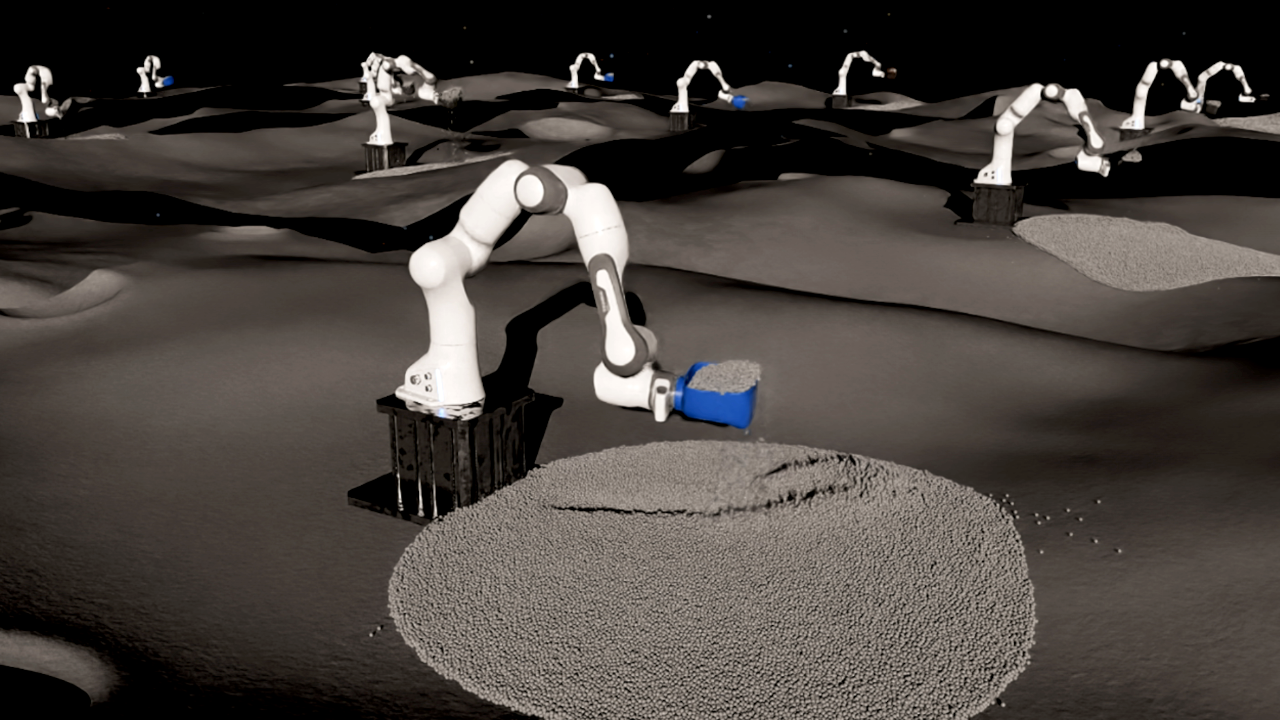

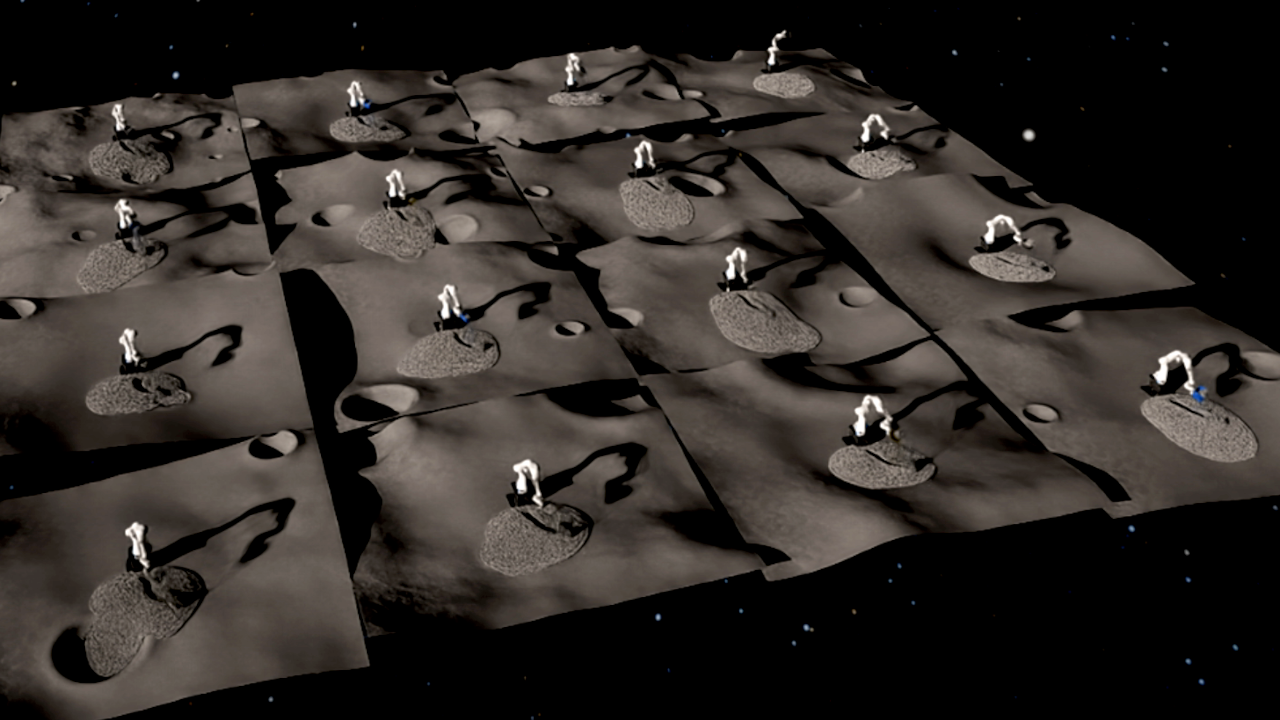

自主月球土壤挖掘是在地球以外维持人类长期存在所需的原位资源利用的关键。然而,这项任务受到颗粒介质复杂交互动力学以及机器人使用各种工具的操作需求的根本限制。为了应对这些挑战,本文提出了一个框架,其中基于模型的强化学习智能体在并行仿真中进行学习。该环境利用高保真粒子物理和程序生成来创建月球地形和挖掘工具几何形状的广泛分布。为了掌握这种多样性,智能体通过操作空间控制动态调节其自身刚度和阻尼,从而学习自适应交互策略。实验表明,使用工具的程序分布进行训练对于泛化至关重要,并能够开发复杂的工具感知行为。此外,视觉反馈的增强显著提高了任务成功率。这些结果代表了一种经过验证的方法,用于开发未来太空任务基础任务所需的鲁棒且通用的自主系统。

🔬 方法详解

问题定义:论文旨在解决月球土壤自主挖掘任务中,由于土壤的复杂物理特性(如颗粒性、非均质性)以及挖掘工具的多样性,导致机器人难以精确控制和高效作业的问题。现有方法通常依赖于预定义的控制策略,难以适应不同的土壤条件和工具类型,泛化能力较差。

核心思路:论文的核心思路是利用强化学习,让机器人通过与环境的交互自主学习挖掘策略。关键在于,机器人能够根据当前使用的工具类型和环境状态,自适应地调整其自身的刚度和阻尼,从而实现柔顺控制,更好地适应土壤的复杂特性。通过程序化生成大量的工具和地形,增强模型的泛化能力。

技术框架:整体框架包括一个基于高保真粒子物理引擎的并行仿真环境和一个强化学习智能体。仿真环境负责生成各种月球地形和挖掘工具,并模拟机器人与土壤的交互。强化学习智能体通过观察环境状态(包括工具类型、视觉信息等),输出控制指令,控制机器人的运动和柔顺参数(刚度和阻尼)。智能体通过与环境的交互,不断优化其控制策略。

关键创新:最重要的技术创新点在于工具感知的自适应柔顺控制。传统的柔顺控制方法通常使用固定的刚度和阻尼参数,难以适应不同的工具和土壤条件。本文提出的方法能够根据当前使用的工具类型和环境状态,动态地调整刚度和阻尼,从而实现更精确和高效的挖掘。此外,使用程序化生成技术来创建大量的训练数据,显著提高了模型的泛化能力。

关键设计:论文使用了一种基于模型的强化学习算法,具体算法未知。关键设计包括:1) 使用高保真粒子物理引擎来模拟土壤的物理特性;2) 使用程序化生成技术来创建大量的月球地形和挖掘工具;3) 设计合适的奖励函数,鼓励机器人高效地完成挖掘任务;4) 使用视觉信息作为智能体的输入,帮助其更好地理解环境状态;5) 通过操作空间控制动态调节刚度和阻尼。

🖼️ 关键图片

📊 实验亮点

实验结果表明,使用程序化工具分布进行训练能够显著提高模型的泛化能力,使机器人能够适应不同的挖掘工具。此外,视觉反馈的加入进一步提高了任务成功率。具体性能数据未知,但论文强调了工具感知和视觉反馈对于提升挖掘性能的重要性。

🎯 应用场景

该研究成果可应用于月球和其他星球的资源开采,为未来的太空任务提供自主挖掘能力。此外,该方法也可推广到其他需要与复杂环境交互的机器人任务中,例如农业机器人、建筑机器人等。通过自适应柔顺控制,机器人能够更好地适应环境变化,提高作业效率和安全性。

📄 摘要(原文)

Autonomous regolith excavation is a cornerstone of in-situ resource utilization for a sustained human presence beyond Earth. However, this task is fundamentally hindered by the complex interaction dynamics of granular media and the operational need for robots to use diverse tools. To address these challenges, this work introduces a framework where a model-based reinforcement learning agent learns within a parallelized simulation. This environment leverages high-fidelity particle physics and procedural generation to create a vast distribution of both lunar terrains and excavation tool geometries. To master this diversity, the agent learns an adaptive interaction strategy by dynamically modulating its own stiffness and damping at each control step through operational space control. Our experiments demonstrate that training with a procedural distribution of tools is critical for generalization and enables the development of sophisticated tool-aware behavior. Furthermore, we show that augmenting the agent with visual feedback significantly improves task success. These results represent a validated methodology for developing the robust and versatile autonomous systems required for the foundational tasks of future space missions.