Imitation Learning Based on Disentangled Representation Learning of Behavioral Characteristics

作者: Ryoga Oishi, Sho Sakaino, Toshiaki Tsuji

分类: cs.RO

发布日期: 2025-09-05

备注: 16 pages, 5 figures, Accepted at CoRL2025

💡 一句话要点

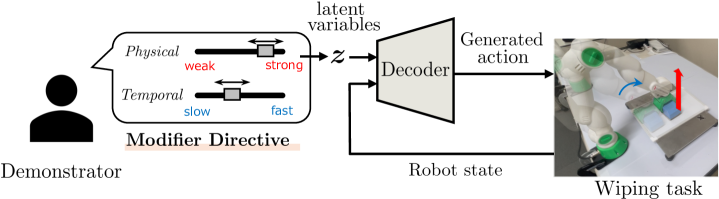

提出基于解耦表征学习的模仿学习方法,实现机器人动作对人类指令的在线适应

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱四:生成式动作 (Generative Motion) 支柱七:动作重定向 (Motion Retargeting) 支柱八:物理动画 (Physics-based Animation)

关键词: 模仿学习 解耦表征学习 机器人动作生成 人类指令 在线调整

📋 核心要点

- 现有方法难以使机器人动作适应人类指令,因为人类指令通常是定性的,需要探索满足各种条件的行为。

- 该论文提出一种运动生成模型,通过学习从修饰语指令到动作的映射,使机器人动作能够响应人类指令进行在线调整。

- 在擦拭和抓取放置任务中的实验结果表明,该方法能够根据修饰语指令在线调整动作,优于传统的批处理方法。

📝 摘要(中文)

在机器人学习领域,通过语言指令协调机器人动作正变得越来越可行。然而,使动作适应人类指令仍然具有挑战性,因为这些指令通常是定性的,并且需要探索满足各种条件的行为。本文提出了一种运动生成模型,该模型可以根据人类指令中的修饰语指令(modifier directives)来调整机器人动作,这些指令在任务执行期间施加行为条件。该方法通过将演示分割成短序列,并分配对应于特定修饰语类型的弱监督标签,来学习从修饰语指令到动作的映射。我们在擦拭和抓取放置任务中评估了该方法。结果表明,与传统的基于批处理的方法(无法在执行期间进行调整)不同,该方法可以响应修饰语指令在线调整动作。

🔬 方法详解

问题定义:现有机器人学习方法难以根据人类指令(特别是包含行为条件的修饰语指令)在线调整机器人动作。传统的基于批处理的方法无法在执行过程中适应指令的变化,限制了机器人的灵活性和适应性。因此,需要一种能够理解并响应人类指令,实时调整机器人行为的方法。

核心思路:该论文的核心思路是将人类指令中的修饰语指令(modifier directives)与机器人动作联系起来,通过学习一个从修饰语指令到动作的映射,使机器人能够根据指令在线调整其行为。这种方法通过解耦行为特征,使得机器人能够理解不同修饰语指令所代表的不同行为条件,并将其转化为相应的动作。

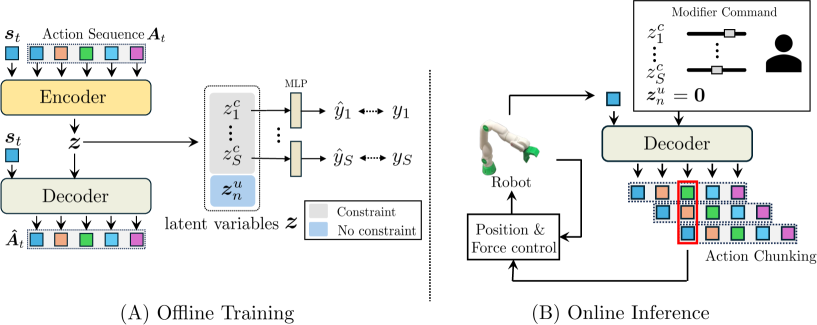

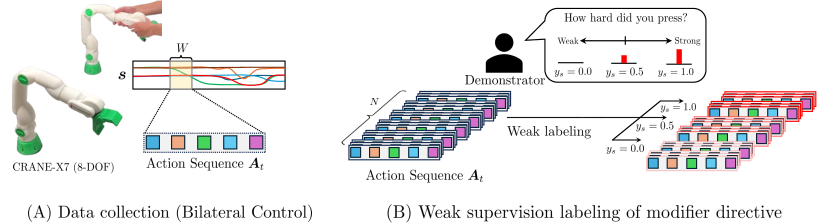

技术框架:该方法主要包含以下几个阶段:1) 数据收集:收集包含人类指令和对应机器人动作的演示数据。2) 数据分割与标注:将演示数据分割成短序列,并为每个序列分配对应于特定修饰语类型的弱监督标签。3) 模型训练:训练一个运动生成模型,该模型能够学习从修饰语指令到动作的映射。4) 在线动作调整:在任务执行过程中,根据接收到的修饰语指令,利用训练好的模型在线调整机器人动作。

关键创新:该论文的关键创新在于提出了一种基于解耦表征学习的模仿学习方法,能够使机器人根据人类指令中的修饰语指令在线调整动作。与传统的批处理方法不同,该方法能够在任务执行过程中实时响应指令的变化,提高了机器人的灵活性和适应性。此外,使用弱监督学习方法,降低了数据标注的成本。

关键设计:论文中关键的设计包括:1) 如何有效地分割演示数据并分配弱监督标签,以确保模型能够学习到准确的修饰语指令与动作之间的对应关系。2) 运动生成模型的具体结构,例如,可以使用循环神经网络(RNN)或Transformer等模型来处理序列数据。3) 损失函数的设计,例如,可以使用交叉熵损失函数来训练分类器,以区分不同的修饰语类型,并使用均方误差损失函数来训练回归器,以预测相应的动作。

🖼️ 关键图片

📊 实验亮点

该方法在擦拭和抓取放置任务中进行了评估,实验结果表明,该方法能够根据修饰语指令在线调整机器人动作,优于传统的批处理方法。具体而言,该方法能够根据不同的修饰语指令,生成不同的动作序列,例如,在擦拭任务中,可以根据“更用力”或“更慢”等指令调整擦拭的力度和速度。

🎯 应用场景

该研究成果可应用于各种需要机器人与人类协作的场景,例如:智能制造、医疗康复、家庭服务等。在智能制造中,机器人可以根据操作人员的指令调整动作,完成复杂的装配任务。在医疗康复中,机器人可以根据治疗师的指令调整运动轨迹,辅助患者进行康复训练。在家庭服务中,机器人可以根据用户的指令完成各种家务任务。

📄 摘要(原文)

In the field of robot learning, coordinating robot actions through language instructions is becoming increasingly feasible. However, adapting actions to human instructions remains challenging, as such instructions are often qualitative and require exploring behaviors that satisfy varying conditions. This paper proposes a motion generation model that adapts robot actions in response to modifier directives human instructions imposing behavioral conditions during task execution. The proposed method learns a mapping from modifier directives to actions by segmenting demonstrations into short sequences, assigning weakly supervised labels corresponding to specific modifier types. We evaluated our method in wiping and pick and place tasks. Results show that it can adjust motions online in response to modifier directives, unlike conventional batch-based methods that cannot adapt during execution.