EMMA: Scaling Mobile Manipulation via Egocentric Human Data

作者: Lawrence Y. Zhu, Pranav Kuppili, Ryan Punamiya, Patcharapong Aphiwetsa, Dhruv Patel, Simar Kareer, Sehoon Ha, Danfei Xu

分类: cs.RO

发布日期: 2025-09-04 (更新: 2025-12-27)

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

EMMA:利用以人为中心的视觉数据扩展移动操作模仿学习

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱六:视频提取与匹配 (Video Extraction) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 移动操作 模仿学习 人机协作 机器人学习 以人为中心 数据增强 Transformer网络

📋 核心要点

- 移动操作模仿学习依赖昂贵的机器人遥操作数据,限制了其扩展性。

- EMMA通过联合训练人类移动操作数据和静态机器人数据,避免了对移动机器人遥操作数据的依赖。

- 实验表明,EMMA在真实世界任务中表现与Mobile ALOHA相当,并能泛化到新场景。

📝 摘要(中文)

移动操作模仿学习的扩展受限于昂贵的移动机器人遥操作数据收集。本文提出了一种名为以人为中心的移动操作(EMMA)的端到端框架,该框架利用人类移动操作数据和静态机器人数据训练移动操作策略,从而避免了移动遥操作。具体而言,EMMA联合训练人类全身运动数据和静态机器人数据。在三个真实世界任务的实验中,EMMA表现出与基于遥操作移动机器人数据(Mobile ALOHA)训练的基线方法相当的性能,在完整任务成功率方面实现了更高或等效的性能。研究发现,EMMA能够泛化到新的空间配置和场景,并且随着人类数据量的增加,性能呈现积极的扩展趋势,为真实世界环境中可扩展的机器人学习开辟了新的途径。

🔬 方法详解

问题定义:论文旨在解决移动操作模仿学习中数据获取成本高昂的问题。现有的方法主要依赖于机器人遥操作来收集训练数据,这种方式耗时耗力,难以扩展到复杂的任务和环境中。因此,如何降低数据收集成本,提高移动操作模仿学习的效率和泛化能力是亟待解决的问题。

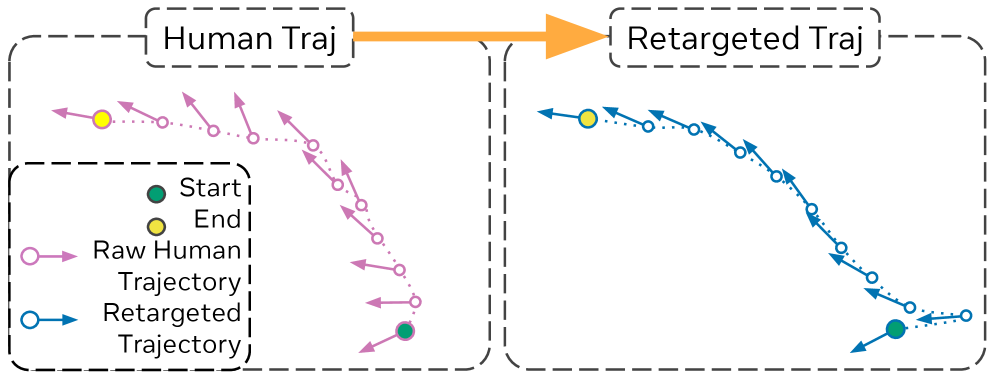

核心思路:论文的核心思路是利用人类的移动操作数据来替代或补充机器人遥操作数据。人类在执行移动操作任务时具有丰富的经验和灵活性,通过学习人类的操作行为,可以有效地训练机器人策略。此外,论文还利用静态机器人数据来增强策略的鲁棒性和泛化能力。

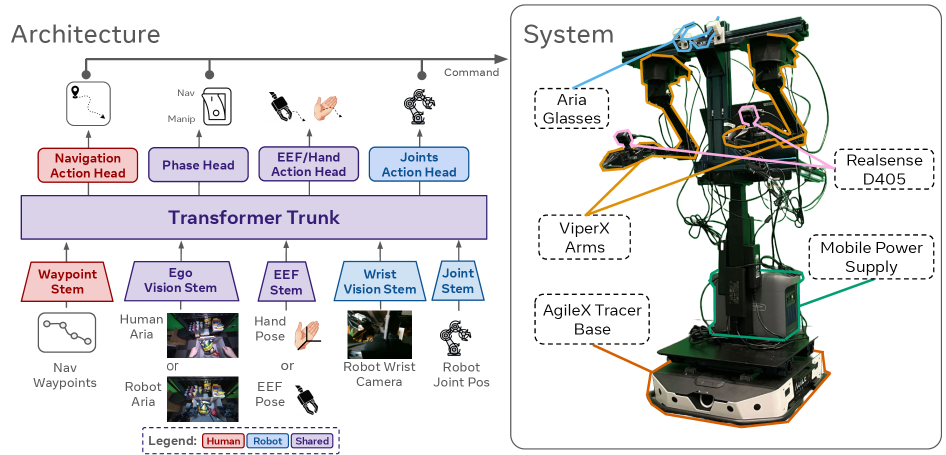

技术框架:EMMA框架主要包含两个部分:人类数据收集和策略训练。首先,通过以人为中心的视觉传感器记录人类执行移动操作任务的数据,包括图像、姿态等信息。然后,将人类数据与静态机器人数据进行联合训练,学习一个能够控制移动机器人的策略。该策略可以根据输入的图像信息,输出机器人的动作指令,从而完成相应的移动操作任务。

关键创新:论文的关键创新在于提出了一种利用人类数据进行移动操作模仿学习的新方法。与传统的机器人遥操作方法相比,该方法可以显著降低数据收集成本,提高学习效率。此外,论文还提出了一种联合训练人类数据和静态机器人数据的策略,进一步增强了策略的泛化能力。

关键设计:论文中使用了Transformer网络来处理以人为中心的视觉数据,并学习人类的操作行为。损失函数包括模仿学习损失和正则化损失,用于约束策略的学习过程。此外,论文还采用了数据增强技术,例如随机裁剪、旋转等,来提高策略的鲁棒性。

🖼️ 关键图片

📊 实验亮点

EMMA在三个真实世界的移动操作任务中取得了显著的成果。与基于遥操作数据训练的Mobile ALOHA相比,EMMA在完整任务成功率方面实现了更高或等效的性能。此外,实验还表明,EMMA能够泛化到新的空间配置和场景,并且随着人类数据量的增加,性能呈现积极的扩展趋势。

🎯 应用场景

EMMA具有广泛的应用前景,例如在家庭服务、物流仓储、医疗护理等领域。通过学习人类的操作行为,机器人可以更好地理解和适应人类的需求,从而提供更智能、更高效的服务。此外,EMMA还可以应用于危险环境下的作业,例如灾难救援、核电站维护等,从而保障人类的安全。

📄 摘要(原文)

Scaling mobile manipulation imitation learning is bottlenecked by expensive mobile robot teleoperation. We present Egocentric Mobile MAnipulation (EMMA), an end-to-end framework training mobile manipulation policies from human mobile manipulation data with static robot data, sidestepping mobile teleoperation. To accomplish this, we co-train human full-body motion data with static robot data. In our experiments across three real-world tasks, EMMA demonstrates comparable performance to baselines trained on teleoperated mobile robot data (Mobile ALOHA), achieving higher or equivalent task performance in full task success. We find that EMMA is able to generalize to new spatial configurations and scenes, and we observe positive performance scaling as we increase the hours of human data, opening new avenues for scalable robotic learning in real-world environments. Details of this project can be found at https://ego-moma.github.io/.