Solving Robotics Tasks with Prior Demonstration via Exploration-Efficient Deep Reinforcement Learning

作者: Chengyandan Shen, Christoffer Sloth

分类: cs.RO, cs.LG

发布日期: 2025-09-04 (更新: 2026-01-08)

备注: This paper has been accepted for Journal publication in Frontiers in Robotics and AI

💡 一句话要点

提出一种探索高效的深度强化学习框架DRLR,利用先验演示解决机器人任务。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 深度强化学习 模仿学习 机器人控制 探索效率 Sim2Real

📋 核心要点

- 现有基于演示的强化学习方法在探索效率方面存在不足,易受自举误差影响,导致探索效率低下。

- DRLR框架通过校准Q值来减轻自举误差,并使用SAC策略防止收敛到次优策略,从而提升探索效率。

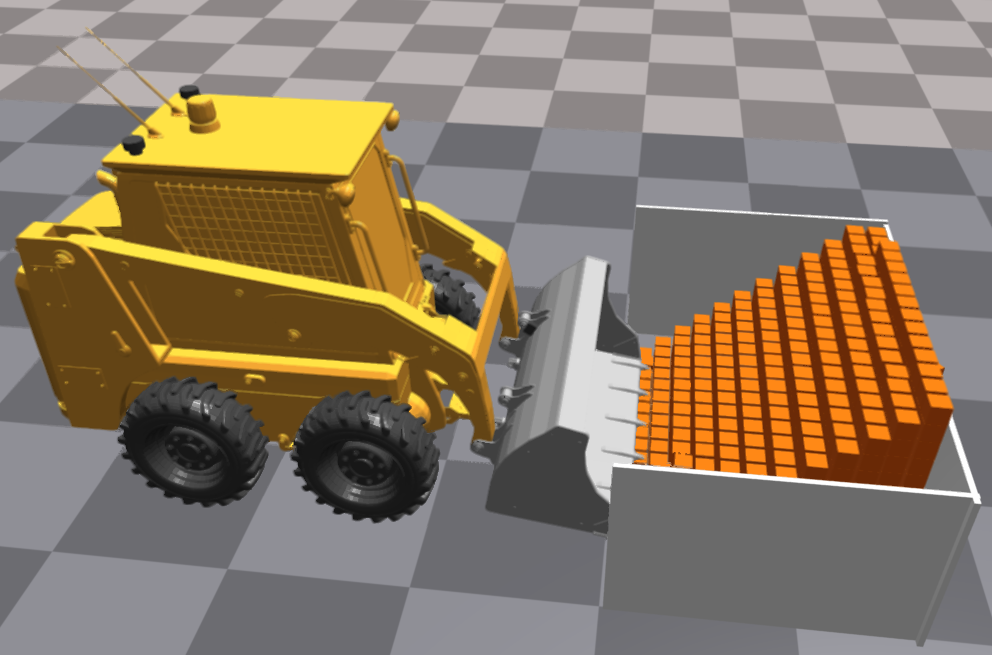

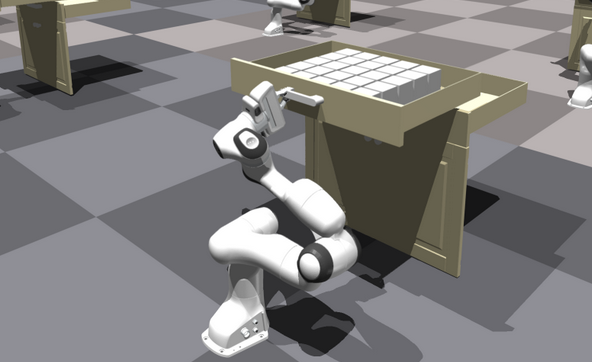

- 在铲斗装载和打开抽屉等机器人任务中,DRLR表现出良好的性能,并在真实轮式装载机上成功部署。

📝 摘要(中文)

本文提出了一种探索高效的深度强化学习框架DRLR,该框架结合了演示学习来解决机器人任务。DRLR框架基于模仿引导的强化学习(IBRL)算法开发。我们通过修改动作选择模块来改进IBRL,提出的动作选择模块提供了一个校准的Q值,从而减轻了自举误差,否则会导致低效的探索。此外,为了防止强化学习策略收敛到次优策略,使用SAC作为强化学习策略,而不是TD3。通过学习两个机器人任务:铲斗装载和打开抽屉,实验验证了我们的方法在减轻自举误差和防止过拟合方面的有效性,这两个任务需要与环境进行广泛的交互。仿真结果还证明了DRLR框架在具有低维和高维状态-动作空间以及不同演示质量的任务中的鲁棒性。为了在真实的工业机器人任务上评估所开发的框架,铲斗装载任务被部署在真实的轮式装载机上。Sim2Real结果验证了DRLR框架的成功部署。

🔬 方法详解

问题定义:论文旨在解决机器人任务中,利用先验演示进行强化学习时,探索效率低下的问题。现有的方法容易受到自举误差的影响,导致探索过程陷入局部最优,难以找到全局最优策略。此外,如何有效地利用演示数据,防止策略过早收敛到次优解也是一个挑战。

核心思路:论文的核心思路是通过改进模仿引导的强化学习(IBRL)算法,提出一种探索高效的深度强化学习框架DRLR。DRLR的关键在于校准Q值,从而减轻自举误差,并使用SAC算法作为强化学习策略,以防止策略收敛到次优解。通过这种方式,DRLR能够更有效地利用演示数据,并进行更充分的探索。

技术框架:DRLR框架主要包含以下几个模块:1) 演示数据模块:提供先验的演示数据,用于初始化策略和价值函数。2) 动作选择模块:该模块负责根据当前状态和策略选择动作,其核心在于校准Q值,减轻自举误差。3) 强化学习模块:使用SAC算法作为强化学习策略,负责根据环境反馈更新策略和价值函数。4) 策略更新模块:根据强化学习模块的输出,更新策略,并利用演示数据进行正则化,防止过拟合。

关键创新:DRLR最重要的技术创新点在于动作选择模块中校准Q值的机制。传统的IBRL算法容易受到自举误差的影响,导致Q值估计不准确,从而影响探索效率。DRLR通过校准Q值,使其更加准确,从而提高了探索效率。此外,使用SAC算法代替TD3算法,可以更好地平衡探索和利用,防止策略收敛到次优解。

关键设计:DRLR的关键设计包括:1) Q值校准机制:具体校准方法未知,但其目的是减少自举误差。2) SAC算法:使用SAC算法作为强化学习策略,SAC是一种基于最大熵的强化学习算法,可以鼓励探索,防止策略过早收敛。3) 损失函数:损失函数的设计需要平衡模仿学习和强化学习的目标,具体形式未知。4) 网络结构:策略网络和价值网络的具体结构未知,但需要能够处理高维状态-动作空间。

🖼️ 关键图片

📊 实验亮点

实验结果表明,DRLR框架在铲斗装载和打开抽屉等机器人任务中表现出良好的性能。与传统的IBRL算法相比,DRLR能够更有效地利用演示数据,并进行更充分的探索。在真实的轮式装载机上进行的Sim2Real实验验证了DRLR框架的成功部署,表明该方法具有良好的泛化能力。具体的性能提升数据未知。

🎯 应用场景

该研究成果可广泛应用于工业机器人、自动驾驶、服务机器人等领域。通过结合先验演示和高效探索,可以显著降低机器人学习复杂任务的难度和时间成本。例如,在工业生产线上,可以利用该方法快速训练机器人完成装配、搬运等任务。在自动驾驶领域,可以利用该方法提高自动驾驶系统在复杂环境下的适应能力。

📄 摘要(原文)

This paper proposes an exploration-efficient Deep Reinforcement Learning with Reference policy (DRLR) framework for learning robotics tasks that incorporates demonstrations. The DRLR framework is developed based on an algorithm called Imitation Bootstrapped Reinforcement Learning (IBRL). We propose to improve IBRL by modifying the action selection module. The proposed action selection module provides a calibrated Q-value, which mitigates the bootstrapping error that otherwise leads to inefficient exploration. Furthermore, to prevent the RL policy from converging to a sub-optimal policy, SAC is used as the RL policy instead of TD3. The effectiveness of our method in mitigating bootstrapping error and preventing overfitting is empirically validated by learning two robotics tasks: bucket loading and open drawer, which require extensive interactions with the environment. Simulation results also demonstrate the robustness of the DRLR framework across tasks with both low and high state-action dimensions, and varying demonstration qualities. To evaluate the developed framework on a real-world industrial robotics task, the bucket loading task is deployed on a real wheel loader. The sim2real results validate the successful deployment of the DRLR framework.