Reactive In-Air Clothing Manipulation with Confidence-Aware Dense Correspondence and Visuotactile Affordance

作者: Neha Sunil, Megha Tippur, Arnau Saumell, Edward Adelson, Alberto Rodriguez

分类: cs.RO, cs.AI, cs.LG

发布日期: 2025-09-04

备注: Accepted at CoRL 2025. Project website: https://mhtippur.github.io/inairclothmanipulation/

💡 一句话要点

提出基于置信度感知稠密对应和触觉可供性的服装空中操作方法

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 服装操作 机器人 视觉触觉 稠密对应 可供性

📋 核心要点

- 服装操作面临复杂形变、材料差异和自遮挡等挑战,现有方法依赖于简化假设,限制了其在复杂环境中的应用。

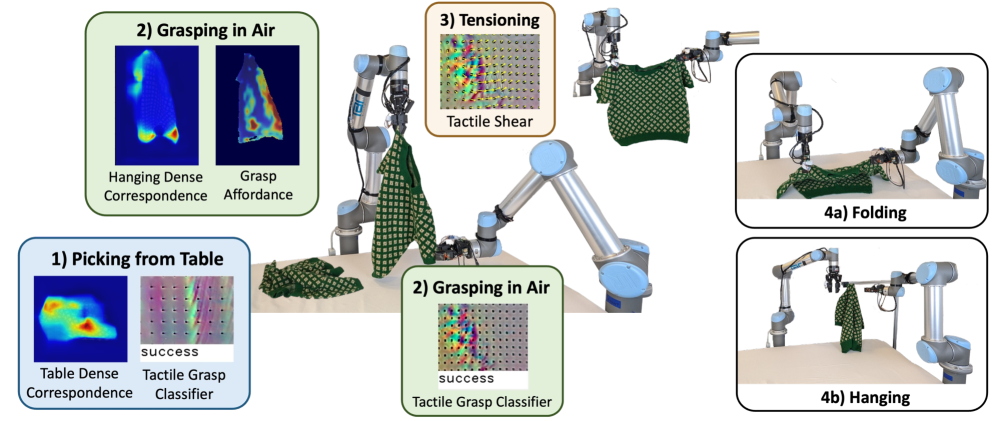

- 该论文提出一种双臂视觉触觉框架,利用置信度感知的稠密对应和触觉监督的可供性,直接操作褶皱和悬挂的服装。

- 实验表明,该系统能够处理高度遮挡的场景,并在折叠和悬挂任务中表现出良好的性能,同时具备从人类演示中学习的能力。

📝 摘要(中文)

服装操作由于其复杂的形态、多变的材料动力学和频繁的自遮挡而具有挑战性。现有的系统通常会展平服装或假设关键特征的可见性。本文提出了一种双臂视觉触觉框架,该框架结合了置信度感知的稠密视觉对应和触觉监督的抓取可供性,可以直接操作褶皱和悬挂的服装。对应模型在一个定制的高保真模拟数据集上进行训练,使用分布损失来捕获服装的对称性并生成对应置信度估计。这些估计指导一个反应式状态机,该状态机根据感知不确定性调整折叠策略。同时,一个视觉触觉抓取可供性网络,使用高分辨率触觉反馈进行自监督,确定哪些区域是物理上可抓取的。相同的触觉分类器在执行期间用于实时抓取验证。通过在低置信度状态下推迟动作,该系统可以处理高度遮挡的桌面和空中配置。我们在折叠和悬挂任务中展示了我们的任务无关的抓取选择模块。此外,我们的稠密描述符为其他规划方式提供了一个可重用的中间表示,例如从人类视频演示中提取抓取目标,为更通用和可扩展的服装操作铺平了道路。

🔬 方法详解

问题定义:服装操作的难点在于服装的复杂形态、材料的易变性以及频繁的自遮挡。现有方法通常依赖于简化假设,例如展平服装或者假设关键特征可见,这限制了它们在真实复杂环境中的应用。因此,需要一种能够直接处理褶皱和悬挂服装的方法。

核心思路:该论文的核心思路是结合视觉和触觉信息,利用置信度感知的稠密对应来理解服装的形状和姿态,并利用触觉监督的可供性来选择合适的抓取点。通过融合这两种模态的信息,系统能够更好地应对服装操作中的不确定性和复杂性。

技术框架:该系统主要包含两个模块:置信度感知的稠密对应模块和视觉触觉抓取可供性模块。稠密对应模块负责建立服装不同部位之间的对应关系,并估计对应关系的置信度。抓取可供性模块负责根据视觉和触觉信息,判断哪些区域适合抓取。这两个模块协同工作,共同完成服装操作任务。系统使用一个反应式状态机,根据感知不确定性动态调整折叠策略。

关键创新:该论文的关键创新在于以下几点:1) 提出了置信度感知的稠密对应方法,能够更好地处理服装的自遮挡和形变;2) 提出了视觉触觉抓取可供性网络,能够根据视觉和触觉信息选择合适的抓取点;3) 将这两个模块集成到一个统一的框架中,实现了对褶皱和悬挂服装的直接操作。与现有方法相比,该方法不需要对服装进行预处理,能够更好地适应真实环境。

关键设计:稠密对应模型使用分布损失函数,以捕获服装的对称性并生成对应置信度估计。视觉触觉抓取可供性网络使用高分辨率触觉反馈进行自监督学习。反应式状态机根据稠密对应的置信度动态调整折叠策略。系统使用相同的触觉分类器进行实时抓取验证。

🖼️ 关键图片

📊 实验亮点

该论文展示了在折叠和悬挂任务中的实验结果,证明了该系统的有效性。该系统能够处理高度遮挡的桌面和空中配置,并且能够从人类视频演示中提取抓取目标。实验结果表明,该系统具有良好的泛化能力和鲁棒性。具体的性能数据和对比基线在论文中进行了详细的描述。

🎯 应用场景

该研究成果可应用于服装制造、仓储物流、家庭服务等领域。例如,在服装制造中,机器人可以自动完成服装的折叠、整理和包装;在仓储物流中,机器人可以自动完成服装的拣选和分拣;在家庭服务中,机器人可以帮助人们整理衣物。该研究有望提高服装操作的自动化水平,降低人工成本,并改善人们的生活质量。

📄 摘要(原文)

Manipulating clothing is challenging due to complex configurations, variable material dynamics, and frequent self-occlusion. Prior systems often flatten garments or assume visibility of key features. We present a dual-arm visuotactile framework that combines confidence-aware dense visual correspondence and tactile-supervised grasp affordance to operate directly on crumpled and suspended garments. The correspondence model is trained on a custom, high-fidelity simulated dataset using a distributional loss that captures cloth symmetries and generates correspondence confidence estimates. These estimates guide a reactive state machine that adapts folding strategies based on perceptual uncertainty. In parallel, a visuotactile grasp affordance network, self-supervised using high-resolution tactile feedback, determines which regions are physically graspable. The same tactile classifier is used during execution for real-time grasp validation. By deferring action in low-confidence states, the system handles highly occluded table-top and in-air configurations. We demonstrate our task-agnostic grasp selection module in folding and hanging tasks. Moreover, our dense descriptors provide a reusable intermediate representation for other planning modalities, such as extracting grasp targets from human video demonstrations, paving the way for more generalizable and scalable garment manipulation.