Enhancing Reliability in LLM-Integrated Robotic Systems: A Unified Approach to Security and Safety

作者: Wenxiao Zhang, Xiangrui Kong, Conan Dewitt, Thomas Bräunl, Jin B. Hong

分类: cs.RO, cs.AI

发布日期: 2025-09-02

💡 一句话要点

提出统一框架,提升LLM集成机器人系统在安全和复杂环境下的可靠性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: LLM集成机器人 安全性 可靠性 提示注入攻击 安全验证

📋 核心要点

- 现有LLM集成机器人系统在对抗攻击和复杂环境中面临安全性和可靠性挑战。

- 提出统一框架,结合提示组装、状态管理和安全验证,提升系统安全性和操作可靠性。

- 实验表明,该框架在对抗攻击和复杂环境中显著提升了LLM集成机器人系统的性能。

📝 摘要(中文)

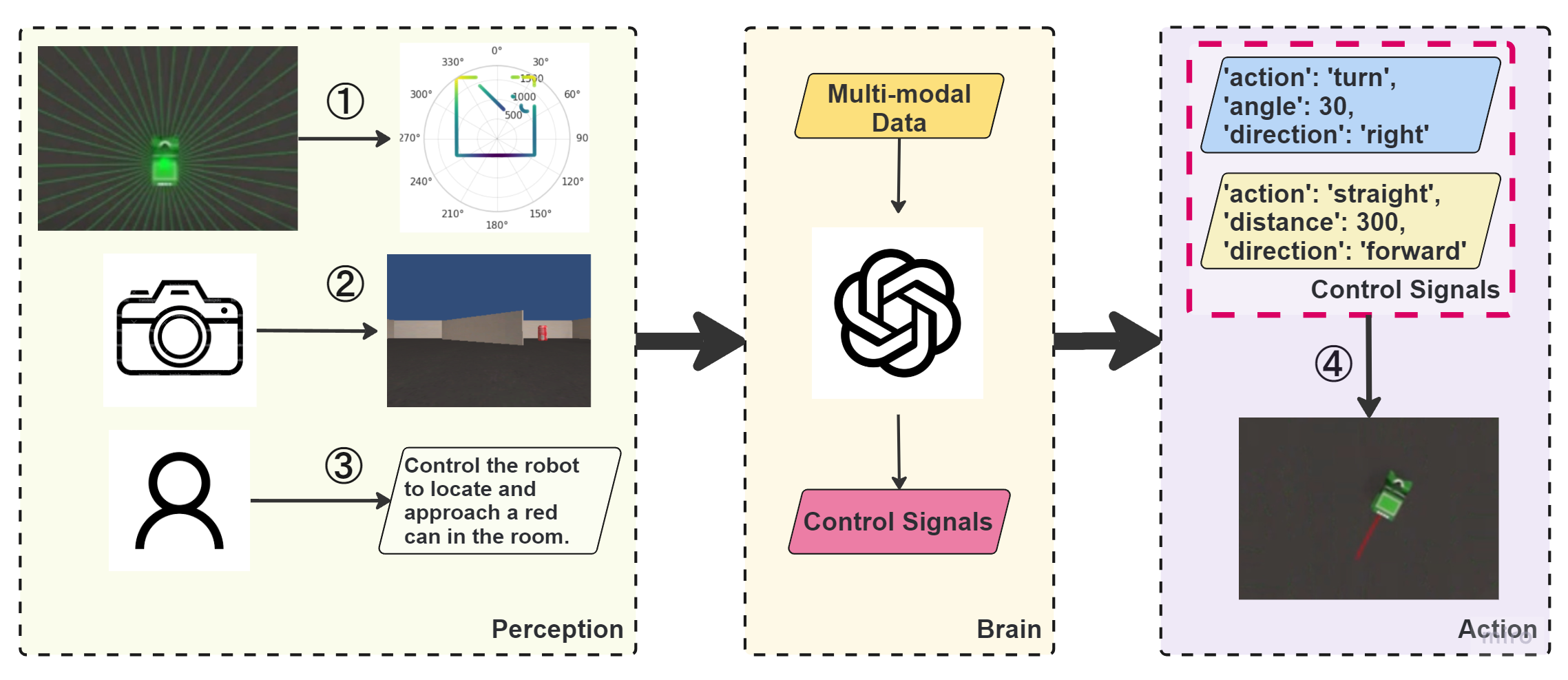

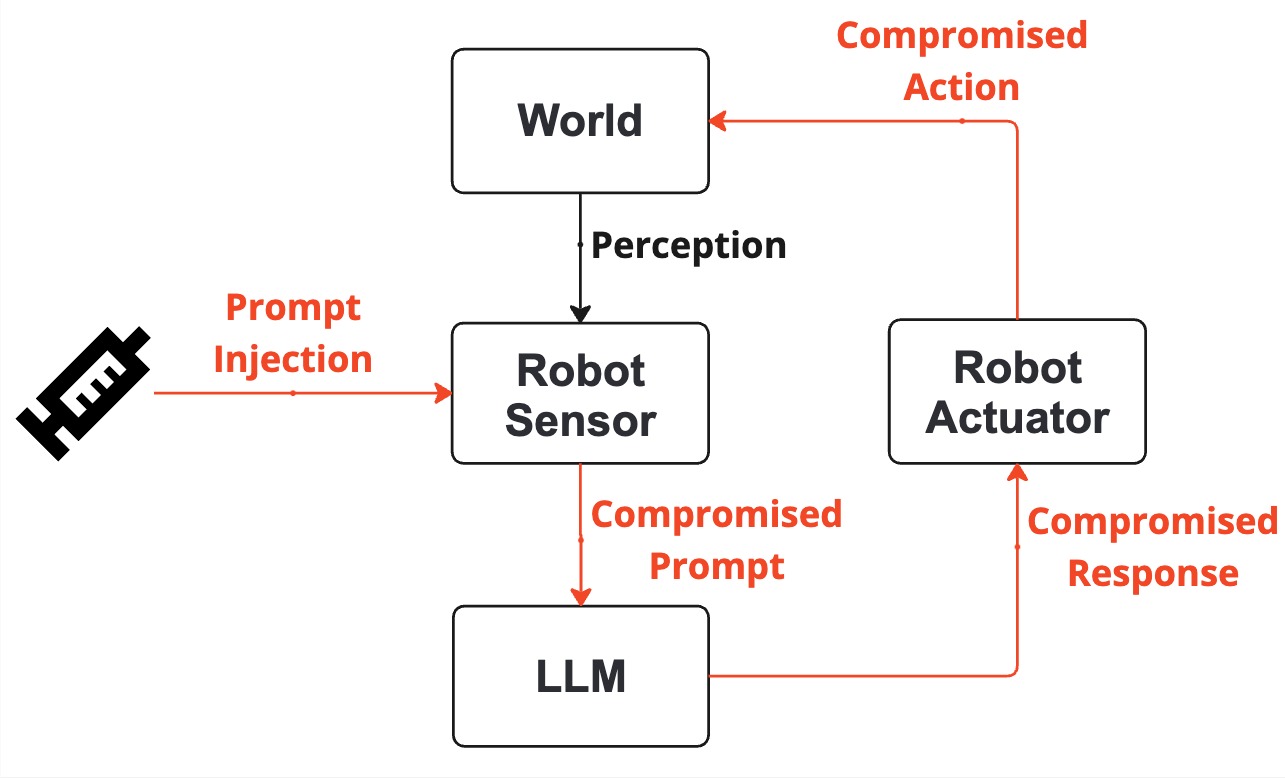

本文提出了一种统一的框架,旨在提高集成大型语言模型(LLM)的机器人系统的可靠性,包括防御对抗攻击的安全性和在复杂环境中运行的安全性。该框架通过结合提示组装、状态管理和安全验证机制,缓解提示注入攻击,同时确保操作安全。实验结果表明,在注入攻击下性能提升了30.8%,在对抗条件下复杂环境中的性能提升高达325%。这项工作弥合了基于LLM的机器人系统中安全性和安全性之间的差距,为在现实环境中部署可靠的LLM集成移动机器人提供了可操作的见解。该框架已开源,并提供模拟和物理部署演示。

🔬 方法详解

问题定义:论文旨在解决将大型语言模型(LLM)集成到机器人系统中时,面临的安全性和可靠性问题。具体来说,现有方法容易受到提示注入攻击,并且在复杂环境中难以保证操作安全。这些问题限制了LLM集成机器人在现实世界中的部署。

核心思路:论文的核心思路是通过一个统一的框架,同时解决安全性和安全性问题。该框架通过控制LLM的输入(提示组装),管理机器人状态,并进行安全验证,从而提高系统的整体可靠性。这种统一的方法旨在弥合安全和安全之间的差距。

技术框架:该框架包含三个主要模块:提示组装(Prompt Assembling)、状态管理(State Management)和安全验证(Safety Validation)。提示组装模块负责构建安全可靠的LLM输入;状态管理模块跟踪机器人的状态和环境信息;安全验证模块则负责检查机器人的动作是否安全,并防止其执行危险操作。整个流程确保LLM在安全可控的环境中运行。

关键创新:该框架的关键创新在于其统一性,它将安全性和安全性问题放在一个框架下解决,而不是分别处理。此外,该框架还引入了状态管理模块,使LLM能够更好地理解和响应环境变化。这种集成的方法能够更有效地提高LLM集成机器人系统的可靠性。

关键设计:提示组装模块的设计考虑了对抗攻击的防御,通过预定义的模板和验证机制,防止恶意用户通过提示注入来控制机器人。安全验证模块则使用规则或机器学习模型来判断机器人的动作是否安全。状态管理模块则维护一个关于机器人和环境信息的动态数据库,供LLM参考。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该框架在提示注入攻击下性能提升了30.8%,证明了其在防御对抗攻击方面的有效性。在复杂环境的对抗条件下,性能提升高达325%,表明该框架显著提高了机器人在复杂环境中的操作安全性。这些数据突出了该框架在提高LLM集成机器人系统可靠性方面的显著优势。

🎯 应用场景

该研究成果可广泛应用于各种需要LLM集成机器人的场景,例如智能仓储、自动驾驶、家庭服务机器人和工业自动化。通过提高LLM集成机器人的安全性和可靠性,可以使其在更复杂的环境中安全高效地工作,从而提升生产效率和服务质量,并降低安全风险。

📄 摘要(原文)

Integrating large language models (LLMs) into robotic systems has revolutionised embodied artificial intelligence, enabling advanced decision-making and adaptability. However, ensuring reliability, encompassing both security against adversarial attacks and safety in complex environments, remains a critical challenge. To address this, we propose a unified framework that mitigates prompt injection attacks while enforcing operational safety through robust validation mechanisms. Our approach combines prompt assembling, state management, and safety validation, evaluated using both performance and security metrics. Experiments show a 30.8% improvement under injection attacks and up to a 325% improvement in complex environment settings under adversarial conditions compared to baseline scenarios. This work bridges the gap between safety and security in LLM-based robotic systems, offering actionable insights for deploying reliable LLM-integrated mobile robots in real-world settings. The framework is open-sourced with simulation and physical deployment demos at https://llmeyesim.vercel.app/